Phỏng vấn mới nhất của Jensen Huang: Ép DeepSeek và Huawei phải liên kết sâu sắc — điều này quá đáng sợ đối với Mỹ

Tuyển chọn TechFlowTuyển chọn TechFlow

Phỏng vấn mới nhất của Jensen Huang: Ép DeepSeek và Huawei phải liên kết sâu sắc — điều này quá đáng sợ đối với Mỹ

Về xuất khẩu sang Trung Quốc, ông chỉ trích chính sách kiểm soát xuất khẩu cực đoan là hết sức ngây thơ.

Biên tập: Tiểu Tiểu, NetEase Intelligent

Gần đây, ông Jen-Hsun Huang – Giám đốc điều hành (CEO) của NVIDIA – đã tham gia cuộc phỏng vấn độc quyền với Dwarkesh Patel, người dẫn chương trình podcast công nghệ nổi tiếng tại Mỹ, để toàn diện phản hồi các chủ đề then chốt như “hào thành” của công ty, cạnh tranh với chip TPU của Google và xuất khẩu chip sang Trung Quốc.

Ông nhấn mạnh rằng “hào thành” của NVIDIA đã ăn sâu vào chuỗi cung ứng, thông qua cam kết mua hàng trị giá hàng trăm tỷ USD với TSMC và các nhà cung cấp bộ nhớ nhằm thiết lập mối liên kết chiến lược.

Về cạnh tranh với TPU, ông Huang chỉ ra rằng Anthropic chỉ là một ngoại lệ đặc biệt chứ không phải xu hướng chung trong sự tăng trưởng của ASIC. Các giải pháp tính toán tăng tốc của NVIDIA bao phủ một thị trường rộng lớn vượt xa AI – từ động lực học phân tử, xử lý dữ liệu đến cơ học chất lỏng; đồng thời, khả năng lập trình cao của CUDA cho phép hiệu năng nâng cấp 10–50 lần mỗi năm.

Ông cũng giải thích lý do NVIDIA không tự mình trở thành nhà cung cấp dịch vụ điện toán đám mây quy mô siêu lớn. Dù có dòng tiền dồi dào, NVIDIA vẫn kiên định nguyên tắc “chỉ làm những việc bắt buộc và hạn chế tối đa số lượng việc làm”. Công ty lựa chọn đầu tư vào hệ sinh thái – như CoreWeave, OpenAI và Anthropic – thay vì trực tiếp cạnh tranh với khách hàng. Ông thừa nhận việc chưa đầu tư quy mô lớn vào Anthropic sớm hơn là một sai lầm của bản thân. Ngoài ra, ông khẳng định ngay cả khi cách mạng AI chưa từng xảy ra, NVIDIA vẫn sẽ là một công ty khổng lồ nhờ tính toán tăng tốc trong các lĩnh vực vật lý, hóa học và xử lý dữ liệu.

Về xuất khẩu sang Trung Quốc, ông phê bình chính sách kiểm soát xuất khẩu cực đoan là “thiếu chín chắn”. Ông Huang nêu rõ sức mạnh tính toán AI là sự kết hợp giữa chip và năng lượng; dù bị giới hạn bởi máy quang khắc EUV, Trung Quốc vẫn sở hữu năng lực sản xuất chip 7nm quy mô khổng lồ. Xét thực tế các mô hình ngôn ngữ lớn (LLM) chủ lưu hiện nay chủ yếu được huấn luyện trên kiến trúc thế hệ Hopper, Trung Quốc hoàn toàn có thể bù đắp khoảng cách hiệu năng từng chip bằng nguồn điện dồi dào và mở rộng quy mô cụm chip.

Hơn nữa, đội ngũ nghiên cứu AI đồ sộ của Trung Quốc đang cải thiện hiệu năng mô hình thông qua khoa học máy tính hiệu quả hơn. Ông Huang lấy ví dụ DeepSeek để cảnh báo đây tuyệt đối không phải tiến bộ nhỏ nhặt. Nếu những mô hình mã nguồn mở xuất sắc như vậy buộc phải tối ưu sâu cho phần cứng nội địa như Huawei và hoạt động tốt nhất trên nền tảng đó, điều này khách quan sẽ làm suy yếu lợi thế toàn cầu của “stack công nghệ Mỹ”. Ông cho rằng việc chủ động từ bỏ thị trường lớn thứ hai thế giới sẽ thúc đẩy Trung Quốc xây dựng một kiến trúc tính toán nền tảng độc lập với Mỹ. Khi những công nghệ dựa trên tiêu chuẩn mã nguồn mở này dần lan tỏa sang các nước phương Nam, Mỹ rất có thể rơi vào thế bị động trong cuộc cạnh tranh dài hạn về tiêu chuẩn sinh thái AI.

Dưới đây là toàn văn cuộc phỏng vấn ông Huang:

Kiểm soát chuỗi cung ứng có phải là “hào thành” lớn nhất của NVIDIA?

Patel: Nhiều công ty phần mềm đang giảm giá trị do thị trường lo ngại AI sẽ biến phần mềm thành hàng hóa tiêu chuẩn. Một quan điểm cho rằng NVIDIA chỉ gửi tài liệu thiết kế cho TSMC, còn TSMC sản xuất chip logic và chuyển mạch; sau đó SK Hynix, Micron và Samsung đóng gói bộ nhớ HBM; cuối cùng, các nhà sản xuất thiết bị gốc (ODM) tại Đài Loan lắp ráp thành tủ máy. Về bản chất, NVIDIA chỉ làm phần mềm, còn phần cứng do bên ngoài sản xuất. Nếu phần mềm bị hàng hóa hóa, liệu NVIDIA cũng sẽ bị hàng hóa hóa?

Huang: Cuối cùng, luôn cần một thực thể nào đó chuyển đổi electron thành token. Quá trình chuyển đổi này rất khó bị hàng hóa hóa hoàn toàn. Việc khiến một token có giá trị hơn token khác giống như khiến một phân tử có giá trị hơn phân tử khác — đòi hỏi khối lượng lớn công nghệ, kỹ thuật, khoa học và sáng chế. Những công việc này còn xa mới được hiểu thấu đáo và cũng chưa hề kết thúc. Tôi không tin tình trạng hàng hóa hóa này sẽ xảy ra.

Tuy nhiên, chúng ta sẽ làm cho quá trình này hiệu quả hơn. Cách bạn đặt câu hỏi chính là mô hình tư duy tôi áp dụng cho công ty: đầu vào là electron, đầu ra là token, và NVIDIA nằm ở giữa. Nguyên tắc của chúng tôi là chỉ làm những việc bắt buộc và hạn chế tối đa số lượng việc làm. “Hạn chế tối đa” nghĩa là bất cứ việc gì tôi không cần tự làm, tôi sẽ tìm đối tác hợp tác để nó trở thành một phần trong hệ sinh thái của tôi.

Ngày nay, NVIDIA có thể là công ty sở hữu hệ sinh thái đối tác lớn nhất thế giới, bao gồm cả chuỗi cung ứng đầu vào – đầu ra, tất cả các công ty máy tính, nhà phát triển ứng dụng và nhà cung cấp mô hình. AI giống như một chiếc bánh gồm năm lớp, và chúng tôi có hệ sinh thái riêng ở mỗi lớp. Chúng tôi hạn chế tối đa số lượng việc làm, nhưng phần việc bắt buộc mà chúng tôi đảm nhận lại cực kỳ khó khăn — và tôi không tin phần việc này sẽ bị hàng hóa hóa.

Ngoài ra, tôi cũng không nghĩ phần mềm doanh nghiệp sẽ bị hàng hóa hóa. Hiện nay, phần lớn công ty phần mềm là nhà cung cấp công cụ — ví dụ như Excel, PowerPoint, Cadence và Synopsys. Quan điểm của tôi trái ngược với nhiều người: số lượng agent AI sẽ tăng theo cấp số mũ, và số lượng người dùng công cụ cũng sẽ tăng theo cấp số mũ. Số lượng phiên bản công cụ có thể bùng nổ.

Chẳng hạn, trình biên dịch thiết kế của Synopsys sẽ được sử dụng bởi vô số agent để thực hiện bố trí mạch và kiểm tra quy tắc thiết kế. Hiện nay, điều giới hạn chúng ta là số lượng kỹ sư; nhưng ngày mai, mỗi kỹ sư sẽ có cả một đội ngũ agent hỗ trợ. Chúng ta có thể khám phá không gian thiết kế theo cách chưa từng có, vẫn sử dụng các công cụ hiện tại. Việc sử dụng công cụ với tần suất cao sẽ giúp các công ty phần mềm phát triển thần tốc. Hiện điều này chưa xảy ra vì các agent vẫn chưa đủ khả năng sử dụng công cụ. Hoặc các công ty phần mềm tự xây dựng agent, hoặc các agent sẽ trở nên đủ giỏi để thành thạo các công cụ này — tôi tin cả hai xu hướng đều sẽ diễn ra.

Patel: Trong tài liệu gần đây nhất của ông, tôi thấy NVIDIA cam kết mua hàng gần 100 tỷ USD từ các nhà máy gia công, nhà cung cấp bộ nhớ và nhà đóng gói. Tổ chức nghiên cứu bán dẫn SemiAnalysis ước tính con số này có thể lên tới 250 tỷ USD. Một cách diễn giải là “hào thành” của NVIDIA nằm ở việc khóa trước các thành phần khan hiếm trong nhiều năm tới. Người khác có thể sở hữu bộ tăng tốc, nhưng lại không thể tiếp cận bộ nhớ và chip logic. Đây có phải là “hào thành” chủ yếu của NVIDIA trong vài năm tới?

Huang: Đây là một trong những điều chúng tôi làm được còn người khác thì rất khó. Chúng tôi đã đưa ra cam kết khổng lồ với các nhà cung cấp đầu vào — một số cam kết mang tính công khai như bạn vừa nêu, một số khác mang tính ngầm: ví dụ, tôi gặp các CEO và giải thích chi tiết quy mô ngành công nghiệp sẽ đạt mức nào, vì sao lại như vậy, rồi trình bày lập luận để họ nhìn thấy viễn cảnh tương lai như tôi đã thấy — sau đó họ mới quyết định đầu tư.

Vì sao họ sẵn sàng đầu tư cho tôi chứ không phải người khác? Bởi họ biết tôi có khả năng mua toàn bộ sản phẩm của họ và bán lại thông qua chuỗi cung ứng đầu ra của tôi. Nhu cầu và chuỗi cung ứng đầu ra của NVIDIA quá lớn nên họ sẵn sàng đầu tư vào đầu vào.

Bạn hãy xem hội nghị GTC: mọi người đều trầm trồ trước quy mô và sức hút của sự kiện. Đó là cả cộng đồng AI tụ họp, vì họ cần giao lưu và được nhìn thấy. Tôi tạo ra sân chơi này để đầu ra thấy được đầu vào, đầu vào thấy được đầu ra, và tất cả cùng chứng kiến tiến bộ của AI. Họ còn được gặp trực tiếp các công ty khởi nghiệp AI thuần túy và các startup mới nổi. Nhờ đó, họ có thể kiểm chứng trực tiếp những điều tôi nói. Tôi dành rất nhiều thời gian — trực tiếp hoặc gián tiếp — để giúp chuỗi cung ứng, đối tác và hệ sinh thái hiểu rõ cơ hội phía trước.

Có người nói bài phát biểu chủ đề của tôi giống một buổi giảng dạy và hơi “tra tấn”. Thực tế, đúng là mục đích của tôi như vậy. Tôi phải giúp toàn bộ chuỗi cung ứng, cả đầu vào lẫn đầu ra, và toàn bộ hệ sinh thái hiểu rõ điều gì sẽ xảy ra, vì sao lại xảy ra, khi nào xảy ra, quy mô lớn đến đâu — và quan trọng nhất là tư duy hệ thống như tôi.

Về “hào thành”, thực chất chúng tôi đang định vị cho tương lai. Nếu vài năm tới doanh thu thực sự chạm mốc nghìn tỷ USD, lúc đó chúng tôi tự nhiên có khả năng xây dựng chuỗi cung ứng tương xứng. Nhưng điều kiện tiên quyết là nếu không có quy mô kinh doanh và ảnh hưởng hiện tại, cũng như tốc độ luân chuyển kinh doanh cao — giống như dòng tiền, chuỗi cung ứng cũng có tốc độ luân chuyển và vòng quay riêng. Nếu kinh doanh luân chuyển chậm, chẳng ai muốn xây dựng chuỗi cung ứng cho một “cái khung rỗng”. Lý do chúng tôi duy trì được quy mô hiện tại là nhu cầu đầu ra cực kỳ mạnh mẽ. Khi họ tận mắt chứng kiến, lắng nghe và nhận thức rõ ràng mọi thứ đang thực sự diễn ra, điều đó mới giúp chúng tôi đạt được những thành tựu ngày nay ở quy mô hiện tại.

Patel: Tôi muốn đi sâu hơn vào khả năng đáp ứng của đầu vào. Doanh thu của quý vị tăng gấp đôi liên tục nhiều năm, và lượng sức mạnh tính toán cung cấp cho thế giới mỗi năm tăng hơn gấp ba lần.

Huang: Việc tăng gấp đôi ở quy mô này thực sự đáng kinh ngạc.

Patel: Nhưng xét về chip logic: quý vị là khách hàng lớn nhất của TSMC ở nút N3 và cũng là một trong những khách hàng lớn nhất ở nút N2. SemiAnalysis phát hiện năm nay AI chiếm 60% công suất N3, và năm sau sẽ lên tới 86%. Nếu quý vị đã chiếm phần lớn công suất rồi, làm sao có thể tăng gấp đôi? Cứ năm này qua năm khác tăng gấp đôi? Liệu chúng ta đã bước vào giai đoạn tốc độ tăng trưởng sức mạnh tính toán AI phải chậm lại do giới hạn đầu vào? Ông có thấy giải pháp nào không? Về cốt lõi, làm thế nào để chúng ta có thể tăng gấp đôi công suất nhà máy bán dẫn mỗi năm?

Huang: Ở bất kỳ thời điểm nào, nhu cầu tức thời đều có thể vượt quá tổng nguồn cung toàn cầu ở cả đầu vào và đầu ra — thậm chí có thể bị giới hạn bởi số lượng thợ ống nước, điều này đã từng xảy ra.

Patel: Thợ ống nước nên được mời tham dự GTC năm sau.

Huang: Ý tưởng hay đấy. Nhưng thực ra đây lại là một dấu hiệu tốt. Bạn mong muốn nhu cầu tức thời của một ngành vượt quá tổng nguồn cung; ngược lại mới là điều không tốt. Nếu thiếu hụt một thành phần nào đó quá lớn, cả ngành sẽ đổ xô giải quyết. Bạn thấy giờ đây ít người bàn luận về CoWoS rồi chứ? Vì trong hai năm qua, chúng tôi đã dồn lực giải quyết vấn đề này và hiện tình hình đã khá ổn. TSMC giờ đây hiểu rõ rằng nguồn cung CoWoS phải theo kịp nhu cầu về chip logic và bộ nhớ. Họ đang mở rộng CoWoS và các công nghệ đóng gói tương lai với tốc độ tương đương mở rộng chip logic. Điều này rất tốt, bởi trước đây CoWoS và bộ nhớ HBM vốn là công nghệ chuyên biệt, nay đã trở thành công nghệ tính toán chủ lưu.

Hiện nay, chúng tôi có thể tác động đến chuỗi cung ứng rộng hơn. Ngay từ đầu cách mạng AI, tôi đã từng nói những điều này — cách đây năm năm. Một số người tin tưởng và đầu tư, ví dụ như ông Sanjay Mehrotra — CEO của Micron — cùng đội ngũ của ông ấy. Tôi còn nhớ rõ cuộc họp đó, tôi đã mô tả chính xác điều gì sẽ xảy ra, vì sao lại như vậy và tình hình hôm nay. Họ thực sự đã tăng gấp đôi đầu tư. Chúng tôi hợp tác trong lĩnh vực bộ nhớ LPDDR và HBM, họ đầu tư mạnh và đạt được thành công lớn. Một số người đến muộn hơn, nhưng giờ đây tất cả đều đã tham gia.

Mỗi điểm nghẽn đều nhận được sự chú ý lớn. Hiện chúng tôi bắt đầu dự báo điểm nghẽn trước nhiều năm. Ví dụ, các khoản đầu tư vào Lumentum, Coherent và hệ sinh thái quang tích hợp silicon trong vài năm qua đã tái cấu trúc chuỗi cung ứng. Chúng tôi xây dựng toàn bộ chuỗi cung ứng quanh TSMC và hợp tác với họ phát triển nền tảng tích hợp quang silicon COUPE, phát minh nhiều công nghệ và cấp phép bằng sáng chế cho chuỗi cung ứng nhằm giữ cho hệ sinh thái luôn mở.

Chúng tôi tăng cường chuỗi cung ứng thông qua việc phát minh công nghệ mới, quy trình mới, thiết bị kiểm tra mới (ví dụ như kiểm tra hai mặt), và đầu tư vào các công ty để giúp họ mở rộng sản xuất. Chúng tôi đang nỗ lực định hình hệ sinh thái để chuỗi cung ứng có thể đáp ứng quy mô này.

Patel: Một số điểm nghẽn dường như dễ giải quyết hơn những điểm khác, ví dụ như mở rộng sản xuất CoWoS.

Huang: Chúng tôi chịu trách nhiệm vượt qua điểm nghẽn khó nhất.

Patel: Điểm nghẽn nào?

Huang: Thợ ống nước và thợ điện. Đây là điều khiến tôi lo ngại về những người theo chủ nghĩa “ngày tận thế”. Họ nói việc làm sẽ biến mất, các vị trí sẽ tiêu tan. Nếu chúng ta ngăn người ta trở thành kỹ sư phần mềm, chúng ta sẽ cạn kiệt kỹ sư phần mềm. Mười năm trước cũng đã có những lời tiên tri tương tự. Một số người theo chủ nghĩa “ngày tận thế” khuyên: “Dù thế nào cũng đừng làm bác sĩ chẩn đoán hình ảnh”, và bạn vẫn có thể tìm thấy video trên mạng nói rằng bác sĩ chẩn đoán hình ảnh sẽ là nghề đầu tiên biến mất, thế giới sẽ không còn cần họ nữa. Bạn đoán xem hiện nay chúng ta đang thiếu gì? Chính là bác sĩ chẩn đoán hình ảnh.

Patel: Một số thứ có thể mở rộng quy mô, một số thì không. Vậy mỗi năm quý vị làm ra gấp đôi số chip logic như thế nào? Cuối cùng, cả bộ nhớ lẫn chip logic đều phụ thuộc vào máy quang khắc EUV. Làm sao quý vị có thể nhận được gấp đôi số máy EUV mỗi năm?

Huang: Toàn bộ công suất này đều có thể mở rộng nhanh chóng — chỉ trong hai đến ba năm. Bạn chỉ cần gửi tín hiệu nhu cầu đến chuỗi cung ứng. Nếu có thể sản xuất một cái, thì có thể sản xuất mười cái; nếu có thể sản xuất mười cái, thì có thể sản xuất một triệu cái. Những thứ này không khó để nhân bản.

Patel: Ông sẽ đi sâu đến đâu trong chuỗi cung ứng? Liệu ông sẽ trực tiếp gặp ASML và nói: “Ba năm nữa, NVIDIA đặt mục tiêu doanh thu hai nghìn tỷ USD, vì vậy chúng tôi cần nhiều máy EUV hơn rất nhiều”?

Huang: Một số việc cần nói trực tiếp, một số việc cần nói gián tiếp. Nếu thuyết phục được TSMC, ASML cũng sẽ bị thuyết phục. Chúng ta cần xác định các điểm nghẽn then chốt. Nhưng nếu TSMC đã bị thuyết phục, trong vài năm tới bạn sẽ có đủ máy EUV.

Quan điểm của tôi là không có điểm nghẽn nào kéo dài quá hai đến ba năm. Đồng thời, chúng tôi còn tăng hiệu suất tính toán lên 10–20 lần; từ Hopper đến Blackwell là 30–50 lần. Vì CUDA rất linh hoạt, chúng tôi liên tục phát minh thuật toán mới, công nghệ mới, vừa tăng dung lượng vừa nâng cao hiệu suất. Những điều này không khiến tôi lo lắng. Điều khiến tôi lo lắng là các yếu tố đầu ra — chính sách năng lượng cản trở mở rộng năng lượng; mà không có năng lượng, bạn không thể xây dựng ngành công nghiệp mới, cũng không thể phát triển sản xuất công nghiệp mới.

Chúng ta cần tái công nghiệp hóa nước Mỹ. Chúng ta cần đưa sản xuất chip, sản xuất máy tính và đóng gói về lại Mỹ. Chúng ta cần sản xuất ô tô điện, robot và nhà máy AI. Không có năng lượng, tất cả những điều này đều không thể xây dựng được — trong khi năng lượng cần rất nhiều thời gian để phát triển. Còn công suất chip là vấn đề có thể giải quyết trong hai đến ba năm. Công suất CoWoS cũng vậy.

TPU có phá vỡ sự kiểm soát của NVIDIA đối với sức mạnh tính toán AI?

Patel: Trong ba mô hình xếp hạng cao nhất thế giới, hai mô hình — Claude và Gemini — đều được huấn luyện trên TPU của Google. Điều này có ý nghĩa gì đối với NVIDIA?

Huang: Những gì chúng tôi làm hoàn toàn khác biệt. NVIDIA làm tính toán tăng tốc, không chỉ là một đơn vị xử lý ten-xơ (TPU). Tính toán tăng tốc có thể áp dụng ở rất nhiều nơi: động lực học phân tử, động lực học sắc động lực lượng tử, xử lý dữ liệu, dữ liệu có cấu trúc, dữ liệu phi cấu trúc, cơ học chất lỏng, vật lý hạt… và cả AI.

Tính toán tăng tốc rộng hơn nhiều so với điều này. Dù AI là chủ đề nóng hiện nay và rõ ràng rất quan trọng, ảnh hưởng sâu rộng, nhưng tính toán lại rộng hơn rất nhiều. NVIDIA đã tái định hình cách tính toán — từ tính toán phổ quát chuyển sang tính toán tăng tốc. Thị trường của chúng tôi rộng hơn bất kỳ TPU hay ASIC nào, và chúng tôi là công ty duy nhất có thể tăng tốc mọi ứng dụng. Chúng tôi có hệ sinh thái khổng lồ, mọi framework và thuật toán đều chạy được trên nền tảng NVIDIA.

Bởi vì máy tính của chúng tôi được thiết kế để người khác có thể vận hành, nên bất kỳ nhà vận hành nào cũng có thể mua hệ thống của chúng tôi. Trong khi hầu hết các hệ thống tự xây dựng yêu cầu bạn tự vận hành, vì chúng thiếu tính linh hoạt nên người khác không thể vận hành được. Vì bất kỳ ai cũng có thể xây dựng và vận hành hệ thống của chúng tôi, nên chúng tôi hiện diện trong mọi đám mây — bao gồm cả đám mây của Google, Amazon, Azure và Oracle.

Nếu bạn muốn cho thuê, bạn nên có một nhóm khách hàng khổng lồ từ nhiều ngành làm “người bảo lãnh mua”. Nếu bạn muốn tự dùng, chúng tôi dĩ nhiên cũng có thể giúp bạn vận hành — như cách chúng tôi hỗ trợ Elon Musk tại xAI. Và chúng tôi có thể trang bị năng lực vận hành cho bất kỳ công ty, bất kỳ ngành nào — bạn có thể xây dựng một siêu máy tính dành riêng cho nghiên cứu khoa học và khám phá thuốc cho Lilly, và chúng tôi có thể giúp họ vận hành cho toàn bộ lĩnh vực khám phá dược phẩm và khoa học sinh học.

Có rất nhiều ứng dụng mà TPU không thể làm. CUDA của NVIDIA cũng là một TPU tuyệt vời, nhưng còn có thể xử lý mọi khâu trong xử lý dữ liệu, tính toán, AI… Cơ hội thị trường của chúng tôi lớn hơn nhiều, phạm vi bao phủ rộng hơn nhiều. Bởi vì chúng tôi hỗ trợ mọi ứng dụng trên thế giới, bạn có thể xây dựng hệ thống NVIDIA ở bất cứ đâu và biết chắc sẽ có khách hàng. Đây là một tình thế hoàn toàn khác biệt.

Patel: Doanh thu của quý vị thật đáng kinh ngạc, nhưng không đến từ dược phẩm hay tính toán lượng tử, mà chủ yếu từ AI — một công nghệ chưa từng có, đang tăng trưởng với tốc độ chưa từng thấy. Vậy vấn đề đặt ra là: điều gì thực sự tốt nhất cho chính AI? Về bản chất, TPU là một mảng mạch đập khổng lồ, đặc biệt giỏi thực hiện phép nhân ma trận. GPU thì linh hoạt hơn, phù hợp với các tác vụ có nhiều rẽ nhánh hoặc truy cập bộ nhớ không đều. Nhưng vấn đề là AI thực sự đang làm gì? Nói thẳng ra, AI chỉ là lặp đi lặp lại các phép nhân ma trận rất dễ dự đoán. Nếu vậy, tại sao quý vị còn dành diện tích trên chip cho bộ lập lịch luồng (thread scheduler) hay chuyển đổi giữa luồng và ngân hàng bộ nhớ — những chức năng phổ quát? Diện tích đó hoàn toàn có thể dành hết cho phép nhân ma trận. Trong khi TPU lại được thiết kế chuyên biệt cho phần tính toán đang bùng nổ này. Ông nghĩ sao?

Huang: Phép nhân ma trận là một phần quan trọng của AI, nhưng không phải tất cả. Nếu bạn phát minh một cơ chế chú ý mới, một cách phân rã khác, hoặc một kiến trúc hoàn toàn mới như mô hình không gian trạng thái hỗn hợp (SSM), bạn cần một kiến trúc có thể lập trình phổ quát. Nếu bạn xây dựng mô hình kết hợp khuếch tán (diffusion) và tự hồi quy (autoregressive), bạn cũng cần một kiến trúc có thể lập trình phổ quát. Chúng tôi có thể chạy bất kỳ thứ gì bạn nghĩ ra. Đó chính là lợi thế. Vì nó có thể lập trình, nên việc phát minh thuật toán mới dễ dàng hơn rất nhiều.

Khả năng phát minh thuật toán mới mới là lý do AI tiến bộ nhanh đến vậy. TPU và các giải pháp khác đều chịu ảnh hưởng của Định luật Moore, tiến bộ khoảng 25% mỗi năm. Để đạt bước nhảy 10–100 lần mỗi năm, cách duy nhất là thay đổi căn bản thuật toán và phương pháp tính toán mỗi năm.

Đây chính là lợi thế cốt lõi của NVIDIA. Blackwell hiệu năng cao hơn Hopper 50 lần. Lần đầu tôi nói là 35 lần, không ai tin. Sau đó có người viết bài nói tôi “giữ bí mật” — thực tế là 50 lần. Chỉ dựa vào Định luật Moore là không thể, chúng tôi đạt được điều này nhờ các mô hình mới như Mixture of Experts (MoE), được song song hóa, phân rã và phân bố khắp toàn bộ hệ thống tính toán. Nếu không có CUDA và không có khả năng viết kernel mới một cách sâu sắc, điều này rất khó thực hiện.

Đây là sự kết hợp giữa kiến trúc có thể lập trình và khả năng thiết kế đồng bộ cực cao của NVIDIA. Chúng tôi thậm chí có thể dời một số phép tính sang chính cấu trúc mạng như NVLink, hoặc Spectrum-X trong mạng. Chúng tôi có thể thay đổi đồng thời bộ xử lý, hệ thống, cấu trúc mạng, thư viện và thuật toán. Không có CUDA, tôi thậm chí không biết bắt đầu từ đâu.

Patel: Điều này dẫn đến một câu hỏi thú vị về khách hàng của NVIDIA. 60% doanh thu của quý vị đến từ năm nhà cung cấp đám mây quy mô siêu lớn. Trong một thời đại khác, khách hàng là các giáo sư làm thí nghiệm — họ cần CUDA và không thể dùng bộ tăng tốc nào khác; họ chỉ cần chạy PyTorch trên CUDA và mọi thứ đã được tối ưu. Nhưng các nhà cung cấp đám mây quy mô siêu lớn này có khả năng tự viết kernel. Thực tế, để khai thác 5% hiệu năng cuối cùng từ kiến trúc cụ thể, họ bắt buộc phải làm vậy. Anthropic và Google chủ yếu chạy trên bộ tăng tốc riêng — TPU và Trainium. Ngay cả OpenAI dùng GPU cũng có Triton vì họ cần kernel riêng. Họ không dùng cuBLAS và NCCL, mà có stack phần mềm riêng và có thể biên dịch sang các bộ tăng tốc khác. Nếu phần lớn khách hàng của quý vị có thể và đang xây dựng các giải pháp thay thế CUDA, thì CUDA còn là yếu tố then chốt đến đâu để AI tiên tiến chạy trên nền tảng NVIDIA?

Huang: CUDA là một hệ sinh thái phong phú. Nếu bạn muốn phát triển trên bất kỳ máy tính nào, lựa chọn đầu tiên là CUDA — một quyết định rất sáng suốt. Vì hệ sinh thái quá phong phú, chúng tôi hỗ trợ mọi framework. Nếu bạn muốn viết kernel tùy chỉnh, chúng tôi đóng góp rất lớn cho Triton, và nền tảng Triton có rất nhiều công nghệ của NVIDIA.

Chúng tôi rất sẵn lòng giúp mọi framework trở nên tốt hơn. Có rất nhiều framework như Triton, vLLM, SGLang. Giờ đây lại xuất hiện hàng loạt framework học tăng cường như verl và NeMo RL. Phần hậu huấn luyện và học tăng cường đang bùng nổ. Vì vậy, nếu bạn muốn phát triển trên một kiến trúc cụ thể, chọn CUDA là hợp lý nhất, bởi bạn biết hệ sinh thái của nó rất tốt.

Bạn biết rằng nếu có vấn đề, khả năng cao lỗi nằm ở mã của bạn chứ không phải ở tầng hệ thống底层 khổng lồ bên dưới. Đừng quên quy mô mã bạn đang đối mặt là khổng lồ đến mức nào. Khi hệ thống không hoạt động, bạn phải tự hỏi: “Lỗi là do tôi hay do máy tính?” Bạn đương nhiên hy vọng mỗi lần đều phát hiện lỗi do mình gây ra, vì chỉ như vậy bạn mới luôn tin tưởng vào máy tính. Rõ ràng, chúng tôi vẫn còn rất nhiều lỗi. Nhưng điều then chốt là hệ thống của chúng tôi đã được kiểm chứng vô số lần, bạn có thể yên tâm xây dựng trên nền tảng đó. Đây là điểm đầu tiên tôi muốn nói — sự phong phú, khả năng lập trình và năng lực của hệ sinh thái.

Điểm thứ hai: nếu bạn là một nhà phát triển, điều bạn mong muốn nhất là cơ sở cài đặt (installed base). Bạn muốn phần mềm của mình có thể chạy trên nhiều máy tính khác nhau. Bạn không chỉ viết phần mềm cho riêng mình, mà cho cụm máy của bạn hoặc cụm máy của người khác — vì bạn là nhà phát triển framework. Hệ sinh thái CUDA của NVIDIA cuối cùng chính là tài sản lớn nhất của công ty.

Hiện nay, chúng tôi có hàng trăm triệu GPU đang được sử dụng ngoài thị trường, trong mọi đám mây. Từ A10, A100, H100, H200 đến các dòng L, P và nhiều kích thước, hình dáng khác nhau. Nếu bạn là công ty robot, bạn muốn stack CUDA chạy trực tiếp bên trong robot. Chúng tôi gần như hiện diện ở mọi nơi. Cơ sở cài đặt khổng lồ này nghĩa là một khi bạn phát triển phần mềm hoặc mô hình, nó có thể chạy ở bất cứ đâu. Giá trị này là vô giá.

Cuối cùng, chúng tôi hiện diện trong mọi đám mây — điều này khiến chúng tôi thực sự độc nhất vô nhị. Nếu bạn là công ty AI hoặc nhà phát triển, bạn chưa chắc chắn sẽ hợp tác với nhà cung cấp đám mây nào, cũng chưa biết muốn chạy tải ở đâu. Không sao cả — chúng tôi hiện diện ở khắp mọi nơi, kể cả trong phòng máy của bạn. Sự phong phú của hệ sinh thái, độ rộng của cơ sở cài đặt, sự đa dạng về vị trí hiện diện — tất cả những yếu tố này cộng lại khiến CUDA trở nên vô giá.

Patel: Đúng vậy. Nhưng tôi muốn hỏi: những lợi thế này quan trọng đến đâu đối với khách hàng lớn nhất của quý vị? Với nhiều người, CUDA có thể rất giá trị. Nhưng phần lớn doanh thu của quý vị thực tế đến từ những khách hàng lớn có khả năng tự xây dựng stack phần mềm. Đặc biệt, nếu tương lai AI bước vào các lĩnh vực có thể được xác minh nghiêm ngặt bằng học tăng cường, vấn đề sẽ trở thành: ai có thể viết kernel nhân ma trận và kernel chú ý chạy nhanh nhất trên cụm máy lớn? Đây là một bài toán tối ưu hóa rất dễ kiểm chứng.

Các nhà cung cấp đám mây quy mô siêu lớn hoàn toàn có khả năng tự viết những kernel tùy chỉnh này. Tất nhiên, hiệu quả chi phí của NVIDIA có thể vẫn tốt hơn, nên họ có thể vẫn chọn NVIDIA. Nhưng khi đó, vấn đề lại trở thành: cuối cùng chỉ còn so ai có thông số phần cứng tốt hơn, và ai cung cấp nhiều sức mạnh tính toán và băng thông hơn trên mỗi đô la?

Trong lịch sử, NVIDIA dựa vào “hào thành” CUDA để duy trì lợi nhuận trên 70% cả về phần cứng và phần mềm AI. Nhưng hiện nay, vấn đề đặt ra là: nếu khách hàng lớn nhất của quý vị thực sự có khả năng vượt qua “hào thành” này, quý vị còn có thể duy trì mức lợi nhuận cao như vậy không?

Huang: Số lượng kỹ sư chúng tôi phân bổ cho các phòng thí nghiệm AI này là đáng kinh ngạc — chúng tôi làm việc cùng họ để tối ưu hóa stack phần mềm của họ. Lý do là không ai hiểu kiến trúc của chúng tôi sâu sắc bằng chính chúng tôi. Những kiến trúc này không phổ quát như CPU. CPU giống như xe Cadillac — dễ lái và không cần chạy nhanh, ai cũng có thể lái khá tốt với hệ thống kiểm soát hành trình, mọi thứ đều rất đơn giản. Còn GPU và bộ tăng tốc của NVIDIA giống như xe F1. Tôi có thể tưởng tượng ai cũng có thể lái được 160 km/h, nhưng để đẩy đến giới hạn thì cần rất nhiều chuyên môn. Chúng tôi dùng lượng lớn AI để viết kernel.

Tôi hoàn toàn tin rằng trong một thời gian dài, chúng tôi vẫn sẽ được cần đến. Chuyên môn của chúng tôi thường giúp các đối tác phòng thí nghiệm AI dễ dàng tăng thêm 2 lần hiệu năng. Sau khi tối ưu một kernel hoặc toàn bộ stack phần mềm, tốc độ mô hình tăng 50%, 2 lần hoặc 3 lần — điều này rất phổ biến. Xét quy mô cụm Hopper và Blackwell mà họ sở hữu, đây là một con số khổng lồ. Tăng gấp đôi hiệu năng trực tiếp tương đương tăng gấp đôi doanh thu.

Stack tính toán của NVIDIA có chi phí sở hữu tổng thể (TCO) tốt nhất thế giới — không ai sánh kịp. Không có nền tảng nào có thể cho tôi thấy hiệu năng trên TCO tốt hơn chúng tôi. Bài kiểm tra chuẩn InferenceMAX của Dylan đang sẵn sàng, bất kỳ ai cũng có thể sử dụng. Nhưng TPU không tham gia kiểm tra, Trainium cũng không. Tôi rất khuyến khích họ dùng InferenceMAX để chứng minh “chi phí suy luận siêu thấp” mà họ tuyên bố. Nhưng điều này rất khó vì không ai muốn tham gia.

Còn có MLPerf, tôi cũng rất muốn Trainium chứng minh ưu thế 40% mà họ luôn tuyên bố. Tôi cũng rất muốn nghe họ trình bày ưu thế chi phí của TPU. Nhưng theo quan điểm của tôi, xuất phát từ nguyên lý đầu tiên, những ưu thế họ tuyên bố hoàn toàn không hợp lý. Vì vậy, tôi cho rằng lý do chúng tôi thành công rất đơn giản: TCO của chúng tôi quá tốt.

Thứ hai, ông nói 60% khách hàng của chúng tôi là năm nhà cung cấp đám mây hàng đầu, nhưng phần lớn nghiệp vụ này là hướng tới bên ngoài. Ví dụ, phần lớn chip NVIDIA được sử dụng trên AWS là dành cho khách hàng bên ngoài chứ không phải dùng nội bộ. Khách hàng trên Azure rõ ràng cũng là bên ngoài, tương tự với Oracle. Họ ưa chuộng chúng tôi vì ảnh hưởng lớn của chúng tôi — chúng tôi có thể mang đến cho họ những khách hàng xuất sắc nhất thế giới, và những khách hàng này đều xây dựng trên nền tảng NVIDIA. Còn những công ty này chọn NVIDIA vì ảnh hưởng và tính đa năng quá mạnh của chúng tôi.

Vì vậy, tôi cho rằng vòng xoáy này gồm: cơ sở cài đặt, khả năng lập trình của kiến trúc, sự phong phú của hệ sinh thái — cộng với hàng ngàn công ty AI trên toàn thế giới. Nếu bạn là startup AI, bạn sẽ chọn kiến trúc nào? Bạn sẽ chọn kiến trúc phong phú nhất — và chúng tôi là phong phú nhất; bạn sẽ chọn kiến trúc có cơ sở cài đặt lớn nhất — và chúng tôi là lớn nhất; bạn sẽ chọn hệ sinh thái hoàn chỉnh nhất. Đó chính là vòng xoáy.

Kết hợp tất cả những điểm trên, hiệu năng trên mỗi đô la của chúng tôi là tốt nhất thế giới và chi phí token của khách hàng là thấp nhất. Hiệu năng trên mỗi watt của chúng tôi là cao nhất thế giới, vì vậy nếu một đối tác xây dựng trung tâm dữ liệu 1 gigawatt, trung tâm này nên tạo ra lượng doanh thu và token lớn nhất có thể — điều này trực tiếp tương đương doanh thu. Bạn muốn nó tạo ra càng nhiều token càng tốt để tối đa hóa doanh thu, và chúng tôi là kiến trúc có số lượng token trên mỗi watt cao nhất thế giới. Ngoài ra, nếu mục tiêu của bạn là cho thuê hạ tầng, chúng tôi có số lượng khách hàng nhiều nhất thế giới. Đó là lý do vòng xoáy vận hành.

Patel: Thú vị đấy. Tôi nghĩ vấn đề cuối cùng là cấu trúc thị trường thực tế rốt cuộc như thế nào? Vì ngay cả khi có các công ty khác tồn tại, có thể có một thế giới trong đó hàng ngàn công ty AI mỗi nhà chiếm phần sức mạnh tính toán gần như bằng nhau. Nhưng thực tế là ngay cả thông qua năm nhà cung cấp đám mây này, những người thực sự sử dụng sức mạnh tính toán trên Amazon chủ yếu là Anthropic, OpenAI và các phòng thí nghiệm nền tảng lớn khác. Những “đại gia” này tự có khả năng và nguồn lực để vận hành các bộ tăng tốc khác nhau.

Nếu những điều ông nói về hiệu quả chi phí, hiệu năng trên mỗi watt… đều đúng, thì tại sao công ty như Anthropic vài ngày trước lại vừa công bố thỏa thuận với Broadcom và Google liên quan đến hàng gigawatt TPU, và đặt phần lớn sức mạnh tính toán của họ lên đó? Đối với Google, TPU cũng chiếm phần lớn sức mạnh tính toán của họ. Vì vậy, nếu tôi nhìn vào các công ty AI lớn, dường như sức mạnh tính toán của họ từng hoàn toàn là NVIDIA, nhưng giờ đây không còn như vậy. Tôi rất tò mò: nếu những lợi thế trên giấy tờ đều đúng, tại sao họ lại chọn bộ tăng tốc khác?

Huang: Anthropic chỉ là một ngoại lệ, không phải xu hướng lớn. Bạn hãy thử suy nghĩ: nếu không có Anthropic, TPU sẽ tăng trưởng từ đâu? 100% là nhờ Anthropic. Tương tự, nếu không có Anthropic, Trainium sẽ tăng trưởng từ đâu? Cũng 100% nhờ Anthropic. Đây cơ bản là một “bí mật công khai”. Không phải cơ hội cho ASIC đang nở rộ, mà chỉ là một mình Anthropic mà thôi.

Patel: Nhưng OpenAI có thỏa thuận với AMD và họ tự sản xuất bộ tăng tốc Titan.

Huang: Đúng vậy, nhưng tôi nghĩ ai cũng thừa nhận phần lớn sức mạnh tính toán của họ vẫn chạy trên NVIDIA. Chúng tôi vẫn sẽ cùng làm rất nhiều việc. Tôi không ngại người khác dùng thứ khác, thử nghiệm thứ khác. Nếu họ không thử, làm sao biết của chúng tôi tốt đến đâu? Đôi khi họ cần được nhắc nhở. Chúng tôi phải liên tục giành lại vị trí hiện tại.

Luôn có người khoác lác. Bạn hãy xem bao nhiêu dự án ASIC đã bị hủy bỏ. Chỉ vì bạn muốn làm một ASIC, bạn còn phải làm ra thứ tốt hơn NVIDIA — điều này không dễ chút nào. Thực tế, điều này là phi lý trừ khi NVIDIA chắc chắn có khuyết điểm nào đó. Nhưng quy mô và tốc độ của chúng tôi đã rõ ràng — chúng tôi là công ty duy nhất trên thế giới mỗi năm đều ra mắt sản phẩm mới và mỗi năm đều đạt bước nhảy khổng lồ.

Patel: Tôi đoán logic của họ là không cần tốt hơn NVIDIA, chỉ cần không tệ hơn 70% là được, vì họ trả cho quý vị 70% lợi nhuận.

Huang: Không, đừng quên lợi nhuận của ASIC cũng rất cao. Giả sử lợi nhuận NVIDIA là 70%, còn lợi nhuận ASIC là 65%. Vậy bạn thực sự tiết kiệm được gì?

Patel: Ông nói như Broadcom à?

Huang: Đúng vậy. Bạn phải trả tiền cho người khác. Theo tôi biết, lợi nhuận ASIC rất cao, họ cũng tự hào về điều đó và coi đó là “lợi nhuận ASIC đáng kinh ngạc”.

Vì vậy, bạn hỏi tại sao? Từ rất lâu rồi, chúng tôi đơn giản là không có khả năng làm. Lúc đó, tôi chưa nhận thức sâu sắc việc xây dựng một phòng thí nghiệm AI nền tảng như OpenAI hay Anthropic khó đến mức nào, và họ cần nhà cung cấp đầu tư số tiền khổng lồ. Chúng tôi lúc đó không có khả năng đầu tư hàng tỷ USD vào Anthropic để đổi lấy việc họ dùng sức mạnh tính toán của chúng tôi. Nhưng Google và AWS có khả năng. Họ đầu tư khổng lồ ngay từ đầu và đổi lại, Anthropic dùng sức mạnh tính toán của họ. Còn chúng tôi thì không có khả năng.

Sai lầm của tôi là chưa nhận thức sâu sắc rằng họ thực sự không còn lựa chọn nào khác — không có quỹ đầu tư mạo hiểm nào sẵn sàng đầu tư 5–10 tỷ USD vào một phòng thí nghiệm AI với kỳ vọng biến nó thành Anthropic. Đó là sai lầm của tôi. Nhưng ngay cả khi tôi hiểu điều đó lúc đó, tôi cũng không tin rằng chúng tôi có khả năng làm như vậy. Nhưng tôi sẽ không lặp lại sai lầm đó nữa.

Tôi rất sẵn lòng đầu tư vào OpenAI và rất sẵn lòng giúp họ mở rộng — tôi tin điều này là cần thiết. Sau đó, khi tôi có khả năng, Anthropic tìm đến chúng tôi, tôi rất sẵn lòng trở thành nhà đầu tư và rất sẵn lòng giúp họ mở rộng. Nhưng lúc đó chúng tôi thực sự không làm được. Nếu tôi có thể quay lại quá khứ, nếu NVIDIA lúc đó đã lớn như hiện nay, tôi sẽ rất sẵn lòng làm điều đó.

Tại sao NVIDIA không trở thành nhà cung cấp đám mây quy mô siêu lớn?

Patel: Trong nhiều năm, NVIDIA luôn là công ty kiếm tiền — và kiếm rất nhiều tiền — trong lĩnh vực AI. Hiện nay, quý vị đang đầu tư, ví dụ như báo cáo cho biết quý vị đã đầu tư 30 tỷ USD vào OpenAI và 10 tỷ USD vào Anthropic. Hiện nay, định giá của họ tăng vọt và tôi tin rằng sẽ còn tiếp tục tăng. Vì vậy, nếu trong nhiều năm qua quý vị luôn cung cấp sức mạnh tính toán cho họ và nhìn thấy hướng phát triển của họ, trong khi giá trị của họ cách đây một hoặc hai năm chỉ bằng một phần mười hiện nay — thậm chí cách đây một năm — và quý vị lại có quá nhiều tiền mặt, thì quý vị nên hoặc tự trở thành phòng thí nghiệm nền tảng và đầu tư khổng lồ, hoặc thực hiện các giao dịch này sớm hơn ở mức định giá hiện tại. Quý vị có tiền mặt. Vậy tại sao không làm sớm hơn?

Huang: Chúng tôi đã làm nhanh nhất có thể khi có khả năng, và làm ngay khi có khả năng. Nếu tôi có thể, tôi sẽ làm sớm hơn. Khi Anthropic cần chúng tôi, chúng tôi đơn giản là không có khả năng — lúc đó điều này không nằm trong tầm cân nhắc của chúng tôi.

Patel: Sao lại như vậy? Là vấn đề tiền à?

Huang: Đúng vậy — vấn đề quy mô đầu tư. Chúng tôi chưa từng thực hiện đầu tư bên ngoài công ty, huống chi là số tiền lớn như vậy. Chúng tôi chưa nhận thức được việc này là cần thiết. Tôi luôn nghĩ họ có thể đi gọi vốn từ các quỹ đầu tư mạo hiểm như mọi công ty khác. Nhưng điều họ muốn làm thì các quỹ đầu tư mạo hiểm không thể làm được. Điều OpenAI muốn làm thì các quỹ đầu tư mạo hiểm cũng không thể làm được. Bây giờ tôi đã nhận ra, nhưng lúc đó tôi chưa biết.

Nhưng đây chính là thiên tài của họ — họ thông minh ở chỗ này. Họ đã nhận ra ngay từ đầu rằng phải làm như vậy. Tôi rất vui vì họ đã làm được. Ngay cả khi điều này khiến Anthropic tìm đến người khác, tôi vẫn rất vui vì điều đó xảy ra. Sự tồn tại của Anthropic là điều tốt cho thế giới, và tôi rất vui vì điều đó.

Patel: Tôi nghĩ quý vị vẫn đang kiếm rất nhiều tiền và mỗi quý còn kiếm nhiều hơn. Vì quý vị có quá nhiều tiền mặt liên tục được tạo ra, NVIDIA nên dùng nó vào việc gì? Một câu trả lời là đã xuất hiện cả một hệ sinh thái trung gian, biến chi phí đầu tư thành chi phí vận hành cho các phòng thí nghiệm này, để họ có thể thuê sức mạnh tính toán. Vì chip rất đắt, nhưng trong vòng đời của chúng có thể kiếm được rất nhiều tiền, bởi mô hình AI ngày càng tốt hơn. Giá trị token do chúng tạo ra đang tăng lên, nhưng chi phí triển khai lại cao. NVIDIA có tiền để chi cho chi phí đầu tư. Thực tế, báo cáo cho biết quý vị đang hỗ trợ CoreWeave với số tiền lên tới 6,3 tỷ USD và đã đầu tư 2 tỷ USD. Tại sao NVIDIA không tự trở thành nhà cung cấp đám mây? Tại sao không tự trở thành nhà cung cấp đám mây quy mô siêu lớn và tự cho thuê sức mạnh tính toán?

Huang: Đây là triết lý của công ty chúng tôi và tôi cho rằng đây là một triết lý sáng suốt. Chúng tôi nên làm những việc bắt buộc và hạn chế tối đa số lượng việc làm. Nghĩa là trong công việc xây dựng nền tảng tính toán, nếu chúng tôi không làm, tôi thực sự tin rằng sẽ không ai làm. Nếu chúng tôi không mạo hiểm như chúng tôi đã mạo hiểm, nếu chúng tôi không xây dựng NVLink theo cách của mình, không xây dựng toàn bộ stack phần mềm theo cách của mình, không tạo dựng hệ sinh thái theo cách của mình và không đầu tư 20 năm vào CUDA — trong phần lớn thời gian còn chịu lỗ — thì nếu chúng tôi không làm, sẽ không ai làm.

Nếu chúng tôi không tạo ra tất cả các thư viện CUDA-X để phục vụ các lĩnh vực chuyên biệt, thì 15 năm trước chúng tôi đã bắt đầu làm các thư viện chuyên biệt, bởi vì chúng tôi nhận ra rằng nếu không tạo ra những thư viện này — dù là cho theo dõi tia, tạo hình ảnh hay công việc AI sơ kỳ, các mô hình này, hoặc xử lý dữ liệu, xử lý dữ liệu có cấu trúc, xử lý dữ liệu vector — thì sẽ không ai làm. Tôi hoàn toàn tin vào điều này. Chúng tôi đã tạo một thư viện cho quang khắc tính toán tên là cuLitho, nếu chúng tôi không làm, sẽ không ai làm. Vì vậy, tiến bộ của tính toán tăng tốc ngày nay là nhờ những việc chúng tôi đã làm.

Vì vậy, chúng tôi nên làm việc đó và nên tập trung toàn lực để làm. Tuy nhiên, trên thế giới có rất nhiều đám mây, nếu tôi không làm thì sẽ có người khác làm. Vì vậy, chúng tôi tuân theo triết lý “làm những việc bắt buộc và hạn chế tối đa số lượng việc làm”, và triết lý này tồn tại trong mỗi ngày của công ty. Mỗi việc tôi làm đều được nhìn dưới góc nhìn này.

Về đám mây, nếu chúng tôi không hỗ trợ sự tồn tại của CoreWeave, những đám mây mới, những đám mây AI này sẽ không tồn tại. Nếu chúng tôi không giúp CoreWeave, họ sẽ không tồn tại. Nếu chúng tôi không hỗ trợ Nscale, họ sẽ không đạt được thành tựu như ngày nay. Nếu không hỗ trợ Nebius, họ cũng sẽ không trở thành như hiện nay. Hiện nay, họ đang làm rất tốt.

Đây là một mô hình kinh doanh. Chúng tôi nên làm những việc bắt buộc và hạn chế tối đa số lượng việc làm. Vì vậy, chúng tôi đầu tư vào hệ sinh thái của mình vì tôi muốn hệ sinh thái của mình phát triển mạnh mẽ. Tôi muốn kiến trúc này, AI, kết nối càng nhiều ngành, càng nhiều quốc gia càng tốt, để toàn hành tinh được xây dựng trên nền tảng AI và trên nền tảng công nghệ Mỹ. Đây chính là tầm nhìn mà chúng tôi đang theo đuổi.

Còn một điều nữa: có rất nhiều công ty mô hình nền tảng xuất sắc và chúng tôi cố gắng đầu tư vào tất cả. Đây là việc khác mà chúng tôi làm. Chúng tôi không chọn “người chiến thắng”, và chúng tôi cần hỗ trợ tất cả. Đây là điều chúng tôi nên làm và cũng là niềm vui của chúng tôi. Điều này rất quan trọng đối với hoạt động kinh doanh của chúng tôi. Nhưng chúng tôi cũng không tiếc công tránh việc chọn “người chiến thắng”, vì vậy tôi đầu tư vào một công ty thì tôi sẽ đầu tư vào tất cả.

Patel: Tại sao ông cố ý không chọn “người chiến thắng”?

Huang: Thứ nhất, đó không phải việc của chúng tôi. Thứ hai, khi NVIDIA mới khởi nghiệp, có 60 công ty đồ họa 3D, và chúng tôi là công ty duy nhất sống sót. Nếu bạn đoán từ 60 công ty này ai sẽ thành công, NVIDIA sẽ đứng đầu danh sách “ít khả năng thành công nhất”.

Đó là chuyện rất lâu rồi. Kiến trúc đồ họa của NVIDIA hoàn toàn sai — không chỉ sai một chút. Chúng tôi tạo ra một kiến trúc hoàn toàn sai, các nhà phát triển không thể hỗ trợ nó và nó sẽ không bao giờ thành công. Chúng tôi dựa trên suy luận nguyên lý đầu tiên tốt, nhưng cuối cùng lại đưa ra giải pháp sai. Mọi người đều loại chúng tôi ra, nhưng chúng tôi vẫn sống sót.

Vì vậy, tôi đủ khiêm tốn để nhận ra điều này: đừng chọn “người chiến thắng”. Hoặc để họ tự lo cho mình, hoặc chăm sóc tất cả.

Patel: Có một điểm tôi chưa hiểu: ông nói chúng tôi không ưu tiên hỗ trợ họ chỉ vì họ là “đám mây mới”, nhưng ông cũng liệt kê một loạt “đám mây mới” và nói rằng nếu không có NVIDIA, họ sẽ không tồn tại. Hai điều này làm sao dung hòa được?

Huang: Trước hết, họ phải tự muốn tồn tại và đến xin chúng tôi giúp đỡ. Khi họ muốn tồn tại, có kế hoạch kinh doanh, chuyên môn và nhiệt huyết, rõ ràng họ cảm thấy mình có một số năng lực. Nhưng nếu cuối cùng họ cần một số đầu tư để khởi động, chúng tôi sẽ hỗ trợ họ. Tuy nhiên, họ khởi động vòng xoáy càng sớm càng tốt.

Câu hỏi của ông là: chúng tôi có muốn làm kinh doanh tài chính không? Câu trả lời là không. Có người đang làm kinh doanh tài chính, chúng tôi thà hợp tác với họ còn hơn tự làm nhà tài trợ. Mục tiêu của chúng tôi là tập trung vào việc mình làm và giữ mô hình kinh doanh càng đơn giản càng tốt, đồng thời hỗ trợ hệ sinh thái của mình.

Khi một tổ chức như OpenAI cần đầu tư quy mô 30 tỷ USD vì họ chưa IPO, và chúng tôi tin chắc họ sẽ trở thành một công ty tuyệt vời, thế giới cần họ tồn tại và thế giới muốn họ tồn tại, tôi hy vọng họ tồn tại và họ thuận buồm xuôi gió — hãy để chúng tôi hỗ trợ họ và giúp họ mở rộng. Chúng tôi sẽ thực hiện những khoản đầu tư này vì họ cần chúng tôi. Nhưng chúng tôi không muốn làm càng nhiều việc càng tốt, mà muốn làm càng ít việc càng tốt.

Patel: Đây có thể là một câu hỏi hiển nhiên, nhưng chúng ta đã trải qua nhiều năm thiếu hụt GPU, và hiện nay tình trạng thiếu hụt còn trầm trọng hơn do mô hình ngày càng tốt hơn.

Huang: Chúng tôi thực sự thiếu GPU.

Patel: Đúng vậy. NVIDIA nổi tiếng với việc phân bổ hạn ngạch khan hiếm — không chỉ dựa trên người trả giá cao nhất, mà còn xem xét việc đảm bảo sự tồn tại của các “đám mây mới”, ví dụ như phân một phần cho CoreWeave, một phần cho Crusoe, một phần cho Lambda. Điều này mang lại lợi ích gì cho NVIDIA? Trước tiên, ông có đồng ý với mô tả “phân chia thị trường” này không?

Huang: Tôi không đồng ý. Tiền đề của ông hoàn toàn sai. Chúng tôi thận trọng và rất thận trọng với những việc này. Thứ nhất, nếu bạn không đặt đơn hàng, chỉ nói suông là vô ích. Trước khi nhận được đơn hàng, chúng tôi có thể làm gì? Vì vậy, việc đầu tiên là chúng tôi cùng mọi người nỗ lực hoàn thành dự báo, bởi vì những thứ này cần rất nhiều thời gian để sản xuất và trung tâm dữ liệu cũng cần rất nhiều thời gian. Chúng tôi phối hợp cung – cầu thông qua dự báo và các phương pháp khác — đây là nhiệm vụ hàng đầu.

Thứ hai, chúng tôi cố gắng dự báo với càng nhiều người càng tốt, nhưng cuối cùng bạn vẫn phải đặt hàng. Có thể vì bất kỳ lý do nào bạn không đặt hàng — tôi có thể làm gì? Đến một thời điểm nào đó, nguyên tắc “đến trước được phục vụ trước” sẽ được áp dụng. Ngoài ra, nếu trung tâm dữ liệu của bạn chưa sẵn sàng, hoặc một số thành phần chưa sẵn sàng để bạn kích hoạt trung tâm dữ liệu, chúng tôi có thể phục vụ khách hàng khác trước. Điều này chỉ nhằm tối đa hóa thông lượng nhà máy của chúng tôi và chúng tôi có thể điều chỉnh một chút.

Ngoài ra, thứ tự ưu tiên là “đến trước được phục vụ trước”. Bạn phải đặt đơn hàng. Tất nhiên, có một số câu chuyện. Ví dụ, mọi việc bắt đầu từ một bài báo về việc Larry Page và Elon Musk ăn tối với tôi để xin GPU — điều này chưa từng xảy ra. Chúng tôi thực sự đã ăn tối và rất vui vẻ, nhưng họ chưa bao giờ xin GPU. Họ chỉ cần đặt hàng. Một khi đặt hàng, chúng tôi sẽ cố gắng phân bổ công suất cho họ — điều này không phức tạp.

Patel: Được rồi. Vậy nghe có vẻ như có một hàng đợi, và việc bạn nhận được hàng phụ thuộc vào trung tâm dữ liệu đã sẵn sàng chưa, và thời điểm bạn đặt đơn hàng. Nhưng nghe có vẻ vẫn không phải “người trả giá cao nhất được phục vụ trước”. Có lý do nào để không làm như vậy không?

Huang: Chúng tôi chưa bao giờ làm như vậy.

Patel: Tại sao không làm như vậy?

Huang: Vì đó là thực hành kinh doanh xấu. Bạn đặt giá và mọi người quyết định mua hay không. Tôi hiểu các công ty khác trong ngành chip có thể tăng giá khi nhu cầu cao, nhưng chúng tôi không làm như vậy. Đây chưa bao giờ là cách làm của chúng tôi. Bạn có thể tin tưởng chúng tôi. Tôi thà làm một người đáng tin cậy và trở thành trụ cột của ngành. Bạn không cần phải đoán sau này. Nếu tôi báo một giá, đó chính là giá đó — không đổi. Nếu nhu cầu tăng vọt, giá vẫn ổn định.

Patel: Mặt khác, đây cũng là lý do tại sao quý vị có quan hệ tốt với TSMC phải không?

Huang: Đúng vậy, NVIDIA đã kinh doanh với họ gần 30 năm. NVIDIA và TSMC không ký hợp đồng pháp lý, nhưng luôn có một sự công bằng sơ bộ. Đôi khi tôi đúng, đôi khi tôi sai. Đôi khi tôi nhận được thương vụ tốt, đôi khi nhận được thương vụ kém. Nhưng nhìn chung, mối quan hệ này rất tốt. Tôi có thể hoàn toàn tin tưởng họ và hoàn toàn dựa vào họ.

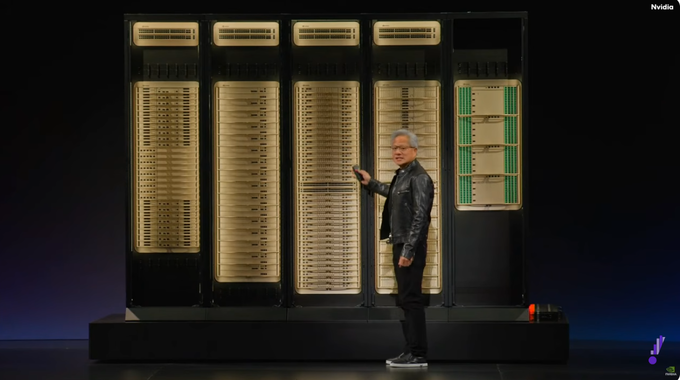

Một điều bạn có thể tin tưởng ở NVIDIA là Vera Rubin năm nay sẽ tuyệt vời. Năm sau, Vera Rubin Ultra sẽ ra mắt. Năm sau nữa, Feynman sẽ ra mắt. Năm sau nữa, tôi chưa giới thiệu tên. Mỗi năm bạn đều có thể tin tưởng chúng tôi. Bạn hãy tìm bất kỳ đội ASIC nào khác trên thế giới, chọn bất kỳ đội nào, và hỏi: “Tôi có thể đặt toàn bộ hoạt động kinh doanh của mình vào tay bạn và bạn sẽ phục vụ tôi mỗi năm không?” Bạn có thể nói: “Chi phí token của bạn sẽ giảm một bậc mỗi năm, và tôi có thể tin tưởng bạn như tin tưởng đồng hồ không?”

Tôi vừa nói điều tương tự với TSMC. Với bất kỳ nhà máy gia công nào trong lịch sử, bạn đều không thể nói như vậy. Nhưng ngày nay, bạn có thể nói như vậy với NVIDIA. Bạn có thể tin tưởng chúng tôi mỗi năm. Nếu bạn muốn mua nhà máy AI trị giá 1 tỷ USD, không vấn đề. Muốn mua 100 triệu USD, không vấn đề. 10 triệu USD, hoặc chỉ một tủ máy, cũng không vấn đề. Hoặc chỉ một card đồ họa, cũng không vấn đề. Nếu bạn muốn đặt hàng 100 tỷ USD, cũng không vấn đề. Chúng tôi là công ty duy nhất trên thế giới mà bạn có thể nói như vậy ngày nay.

Tôi cũng có thể nói như vậy với TSMC. Tôi muốn mua một cái hoặc mua một tỷ cái, đều không vấn đề. Chúng ta chỉ cần trải qua quy trình lập kế hoạch và tất cả những

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News