Trong trò lừa đảo “mổ lợn” này, AI vừa phụ trách việc hẹn hò, vừa phụ trách làm giả giấy phép hành nghề luật sư.

Tuyển chọn TechFlowTuyển chọn TechFlow

Trong trò lừa đảo “mổ lợn” này, AI vừa phụ trách việc hẹn hò, vừa phụ trách làm giả giấy phép hành nghề luật sư.

Một tài khoản ChatGPT có thể thực hiện phần lớn công việc trong các khu vực lừa đảo.

Tác giả: Khổ Lý, TechFlow

Gần đây OpenAI đã công bố một báo cáo, trong đó nêu rõ việc một số đối tượng lợi dụng ChatGPT để thực hiện các hành vi phạm pháp và đã bị OpenAI phát hiện.

Báo cáo khá dài, liệt kê hàng loạt vụ lạm dụng trí tuệ nhân tạo (AI). Có người Nga dùng AI để phát tán tuyên truyền sai lệch; có nghi can gián điệp sử dụng kỹ thuật kỹ sư xã hội (social engineering); tuy nhiên hôm nay tôi muốn tập trung phân tích một vụ cụ thể:

Vụ “lừa đảo kiểu giết lợn” tại Campuchia.

“Lừa đảo kiểu giết lợn” vốn không mới—các câu chuyện về các khu công nghiệp lừa đảo ở Campuchia đã quá quen thuộc. Điều khiến vụ việc này trở nên đặc biệt chính là vai trò của AI.

Trong băng nhóm lừa đảo này, ChatGPT đảm nhiệm nhiều vai trò: tán tỉnh nạn nhân, dịch chỉ thị từ quản lý, viết báo cáo công việc hằng ngày và thậm chí định giá từng nạn nhân.

Trong giới lừa đảo, thuật ngữ nội bộ dùng để chỉ khoản tiền dự kiến “khai thác” được từ bạn là kill value (giá trị “giết lợn”).

Trên toàn bộ dây chuyền hoạt động, ChatGPT có lẽ là “nhân viên bận rộn nhất”.

OpenAI đặt tên mã cho vụ việc này là Operation Date Bait (Chiến dịch Mồi Nhử Hẹn Hò).

Quy trình như sau.

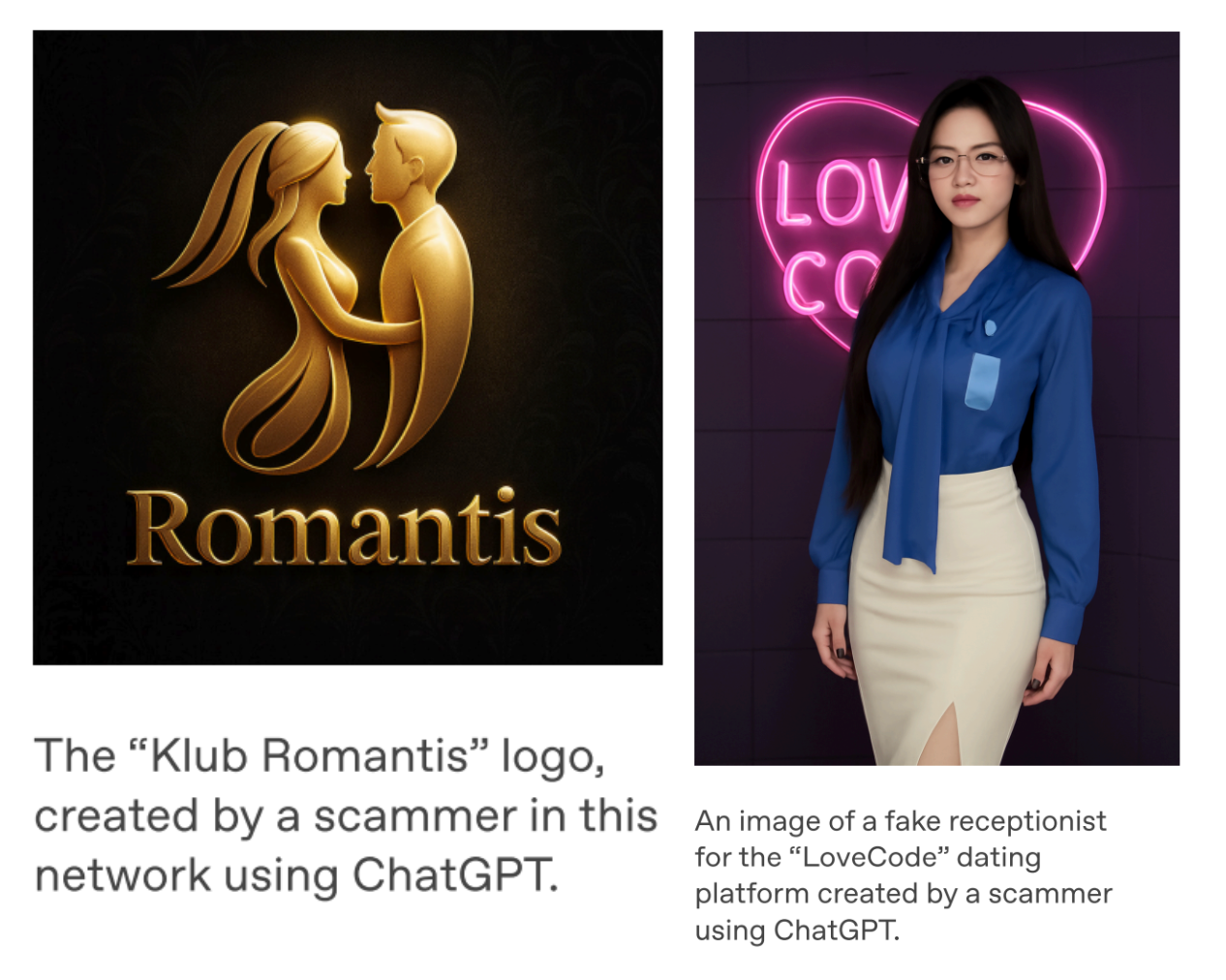

Đầu tiên, băng nhóm lừa đảo dựng lên một dịch vụ hẹn hò cao cấp giả mạo mang tên Klub Romantis, logo cũng được thiết kế bằng ChatGPT. Sau đó họ chạy quảng cáo trả phí trên mạng xã hội với các từ khóa như “gôn”, “du thuyền”, “nhà hàng sang trọng”, nhắm thẳng vào nam giới trẻ Indonesia.

Khi bạn nhấn vào quảng cáo, bạn sẽ bắt đầu trò chuyện với một chatbot AI. Chatbot đóng vai lễ tân quyến rũ, yêu cầu bạn chọn loại phụ nữ mình thích; sau khi bạn lựa chọn xong, nó sẽ gửi cho bạn một liên kết Telegram kèm mã mời riêng.

Sau khi bạn vào Telegram, người thật sẽ tiếp nhận vai trò.

Nhân viên tiếp đón tiếp tục dùng ChatGPT soạn những tin nhắn gợi cảm, dần dần đẩy mức độ thân mật lên cao hơn, rồi dẫn dắt bạn đến hai nền tảng hẹn hò giả mạo: một tên là LoveCode, một tên là SexAction.

Các nền tảng này chứa đầy hồ sơ giả của phụ nữ, đồng thời hiển thị thanh thông báo cuộn liên tục như: “Chúc mừng [tên người nào đó] hoàn thành nhiệm vụ, mở khóa phần thưởng”. Toàn bộ nội dung này đều là bịa đặt—người thường xuyên lướt mạng như bạn có thể dễ dàng nhận ra ngay, nhưng không phải tất cả nạn nhân tiềm năng đều đủ cảnh giác.

Khi cuộc trò chuyện đạt đến mức “đủ sâu”, nhân viên tiếp đón sẽ chuyển bạn cho một “cố vấn”. Cố vấn bắt đầu yêu cầu bạn thực hiện các “nhiệm vụ”, mỗi nhiệm vụ đều yêu cầu nạp tiền, và số tiền tăng dần theo từng bước: mua thẻ VIP, bỏ phiếu cho “người phụ nữ bạn thích”, đặt cọc khách sạn… Danh mục các khoản phí rất đa dạng.

Bước cuối cùng trong quy trình nội bộ gọi là kill (“giết lợn”).

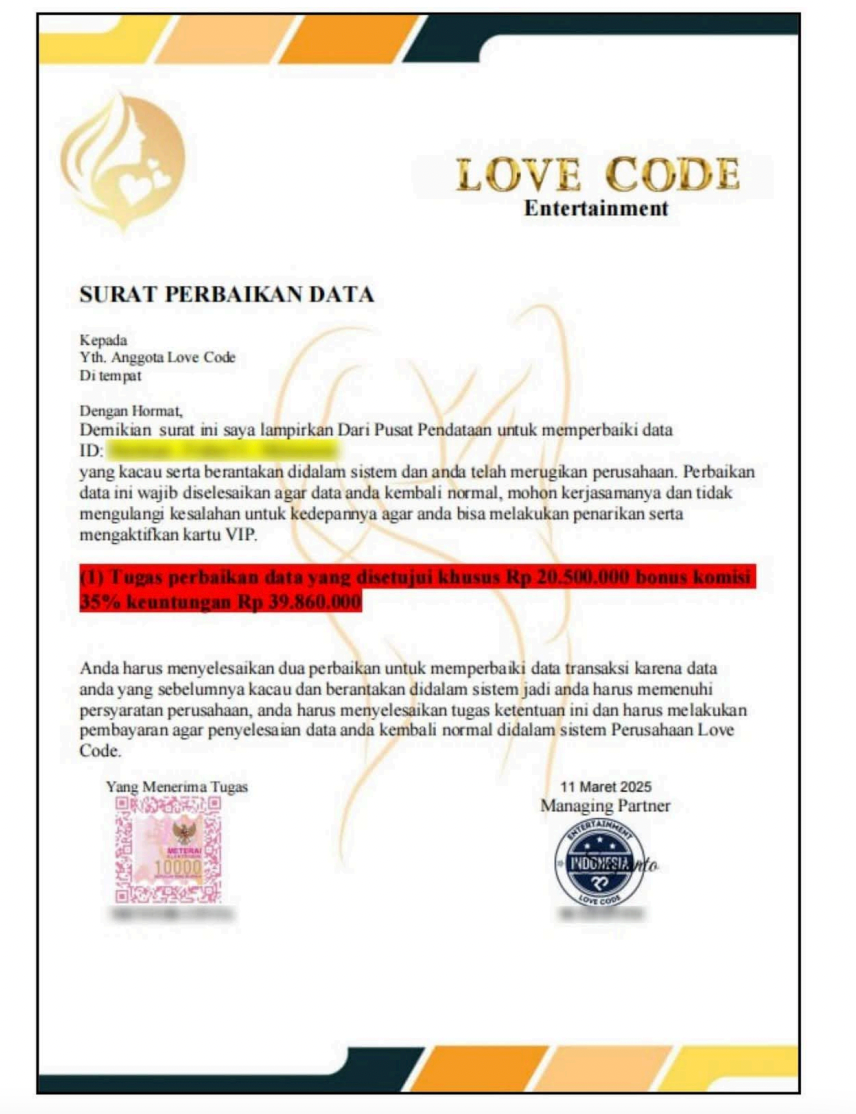

Họ bịa ra một lý do—ví dụ như “xử lý dữ liệu gặp lỗi”, hoặc “tiền bảo chứng xác minh”—để yêu cầu bạn chuyển một khoản tiền lớn một lần duy nhất. Trong báo cáo, OpenAI đăng tải một bức thư mà băng nhóm gửi cho nạn nhân, yêu cầu thanh toán 20,5 triệu Rupiah Indonesia (tương đương khoảng 12.000 USD), kèm cam kết hoàn lại 35% tiền thưởng sau khi thanh toán.

Sau khi tiền vào tài khoản, kẻ lừa đảo trên Telegram sẽ chặn bạn và ghi chú trạng thái “đã giải quyết xong”.

Đến đây, bạn có thể nghĩ rằng chẳng có gì đặc biệt.

Bản thân thủ đoạn lừa đảo không mới; mô thức “giết lợn” đã bị vạch trần nhiều lần trong vài năm gần đây. Điều thực sự khiến người ta sững sờ chính là hậu trường vận hành.

Các điều tra viên của OpenAI đã tái cấu trúc toàn bộ cơ cấu tổ chức doanh nghiệp dựa trên lịch sử sử dụng ChatGPT của băng nhóm:

Khu công nghiệp lừa đảo được chia làm ba bộ phận: nhóm thu hút lưu lượng (lead generation), nhóm tiếp đón và nhóm quản lý. Nhóm thu hút chịu trách nhiệm chạy quảng cáo để kéo người vào; nhóm tiếp đón phụ trách trò chuyện nhằm xây dựng lòng tin; còn nhóm quản lý thực hiện khâu “thu hoạch” cuối cùng.

Hằng ngày đều có báo cáo công việc. Báo cáo liệt kê từng nạn nhân đang được xử lý, ghi rõ người phụ trách, tiến độ xử lý ở đâu, và con số quan trọng kia:

kill value.

Đây là số tiền mà quản lý dự kiến “khai thác” được tối đa từ cá nhân nạn nhân.

Họ còn dùng ChatGPT để phân tích sổ sách kế toán, soạn báo cáo công việc, thậm chí hỏi ChatGPT cách kết nối API hay cách chỉnh sửa mã nguồn website hẹn hò. Trong trường hợp quản lý nói tiếng Trung còn nhân viên nói tiếng Indonesia, ChatGPT đảm nhiệm vai trò thông dịch hai chiều.

Điều gây cười là một nhân viên lừa đảo từng hỏi ChatGPT về nghĩa vụ thuế sau khi có thu nhập, và trong mục “nghề nghiệp”, anh ta thành thật điền là scammer (kẻ lừa đảo).

Văn phong báo cáo của OpenAI rất thận trọng: dựa trên nhật ký nhập liệu của chính băng nhóm lừa đảo, có thể suy ra họ đang xử lý hàng trăm mục tiêu đồng thời và thu về hàng nghìn đô la Mỹ mỗi ngày. Tuy nhiên, báo cáo cũng nêu rõ rằng các con số này chưa thể được xác minh độc lập.

Tuy nhiên, theo tôi, chúng ta không cần quá bận tâm về tính xác thực của các con số—chỉ cần nhìn vào quy trình quản trị này thôi cũng đã đủ rõ ràng:

Thu hút lưu lượng, chuyển đổi, giá trị đơn hàng trung bình, báo cáo hằng ngày, phân chia bộ phận… Chỉ cần thay đổi chút thuật ngữ, bạn sẽ tưởng mình đang đọc sổ tay vận hành của một công ty SaaS nào đó.

Còn việc tán tỉnh, dịch thuật, viết báo cáo, chỉnh sửa mã nguồn, tính toán sổ sách… phần lớn công việc trong khu công nghiệp này đều do một tài khoản ChatGPT đảm nhiệm.

Câu chuyện chưa dừng lại ở đây.

Cùng trong báo cáo này, OpenAI còn phanh phui một đường dây khác, mang tên mã Operation False Witness (Chiến dịch Nhân Chứng Giả), cũng xuất phát từ Campuchia.

Đường dây này không nhắm vào người bình thường, mà vào những người đã từng bị lừa.

Logic rất đơn giản: bạn vừa bị “giết lợn” mất tiền, bạn muốn đòi lại, nên lên mạng tìm cách.

Rồi bạn thấy một quảng cáo, có luật sư khẳng định chuyên giúp nạn nhân lừa đảo đòi lại thiệt hại. Bạn nhấn vào.

Website được thiết kế trông rất chuyên nghiệp. Ảnh luật sư một phần lấy cắp từ ảnh chân dung thật trên mạng xã hội, một phần do AI tạo ra. Mỗi văn phòng luật đều có địa chỉ, giấy phép hành nghề và tiểu sử chi tiết. ChatGPT đã tạo thẻ hội viên Hiệp hội Luật sư bang New York, cũng như các hồ sơ đăng ký luật sư giả.

OpenAI phát hiện ít nhất sáu văn phòng luật giả như vậy.

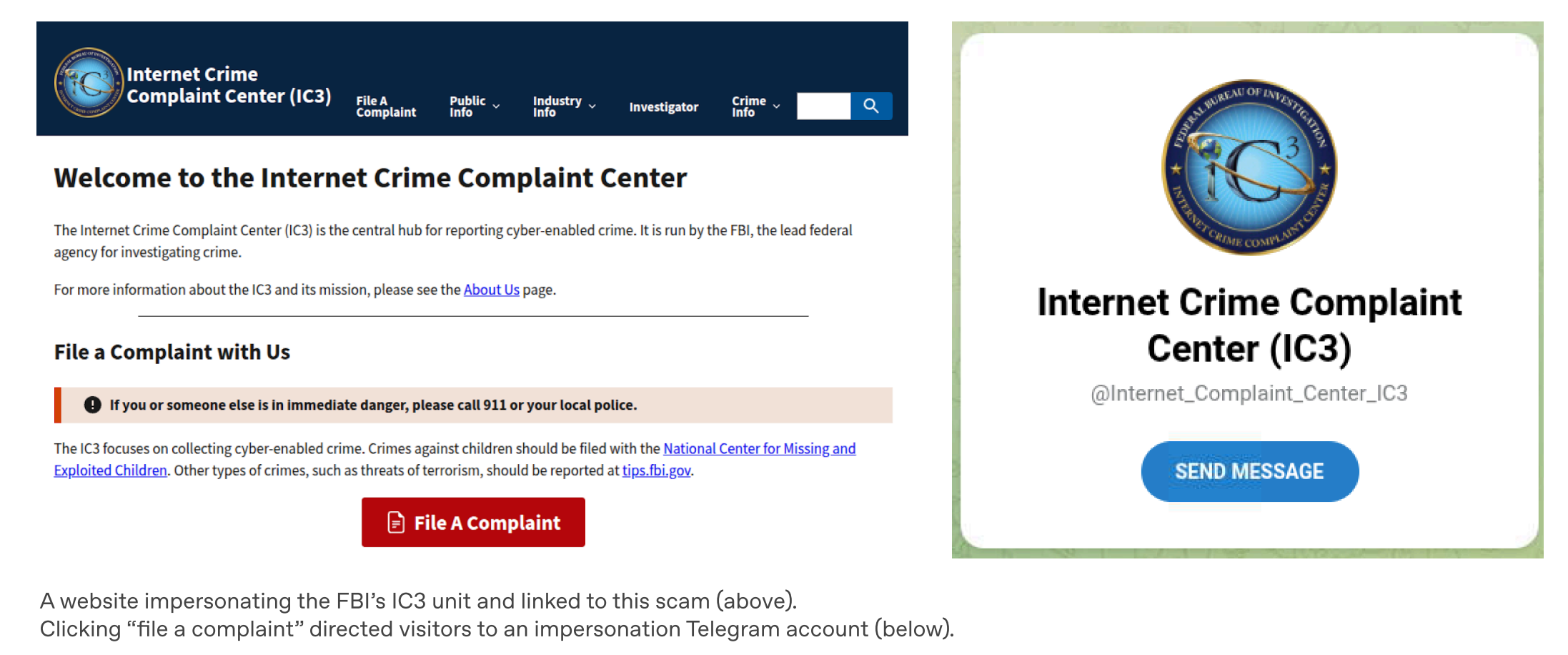

Một website khác thậm chí sao chép nguyên bản Trung tâm Khiếu nại Tội phạm Mạng Internet (IC3) của FBI. Trên trang web có nút “Gửi khiếu nại”, bạn nhấn vào, hệ thống sẽ chuyển bạn đến một tài khoản Telegram.

Khi vào Telegram, “luật sư” bắt đầu trò chuyện với bạn. Các mẫu hội thoại đều do ChatGPT tạo ra, với yêu cầu cụ thể là viết bằng “tiếng Anh kiểu Mỹ”, giọng điệu bắt chước luật sư chuyên nghiệp. Họ khẳng định đang hợp tác với Tòa án Hình sự Quốc tế và sẽ không thu phí trước khi hoàn lại tiền.

Tuy nhiên, họ yêu cầu bạn phải trả trước 15% phí dịch vụ để “kích hoạt tài khoản”, và thanh toán bằng tiền điện tử.

Họ còn yêu cầu bạn ký thỏa thuận bảo mật—một thỏa thuận cũng do ChatGPT soạn thảo, nhằm ngăn bạn tìm kiếm sự xác minh từ bên ngoài.

Về sau, FBI đã đưa ra cảnh báo công khai riêng về vụ việc này, nhấn mạnh rằng thủ đoạn này chủ yếu nhắm vào người cao tuổi, lợi dụng đúng tâm lý nóng vội muốn đòi lại tài sản đã mất của nạn nhân.

Sau khi xem xét cả hai vụ việc, tôi cho rằng điều khiến người ta vừa buồn cười vừa chua xót nhất trong bối cảnh AI hiện đã trở thành tiêu chuẩn phổ biến chính là:

Lần đầu tiên bạn bị lừa, bạn chỉ là một “mục tiêu”. Lần thứ hai bạn bị lừa, bạn lại là một “mục tiêu tốt hơn”, vì bạn đã tự chứng minh rằng mình dễ bị lừa.

Cuối cùng, OpenAI tổng kết quy trình lừa đảo thành ba bước trong báo cáo.

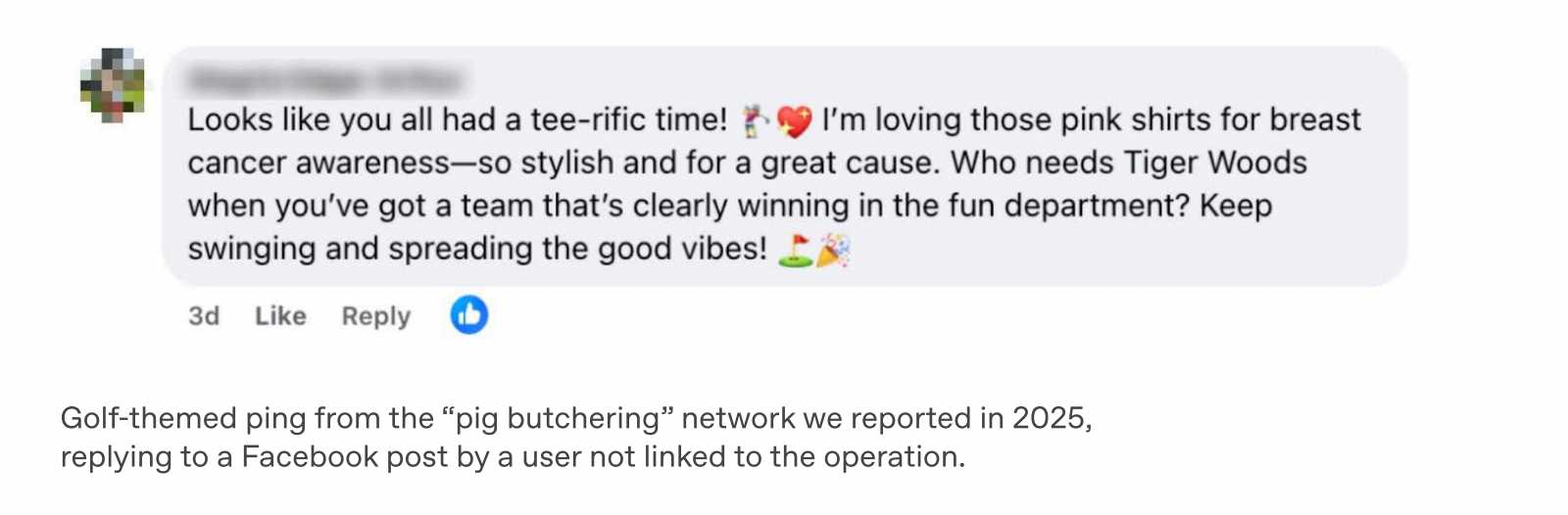

Bước một gọi là ping (liên hệ ban đầu): tiếp cận “lạnh”, tìm cách khiến mục tiêu chú ý đến bạn. Bước hai gọi là zing (kích hoạt cảm xúc): tạo ra cảm xúc—làm bạn rung động, phấn khích hoặc hoảng sợ. Bước ba gọi là sting (thu hoạch): chiếm đoạt tiền bạc.

Khung phân tích này khá sắc sảo. Hãy thử nhìn kỹ xem: trong cả ba bước ấy, bước nào là AI không làm được?

Trước đây, chi phí lớn nhất trong các vụ “giết lợn” là con người. Bạn phải thuê cả một phòng người ngồi trước máy tính để trò chuyện, lại còn phải thông thạo ngôn ngữ của nạn nhân. Những năm đầu, khu công nghiệp lừa đảo ở Campuchia còn tuyển người giỏi tiếng Anh và trả lương rất cao.

Nhưng giờ đây, trong vụ lừa đảo hẹn hò được nêu trong báo cáo, quản lý nói tiếng Trung, nhân viên nói tiếng Indonesia, còn nạn nhân cũng là người Indonesia. Ba bên bất đồng ngôn ngữ—trước đây việc này gần như không thể triển khai. Chỉ cần thêm một ChatGPT, mọi chuyện liền thông suốt.

Ngôn ngữ chỉ là một khía cạnh.

Một chi tiết khác trong báo cáo cho thấy, chính những “công nhân lừa đảo” còn hỏi ChatGPT cách kết nối API của OpenAI, nhằm tự động hóa hoàn toàn khâu trò chuyện.

Nói cách khác, AI không làm cho thủ đoạn lừa đảo trở nên tinh vi hơn—thủ đoạn vẫn y nguyên như cũ. AI chỉ làm cho thủ đoạn lừa đảo trở nên rẻ hơn.

Theo thông tin từ OpenAI, băng nhóm này hiện có thể đang xử lý đồng thời hàng trăm vụ lừa đảo. Quy mô mở rộng khiến chi phí nhân lực phân bổ cho mỗi nạn nhân giảm xuống, do đó họ có thể nhắm tới nhiều nạn nhân hơn với giá trị mỗi lần lừa thấp hơn.

Còn một vấn đề nữa, theo tôi, đáng để suy ngẫm sâu hơn.

OpenAI có thể phát hiện ra những vụ việc này vì băng nhóm sử dụng ChatGPT—tức là lịch sử trò chuyện được lưu trữ trên máy chủ của OpenAI.

Còn những băng nhóm dùng các mô hình mã nguồn mở được triển khai cục bộ thì sao?

Có thể nói, báo cáo này chỉ phản ánh một góc nhỏ trong toàn bộ bức tranh—góc mà OpenAI có thể “soi sáng”. Còn phần “bóng tối” còn lại rộng đến đâu, không ai biết.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News