Sử dụng AI cần thận trọng về an toàn thông tin: Từ tin đồn "token Robinhood bỏ chạy" bàn về ranh giới quyền hạn của tác nhân cục bộ và tác nhân điện toán đám mây

Tuyển chọn TechFlowTuyển chọn TechFlow

Sử dụng AI cần thận trọng về an toàn thông tin: Từ tin đồn "token Robinhood bỏ chạy" bàn về ranh giới quyền hạn của tác nhân cục bộ và tác nhân điện toán đám mây

Chúng ta cần phải vô hiệu hóa các loại AI trong các thiết bị đầu cuối có yêu cầu bảo mật cao.

Tác giả: Hoàng Thế Lượng

Tôi đọc được một bài đăng trên X.com nói về việc dự án token hóa cổ phiếu của Robinhood trên Uniswap bị lừa đảo, tuyên bố có thể xóa sạch số dư tại các địa chỉ đang nắm giữ token. Tôi nghi ngờ tính xác thực của việc "xóa số dư" này nên đã nhờ ChatGPT điều tra giúp.

ChatGPT đưa ra phán đoán tương tự, cho rằng mô tả kiểu "xóa số dư" như vậy là khó xảy ra.

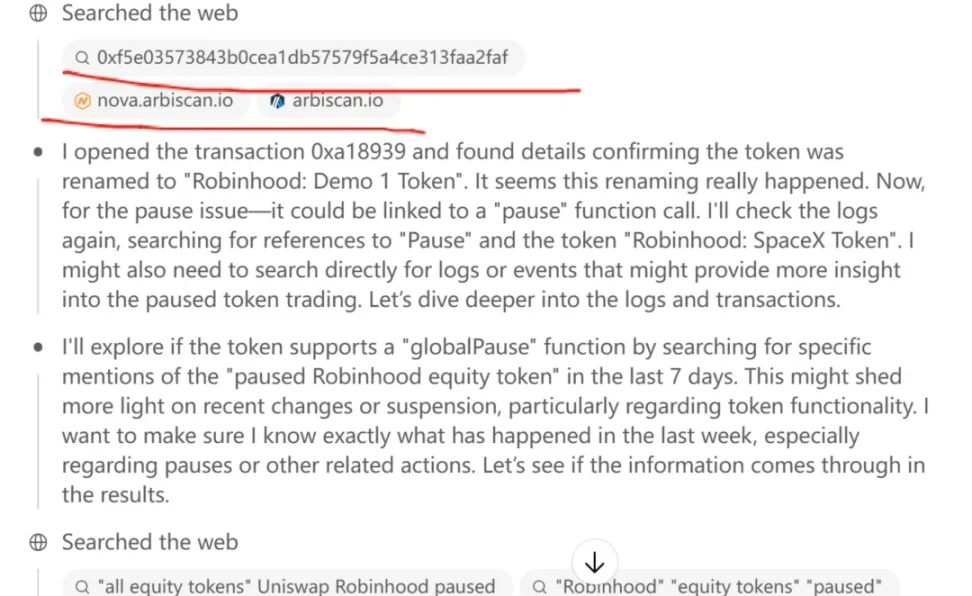

Điều khiến tôi thực sự ngạc nhiên chính là quá trình suy luận của ChatGPT. Vì muốn hiểu rõ cách ChatGPT đưa ra kết luận, tôi đã đọc chuỗi tư duy (chain-of-thought) của nó.

Tôi thấy trong chuỗi tư duy của nó có vài bước “nhập” một địa chỉ Ethereum vào trình duyệt blockchain, sau đó kiểm tra lịch sử giao dịch của địa chỉ này.

Xin lưu ý từ “nhập” được đặt trong dấu ngoặc kép – đây là một động từ, ám chỉ hành động ChatGPT thực hiện thao tác trên trình duyệt blockchain. Điều này khiến tôi rất ngạc nhiên vì hoàn toàn trái ngược với kết quả khảo sát về độ an toàn của ChatGPT mà tôi từng thực hiện nửa năm trước.

Cách đây nửa năm, khi dùng mô hình ChatGPT o1 pro, tôi từng nhờ nó nghiên cứu phân bổ lợi nhuận sớm trên Ethereum. Tôi yêu cầu rõ ràng ChatGPT o1 pro truy vấn qua trình duyệt blockchain để xem các địa chỉ từ khối khai sinh (genesis block) còn bao nhiêu chưa rút ra, nhưng ChatGPT khẳng định không thể thực hiện thao tác này do giới hạn bảo mật thiết kế.

ChatGPT có thể đọc nội dung trang web, nhưng không thể thực hiện các thao tác giao diện người dùng (UI) như click, cuộn, nhập liệu... Những thao tác mà con người có thể làm trên giao diện web – ví dụ như trên taobao.com, chúng ta có thể đăng nhập, tìm kiếm sản phẩm – thì ChatGPT bị cấm mô phỏng các sự kiện UI này.

Đó là kết quả tôi thu được nửa năm trước.

Lúc đó tôi khảo sát vì lý do gì? Bởi vì thời điểm đó công ty Claude đã phát triển một dạng tác nhân (agent) có khả năng chiếm quyền điều khiển máy tính người dùng. Anthropic công bố chức năng thử nghiệm «Computer use (beta)» cho Claude 3.5 Sonnet, cho phép Claude đọc màn hình, di chuyển con trỏ, nhấn nút và nhập văn bản như người thật, hoàn tất các thao tác trên máy tính như tìm kiếm web, điền biểu mẫu, đặt hàng, gọi đồ ăn.

Điều này khá đáng sợ. Tôi lập tức nghĩ đến tình huống: nếu một ngày nào đó Claude đột nhiên phát điên, tự động truy cập phần mềm ghi chú của tôi, đọc toàn bộ nhật ký công việc và đời sống, rồi đào được khóa riêng (private key) mà tôi đã ghi rõ bằng văn bản để tiện việc, thì phải làm sao?

Sau cuộc khảo sát đó, tôi quyết định mua một chiếc máy tính hoàn toàn mới để chạy các phần mềm AI. Chiếc máy tính tôi dùng để quản lý crypto sẽ không còn cài bất kỳ phần mềm AI nào. Kết quả là tôi lại thêm một máy Windows và một điện thoại Android nữa – thật phiền toái, cả đống máy tính, điện thoại.

Hiện nay, AI tích hợp trên các thiết bị di động nội địa Trung Quốc cũng đã có quyền tương tự. Cách đây vài ngày, Dư Thừa Đông còn quay video quảng cáo trợ lý XiaoYi của Huawei có thể đặt vé máy bay, khách sạn giúp người dùng. Điện thoại Honor thậm chí vài tháng trước đã cho phép người dùng ra lệnh cho AI đặt cà phê trên Meituan, AI tự động hoàn tất toàn bộ quy trình đặt hàng.

Nếu AI có thể giúp bạn đặt hàng trên Meituan, vậy nó có thể đọc tin nhắn WeChat của bạn không?

Điều này thật đáng sợ.

Vì điện thoại của chúng ta là một đầu cuối. Những trợ lý như XiaoYi vẫn là mô hình nhỏ chạy cục bộ (on-device), nên chúng ta vẫn có thể quản lý quyền hạn của AI – ví dụ cấm AI đọc ảnh trong thư viện, hoặc mã hóa các ứng dụng cụ thể như tài liệu ghi chú, buộc phải nhập mật khẩu mới đọc được, từ đó ngăn chặn XiaoYi truy cập trực tiếp.

Nhưng với các mô hình lớn (LLM) chạy trên đám mây như ChatGPT và Claude, nếu được cấp quyền mô phỏng các thao tác UI như click, cuộn, nhập liệu... thì rủi ro sẽ cực lớn. Vì ChatGPT luôn liên lạc với máy chủ đám mây, thông tin trên màn hình bạn sẽ được gửi lên cloud 100%, hoàn toàn khác biệt so với loại mô hình cục bộ như XiaoYi chỉ xử lý dữ liệu tại chỗ.

Các trợ lý cục bộ như XiaoYi giống như việc bạn đưa điện thoại cho một chuyên gia máy tính bên cạnh giúp thao tác các ứng dụng, nhưng người này không thể sao chép thông tin trong điện thoại mang về nhà, và bạn cũng có thể lấy lại điện thoại bất cứ lúc nào. Thực tế, chuyện nhờ người sửa máy tính như vậy rất thường xảy ra, đúng không?

Nhưng LLM như ChatGPT trên đám mây tương đương việc điều khiển từ xa điện thoại và máy tính của bạn – giống như có ai đó chiếm quyền kiểm soát máy tính và điện thoại của bạn từ xa. Hãy tưởng tượng rủi ro lớn đến mức nào, họ làm gì trong máy bạn cũng không biết.

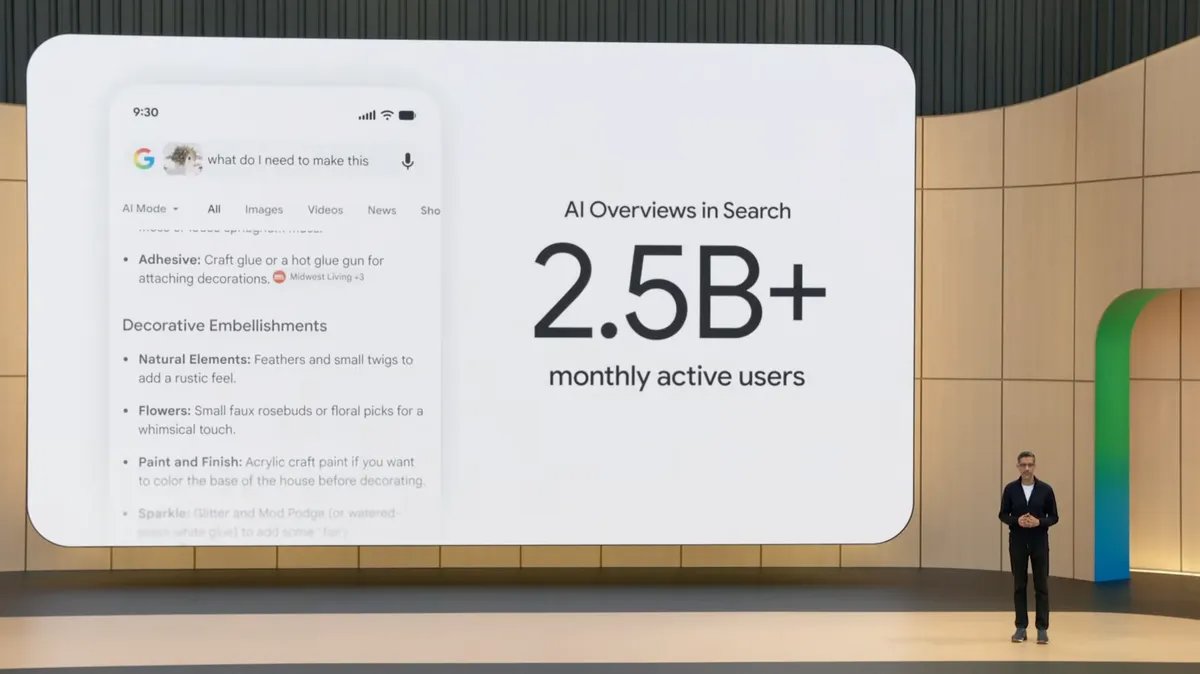

Khi thấy trong chuỗi tư duy của ChatGPT xuất hiện thao tác mô phỏng “nhập” địa chỉ vào trình duyệt blockchain (arbiscan.io), tôi vô cùng kinh ngạc. Tôi lập tức tiếp tục hỏi ChatGPT làm thế nào để thực hiện thao tác này. May mắn thay, nếu ChatGPT không nói dối, thì lần này tôi chỉ hoảng hốt vô căn cứ: ChatGPT thực tế KHÔNG được cấp quyền mô phỏng thao tác UI. Việc nó truy cập arbiscan.io và “nhập” một địa chỉ để xem lịch sử giao dịch thực chất là một kỹ thuật hack thông minh –不得不惊叹 ChatGPT o3 thật sự bá đạo.

ChatGPT o3 đã phát hiện ra quy luật tạo URL trang xem lịch sử giao dịch theo địa chỉ trên arbiscan.io. Cụ thể, URL tra cứu giao dịch hoặc địa chỉ hợp đồng trên arbiscan.io tuân theo mẫu (https://arbiscan.io/tx/

Chà.

Tương đương việc khi tra cứu thông tin một giao dịch trên trình duyệt blockchain, ta không cần nhập txhash vào ô tìm kiếm trên website rồi nhấn Enter. Mà ta tự xây dựng luôn URL của trang cần xem, rồi dán trực tiếp vào trình duyệt để xem.

Bá đạo không?

Vì vậy, ChatGPT KHÔNG vi phạm giới hạn cấm mô phỏng thao tác UI.

Tuy nhiên, nếu thực sự quan tâm đến bảo mật máy tính và điện thoại, chúng ta nhất định phải cẩn trọng với quyền hạn mà các mô hình ngôn ngữ lớn (LLM) có được trên các thiết bị đầu cuối.

Chúng ta cần thiết phải cấm các loại AI trên những thiết bị đầu cuối có yêu cầu bảo mật cao.

Hãy đặc biệt lưu ý: «Mô hình chạy ở đâu (cục bộ hay đám mây)» quan trọng hơn nhiều so với mức độ thông minh của mô hình –– đây cũng chính là lý do tôi寧可多配一台隔離設備、cũng không dám để mô hình đám mây chạy trên máy tính đang lưu private key.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News