크립토 AI의 성배: 탈중앙화 훈련의 최전선 탐구

글 작성: 0xjacobzhao 및 ChatGPT 4o

Advait Jayant(Peri Labs), Sven Wellmann(Polychain Capital), Chao(Metropolis DAO), Jiahao(Flock), Alexander Long(Pluralis Research), Ben Fielding & Jeff Amico(Gensyn)의 조언과 피드백에 특별히 감사드립니다.

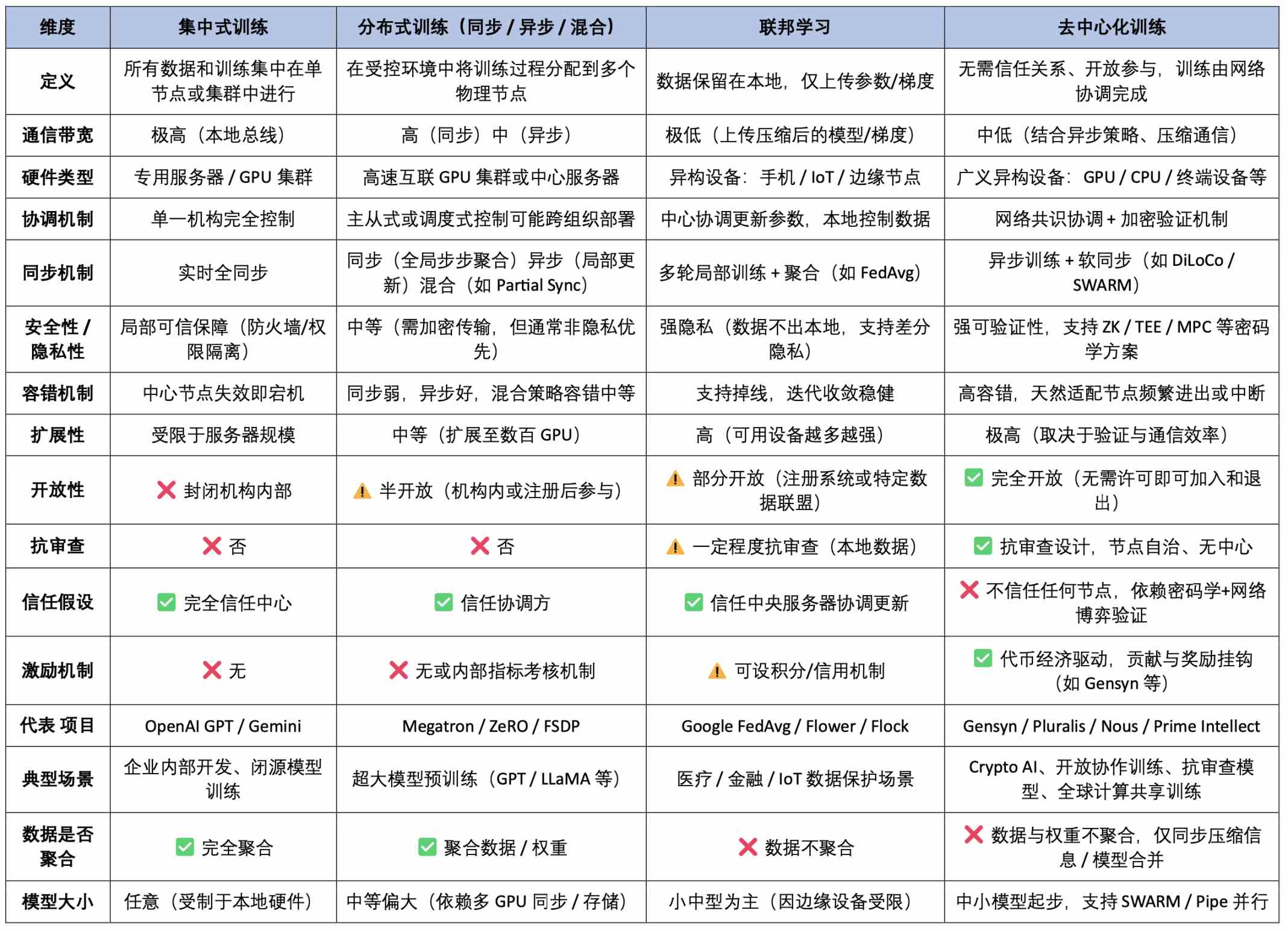

AI 전 가치 사슬에서 모델 훈련은 자원 소모가 가장 크고 기술 장벽이 가장 높은 단계로, 모델의 능력 한계와 실제 적용 효과를 직접적으로 결정합니다. 추론 단계의 경량 호출과 비교해 훈련 과정은 지속적인 대규모 컴퓨팅 파워, 복잡한 데이터 처리 프로세스, 강도 높은 최적화 알고리즘을 필요로 하며, 이는 AI 시스템 구축의 진정한 "중공업"입니다. 아키텍처 패러다임 관점에서 훈련 방식은 네 가지로 나뉩니다: 중앙집중형 훈련, 분산 훈련, 연합 학습, 그리고 본문에서 주로 다룰 탈중앙화 훈련입니다.

중앙집중형 훈련은 가장 일반적인 전통적 방식으로, 단일 기관이 고성능 클러스터 내에서 모든 훈련 절차를 완료합니다. 하드웨어(NVIDIA GPU 등), 저수준 소프트웨어(CUDA, cuDNN), 클러스터 스케줄링 시스템(Kubernetes 등), 훈련 프레임워크(PyTorch의 NCCL 백엔드 기반 등)까지 모든 구성 요소가 통합된 제어 시스템에 의해 조율됩니다. 이러한 깊이 있는 협업 구조는 메모리 공유, 그래디언트 동기화, 오류 복구 메커니즘의 효율성을 극대화하며, GPT, Gemini 등 대규모 모델 훈련에 적합하여 효율성과 자원 통제력 측면에서 이점을 갖습니다. 그러나 동시에 데이터 독점, 자원 장벽, 에너지 소비, 단일 실패점 등의 문제도 존재합니다.

분산 훈련(Distributed Training)은 현재 대규모 모델 훈련의 주류 방식으로, 핵심은 훈련 작업을 분할하여 여러 기기에 분산시켜 단일 기기의 계산 및 저장 한계를 극복하는 것입니다. 물리적으로 "분산" 특성을 갖지만, 전체 시스템은 여전히 중앙 집중 기관이 스케줄링과 동기화를 통제하며, 보통 고속 LAN 환경에서 NVLink 고속 인터커넥트 버스 기술을 통해 마스터 노드가 각 서브태스크를 조율합니다. 주요 방법에는 다음과 같은 것들이 있습니다:

-

데이터 병렬(Data Parallel): 각 노드가 서로 다른 데이터로 훈련하되 매개변수를 공유하고 모델 가중치를 일치시킴

-

모델 병렬(Model Parallel): 모델의 다양한 부분을 서로 다른 노드에 배포하여 확장성 향상

-

파이프라인 병렬(Pipeline Parallel): 단계별로 직렬 실행하여 처리량 증가

-

텐서 병렬(Tensor Parallel): 행렬 계산을 세밀하게 분할하여 병렬 처리 수준 향상

분산 훈련은 '중앙 통제 + 분산 실행'의 조합이며, 하나의 사장이 여러 "사무실"의 직원들을 원격으로 지휘하는 것과 유사합니다. 현재 거의 모든 주요 대규모 모델(GPT-4, Gemini, LLaMA 등)은 이 방식으로 훈련되었습니다.

탈중앙화 훈련(Decentralized Training)은 더 개방적이며 검열 저항성이 강한 미래 지향적 접근 방식을 의미합니다. 그 핵심 특징은 서로 신뢰하지 않는 노드들(가정용 컴퓨터, 클라우드 GPU 또는 엣지 디바이스일 수 있음)이 중앙 조정기가 없이 협력하여 훈련 작업을 수행한다는 점입니다. 일반적으로 프로토콜을 통해 작업 분배와 협력을 구동하며, 암호 기반 인센티브 메커니즘을 통해 기여의 정직성을 보장합니다. 이 모델이 직면한 주요 도전 과제는 다음과 같습니다:

-

장비 이질성과 분할 난이도: 이질적인 장비 조율이 어려우며, 작업 분할 효율이 낮음

-

통신 효율 병목: 네트워크 불안정, 그래디언트 동기화 병목 현상 두드러짐

-

신뢰 가능한 실행 환경 부족: TEE(Trusted Execution Environment) 부재로 노드의 실제 계산 참여 여부 검증 어려움

-

통합된 조정 부재: 중앙 스케줄러 없이 작업 분배, 예외 롤백 메커니즘이 복잡함

탈중앙화 훈련은 전 세계 자원봉사자들이 각각 컴퓨팅 파워를 기부하여 협력적으로 모델을 훈련하는 것으로 이해할 수 있습니다. 하지만 '실질적으로 가능하고 규모화 가능한 탈중앙화 훈련'은 여전히 시스템 아키텍처, 통신 프로토콜, 암호 보안, 경제 메커니즘, 모델 검증 등 다층적 영역에 걸친 체계적인 엔지니어링 도전이며, '협력적이고 효과적이며, 정직한 인센티브를 제공하고, 결과가 올바른지' 여부는 아직 초기 프로토타입 탐색 단계에 머물러 있습니다.

연합 학습(Federated Learning)은 분산과 탈중앙화 사이의 전이 형태로, 데이터는 로컬에 보존하고 모델 파라미터만 중앙에서 집계하는 것을 강조하며, 의료, 금융 등 개인정보 준수를 중시하는 시나리오에 적합합니다. 연합 학습은 분산 훈련의 공학 구조와 지역 협업 능력을 갖추면서도, 탈중앙화 훈련의 데이터 분산 이점을 유지하지만, 여전히 신뢰 가능한 조정자가 필요하며, 완전한 개방성과 검열 저항성을 갖추지 못했습니다. 이를 개인정보 준수 시나리오에서의 '제어된 탈중앙화' 솔루션으로 볼 수 있으며, 훈련 작업, 신뢰 구조, 통신 메커니즘 모두 상대적으로 온건하여 산업계 전환 배포 아키텍처로 더 적합합니다.

AI 훈련 패러다임 종합 비교표 (기술 아키텍처 × 신뢰 인센티브 × 응용 특성)

탈중앙화 훈련의 경계, 기회 및 현실적 경로

훈련 패러다임 관점에서 탈중앙화 훈련은 모든 작업 유형에 적합하지 않습니다. 일부 시나리오에서는 작업 구조가 복잡하거나 자원 요구가 매우 높거나 협업 난이도가 크기 때문에, 이질적이고 신뢰 없는 노드 간에 효율적으로 수행하기 어렵습니다. 예를 들어, 대규모 모델 훈련은 일반적으로 높은 VRAM, 낮은 지연 시간, 고속 대역폭에 의존하므로 공개 네트워크에서 효과적으로 분할 및 동기화하기 어렵습니다. 개인정보 및 권한 제한이 강한 작업(예: 의료, 금융, 기밀 데이터)은 법적 규정 및 윤리적 제약으로 인해 공유가 불가능하며, 협업 인센티브 기반이 부족한 작업(예: 기업 폐쇄형 모델 또는 내부 프로토타입 훈련)은 외부 참여 동기를 결여하고 있습니다. 이러한 경계들은 현재 탈중앙화 훈련의 현실적 제약을 형성하고 있습니다.

그럼에도 불구하고 탈중앙화 훈련이 허구라고 볼 수 없습니다. 실제로 구조가 가볍고, 쉽게 병렬화 가능하며, 인센티브가 가능한 작업 유형에서는 명확한 응용 전망을 보여줍니다. LoRA 미세 조정, 행동 정렬 후처리 작업(RLHF, DPO), 데이터 크라우드소싱 훈련 및 주석 작업, 자원 제어가 가능한 소형 기초 모델 훈련, 엣지 디바이스가 참여하는 협동 훈련 시나리오 등이 포함됩니다. 이러한 작업들은 일반적으로 높은 병렬성, 낮은 결합도, 이질적 컴퓨팅 파워에 대한 용인도를 가지며, P2P 네트워크, Swarm 프로토콜, 분산 최적화기 등을 통해 협업 훈련이 가능합니다.

탈중앙화 훈련 작업 적합성 종합 표

탈중앙화 훈련 대표 프로젝트 분석

현재 탈중앙화 훈련 및 연합 학습 분야에서 대표적인 블록체인 프로젝트로는 Prime Intellect, Pluralis.ai, Gensyn, Nous Research, Flock.io 등이 있습니다. 기술적 혁신성과 엔지니어링 실현 난이도 면에서 Prime Intellect, Nous Research, Pluralis.ai는 시스템 아키텍처 및 알고리즘 설계에서 많은 독창적 탐색을 제시하며 현재 이론 연구의 최전선을 대표하고 있습니다. 반면 Gensyn과 Flock.io는 실현 경로가 상대적으로 명확하며 초보적인 엔지니어링 진행 상황을 확인할 수 있습니다. 본문에서는 이 다섯 프로젝트의 핵심 기술과 엔지니어링 아키텍처를 차례로 분석하고, 탈중앙화 AI 훈련 시스템 내에서의 차이점과 상호 보완 관계를 탐구합니다.

Prime Intellect: 훈련 궤적 검증이 가능한 강화 학습 협업 네트워크의 선구자

Prime Intellect은 누구나 참여하고 계산 기여에 대해 신뢰할 수 있는 보상을 받을 수 있는 신뢰 불필요 AI 훈련 네트워크 구축을 목표로 합니다. PRIME-RL + TOPLOC + SHARDCAST 세 가지 모듈을 통해 검증 가능성, 개방성, 인센티브 메커니즘이 완비된 탈중앙화 AI 훈련 시스템을 구축하려고 합니다.

1. Prime Intellect 프로토콜 스택 구조 및 핵심 모듈 가치

2. Prime Intellect 훈련 핵심 메커니즘 상세 분석

PRIME-RL: 해체형 비동기 강화 학습 작업 아키텍처

PRIME-RL은 탈중앙화 훈련 시나리오에 맞춘 작업 모델링 및 실행 프레임워크로, 이질적 네트워크와 비동기 참여를 위해 설계되었습니다. 강화 학습을 우선 적응 대상으로 삼아 훈련, 추론, 가중치 업로드 프로세스를 구조적으로 분리하여 각 훈련 노드가 로컬에서 독립적으로 작업 순환을 완료하고 표준화된 인터페이스를 통해 검증 및 집계 메커니즘과 협업할 수 있도록 합니다. 기존 지도 학습 프로세스와 비교해 PRIME-RL은 중심 스케줄러가 없는 환경에서 탄력적인 훈련을 구현하기에 더 적합하며, 시스템 복잡성을 낮추고 다중 작업 병렬화 및 전략 진화의 기반을 마련합니다.

TOPLOC: 경량 훈련 행동 검증 메커니즘

TOPLOC(Trusted Observation & Policy-Locality Check)은 Prime Intellect이 제안한 훈련 검증 가능성의 핵심 메커니즘으로, 노드가 관측 데이터를 기반으로 효과적인 전략 학습을 실제로 완료했는지를 판단합니다. ZKML과 같은 무거운 솔루션과 달리, TOPLOC은 전체 모델 재계산에 의존하지 않고, '관측 시퀀스 ↔ 정책 업데이트' 간의 국소 일관성 궤적을 분석하여 경량 구조 검증을 수행합니다. 훈련 과정 중 행동 궤적을 처음으로 검증 가능한 객체로 전환한 것이며, 신뢰 불필요한 훈련 보상 배분을 실현하는 핵심 혁신으로, 감사 가능하고 인센티브 기반의 탈중앙화 협업 훈련 네트워크 구축에 실현 가능한 경로를 제공합니다.

SHARDCAST: 비동기 가중치 집계 및 전파 프로토콜

SHARDCAST는 Prime Intellect이 설계한 가중치 전파 및 집계 프로토콜로, 비동기, 대역폭 제한, 노드 상태 변화가 잦은 실제 네트워크 환경에 최적화되었습니다. gossip 전파 메커니즘과 국소 동기화 전략을 결합하여 다수의 노드가 비동기 상태에서도 지속적으로 부분 업데이트를 제출할 수 있도록 하여 가중치의 점진적 수렴과 다중 버전 진화를 실현합니다. 중앙 집중형 또는 동기식 AllReduce 방법과 비교해 SHARDCAST는 탈중앙화 훈련의 확장성과 오류 허용 능력을 크게 향상시키며, 안정적인 가중치 컨센서스와 지속적인 훈련 반복을 위한 핵심 기반입니다.

OpenDiLoCo: 희소 비동기 통신 프레임워크

OpenDiLoCo는 DeepMind가 제안한 DiLoCo 개념을 기반으로 Prime Intellect 팀이 독자적으로 구현하고 오픈소스화한 통신 최적화 프레임워크로, 탈중앙화 훈련에서 흔히 발생하는 대역폭 제한, 장비 이질성, 노드 불안정성 등의 도전에 특화되어 설계되었습니다. 데이터 병렬 기반 아키텍처를 사용하며, Ring, Expander, Small-World 등 희소 토폴로지 구조를 구축하여 전역 동기화의 높은 통신 오버헤드를 피하고, 국소 이웃 노드에 의해서만 모델 협업 훈련을 완료합니다. 비동기 업데이트와 체크포인트 복구 메커니즘을 결합하여 소비자용 GPU 및 엣지 디바이스도 안정적으로 훈련 작업에 참여할 수 있게 하며, 글로벌 협업 훈련의 참여 가능성을 크게 향상시킵니다. 이는 탈중앙화 훈련 네트워크 구축의 핵심 통신 인프라 중 하나입니다.

PCCL: 공동 통신 라이브러리

PCCL(Prime Collective Communication Library)은 탈중앙화 AI 훈련 환경을 위해 특별히 설계된 경량 통신 라이브러리로, 기존 통신 라이브러리(NCCL, Gloo 등)가 이질적 장비, 저대역폭 네트워크에서 겪는 적합성 문제를 해결합니다. PCCL은 희소 토폴로지, 그래디언트 압축, 저정밀 동기화, 체크포인트 복구를 지원하며, 소비자용 GPU 및 불안정한 노드에서도 작동 가능하며, OpenDiLoCo 프로토콜의 비동기 통신 능력을 지원하는 하위 구성 요소입니다. 훈련 네트워크의 대역폭 허용도와 장비 호환성을 크게 향상시켜, 진정으로 개방되고 신뢰 불필요한 협업 훈련 네트워크의 통신 기반을 완성합니다.

3. Prime Intellect 인센티브 네트워크 및 역할 분담

Prime Intellect은 허가 불필요, 검증 가능, 경제 인센티브 메커니즘이 있는 훈련 네트워크를 구축하여 누구나 참여하고 실질적인 기여에 따라 보상을 받을 수 있도록 합니다. 프로토콜은 세 가지 핵심 역할을 기반으로 운영됩니다:

-

작업 발주자(Task Initiator): 훈련 환경, 초기 모델, 보상 함수, 검증 기준을 정의

-

훈련 노드(Training Node): 로컬 훈련 수행, 가중치 업데이트 및 관측 궤적 제출

-

검증 노드(Verification Node): TOPLOC 메커니즘을 사용해 훈련 행동의 진실성을 검증하고 보상 계산 및 전략 집계에 참여

프로토콜의 핵심 프로세스는 작업 게시, 노드 훈련, 궤적 검증, 가중치 집계(SHARDCAST), 보상 지급으로 이루어져 '실제 훈련 행동'을 중심으로 한 인센티브 폐쇄 회로를 형성합니다.

4. INTELLECT-2: 최초의 검증 가능한 탈중앙화 훈련 모델 출시

Prime Intellect은 2025년 5월 INTELLECT-2를 발표했습니다. 이는 비동기적이고 신뢰 불필요한 탈중앙화 노드들이 협력하여 훈련한 세계 최초의 강화 학습 대규모 모델로, 파라미터 규모는 32B입니다. INTELLECT-2 모델은 세 대륙에 위치한 100개 이상의 GPU 이질적 노드들이 협력하여 훈련되었으며, 완전한 비동기 아키텍처를 사용해 400시간 이상의 훈련 시간을 거쳐 비동기 협업 네트워크의 실현 가능성과 안정성을 입증했습니다. 이 모델은 성능상 돌파구를 이루었을 뿐 아니라, Prime Intellect이 제안한 '훈련 즉 컨센서스' 패러다임의 첫 시스템적 실현이기도 합니다. INTELLECT-2는 PRIME-RL(비동기 훈련 구조), TOPLOC(훈련 행동 검증), SHARDCAST(비동기 가중치 집계) 등 핵심 프로토콜 모듈을 통합하여, 훈련 과정의 개방성, 검증 가능성, 경제 인센티브 폐쇄 회로를 처음으로 실현했습니다.

성능 면에서 INTELLECT-2는 QwQ-32B를 기반으로 훈련되어 코드 및 수학 분야에서 특화된 RL 훈련을 수행했으며, 현재 오픈소스 RL 미세 조정 모델의 최전선 수준에 있습니다. GPT-4 또는 Gemini와 같은 폐쇄형 모델을 아직 초월하지는 못했지만, 그 진정한 의미는 훈련 전 과정이 재현 가능하고, 검증 가능하며, 감사 가능한 세계 최초의 탈중앙화 모델 실험이라는 점입니다. Prime Intellect은 모델뿐 아니라 훈련 과정 자체를 오픈소스화하여 훈련 데이터, 전략 업데이트 궤적, 검증 프로세스, 집계 로직을 모두 투명하게 공개함으로써 누구나 참여하고 신뢰 가능한 협업, 수익 공유가 가능한 탈중앙화 훈련 네트워크 프로토타입을 구축했습니다.

5. 팀 및 투자 배경

Prime Intellect은 2025년 2월 1500만 달러 규모의 시드 펀딩을 완료하였으며, Founders Fund가 리드 투자하고 Menlo Ventures, Andrej Karpathy, Clem Delangue, Dylan Patel, Balaji Srinivasan, Emad Mostaque, Sandeep Nailwal 등 다수의 업계 리더들이 참여했습니다. 이전에 2024년 4월에는 CoinFund와 Distributed Global이 공동 리드 투자한 550만 달러 규모의 초기 펀딩을 완료하였으며, Compound VC, Collab + Currency, Protocol Labs 등 기관들도 참여했습니다. 지금까지 Prime Intellect의 누적 투자금은 2000만 달러를 초과합니다.

Prime Intellect의 공동 창립자는 Vincent Weisser와 Johannes Hagemann이며, 팀 구성원들의 배경은 AI 및 Web3 분야를 아우릅니다. 핵심 멤버들은 Meta AI, Google Research, OpenAI, Flashbots, Stability AI 및 이더리움 재단 출신으로, 시스템 아키텍처 설계 및 분산형 엔지니어링 실현 능력이 뛰어나며, 현재 실제로 탈중앙화 대규모 모델 훈련을 성공적으로 완료한 소수의 실행 팀 중 하나입니다.

Pluralis: 비동기 모델 병렬 및 구조 압축 협업 훈련 패러다임 탐색자

Pluralis는 '신뢰 가능한 협업 훈련 네트워크'에 집중하는 Web3 AI 프로젝트로, 핵심 목표는 탈중앙화되고 개방적으로 참여 가능하며 장기 인센티브 메커니즘이 있는 모델 훈련 패러다임을 추진하는 것입니다. 현재 주류인 중앙집중형 또는 폐쇄형 훈련 경로와 달리, Pluralis는 '프로토콜 학습(Protocol Learning)'이라는 새로운 개념을 제안합니다. 모델 훈련 과정을 '프로토콜화'하여 검증 가능한 협업 메커니즘과 모델 소유권 매핑을 통해 내생적인 인센티브 폐쇄 회로를 갖춘 개방형 훈련 시스템을 구축합니다.

1. 핵심 개념: 프로토콜 학습(Protocol Learning)

Pluralis가 제안한 프로토콜 학습은 세 가지 핵심 기둥으로 구성됩니다:

-

추출 불가능한 모델(Unmaterializable Models): 모델이 여러 노드 사이에 조각 형태로 분포되어 있어, 어떤 단일 노드도 완전한 가중치를 복원할 수 없습니다. 이 설계는 모델을 자연스럽게 '프로토콜 내 자산'으로 만들며, 접근 권한 제어, 유출 방지, 수익 귀속 바인딩을 실현합니다.

-

인터넷 기반 모델 병렬 훈련(Model-parallel Training over Internet): 비동기 파이프라인 모델 병렬 메커니즘(SWARM 아키텍처)을 통해 서로 다른 노드가 일부 가중치만 보유하고 낮은 대역폭 네트워크에서 협력하여 훈련 또는 추론을 완료합니다.

-

기여도에 따른 모델 소유권 분배(Partial Ownership for Incentives): 모든 참여 노드는 훈련 기여에 따라 모델의 일부 소유권을 얻어 미래 수익 분배 및 프로토콜 거버넌스 권한을 누립니다.

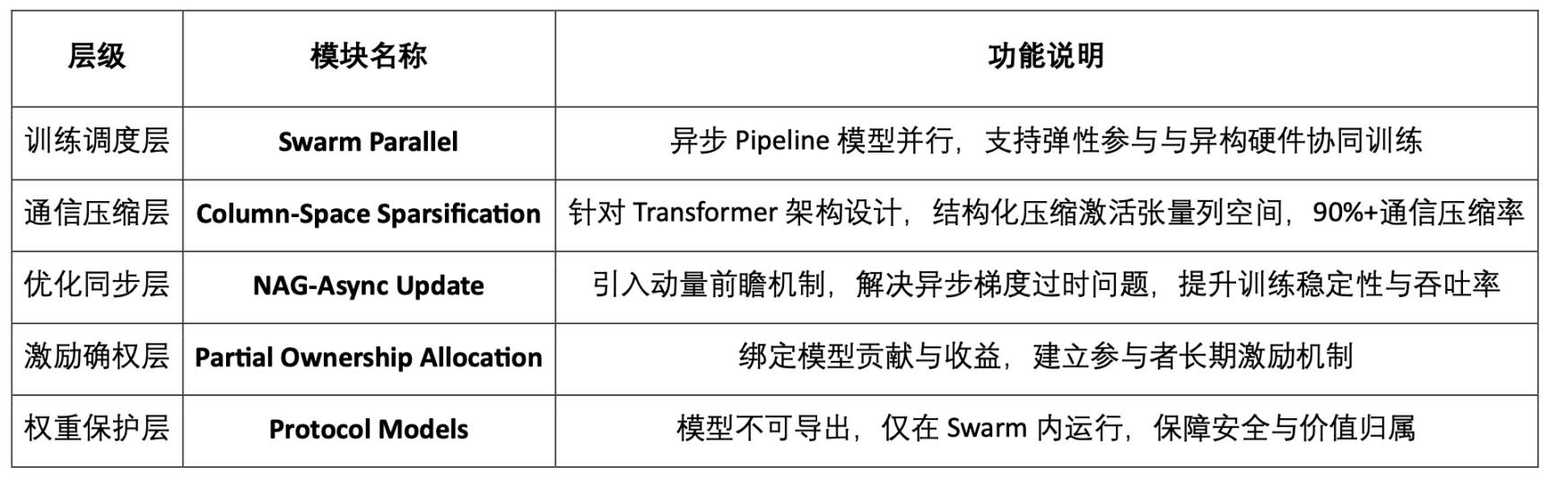

2. Pluralis 프로토콜 스택의 기술 아키텍처

3. 핵심 기술 메커니즘 상세 분석

Unmaterializable Models

『A Third Path: Protocol Learning』에서 처음으로 체계적으로 제안되었으며, 모델 가중치가 조각 형태로 분포되어 '모델 자산'이 SWARM 네트워크 내에서만 실행되도록 하여 접근과 수익이 프로토콜에 의해 제어되도록 보장합니다. 이 메커니즘은 탈중앙화 훈련의 지속 가능한 인센티브 구조를 실현하는 전제입니다.

Asynchronous Model-Parallel Training

『SWARM Parallel with Asynchronous Updates』에서 Pluralis는 파이프라인 기반 비동기 모델 병렬 아키텍처를 구축하고, LLaMA-3에서 실증을 수행했습니다. 핵심 혁신은 Nesterov Accelerated Gradient(NAG) 메커니즘을 도입하여 비동기 업데이트 과정에서의 그래디언트 드리프트 및 수렴 불안정 문제를 효과적으로 수정함으로써, 이질적 장비 간 훈련이 낮은 대역폭 환경에서도 실현 가능하도록 했다는 점입니다.

Column-Space Sparsification

『Beyond Top-K』에서 제안된 것으로, 전통적인 Top-K 대신 구조 인식 열 공간 압축 방법을 사용하여 의미 경로를 파괴하지 않도록 합니다. 이 메커니즘은 모델 정확도와 통신 효율을 동시에 고려하며, 비동기 모델 병렬 환경에서 통신 데이터의 90% 이상을 압축할 수 있어 구조 인식 고효율 통신을 실현하는 핵심 돌파구입니다.

4. 기술 포지셔닝 및 경로 선택

Pluralis는 '비동기 모델 병렬'을 핵심 방향으로 명확히 하며, 데이터 병렬에 비해 다음 이점을 강조합니다:

-

저대역폭 네트워크 및 비동기 노드 지원

-

장비 이질성에 적합하며 소비자용 GPU의 참여를 허용

-

천연 탄력적 스케줄링 능력을 갖추고 있어 노드의 빈번한 접속/접속 해제를 지원

-

구조 압축 + 비동기 업데이트 + 가중치 추출 불가능성 세 가지 돌파구

현재 공식 웹사이트에서 공개된 6편의 기술 블로그 문서를 기반으로 논리 구조를 다음 세 가지 주선으로 통합할 수 있습니다:

-

철학 및 비전: 『A Third Path: Protocol Learning』, 『Why Decentralized Training Matters』

-

기술 메커니즘 세부사항: 『SWARM Parallel』, 『Beyond Top-K』, 『Asynchronous Updates』

-

제도적 혁신 탐색: 『Unmaterializable Models』, 『Partial Ownership Protocols』

현재 Pluralis는 제품, 테스트넷, 코드 오픈소스화를 아직 시작하지 않았습니다. 이는 선택한 기술 경로가 매우 도전적이기 때문입니다. 먼저 저수준 시스템 아키텍처, 통신 프로토콜, 가중치 추출 불가능성 등의 시스템 수준 문제를 해결해야 상위 레벨의 제품 서비스를 패키징할 수 있기 때문입니다.

2025년 6월 Pluralis Research가 발표한 새로운 논문에서, 탈중앙화 훈련 프레임워크를 모델 사전 훈련에서 미세 조정 단계로 확장하여 비동기 업데이트, 희소 통신, 부분 가중치 집계를 지원합니다. 이전의 이론 중심 및 사전 훈련 중심 설계와 비교해 이번 작업은 실현 가능성에 더 집중하며, 훈련 전체 주기 아키텍처의 성숙도를 더욱 높였음을 의미합니다.

5. 팀 및 투자 배경

Pluralis는 2025년에 760만 달러 규모의 시드 펀딩을 완료했으며, Union Square Ventures(USV)와 CoinFund가 공동 리드 투자했습니다. 창립자 Alexander Long은 머신러닝 박사 출신으로 수학 및 시스템 연구 배경을 모두 갖추고 있습니다. 핵심 멤버들은 전원 박사 학위를 소지한 머신러닝 연구자들로 구성되어 있으며, 밀도 높은 논문과 기술 블로그를 주요 발표 경로로 하는 기술 중심형 프로젝트입니다. 현재 BD/Growth 팀을 구성하지 않고 저대역폭 비동기 모델 병렬 기반 인프라 문제 해결에 집중하고 있습니다.

Gensyn: 검증 가능한 실행을 중심으로 하는 탈중앙화 훈련 프로토콜 레이어

Gensyn은 '딥러닝 훈련 작업의 신뢰 가능한 실행'에 집중하는 Web3 AI 프로젝트로, 핵심은 모델 아키텍처나 훈련 패러다임을 재구성하는 것이 아니라, '작업 분배 + 훈련 실행 + 결과 검증 + 공정한 인센티브' 전 과정을 갖춘 검증 가능한 분산 훈련 실행 네트워크를 구축하는 것입니다. 오프체인 훈련 + 온체인 검증 아키텍처 설계를 통해 Gensyn은 효율적이고 개방적이며 인센티브 기반의 글로벌 훈련 시장을 구축하여 '훈련 즉 채굴(mining)'을 현실로 만듭니다.

1. 프로젝트 포지셔닝: 훈련 작업의 실행 프로토콜 레이어

Gensyn은 '어떻게 훈련할 것인가'가 아니라 '누가 훈련할 것인지, 어떻게 검증할 것인지, 어떻게 수익을 분배할 것인지'에 대한 인프라입니다. 본질적으로 훈련 작업의 검증 가능 컴퓨팅 프로토콜로서 주로 다음을 해결합니다:

-

누가 훈련 작업을 수행할 것인가(컴퓨팅 파워 분배 및 동적 매칭)

-

실행 결과를 어떻게 검증할 것인가(전체 재계산 없이 분쟁 연산자만 검증)

-

훈련 수익을 어떻게 분배할 것인가(Stake, Slashing 및 다중 역할 게임 메커니즘)

2. 기술 아키텍처 개요

3. 모듈 상세 분석

RL Swarm: 협업 강화 학습 훈련 시스템

Gensyn이 최초로 제안한 RL Swarm은 후처리 단계를 위한 탈중앙화 다중 모델 협업 최적화 시스템으로, 다음과 같은 핵심 특성을 갖춥니다:

분산 추론 및 학습 프로세스:

-

생성 단계(Answering): 각 노드가 독립적으로 답변 출력

-

비판 단계(Critique): 노드들이 서로의 출력을 평가하여 최적의 답변과 논리를 선정

-

합의 단계(Resolving): 대부분의 노드 선호도를 예측하고 이를 기반으로 자신의 답변을 수정하여 국소 가중치 업데이트를 실현

Gensyn이 제안한 RL Swarm은 탈중앙화된 다중 모델 협업 최적화 시스템으로, 각 노드는 독립 모델을 실행하고 로컬 훈련을 수행하며 그래디언트 동기화가 필요하지 않아 이질적 컴퓨팅 파워와 불안정한 네트워크 환경에 자연스럽게 적합하며, 탄력적인 노드 접속/접속 해제도 지원합니다. 이 메커니즘은 RLHF 및 다중 에이전트 게임 아이디어를 참고하지만, 협업 추론 네트워크의 동적 진화 논리에 더 부합합니다. 노드는 집단 합의 결과와의 일치 정도에 따라 보상을 받으며, 이는 추론 능력의 지속적 최적화와 수렴 학습을 촉진합니다. RL Swarm은 오픈 네트워크에서의 모델 안정성과 일반화 능력을 크게 향상시키며, Gensyn의 Ethereum Rollup 기반 Testnet Phase 0에 핵심 실행 모듈로 이미 배포되었습니다.

Verde + Proof-of-Learning: 신뢰 가능한 검증 메커니즘

Gensyn의 Verde 모듈은 세 가지 메커니즘을 결합합니다:

-

Proof-of-Learning: 그래디언트 궤적 및 훈련 메타데이터를 기반으로 훈련이 실제로 발생했는지 판단

-

Graph-Based Pinpoint: 훈련 계산 그래프에서 분歧 노드를 식별하고 특정 연산만 재계산

-

Refereed Delegation: 중재 기반 검증 메커니즘을 채택하여 검증자(verifier)와 도전자(challenger)가 분쟁을 제기하고 부분 검증을 수행하여 검증 비용을 크게 낮춤

ZKP 또는 전체 재계산 검증 방안과 비교해 Verde 방안은 검증 가능성과 효율성 사이에서 더 우수한 균형을 이룹니다.

SkipPipe: 통신 오류 허용 최적화 메커니즘

SkipPipe는 '저대역폭 + 노드 연결 끊김' 시나리오에서의 통신 병목 문제를 해결하기 위해 개발되었습니다. 핵심 기능은 다음과 같습니다:

-

스킵 레이어 메커니즘(Skip Ratio): 제한된 노드를 건너뛰어 훈련 차단 방지

-

동적 스케줄링 알고리즘: 실시간으로 최적의 실행 경로 생성

-

오류 허용 실행: 노드의 50%가 실패하더라도 추론 정확도는 약 7%만 하락

훈련 처리량을 최대 55%까지 향상시키며, 'early-exit 추론', '무중단 재정렬', '추론 보완' 등의 핵심 기능을 실현합니다.

HDEE: 다중 분야 이질적 전문가 클러스터

HDEE(Heterogeneous Domain-Expert Ensembles) 모듈은 다음과 같은 시나리오 최적화를 목표로 합니다:

-

다양한 분야, 다중 모달, 다중 작업 훈련

-

다양한 훈련 데이터 분포 불균형, 난이도 차이 큼

-

장비 계산 능력 이질성, 통신 대역폭 불일치 환경에서의 작업 분배 및 스케줄링 문제

핵심 특성:

-

MHe-IHo: 난이도가 다른 작업에 다른 크기의 모델 할당(모델 이질성, 훈련 스텝 일치)

-

MHo-IHe: 작업 난이도 통일, 훈련 스텝 비동기 조정

-

이질적 전문가 모델 + 플러그인 가능 훈련 전략 지원, 적응성 및 오류 허용성 향상

-

'병렬 협업 + 매우 낮은 통신 + 동적 전문가 할당' 강조, 현실의 복잡한 작업 생태계에 적합

다중 역할 게임 메커니즘: 신뢰와 인센티브 병행

Gensyn 네트워크는 네 가지 참가자를 도입합니다:

-

Submitter: 훈련 작업 게시, 구조 및 예산 설정

-

Solver: 훈련 작업 실행, 결과 제출

-

Verifier: 훈련 행동 검증, 규정 준수 및 효율성 보장

-

Whistleblower: 검증자에 도전, 중재 보상 획득 또는 몰수 부담

이 메커니즘은 Truebit의 경제 게임 설계에서 영감을 얻었으며, 강제 오류 삽입 + 무작위 중재를 통해 참가자의 정직한 협업을 유도하여 네트워크의 신뢰 가능한 실행을 보장합니다.

4. 테스트넷 및 로드맵 계획

5. 팀 및 투자 배경

Gensyn은 Ben Fielding과 Harry Grieve가 공동 창립했으며, 본사는 영국 런던에 위치합니다. 2023년 5월, Gensyn은 a16z crypto가 리드 투자한 4,300만 달러 규모의 A 라운드 펀딩을 완료했으며, 기타 투자자로는 CoinFund, Canonical, Ethereal Ventures, Factor, Eden Block 등이 있습니다. 팀은 분산 시스템과 머신러닝 엔지니어링 경험을 결합하여 검증 가능하고 신뢰 불필요한 대규모 AI 훈련 실행 네트워크 구축에 오랫동안 집중해 왔습니다.

Nous Research: 주체성 AI 개념이 이끄는 인지 진화형 훈련 시스템

Nous Research는 현재 철학적 높이와 엔지니어링 실현을 동시에 갖춘 소수의 탈중앙화 훈련 팀 중 하나로, 핵심 비전은 'Desideratic AI' 개념에서 비롯됩니다. AI를 단순한 제어 가능한 도구가 아니라 주관성과 진화 능력을 갖춘 지능형 주체로 보는 것입니다. Nous Research의 독특함은 AI 훈련을 '효율 문제'로 최적화하는 것이 아니라 '인지 주체'의 형성 과정으로 간주한다는 점입니다. 이러한 비전 아래 Nous는 이질적 노드들이 협력하여 중앙 조정 없이 검열 저항성 검증이 가능한 개방형 훈련 네트워크를 구축하고, 전 스택 도구 체계를 통해 체계적으로 실현합니다.

1. 개념적 기반: 훈련의 '목

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News