GPT と Claude を手をつながせるのは、米国防総省(ペンタゴン)への共同反対?

TechFlow厳選深潮セレクト

GPT と Claude を手をつながせるのは、米国防総省(ペンタゴン)への共同反対?

今回、2人は手をつないだが、おそらく数時間ほどしか続かなかった。

著者:クリー、TechFlow

先日、インターネット上で話題となった写真があります。

インドで開催されたAIサミットの様子です。モディ首相が壇上に立ち、その両側にはシリコンバレーの大物経営者が一列に並んでいました。記念撮影の際、モディ氏は隣に立つ人物の手を取って頭上へと掲げ、他の参加者もそれに倣って手を取り合い、非常に団結した雰囲気を醸し出していました。

しかし、ただ二人だけが手をつなぎませんでした。

OpenAIのCEOとAnthropicのCEO——つまりChatGPTとClaudeを支える二社のトップ——が互いに隣同士に立ち、それぞれ拳を握り上げていました。

手をつながず、目を合わせず、まるで先生に無理やり隣同士に座らされた仲違いの生徒のようです。

この二社はここ数年、激しく競争してきました。Claudeは元OpenAIチームが独立して設立したAnthropicによって開発されたものであり、ユーザー獲得、企業顧客獲得、資金調達の争奪戦を繰り広げています。今年のスーパーボウル期間中には、AnthropicがわざわざCMを購入し、ChatGPTが今後広告を表示するようになることを皮肉る宣伝を行ったほどです。

だから、手をつながないのは当然です。

ところが、今日彼らは手をつなぎました。その理由は、米国防総省(ペンタゴン)です。

事情はこうです。

Anthropic——すなわちClaudeを開発する企業——は昨年、米国防総省と最大2億ドル規模の契約を結びました。Claudeは、米軍の機密ネットワークに配備された初のAIモデルであり、諜報分析や任務計画などの業務を支援しています。

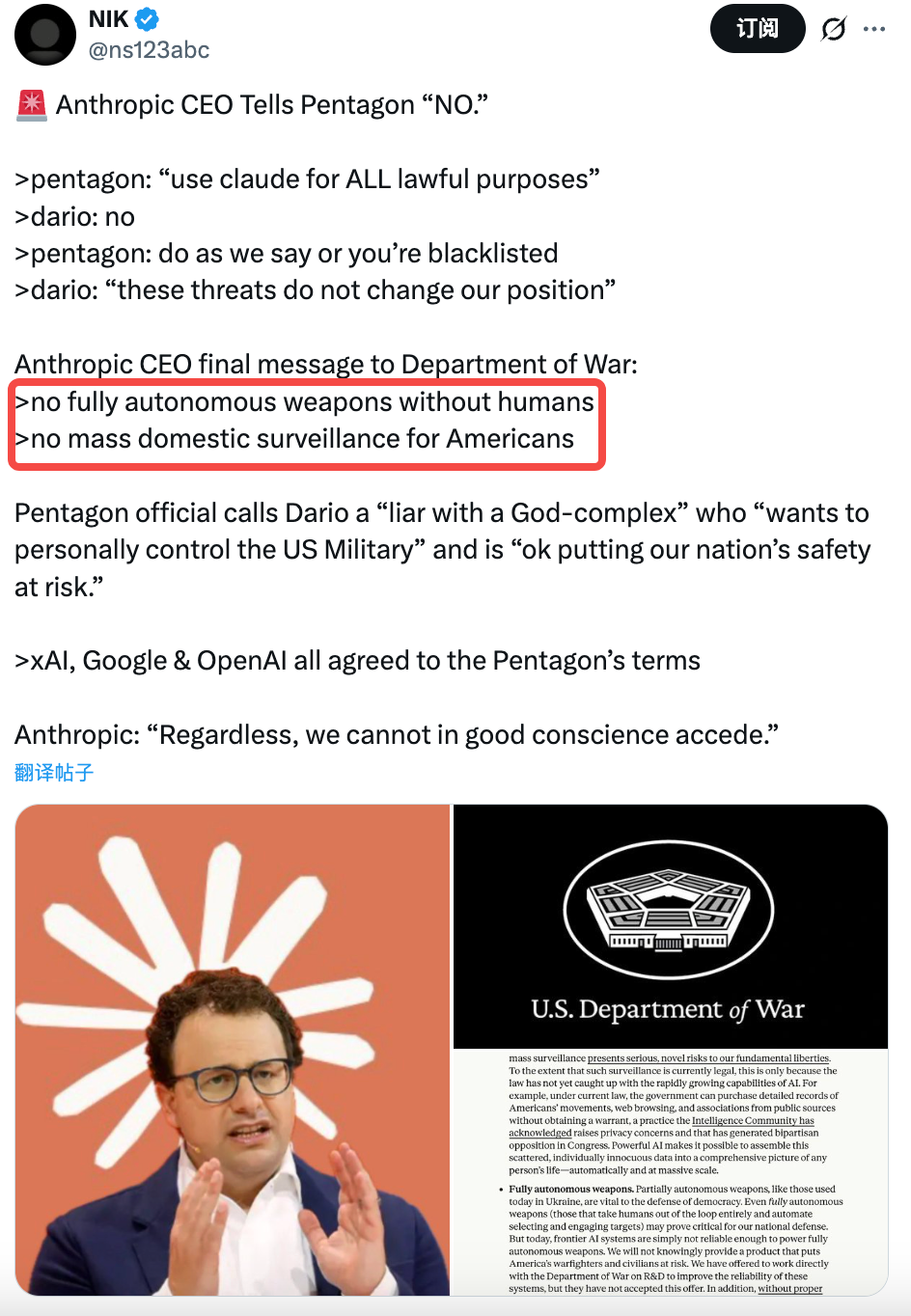

ただしAnthropicは、契約書内で二つの「レッドライン」(絶対に守るべき線)を明記しました:

Claudeは米国市民に対する大規模監視にも、人間の関与なしに自律的に作動する殺傷兵器にも使用してはならない。(参考記事:Anthropicのアイデンティティ・クライシス:72時間)

しかし、ペンタゴンはこれを認めませんでした。

彼らの要求はたった四文字——「制限なし」。ツールを購入した以上、自由に使えるのが当然であり、民間テック企業が米軍に対し「これをしてよい」「これはしてはならない」と指示を出す権利などない、という主張です。

先週火曜日、ヘグセット国防長官がAnthropicのCEOに対し、金曜日午後5時01分までに合意しない場合の「最終通告」を直接下しました。

Anthropicは合意しませんでした。

同社CEOは公開声明を発表し、その趣旨は以下の通りです。「私たちは、AIが米国国防にとって極めて重要であることを十分に認識しています。しかしごく一部のケースでは、AIが民主的価値を守るどころか、むしろそれを損なう可能性があることも理解しています。この要求を良心に従って受け入れることはできません。」

その後、ペンタゴンの交渉担当者であり国防副長官でもあるエミル・マイケル氏がソーシャルメディア上で、彼を「詐欺師」と罵り、「神の情念」に取りつかれ、国家の安全保障を軽んじていると非難しました。

一時的な手のつなぎ

すると、予期せぬ出来事が起こりました。

OpenAIとGoogleの社員、延べ400人以上が連名で公開書簡を提出しました。そのタイトルは「我々は分断されない」。

この書簡には、ペンタゴンがAI企業を一つひとつ個別に交渉し、Anthropicが拒否した条件を他社にも押し付けようとしており、恐怖によって各社を分断しようとしていると記されています。

またOpenAIのCEOも全社員向けに内部メールを送付し、Anthropicと同様のレッドラインを自社も堅持すると明言しました。

すなわち、大規模監視も、自律型殺傷兵器も行わないというものです。

つい数日前まで手をつなごうともしなかった二社が、突如としてペンタゴンを相手に同じ陣営に立ったのです。

とはいえ、この団結はおそらく数時間しか続かなかったでしょう。

金曜日午後5時01分、ペンタゴンの最終通告の期限が到来しました。Anthropicは署名しませんでした。

評価額3800億ドルの米国テック企業が、2億ドル規模の契約失効というリスクを負いながら、米国防総省の要請を拒否したのです。過去であれば、このような事態は単なる契約解除・サプライヤー変更で済んでいたかもしれません。しかし今回は、ワシントンの反応はもはやビジネスレベルではありませんでした。

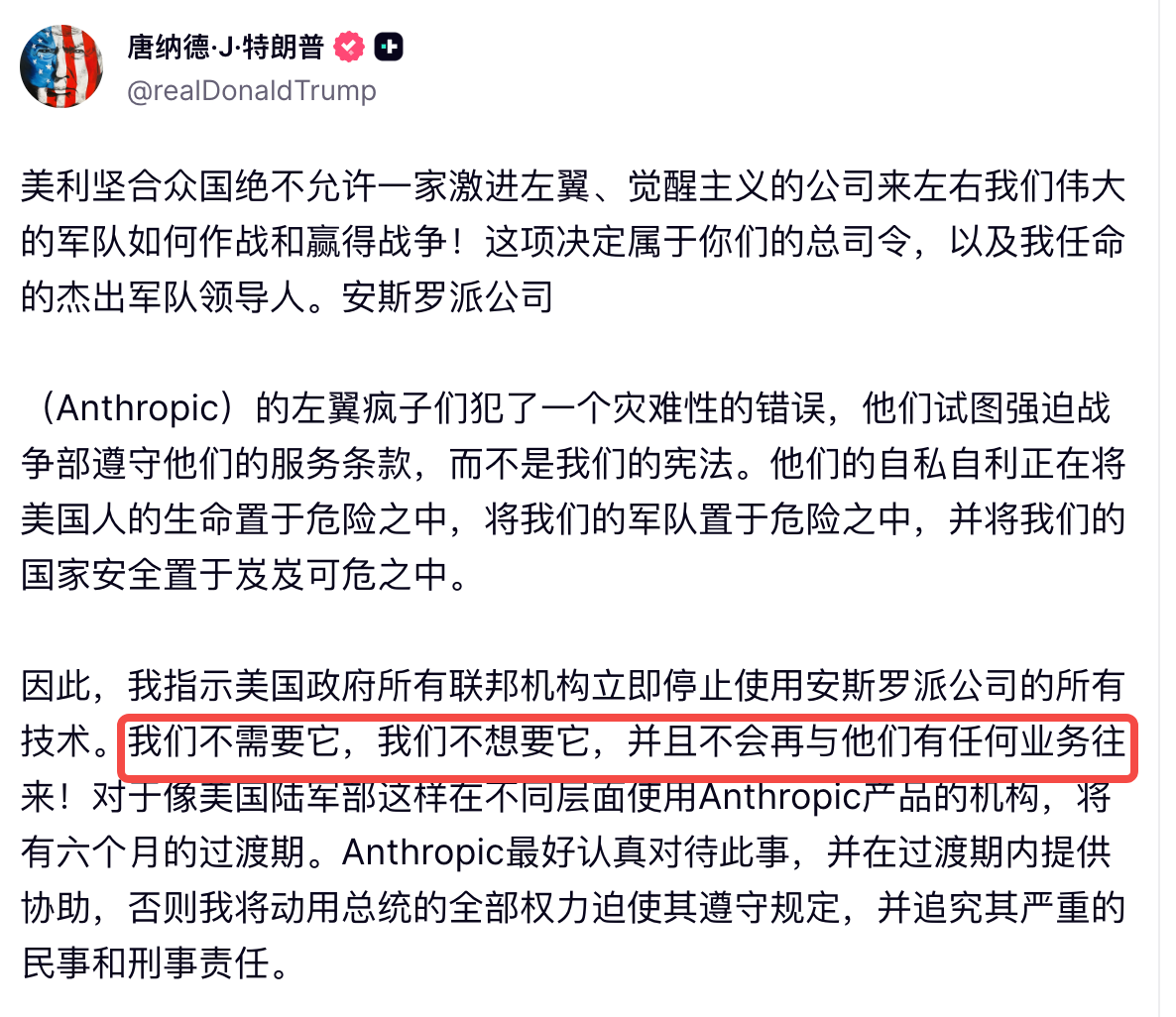

トランプ氏は、その約1時間後にTruth Social上で投稿し、Anthropicを「左翼の狂信者」と呼び、「憲法を凌駕しようとしている」「米軍兵士の命を弄んでいる」と批判しました。

さらに、連邦政府機関すべてに対し、Anthropicの技術の即時使用停止を命じました。

直後、ヘグセット国防長官はAnthropicを「サプライチェーン上の安全保障リスク」として指定しました。このラベルは通常、ファーウェイのような企業に与えられるものです。つまり、米軍と取引するすべての請負業者は、今後Anthropicの製品を一切使用してはならないということを意味します。

Anthropicは訴訟を起こすと表明しました。

そして、同じ夜のうちに、先ほどまで同一の立場を取っていたOpenAIが、ペンタゴンと契約を締結しました。

イデオロギー問題

OpenAIは、いったい何を得たのでしょうか?

Claudeが排除された後に空いたポジション——米軍機密ネットワークにおけるAIサプライヤーの地位です。ただしOpenAIは、ペンタゴンに対し三つの条件を提示しました。「大規模監視を行わない」「自律型殺傷兵器を開発・提供しない」「高リスクな意思決定には必ず人間の関与が必要」というものです。

ペンタゴンは、「了承」と答えました。

お読み間違いではありません。Anthropicが数週間にわたって粘り強く求めても認められなかった条件が、別の企業から提示された途端、わずか数日で合意に至ったのです。

もちろん、両者の提案内容は完全に同一ではありません。

Anthropicはさらに一歩踏み込んで、現行法がAIの能力に追いついていない点を指摘しました。たとえば、AIがユーザーの位置情報、閲覧履歴、SNSデータなどをすべて合法的に購入・集約し、結果として実質的な監視と同等の効果を生み出すことは可能ですが、その過程のどの一連の行為も法的には違法ではない、という問題です。

Anthropicは、「監視を行わない」という四文字の条項だけでは不十分であり、この抜け穴を塞ぐ必要があると主張しました。一方、OpenAIはこの点を強く主張せず、現行法で十分であるというペンタゴンの見解を受け入れました。

しかし、これが単なる条項の違いだと考えるのはあまりにも短慮です。この交渉は最初から、単なる条項の折衝ではなかったのです。

ホワイトハウスのAI担当最高責任者(AI・ツァール)であるデイビッド・サックス氏は、以前からAnthropicが「ウオーカーAI」(イデオロギー優先・政治的正しさ志向)を推進していると公然と批判しています。またペンタゴンの高官がメディアに対し、「ダリオ(Anthropic CEO)の問題はイデオロギーに根差したものだ」「我々は、誰と交渉しているのかをよく知っている」と語ったとの報道もあります。

イーロン・マスク氏が創設したxAIは、Anthropicの直接の競合企業ですが、マスク氏は今週X(旧Twitter)上で繰り返しAnthropicを攻撃し、「西洋文明を憎んでいる」と非難しました。

さらに、AnthropicのCEOは昨年のトランプ氏の就任式に出席していません。一方、OpenAIのCEOは出席しました。

示しのための処罰

では、一体何が起きたのか整理しましょう。

同じ原則、同じレッドラインを掲げていたにもかかわらず、Anthropicは「さらに一層の保証を求めたこと」「誤った陣営を選んだこと」「誤った姿勢を示したこと」により、ファーウェイと同格の「米国国家安全保障上の脅威」として標的にされました。

一方OpenAIは、一層の保証を求めるのをやめ、関係構築をうまくこなしたことで、契約を勝ち取りました。これは、原則の勝利でしょうか、それとも原則の「価格付け」でしょうか?

ペンタゴンとの契約拒否は、今回が初めてではありません。

2018年、Googleの社員4000人以上が請願書に署名し、十数人が辞職して抗議しました。その対象は、ペンタゴンのプロジェクト「メイブン」——AIを用いてドローン映像を解析し、軍が目標をより迅速に識別できるように支援するプロジェクト——への関与でした。

Googleは最終的に撤退し、契約更新を拒否しました。社員の勝利でした。

それから8年、同じ論争が再燃しましたが、今回はルールがまったく変わっています。ある米国企業が、「軍事契約は引き受けるが、以下の二点は絶対に行わない」と宣言したところ、米国政府の回答は、その企業を連邦政府全体のシステムから除外することでした。

そして、「サプライチェーン上の安全保障リスク」というラベルの破壊力は、単に2億ドルの契約を失うことにとどまりません。

Anthropicの今年の収益は約140億ドルと見込まれており、2億ドルの契約はそのわずか1%にも満たない額です。しかし、このラベルの意味するところは、米軍と取引のあるあらゆる企業が、Claudeを使用してはならないということです。

これらの企業は、ペンタゴンの立場に賛同する必要はありません。必要なのは単純なリスク評価のみです。「Claudeを使い続けたら、政府からの契約を失うかもしれない。別のモデルに切り替えれば、何事も起きない」という判断です。

選択は極めて容易です。それが、この出来事の真のメッセージなのです。

Anthropicが耐え抜けるかどうかは本質ではありません。重要なのは、次に来る企業が、果たして同じような抵抗を敢えて行えるかどうかです。その企業は今回の結果を見、原則を貫くコストを検討し、非常に合理的な判断を下すことでしょう。

改めて、あのインドの写真を振り返ってみてください。全員が手を取り合い、頭上へと掲げています。ただ二人だけが、それぞれ拳を握りしめています。

もしかすると、それがむしろ「日常」なのかもしれません。

AI企業の原則は同じでも、手をつなげるとは限りません。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News