Alliance DAO:AIとWeb3の融合には、どのような機会と課題があるのか?

TechFlow厳選深潮セレクト

Alliance DAO:AIとWeb3の融合には、どのような機会と課題があるのか?

人工知能の発展軌道に顕著な影響を与える技術はめったにないが、Web3はその一つである。

執筆:Mohamed Fouda、Qiao Wang

*本記事はAlliance DAOより深潮 TechFlowに独占的に翻訳・掲載許可されています。

ChatGPTおよびGPT-4の登場以降、AIがWeb3を含むあらゆる分野をどのように変革するかについて多くの議論がなされてきました。多くの業界の開発者は、ChatGPTを活用して、テンプレートコードの生成、ユニットテスト、ドキュメント作成、デバッグ、脆弱性検出などの業務を自動化しています。本稿ではAIによって実現される新たな興味深いWeb3ユースケースについても考察しますが、特に注目するのはWeb3とAIの相互補完的な関係です。技術の中でもWeb3ほどAIの発展軌道に顕著な影響を与えるものは他にほとんどありません。

Web3がAIにどう貢献できるか?

可能性は大きいものの、現在のAIモデルにはデータのプライバシー、独自モデル実行の公平性、信頼できるフェイクコンテンツの作成と拡散といった課題が多数存在しています。既存のWeb3.0技術は、こうした課題に対処する上で独特の優位性を持っています。

機械学習トレーニング用の独自データセット

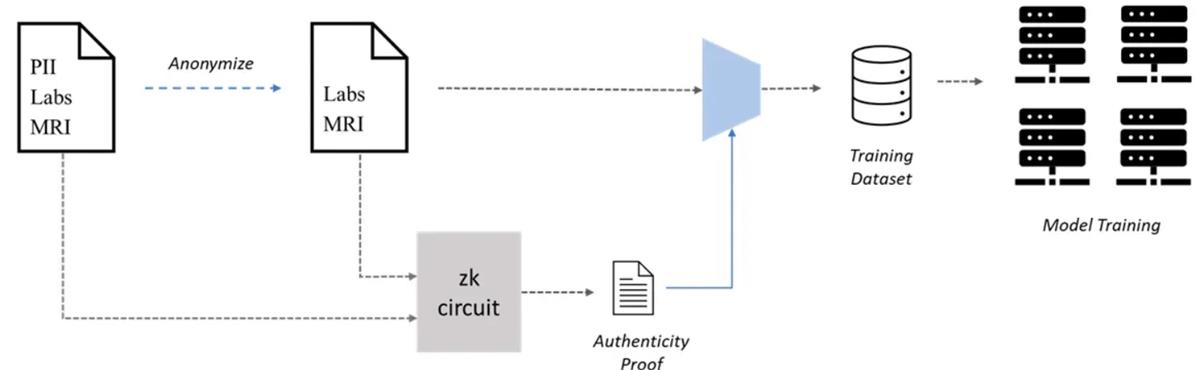

Web3がAIに貢献できる分野の一つが、機械学習(ML)用データセットの共同作成、すなわちPoPWネットワークによるデータセット構築です。正確なMLモデルには膨大なデータセットが必要ですが、その作成はボトルネックとなることがあります。特に医療MLアプリケーションのように、個人データを使用した診断が必要な場合、患者のデータプライバシーの問題が大きな障壁となります。患者の医療記録へのアクセスはモデル訓練に不可欠ですが、プライバシー上の懸念から患者が自身の記録を共有することに抵抗を示すことも多いのです。この問題を解決するために、患者は自身の医療記録を検証可能な方法で匿名化し、プライバシーを保護しつつML訓練に利用できるようにすることが可能です。

しかし、匿名化された医療記録の真正性も問題になります。偽造データがモデルの性能に悪影響を及ぼす可能性があるためです。このジレンマを解決するために、ゼロ知識証明(ZKP)を使って匿名化された医療記録の真正性を検証できます。患者は、個人識別情報(PII)が削除されていても、匿名化された記録が元の記録の正確なコピーであることを証明するZKPを生成できます。これにより、患者は匿名化された記録とZKPを関係者に提出して報酬を得ることができ、プライバシーを犠牲にすることなく済みます。

プライベートデータに対する推論実行

現在のLLMの主な弱点の一つは、プライベートデータを扱う能力です。たとえば、ユーザーがChatGPTとやり取りすると、OpenAIはそのデータを収集し、モデルの訓練強化に使用します。これは敏感な情報の漏洩につながる可能性があり、実際にサムスン社で同様の事例がありました。ゼロ知識(zk)技術は、MLモデルがプライベートデータに対して推論を行う際に生じる問題のいくつかを解決するのに役立ちます。ここでは、オープンソースモデルとプロプライエタリーモデルという二つのケースを想定します。

-

オープンソースモデルの場合、ユーザーはモデルをダウンロードし、自身のプライベートデータをローカルで処理できます。一例として、WorldcoinがWorld IDのアップグレードを計画していることが挙げられます。Worldcoinは、ユーザーの虹彩スキャンといったバイオメトリクスデータを処理し、各ユーザーに固有の識別子「IrisCode」を作成する必要があります。この場合、ユーザーはバイオメトリクスデータを端末内に保持したまま、IrisCode生成用のMLモデルをダウンロードしてローカルで推論を実行し、ZKPを生成することでIrisCodeの作成に成功したことを証明できます。この証明は推論の正当性を保証しつつ、データのプライバシーも守ります。このユースケースにおいては、Modulus Labsが開発しているような、効率的なMLモデル用zk証明機構が極めて重要です。

-

もう一つのケースが、プロプライエタリーモデルです。ZKPにはこの問題を解決する二つのアプローチがあります。 最初の方法は、前述のデータセット作成時と同様に、ユーザーのデータをZKPを使って匿名化し、その後MLモデルに送信するというものです。 二つ目の方法は、前処理された出力をMLモデルに送信する前に、プライベートデータをローカルで前処理するというものです。 この場合、前処理ステップによりユーザーのプライベートデータは再構築不能な形で隠蔽されます。ユーザーは前処理ステップが正しく実行されたことを証明するZKPを生成し、その後モデル所有者のサーバー上で残りの専有モデル部分をリモート実行できます。この応用例には、患者の医療記録を分析して潜在的診断を行うAI医師や、顧客のプライベートな財務情報を評価する金融リスク評価アルゴリズムなどが含まれます。

コンテンツの真正性とディープフェイク対策

ChatGPTは、画像・音声・動画生成に特化した生成AIモデルの注目を集める中でスポットライトを浴びてきました。しかし、これらのモデルは現在すでにリアルなディープフェイクコンテンツを生成できるまでになっています。最近AIによって生成されたDrakeの楽曲が良い例です。このようなディープフェイク技術は重大な脅威であり、数多くのスタートアップ企業がWeb 2技術を使ってこれを解決しようとしていますが、コンテンツ認証にはWeb3技術(例えばデジタル署名)の方が適しています。

Web3では、ユーザーのインタラクション(=トランザクション)はユーザーの秘密鍵で署名され、その正当性が証明されます。同様に、テキスト、画像、音声、動画などのコンテンツも作成者の秘密鍵で署名され、真正性を証明できます。誰でも作成者の公開アドレスを使って署名を検証でき、そのアドレスは作成者のウェブサイトやSNSアカウントに提示されます。Web3ネットワークはすでにこの用途に必要なインフラを整備しています。Fred Wilsonは、コンテンツを公開鍵に関連付けることで誤情報対策が可能になると指摘しています。多くの著名なVCは、既存のSNSプロフィール(Twitterなど)や分散型SNSプラットフォーム(Lens ProtocolやMirrorなど)を暗号通貨の公開アドレスと結びつけており、デジタル署名によるコンテンツ認証の信頼性を高めています。

この概念は単純ですが、認証プロセスのユーザーエクスペリエンスを改善するには多くの作業が必要です。たとえば、コンテンツ作成時にデジタル署名を自動生成する仕組みを導入し、クリエイターにとってシームレスなプロセスにする必要があります。また、再署名せずに音声や動画の一部(クリップ)だけを抽出して利用する方法も課題です。多くの既存Web3技術がこうした問題に独自に対応しています。

プロプライエタリーモデルにおける最小限の信頼

Web3がAIに貢献できるもう一つの分野は、独自のMLモデルをサービスとして提供する際の信頼度の最小化です。ユーザーは、自分が支払った金額に見合うサービスを受け取ったかどうかを検証したり、MLモデルが公平に実行されたことを保証したいと考えます。つまり、すべてのユーザーが同じモデルを使用していることを確認したいのです。このような保証はZKPを使って提供できます。このアーキテクチャでは、MLモデル作成者がMLモデルを表すzk回路を生成します。必要に応じて、この回路を使ってユーザーの推論に対してZKPを生成します。ZKPはユーザーに送信され検証されるか、あるいはユーザーの検証を処理するパブリックチェーン上に公開されます。もしMLモデルが非公開であれば、独立した第三者が使用されているzk回路が本当にそのモデルを表しているかを検証できます。MLモデルの実行結果が重大な影響を及ぼす場合には、信頼の最小化が特に有用です。具体例としては以下のようなものがあります:

1. MLによる医療診断

このユースケースでは、患者が自身の医療データをMLモデルに提出して潜在的診断を受けます。患者は、自分のデータに対して正しいMLモデルが適用されたことを保証したいと考えます。推論プロセスでは、MLモデルが正しく実行されたことを証明するZKPが生成されます。

2. 融資信用評価

ZKPは、銀行や金融機関が信用評価時に申請者が提出したすべての財務情報を考慮していることを保証できます。さらに、全ユーザーが同じモデルを使用していることを証明することで、公平性を示すことができます。

3. 保険請求処理

現在の保険請求処理は手動かつ主観的です。MLモデルを使えば、保険契約や請求内容をより公正に評価できます。ZKPと組み合わせることで、これらの請求処理用MLモデルがすべての契約・請求詳細を考慮していること、そして同一契約下のすべての請求に対して同じモデルが使用されていることが保証できます。

モデル作成の集中化問題の解決

LLM(大規模言語モデル)の作成と訓練は、特定分野の専門知識、専用の計算インフラ、数百万ドルの計算コストを要する長く高価なプロセスです。そのため、OpenAIのような強力な中央集権的組織が生まれやすく、モデルへのアクセスを制限することで莫大な権力を得る可能性があります。

こうした集中化のリスクを踏まえると、Web3がいかにLLM作成の非中央集権化を促進できるかが研究の焦点となっています。一部のWeb3支持者は、中央集権的主体と競合する分散型コンピューティングの手法を提唱しています。核心は、分散コンピューティングがより安価な代替手段となり得るという点です。しかし、私たちの見解では、これは中央集権的主体と競争する最適なアプローチではないかもしれません。分散コンピューティングの欠点は、異なる異種コンピュータ間の通信オーバーヘッドにより、ML訓練が10〜100倍遅くなる可能性があることです。

その代わりに、Web3プロジェクトはPoPW方式で独自かつ競争力のあるMLモデルの作成に焦点を当てるべきです。こうしたPoPWネットワークは、モデル訓練用の一意なデータセットを収集することもできます。TogetherやBittensorなど、すでにこの方向に進んでいるプロジェクトもあります。

AIエージェントの支払いと実行フレームワーク

ここ数週間で、LLMを利用して特定目標達成に必要なタスクを推論し、それを実行するAIエージェントの台頭が見られました。AIエージェントの波はBabyAGIから始まり、AutoGPTなどの高度なバージョンへと急速に広がりました。ここで重要な予測は、AIエージェントが特定のタスクに特化していくことで、その分野でのパフォーマンスが向上するということです。専用のAIエージェント市場が存在すれば、AIエージェントは他のAIエージェントを検索・雇用・支払いして特定タスクを実行させ、メインプロジェクトを完遂できます。この過程において、Web3ネットワークはAIエージェントにとって理想的な環境を提供します。支払いに関しては、AIエージェントに暗号通貨ウォレットを装備させ、報酬の受取や他のAIエージェントへの支払いを行わせることができます。また、AIエージェントは無許可でリソースを委託できるように暗号ネットワークに接続できます。たとえば、データ保存が必要な場合、AIエージェントはFilecoinウォレットを作成し、IPFS上での分散型ストレージ料金を支払えます。また、Akashなどの分散型コンピューティングネットワークから計算リソースを委託して特定タスクを実行したり、自らの実行能力を拡張したりすることも可能です。

AIによるプライバシー侵害の防止

効率的なMLモデルの訓練には大量のデータが必要なため、公共データがモデルに取り込まれ、個人の行動予測に使われることは避けられません。さらに、銀行や金融機関はユーザーの財務情報をもとに独自のMLモデルを構築し、将来の財務行動を予測できるようになるでしょう。これはプライバシーの重大な侵害となります。この脅威を緩和する唯一の方法は、金融取引のプライバシーがデフォルトで保護されることです。Web3では、zCashやAztecといったプライバシーペイメントブロックチェーン、PenumbraやAleoといったプライベートDeFiプロトコルを利用することで、これを実現できます。

AIが可能にするWeb3ユースケース

オンチェーンゲーム

1. 非プログラミングゲーマー向けのロボット生成

Dark Forestのようなオンチェーンゲームは、プレイヤーがゲーム内で必要なタスクを実行するロボットを開発・展開することで優位を得られるという独自のパラダイムを生み出しました。しかし、このパラダイムはプログラミング能力のないゲーマーを排除してしまう可能性があります。ここでLLMが役に立ちます。LLMを微調整することで、オンチェーンゲームのロジックを理解させ、プレイヤーがコードを書くことなく自身の戦略を反映したロボットを作成できるようにできます。PrimodiumやAI Arenaといったプロジェクトは、自社のゲームに人間だけでなくAIプレイヤーも参加させるべく取り組んでいます。

2. ロボット戦闘、賭け、ギャンブル

オンチェーンゲームのもう一つの可能性は、完全自律型AIプレイヤーです。この場合、プレイヤーはAutoGPTのようなAIエージェントであり、LLMをバックエンドとして持ち、インターネットアクセスや初期の暗号資産資金といった外部リソースにアクセスできます。こうしたAIプレイヤーはロボットバトル形式で賭けを行うことができ、その結果への投機や賭けの市場が開かれます。

3. オンチェーンゲーム向けのリアルなNPCの創出

現在のゲームでは、非プレイヤーキャラクター(NPC)にあまり注目が集まっていません。NPCの行動は限定的で、ゲーム進行への影響も小さいのが一般的です。AIとWeb3の相乗効果を考えれば、予測不能な行動を取り、ゲームをより面白くする魅力的なAI制御NPCを作成できます。ただし、NPC活動に関連するTPS(トランザクション毎秒)を最小限に抑えながら、意味のあるNPCを導入する方法が課題となります。NPC活動のTPS要求が高すぎると、ネットワークの混雑や実際のプレイヤーの体験劣化を招く可能性があります。

分散型ソーシャルメディア

現在の分散型ソーシャルプラットフォームの課題の一つは、既存の中央集権型プラットフォームと比べて独自のユーザーエクスペリエンスを提供していないことです。AIとのシームレスな統合は、Web 2の代替手段に欠けている独自体験を提供できます。たとえば、AI管理アカウントは関連コンテンツの共有、投稿へのコメント、ディスカッション参加を通じて、新規ユーザーのネットワーク参加を促進できます。AIアカウントはニュースのアグリゲーションにも使え、ユーザーの興味に合致する最新トレンドを要約できます。

分散型プロトコルのセキュリティと経済設計のテスト

LLMベースのAIエージェントは、目的をカスタマイズし、コードを作成・実行できるため、分散型ネットワークのセキュリティと経済的実現可能性を実際にテストする機会を提供します。この場合、AIエージェントにプロトコルのセキュリティや経済バランスを調査するよう指示します。AIエージェントはプロトコル文書やスマートコントラクトを精査し、弱点を特定できます。その後、AIエージェントは自らの利益を最大化するために、プロトコルに対する攻撃メカニズムを独立して実行できます。この方法により、プロトコルがリリース後に直面する可能性のある実際の環境を模倣できます。これらのテスト結果に基づき、プロトコル設計者は設計を見直し、弱点を修正できます。これまで、Gauntletのような専門企業のみがこうした分散型プロトコルサービスに必要な技術スキルセットを持っていました。しかし、Solidity、DeFiメカニズム、過去の開発パターンを学習させたLLMであれば、同様の機能を提供できると期待しています。

データインデックスと指標抽出のためのLLM

ブロックチェーンデータは公開されていますが、そのデータをインデックス化し、有用なインサイトを抽出することは依然として困難な課題です。この分野の一部の企業(CoinMetricsなど)はデータインデックス化と複雑な指標の構築に注力し、それを販売しています。一方、Duneのような企業は、元のトランザクションの主要成分をインデックス化し、コミュニティの貢献によって指標作成をクラウドソーシングしています。最近のLLMの進展により、データインデックス化と指標抽出が大きく変革される兆しが明らかになってきました。Duneはすでにこの脅威を認識しており、SQLクエリの説明やNLPベースのクエリ可能性などを含むLLMロードマップを公表しています。しかし、我々はLLMの影響がさらに深くなると予測しています。ある可能性として、LLMが特定の指標用にデータをインデックス化し、直接ブロックチェーンノードとやり取りするという未来が考えられます。Dune Ninjaのようなスタートアップは、すでにデータインデックス化のための革新的なLLMアプリケーションを探求しています。

新エコシステムへの開発者誘導

異なるブロックチェーンは、開発者を自らのエコシステムに引き寄せるために競い合っています。Web3開発者の活性化は、特定エコシステムの成功を測る重要な指標の一つです。開発者にとっての主な課題の一つは、新しいエコシステムの学習や構築中に十分なサポートや指導が得られないことです。一部のエコシステムは、この課題に対処するために何百万ドルもの投資を行い、開発者支援(Dev Rel)専門チームを設立しています。この分野では、新興のLLMが複雑なコードの説明、エラーの検出、ドキュメント作成といった驚くべき成果を示しています。微調整されたLLMは人間の経験と相補的に作用し、Dev Relチームの作業効率を大幅に向上させます。たとえば、LLMはドキュメントやチュートリアルの作成、よくある質問への回答、ハッカソン中の開発者支援(テンプレートコードの提供やユニットテストの作成など)に活用できます。

DeFiプロトコルの改善

AIをDeFiプロトコルのロジックに統合することで、多くのDeFiプロトコルのパフォーマンスを大幅に向上させることができます。これまでDeFiにAIを統合する主なボトルネックは、オンチェーンでのAI実装コストが高すぎることでした。AIモデルはオフチェーンで実装できますが、それまでのところモデル実行を検証する手段がありませんでした。しかし、ModulusやChainMLのようなプロジェクトのおかげで、オフチェーン実行の検証が可能になりつつあります。これらのプロジェクトにより、オフチェーンでのMLモデル実行が可能になりながら、オンチェーンコストの拡大を抑えることができます。Modulusの場合、オンチェーン費用はモデルのZKP検証に限定されます。ChainMLの場合は、分散型AI実行ネットワークに支払うオラクル料金となります。

AI統合から恩恵を受ける可能性のあるDeFiユースケース:

-

AMM流動性供給(Uniswap V3の流動性範囲の更新など)。

-

オンチェーン・オフチェーンデータを用いた債務ポジションの清算保護。

-

複雑なDeFi構造化商品。 Vaultsのメカニズムが固定戦略ではなく金融AIモデルによって定義されるもの。戦略にはAIが管理する取引、貸し出し、オプションなどが含まれる。

-

複数チェーン、複数ウォレットにわたるオンチェーン信用スコアリングメカニズム。

結論

私たちは、文化的・技術的にWeb3とAIは互換性があると考えています。ロボットを嫌う傾向のあるWeb2とは対照的に、Web3は無許可のプログラマブル性のおかげでAIが繁栄できる環境を提供しています。

より広く言えば、ブロックチェーンをネットワークと捉えるなら、AIがネットワークのエッジ(訳者注:ネットワークへのインタラクションポイント)を支配すると予想されます。これは、ソーシャルメディアからゲームに至るさまざまな消費者アプリケーションに適用されます。

これまで、Web3ネットワークのエッジは主に人間でした。人間が取引を開始・署名したり、固定戦略を持つロボットを実行して代理行動を取ったりしていました。

時間の経過とともに、ネットワークのエッジにはますます多くのAIエージェントが現れるでしょう。AIエージェントはスマートコントラクトを通じて人間や他のAIエージェントと相互作用します。こうした相互作用が、新しい消費者体験を生み出すことになります。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News