TechFlow rapporte, le 8 mars, selon Forbes, que Caitlin Kalinowski, responsable de l’équipe matérielle et robotique d’OpenAI, a annoncé sa démission samedi sur la plateforme X, précisant que cette décision était « motivée par des principes ». Kalinowski souligne que l’intelligence artificielle revêt une importance stratégique dans le domaine de la sécurité nationale, mais ajoute que « la surveillance des citoyens américains sans contrôle judiciaire, ainsi que le recours à des actions autonomes mortelles sans autorisation humaine préalable, constituent des lignes rouges qui auraient dû faire l’objet d’un examen bien plus approfondi qu’elles ne l’ont été en pratique ». Selon elle, l’accord concerné a été rendu public « précipitamment, sans que des garde-fous sécuritaires clairs n’aient été définis ».

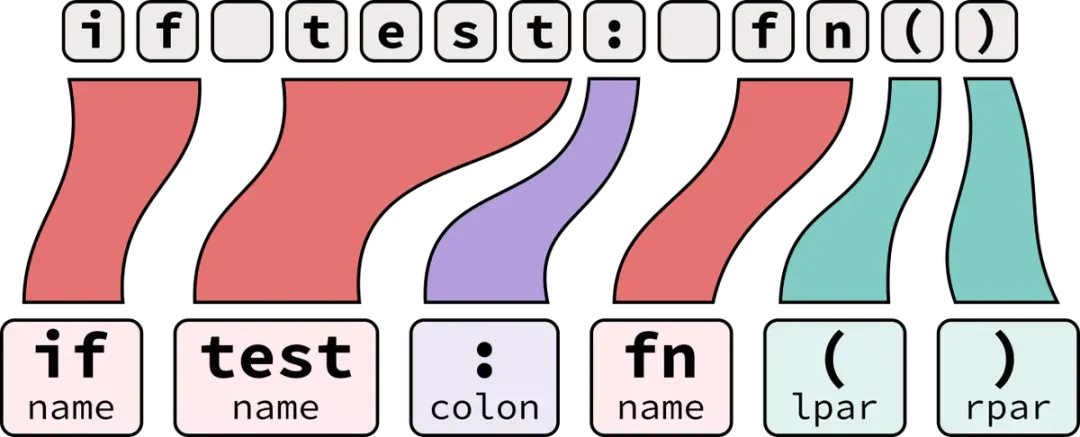

Cette semaine, OpenAI a annoncé un partenariat avec le Département de la Défense américain, dont les technologies soutiendront des applications militaires dans les domaines de la cybersécurité, de l’analyse du renseignement et de la logistique. Cet accord a suscité des critiques tant au sein d’OpenAI qu’au sein de la communauté de recherche en IA : le jour suivant son annonce, les désinstallations de l’application mobile ChatGPT ont bondi de 295 %. Le PDG d’OpenAI, Sam Altman, a ensuite reconnu que la mise en œuvre de cet accord avait été « précipitée », et a procédé à des révisions afin de préciser explicitement que le système ChatGPT « ne doit pas être utilisé intentionnellement pour surveiller les citoyens américains ». Parallèlement, les téléchargements de l’application Claude d’Anthropic ont augmenté d’environ 55 % sur la semaine achevée le 2 mars.

Auparavant, le Département de la Défense américain avait collaboré avec Anthropic, mais l’administration Trump avait mis fin au contrat avec cette entreprise après qu’Anthropic eut refusé de permettre aux forces armées d’utiliser son IA pour des armes autonomes ou pour une surveillance de masse, privilégiant alors un rapprochement accru avec OpenAI.