L’expansion de l’IA met à rude épreuve les réseaux électriques : 7 logiques d’investissement énergétique que vous devez absolument connaître

TechFlow SélectionTechFlow Sélection

L’expansion de l’IA met à rude épreuve les réseaux électriques : 7 logiques d’investissement énergétique que vous devez absolument connaître

L’énergie constitue en réalité le véritable goulot d’étranglement de la croissance intelligente.

Auteur : Joseph Ayoub

Traduction et adaptation : TechFlow

Introduction de TechFlow : Tout le monde parle de puissance de calcul et de modèles, mais cet article soulève une question plus fondamentale : l’offre énergétique pourra-t-elle suivre ? Morgan Stanley prévoit un déficit électrique de 45 GW aux États-Unis d’ici 2028 ; les délais de livraison des grands transformateurs atteignent désormais 24 à 36 mois ; et la consommation d’électricité des centres de données dédiés à l’IA augmente chaque année de 15 %. À partir de ces constats, l’auteur déduit sept logiques d’investissement — allant de la fragmentation du réseau électrique aux transformateurs à état solide en passant par le refroidissement biphasé — des angles inhabituels, mais essentiels.

Texte intégral :

Nvidia a récemment présenté son cadre selon lequel « l’IA est un gâteau à cinq couches ». Aujourd’hui, je soutiens que la couche énergétique constitue la contrainte fondamentale liée à la croissance de l’intelligence, et j’en examine les conséquences.

Le progrès de la civilisation humaine résulte de notre capacité à maîtriser des outils — qu’il s’agisse du marteau, du feu, du cheval, de l’imprimerie, du téléphone, de l’ampoule, de la machine à vapeur, de la radio ou de l’IA. Ces « outils » représentent les moyens par lesquels l’humanité convertit l’énergie en productivité.

Fondamentalement, nous accroissons notre productivité humaine en capturant de l’énergie puis en la dirigeant vers des objectifs précis au moyen d’outils.

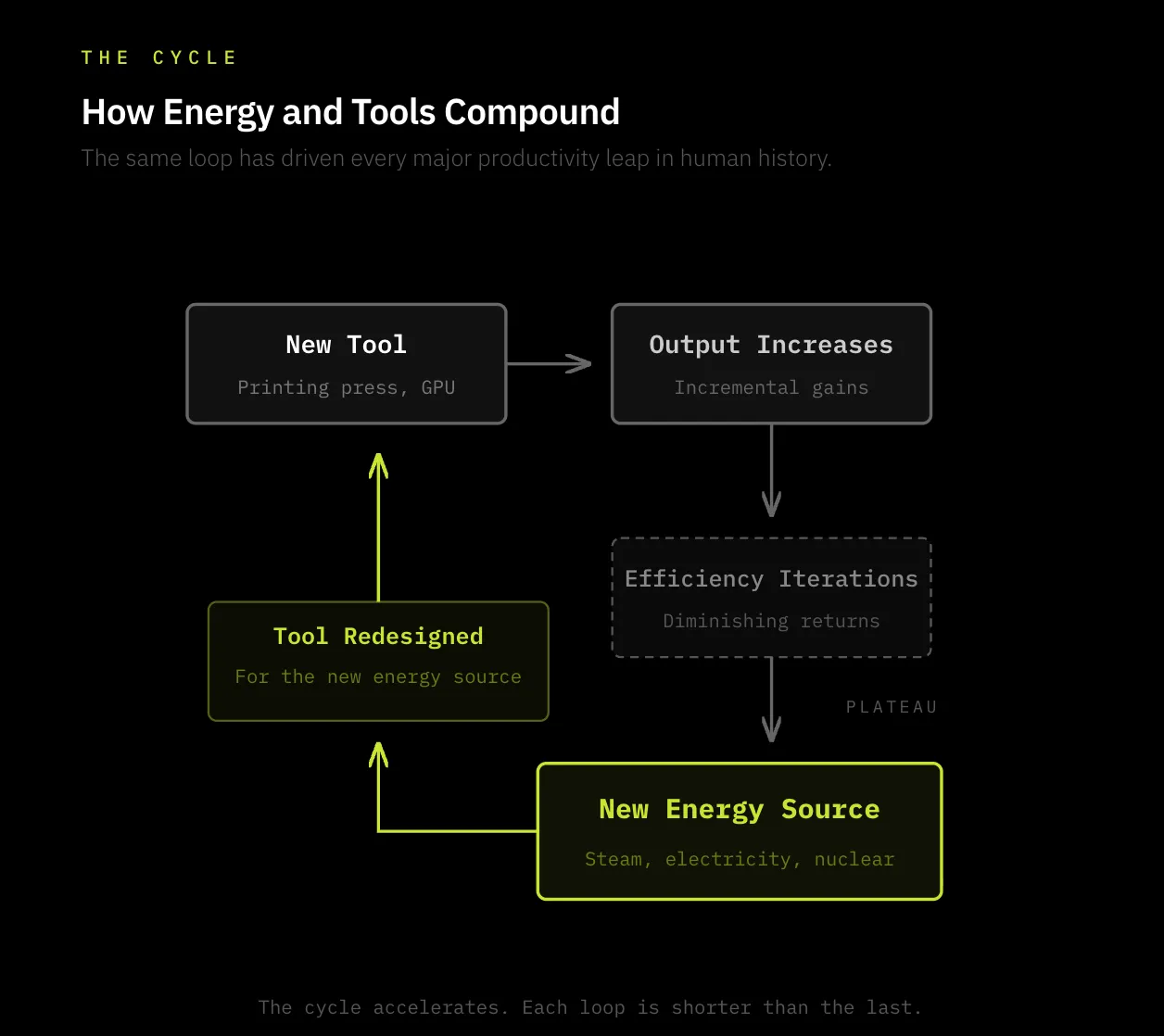

En bref, la logique centrale du progrès de la civilisation humaine est la suivante :

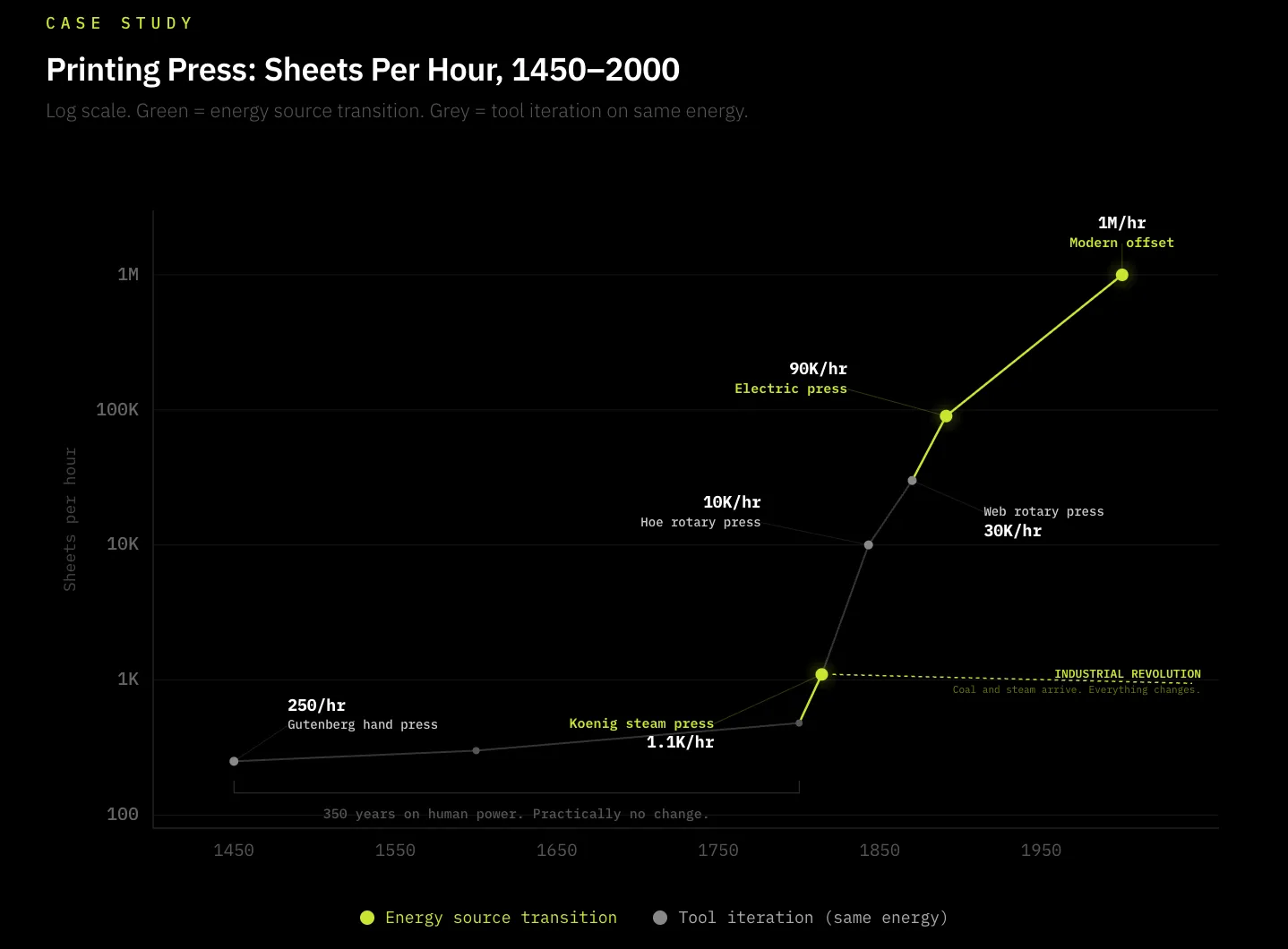

Pendant la majeure partie de l’histoire humaine, l’être humain s’est appuyé sur son propre corps et ses mains comme outils pour atteindre ses objectifs, qu’il s’agisse de cultiver des terres ou d’écrire. L’imprimerie illustre parfaitement comment l’énergie et les outils progressent conjointement — elle fut vulgarisée par Gutenberg vers 1440. Avant cette innovation, les humains consacraient leur propre énergie à transcrire manuellement des informations à l’aide d’une plume (un outil), ce qui était extrêmement inefficace. L’imprimerie introduisit un nouvel outil, permettant d’imprimer mécaniquement des textes, ce qui améliora considérablement l’efficacité d’utilisation de l’énergie humaine et augmenta la productivité de plusieurs ordres de grandeur. Pourtant, entre 1450 et 1800, soit pendant près de 350 ans, l’imprimerie connut peu d’innovations substantielles. Ce n’est qu’avec la maîtrise d’une source d’énergie plus puissante — le charbon — que le côté « énergie » de l’équation fut transformé. En 1814, Friedrich Koenig inventa l’imprimerie à vapeur, adaptant ainsi l’imprimerie à l’innovation énergétique dominante de l’époque — le charbon — et augmentant son efficacité de 5 fois. Par la suite, l’imprimerie s’adapta continuellement et efficacement aux nouvelles sources d’énergie, passant d’une production de 250 exemplaires par heure à 30 000 exemplaires cinquante ans plus tard, et atteignant aujourd’hui plusieurs millions d’exemplaires.

Ainsi, le processus continu d’innover de nouveaux outils, de repousser les limites de la maîtrise énergétique et d’accroître l’efficacité des nouveaux outils relativement à l’énergie disponible se poursuit jusqu’à nos jours. Aujourd’hui, l’intelligence constitue la nouvelle forme de productivité sur laquelle nous concentrons notre attention, et l’énergie en est le carburant. L’enjeu essentiel est de savoir si nous pouvons poursuivre la croissance de l’intelligence, ce qui dépend de notre capacité à produire une énergie suffisante, durable et fiable afin d’alimenter les outils (les GPU) et de les orienter vers leurs objectifs (l’intelligence).

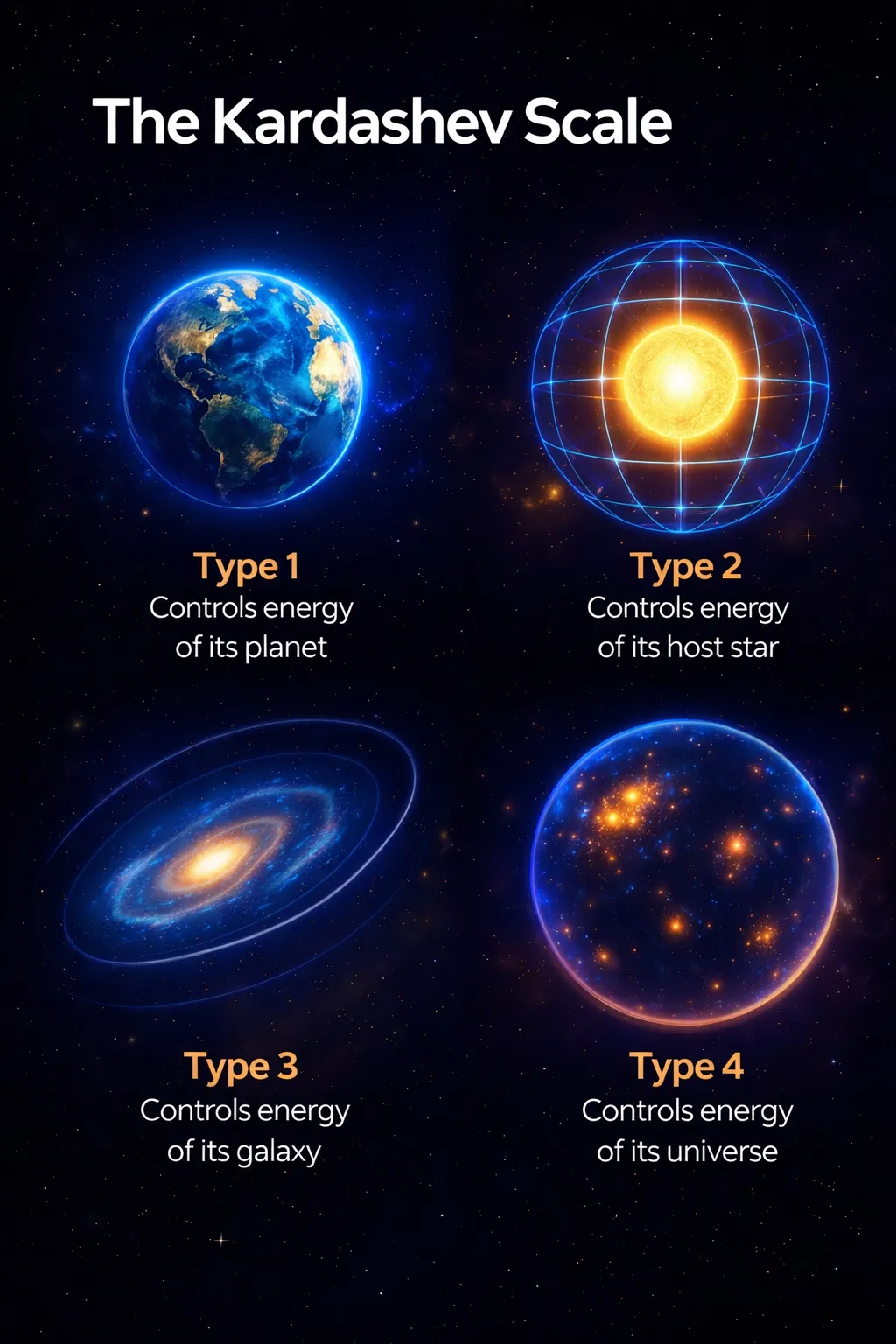

Cette thèse trouve un écho dans l’échelle de Kardashev, qui mesure le niveau de progrès technologique d’une civilisation en fonction de la quantité d’énergie qu’elle est capable de maîtriser — de la planétaire à la stellaire, galactique, cosmique, voire multiverselle. La quantité d’énergie que nous sommes capables de maîtriser marque l’étendue de notre progrès en tant que civilisation. Cette règle a toujours été vérifiée historiquement, et il n’y a aucune raison qu’elle ne le soit pas à l’avenir. La capacité à maîtriser l’énergie constitue donc le fondement même du progrès civilisationnel.

L’argument central de cet article est le suivant : la demande énergétique dépasse rapidement l’offre, ce qui constitue le principal goulot d’étranglement à la progression de l’intelligence. J’examinerai ici les effets de premier et de second ordre de cet argument.

Pourquoi l’offre énergétique ralentit-elle ?

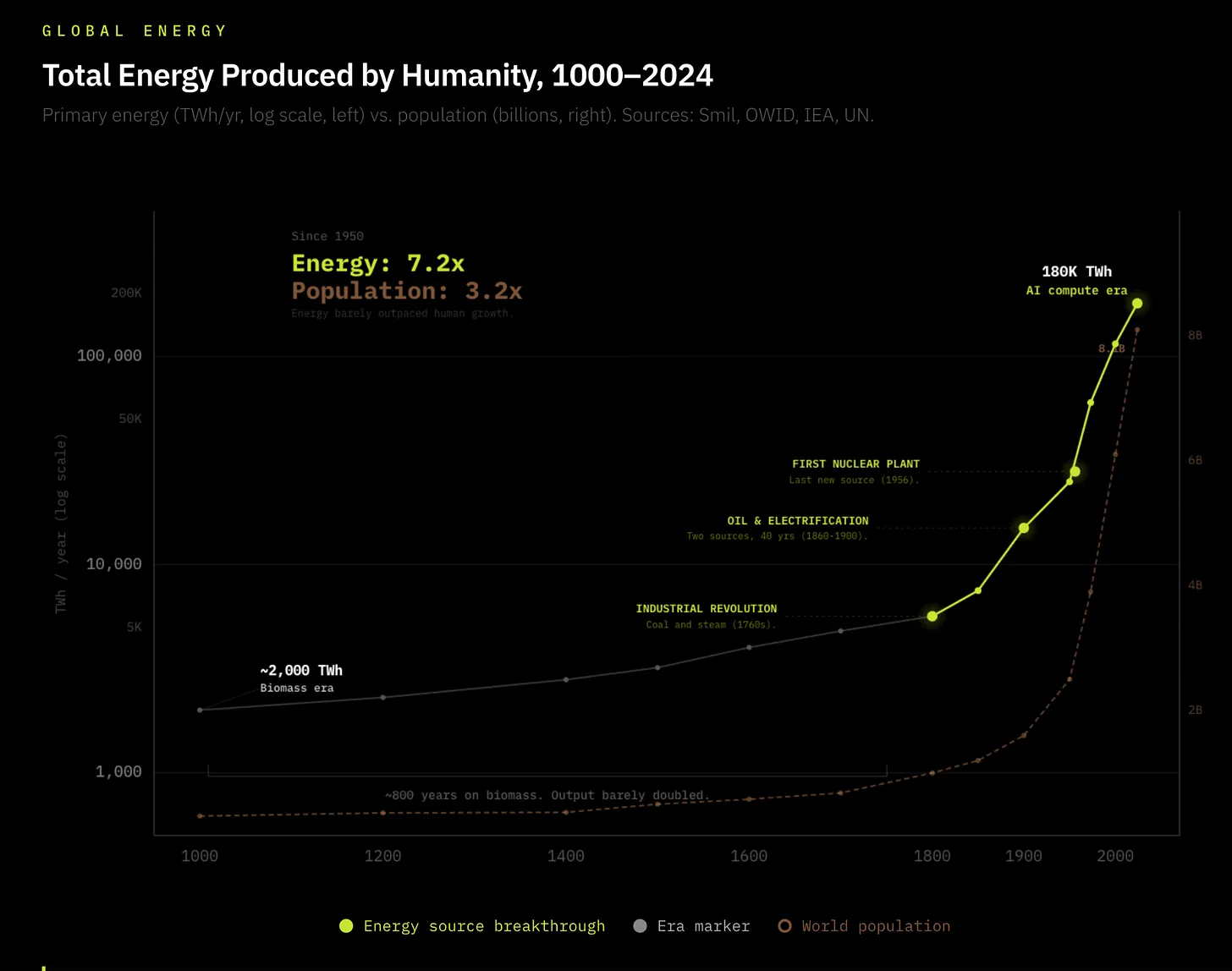

La fission nucléaire, découverte en 1939, représente jusqu’à présent la dernière grande mutation énergétique accomplie par la civilisation humaine depuis son origine. Toutefois, à la suite de la catastrophe de Tchernobyl et des engagements mondiaux visant à remplacer l’énergie nucléaire par des énergies renouvelables, un décalage manifeste s’est installé, depuis 1950, entre l’innovation des outils et les progrès énergétiques. En 1950, la production mondiale d’énergie s’élevait à 2 600 GW ; elle atteint aujourd’hui 19 000 GW (soit une multiplication par 7,3). Cela semble être un bond spectaculaire, mais cette croissance linéaire progressive est largement insuffisante pour suivre celle des technologies de calcul modernes, et elle dépasse à peine, de 3,5 fois, la croissance démographique sur la même période.

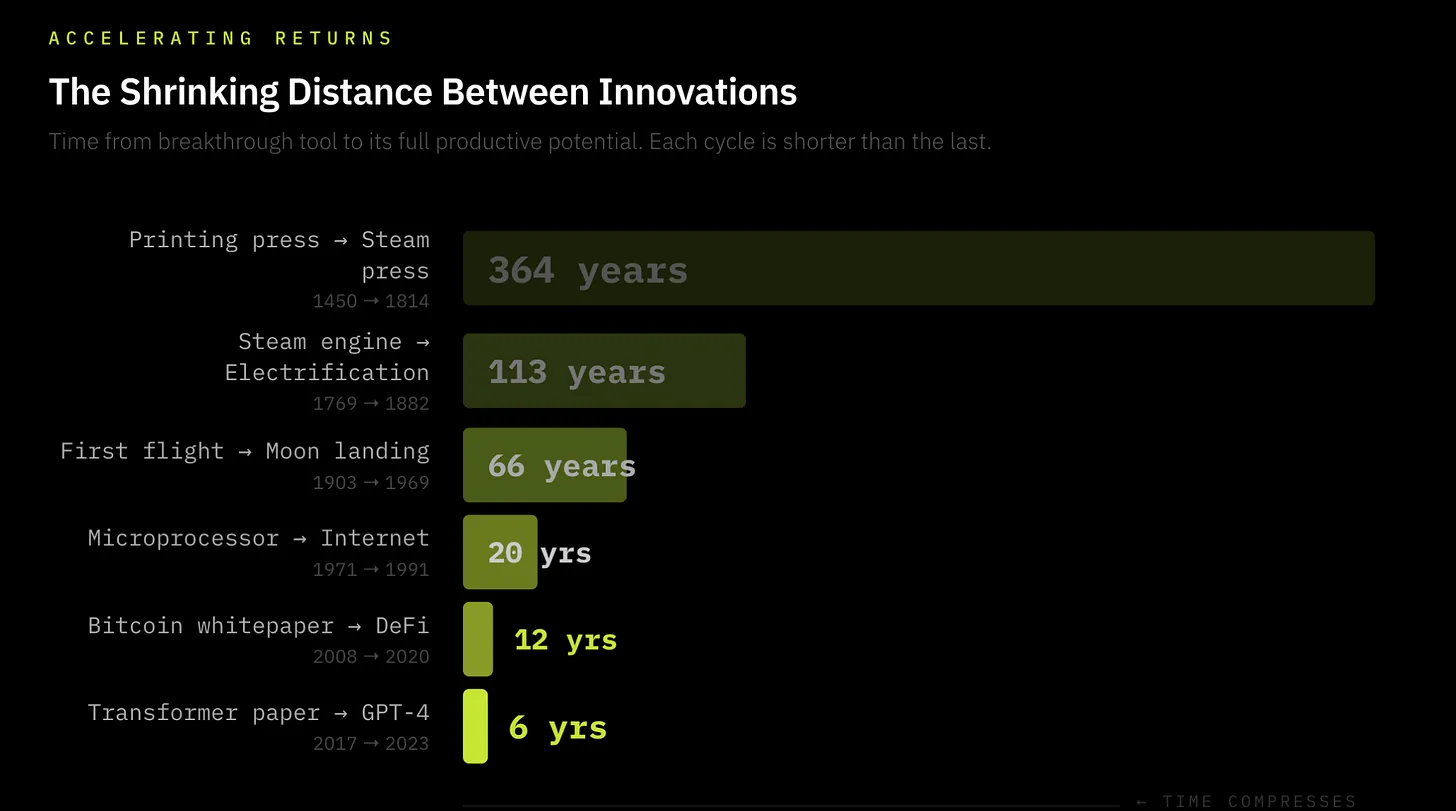

En revanche, les intervalles entre les sauts quantiques d’innovation des outils se raccourcissent. Il s’est écoulé 364 ans entre la première imprimerie et sa prochaine grande amélioration ; 58 ans entre le premier vol motorisé et le voyage spatial ; 20 ans entre le premier microprocesseur et l’apparition d’internet ; et aujourd’hui, les sauts majeurs des GPU interviennent tous les deux ans. Nous vivons une fenêtre d’amélioration continue et accélérée de l’efficacité des outils, au point que plusieurs innovations se chevauchent désormais dans des cycles de plus en plus rapides. De l’IA à la cryptographie en passant par l’informatique quantique, les nouvelles innovations sont découvertes de plus en plus vite, et leurs progrès en efficacité s’accélèrent également — c’est ce qu’on appelle la loi des rendements accélérés.

Aujourd’hui, les centres de données consomment 1,5 % de l’électricité mondiale ; ce chiffre devrait atteindre 3 % d’ici 2030 — soit une progression réalisée en six ans, alors qu’il avait fallu 50 ans à la machine à vapeur pour accomplir un parcours similaire. La différence fondamentale entre la Révolution industrielle et l’explosion actuelle de l’intelligence réside dans le fait que, durant la Révolution industrielle, l’offre énergétique avait été construite simultanément avec la croissance de la demande : mines de charbon, canaux, réseaux ferroviaires et machines consommatrices de ces ressources avaient toutes connu une expansion concomitante. Chaque révolution énergétique précédente avait développé sa propre chaîne d’approvisionnement au fur et à mesure de son expansion ; l’IA hérite d’une chaîne d’approvisionnement déjà existante, mais celle-ci commence à se désintégrer.

Le réseau électrique n’est absolument pas prêt à faire face à une croissance annuelle de la consommation d’électricité de 15 % liée à l’explosion de l’intelligence, alors que la demande électrique aux États-Unis a presque stagné au cours des dix dernières années. Des fissures commencent déjà à apparaître aux États-Unis : la file d’attente pour l’accès au réseau électrique a atteint un record historique, les délais de livraison des grands transformateurs s’élèvent désormais en moyenne à 24 à 36 mois, et un déficit d’offre de transformateurs électriques de 30 % est attendu pour 2025. Morgan Stanley estime que les États-Unis feront face, d’ici 2028, à un déficit électrique de 45 GW — l’équivalent de la consommation électrique de 33 millions de foyers américains. Je pense que ce déficit pourrait être bien plus important encore.

Le problème est clair : l’humanité doit étendre radicalement son offre énergétique afin de suivre les sauts d’innovation dans des domaines tels que l’IA, la robotique ou la conduite autonome.

Le déficit énergétique à venir : effets de premier et de second ordre

Les conséquences du déficit énergétique à venir ont une portée historique : à mesure que la demande énergétique explose tandis que l’offre reste insuffisante, nous pourrions assister à l’émergence de marchés énergétiques quasi privatisés.

Les fournisseurs de services cloud hyperscalaires ont déjà commencé à construire leurs propres installations de production d’électricité « derrière le compteur » (BTM), et envisagent d’étendre ce modèle à des centres de données alimentés par énergie nucléaire — une tendance qui commence à se dessiner. Je suis convaincu que cette tendance ne fera que s’amplifier.

J’expose ci-dessous sept arguments, tous dérivés de l’explosion de l’intelligence et de ses répercussions sur une offre électrique déjà fortement tendue.

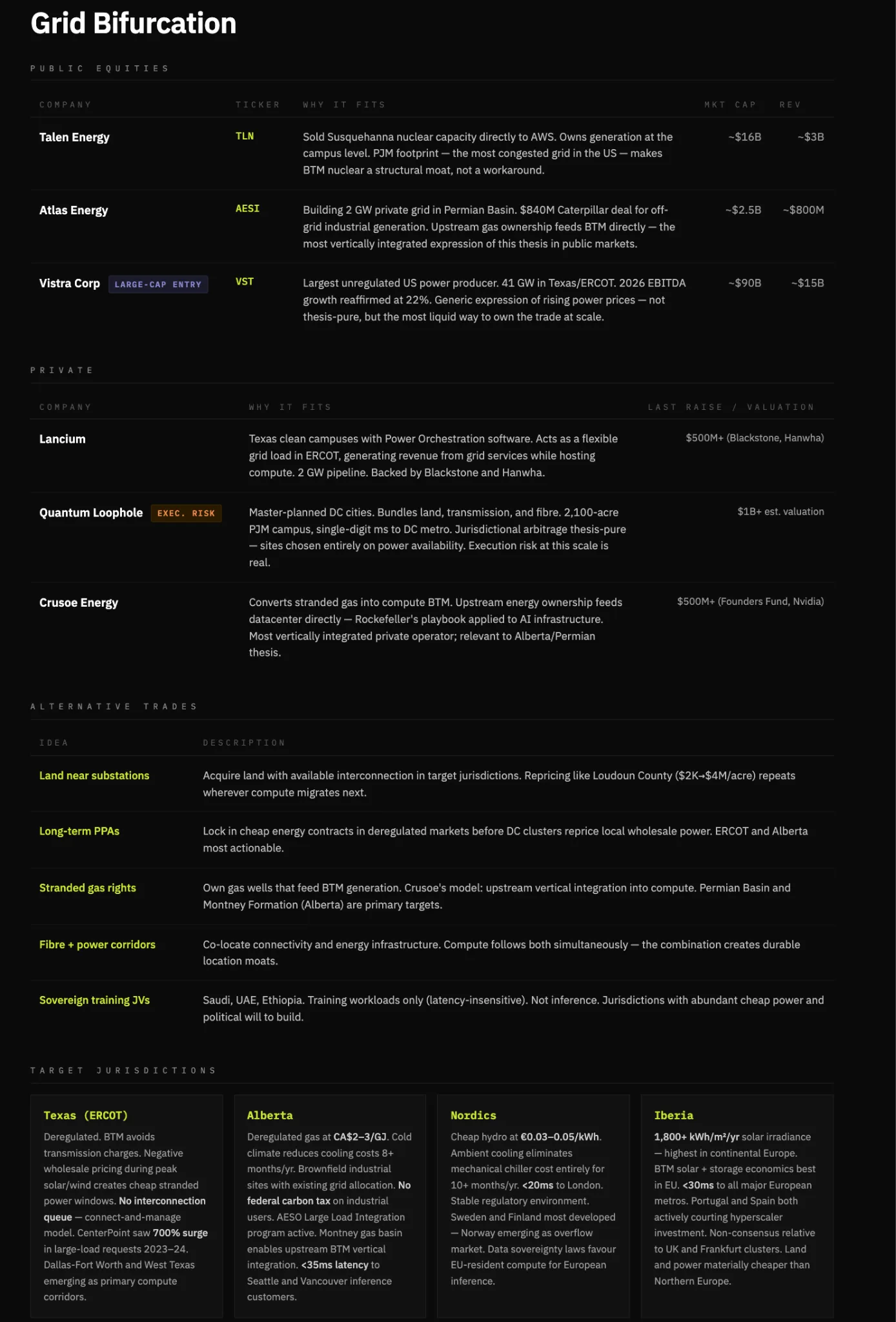

Argument n°1 : La fragmentation du réseau électrique — la puissance de calcul migrera vers l’énergie, et non l’inverse

Dans les régions géographiquement proches des besoins d’inférence, dotées d’une abondance énergétique et d’un cadre réglementaire souple, la fragmentation des systèmes énergétiques générera une valeur disproportionnée.

Lorsque la demande énergétique commence à dépasser l’offre, l’électricité devient un enjeu politique sensible. Les ménages disposent d’un droit de vote, les centres de données non. Dans un contexte de déficit énergétique, il est peu probable que le réseau électrique conserve une neutralité stricte : il privilégiera plutôt l’alimentation des foyers par rapport à celle des usages industriels, via des mécanismes tarifaires, des restrictions d’accès ou des seuils implicites.

Compte tenu de la sensibilité extrême de la puissance de calcul aux délais, au temps de disponibilité et à la fiabilité, il deviendra tout simplement impossible d’exploiter des infrastructures dans des juridictions où la priorité est donnée à l’alimentation résidentielle. À mesure que l’accès au réseau deviendra instable ou politisé, les charges de calcul migreront vers des modèles de production « derrière le compteur » (BTM), où l’électricité peut être garantie, contrôlée et tarifée directement.

Cela entraînera une transformation structurelle : la puissance de calcul migrera vers les économies dotées d’une abondance énergétique et d’un cadre réglementaire souple. Les gagnants seront ceux qui sauront intégrer terre, connectivité, production d’énergie et fibre optique en des systèmes déployables et reproductibles, dont les juridictions d’implantation bénéficieront également.

Argument n°2 : L’énergie devient une moine de compétitivité, et la production BTM constitue la capacité différenciante fondamentale des fournisseurs de puissance de calcul

À mon avis, c’est là l’effet de premier ordre le plus critique de l’aggravation du déficit énergétique. Dans un monde où la demande énergétique dépasse l’offre, l’accès à une électricité bon marché et fiable constitue un avantage structurel de coût qui s’accumule avec le temps. En outre, il devient politiquement intenable que les centres de données bénéficient d’une priorité d’accès au réseau électrique — or c’est précisément la trajectoire actuelle de l’énergie. La tension croissante sur les réseaux nationaux forcera les fournisseurs de puissance de calcul à produire eux-mêmes leur électricité : les fournisseurs cloud hyperscalaires ont déjà entamé ce mouvement. Les infrastructures sans capacité de production BTM seront purement et simplement éliminées du marché.

Fondamentalement, les entreprises qui possèdent leur propre énergie gagnent, celles qui la louent perdent. Sans production BTM, les fournisseurs de puissance de calcul feront face à des problèmes critiques de fiabilité énergétique, à une hausse des coûts et à des restrictions d’usage. Les REIT spécialisés exclusivement dans l’hébergement (tels qu’Equinix ou Digital Realty), qui ne produisent pas leur propre énergie, verront leur valeur diminuer par rapport aux opérateurs verticalement intégrés. Les entreprises combinant production énergétique et hébergement de calcul sont en train de construire les moines de compétitivité les plus profondes (Crusoe, Iren et certains fournisseurs hyperscalaires). Cela pourrait se traduire par une stratégie longue/courte, mais je préfère ici mettre l’accent sur les gagnants de l’intégration verticale.

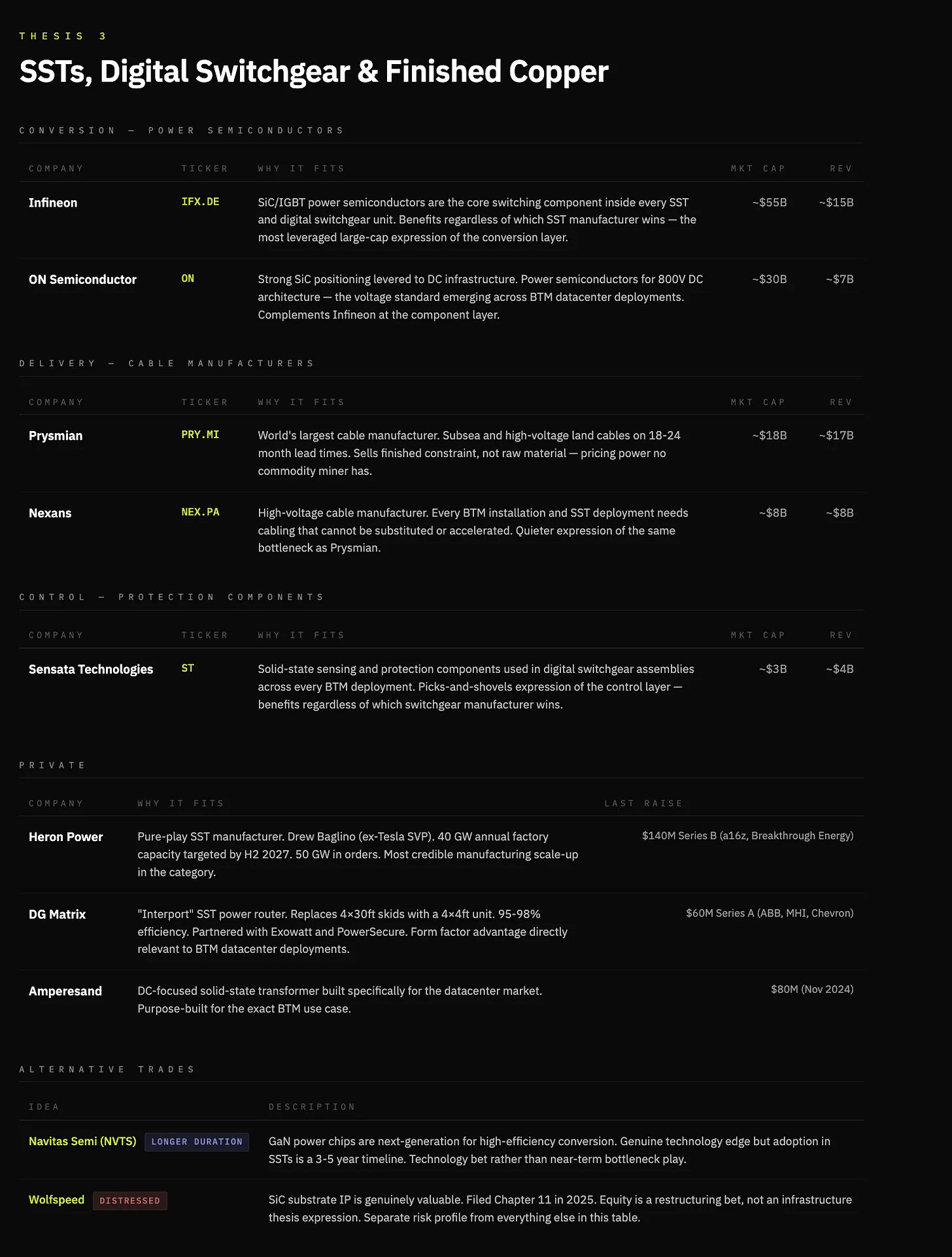

Argument n°3 : La standardisation BTM stimule l’innovation — des transformateurs traditionnels aux transformateurs à état solide, des équipements de commutation classiques aux équipements numériques

Les transformateurs traditionnels servent à élever ou abaisser la tension du courant alternatif fourni par le réseau électrique. En raison de leur taille et des matériaux utilisés, leurs délais de livraison atteignent aujourd’hui 24 à 36 mois, et un déficit d’offre de 30 % est attendu. Il s’agit aussi d’une technologie datant des années 1880, fabriquée à la main à partir de matériaux limités. Le point essentiel est que chaque mégawatt produit « derrière le compteur » doit obligatoirement passer par une conversion, une régulation et une distribution jusqu’au point de calcul — aucun contournement n’est possible pour le transformateur.

Le transformateur à état solide remplace l’ensemble de ce système par des composants électroniques de puissance haute fréquence. Il est plus petit, plus rapide et entièrement contrôlable, assurant en un seul module la conversion courant alternatif / courant continu, la régulation de tension et le courant bidirectionnel. Sa fabrication est également plus simple, reposant sur des semi-conducteurs de puissance au carbure de silicium ou au nitrure de gallium, plutôt que sur d’énormes enroulements de cuivre et des cuves remplies d’huile. À mesure que l’architecture BTM devient la norme, le dispositif situé entre l’énergie et la puissance de calcul devient le goulot d’étranglement — ce dispositif est précisément le transformateur à état solide (SST).

Les équipements de commutation font face eux aussi à des délais de 80 semaines : ils constituent la couche de contrôle entre la production d’électricité et la charge, assurant la routage de l’électricité, l’isolement des défauts et la protection du système. Comme les transformateurs, ils sont produits de façon artisanale à partir de matériaux limités et n’ont pratiquement pas évolué depuis les années 1880.

L’équipement de commutation numérique remplace entièrement ce système par des composants électroniques de puissance à état solide. Il est plus rapide, programmable, entièrement contrôlable, permettant une détection en temps réel des défauts, une isolation à distance et un routage dynamique des charges. Plus important encore, il s’étend comme un produit électronique, et non comme un équipement industriel.

Une remarque complémentaire sur le cuivre : j’adopte une position constructive vis-à-vis du cuivre. Ce métal constitue l’autoroute des électrons et sera la première matière première requise dans un monde de plus en plus électrifié. Toutefois, la manière d’exprimer cette opportunité est subtile — les sociétés minières traditionnelles, en tant qu’actifs de transaction, connaissent des marges faibles, susceptibles de se comprimer davantage dans le temps. En revanche, des goulots d’étranglement importants et des perspectives de création de valeur future existent en aval, là où le cuivre est indispensable et où les délais sont serrés. Des fabricants de câbles tels que Prysmian et Nexans vendent des produits finis contraints, et non des matières premières ; avec des délais de livraison des transformateurs fortement allongés, ce marché n’est plus un marché de commodités.

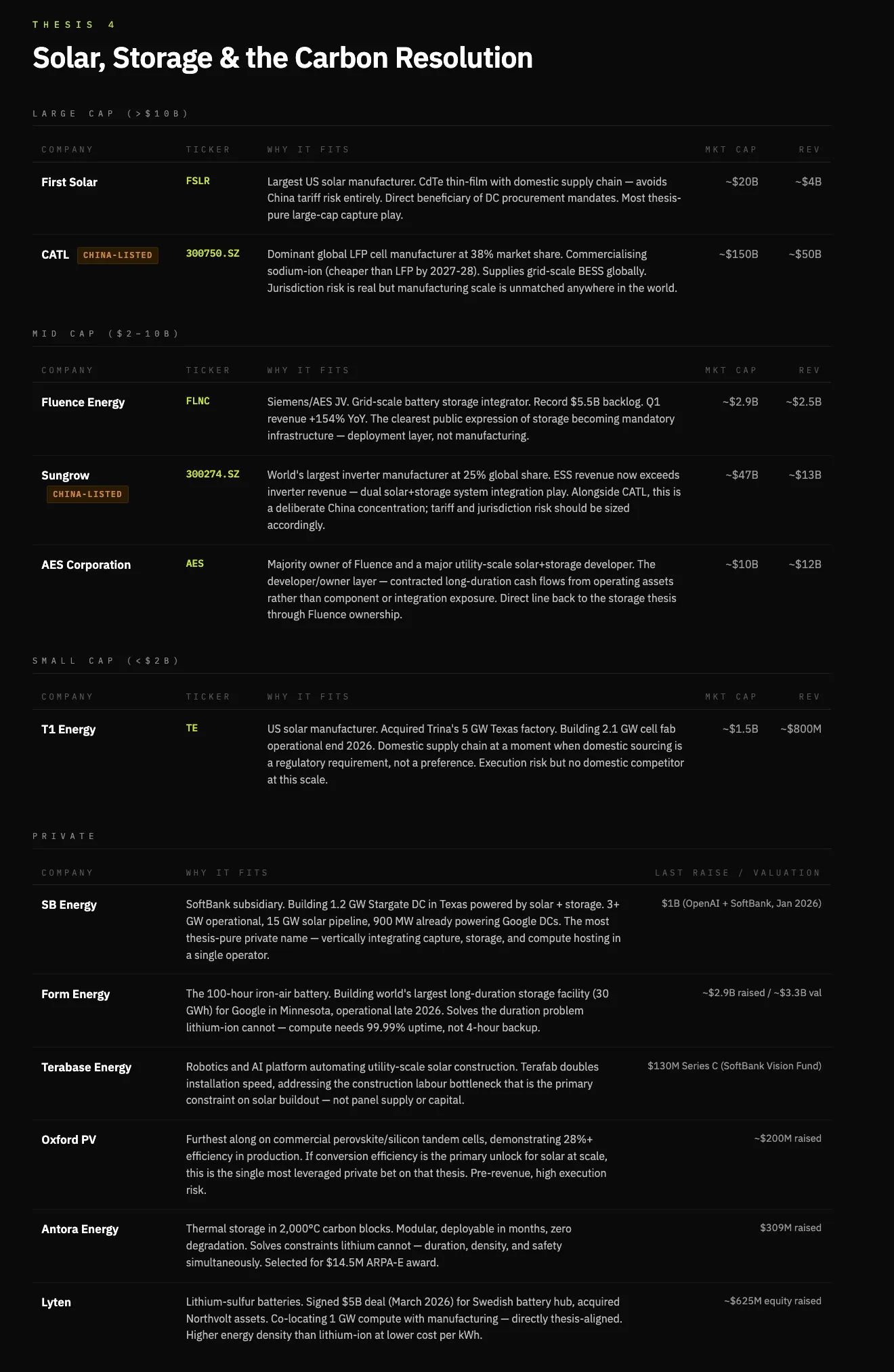

Argument n°4 : Le coût carbone de l’IA devient politiquement de plus en plus difficile à justifier, ce qui imposera des solutions basées sur le solaire et les batteries

Le développement de l’IA comporte un problème carbone encore non valorisé, qui constitue une contrainte politique. Les centres de données font grimper les tarifs électriques, consomment massivement de l’eau et augmentent les émissions locales. Cela s’est déjà concrétisé : un projet de centre de données de 18 milliards de dollars a été totalement annulé, et un autre projet de 46 milliards de dollars a été reporté.

Aujourd’hui, environ 56 % de l’électricité consommée par les centres de données provient de combustibles fossiles. Le gaz naturel résout le problème de la rapidité de déploiement, mais il est politiquement vulnérable. À mesure que la demande s’accroît, la résistance à l’expansion des énergies fossiles augmente, imposant à court terme un système hybride combinant gaz naturel, énergie nucléaire et énergies renouvelables.

Bien que le gaz naturel serve de pont à court terme durant l’explosion des centres de données, à plus long terme, l’abondance énergétique ne se résout pas par l’extraction de combustibles, mais par la capture d’énergie. Le Soleil fournit à la Terre une quantité d’énergie supérieure de plusieurs ordres de grandeur à celle que l’humanité consomme. La contrainte ne réside pas dans la disponibilité, mais dans la conversion, le stockage et le déploiement.

L’énergie solaire n’est pas une solution immédiate à la demande énergétique de la puissance de calcul, mais bien sa solution finale.

Aujourd’hui, les panneaux solaires commerciaux captent environ 22 % de l’énergie incidente. Chaque point de gain d’efficacité de conversion réduit le coût par mégawatt, rapprochant ainsi l’énergie solaire, dans les systèmes BTM, de la parité avec la génération programmable.

Le stockage par batteries devient un composant central de cette architecture. Non seulement il permet de lisser l’intermittence, mais il constitue aussi une couche génératrice de revenus. L’arbitrage de stockage et l’équilibrage de charge transforment ce qui était historiquement un centre de coûts en un contributeur aux profits des opérateurs BTM.

Dans ce scénario, les gagnants sont les entreprises verticalement intégrées couvrant la capture, le stockage et la distribution : des développeurs solaires spécialisés disposant de contrats BTM, des fabricants de batteries proposant des produits à l’échelle du réseau et à l’échelle des sites, ainsi que quelques opérateurs capables de combiner production énergétique propre et hébergement de calcul.

L’énergie solaire relève de l’achat et de la fabrication, les batteries constituent la couche de contrainte et de monétisation, et l’intégration capte les profits. Les technologies de pointe restent des options spéculatives, non des scénarios de base. Sur ce point, Tesla pourrait continuer à dominer, mais je choisirai ici de me concentrer sur des titres moins consensuels.

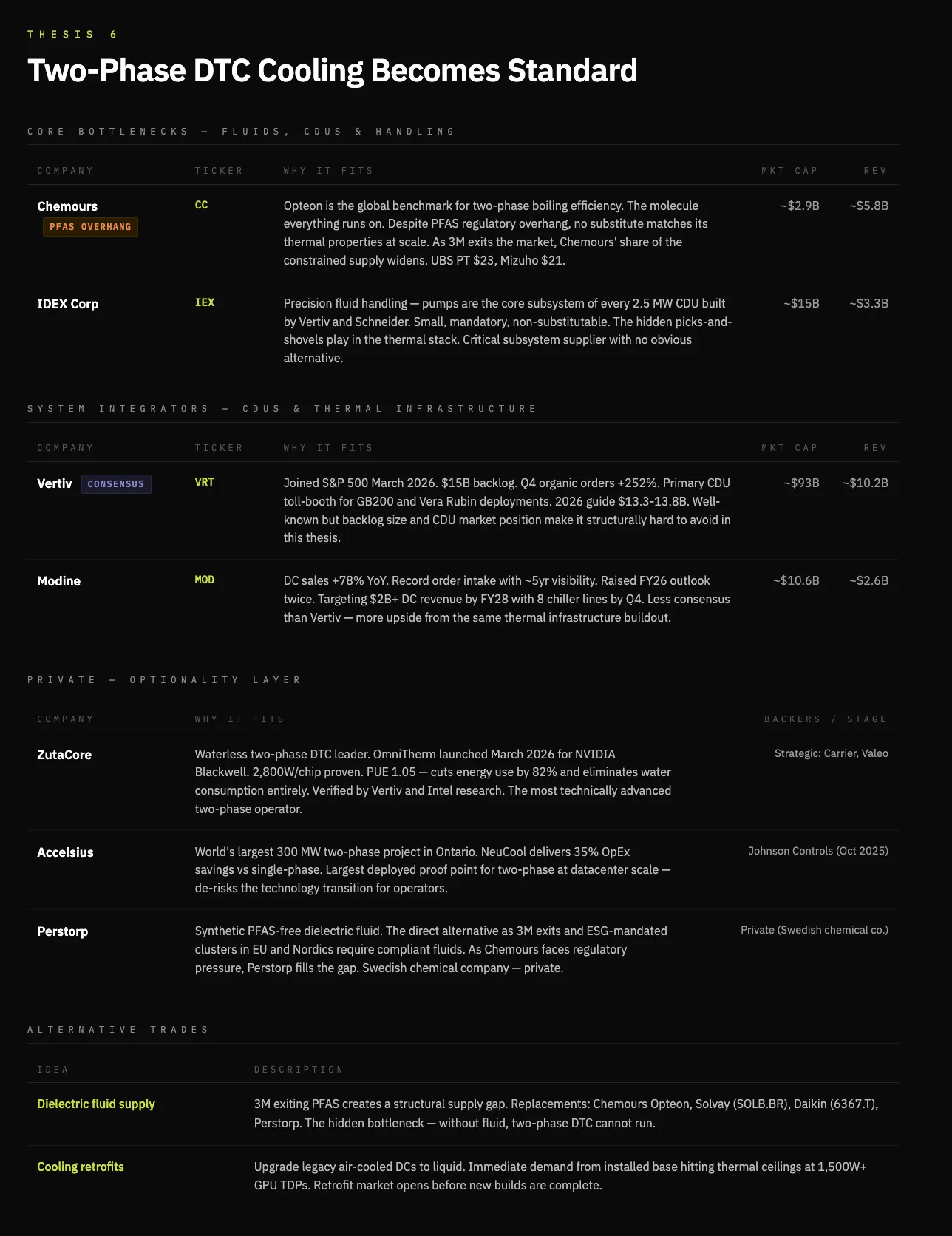

Argument n°5 : Le refroidissement devient une contrainte de premier ordre, et le refroidissement liquide direct biphasé (D2C) devient incontournable dans les applications de pointe

Une autre conséquence est l’essor du refroidissement liquide biphasé. Pour être franc, cet argument intègre aussi mon propre jugement : la densité de puissance des puces suit une trajectoire parabolique, posant un défi thermodynamique de plus en plus ardu. Le refroidissement par air classique est fondamentalement insoutenable pour plusieurs raisons, principalement parce qu’il ne fonctionne plus sur des puces de densité plus élevée, et à cause des problèmes environnementaux liés à la consommation d’eau et d’électricité.

Tout d’abord, le refroidissement D2C permet de repousser les limites de densité et de performance sans contrainte liée à la gestion thermique — un enjeu crucial pour l’extension. La réalité actuelle du marché est dominée par le refroidissement monophasé, car il est plus simple : de l’eau froide circule dans des plaques refroidissantes pour refroidir les puces, mais ce système connaît des limites bien connues. Lorsque la densité de puissance des puces dépasse 1 500 W, la transition vers le refroidissement biphasé deviendra inévitable. Ce dernier consiste à pomper un liquide diélectrique autour des puces, conçu pour bouillir à basse température — la transition de phase du liquide à la vapeur améliore considérablement l’efficacité du refroidissement.

Le refroidissement biphasé permet de réduire la consommation énergétique de 20 % et la consommation d’eau de 48 %. Cette amélioration des performances autorise des emballages de puces plus denses, augmente les performances, et génère finalement une demande accrue pour des systèmes de refroidissement haute performance.

La société privée Zutacore, leader du refroidissement biphasé DTC, a démontré, à l’aide d’un liquide diélectrique (et non d’eau), un refroidissement biphasé D2C permettant de réduire la consommation énergétique de 82 % et d’éliminer totalement la consommation d’eau — résultats validés par des recherches menées conjointement avec Vertiv et Intel. Zutacore est un acteur privé à surveiller de près dans ce domaine ; par ailleurs, une étude approfondie des fournisseurs de liquides diélectriques pourrait également présenter un intérêt.

Argument n°6 : L’énergie nucléaire peut servir de pont vers l’abondance et la stabilité énergétiques, mais ne constitue pas la réponse à long terme à l’expansion de l’offre

Lors de la rédaction de cet article, j’avais initialement considéré que l’énergie nucléaire constituait une bonne solution pour combler le vide énergétique à court terme. La réalité est que le coût de déploiement des petits réacteurs modulaires (SMR) est de 5 à 10 fois supérieur à celui des systèmes comparables au gaz naturel (10 000 à 15 000 USD par kW), rendant leur déploiement à grande échelle et leur extension pratiquement impossibles.

L’énergie nucléaire résout le problème de la fiabilité, et non celui de la vitesse ou du coût — surtout lorsqu’il s’agit d’installations « derrière le compteur ». Elle permet ainsi de fournir une électricité de base stable et programmable dans des contextes où la fiabilité est non négociable. L’énergie nucléaire a donc un rôle à jouer dans le déficit énergétique, mais comme un pont, et non comme une source d’approvisionnement fondamentale.

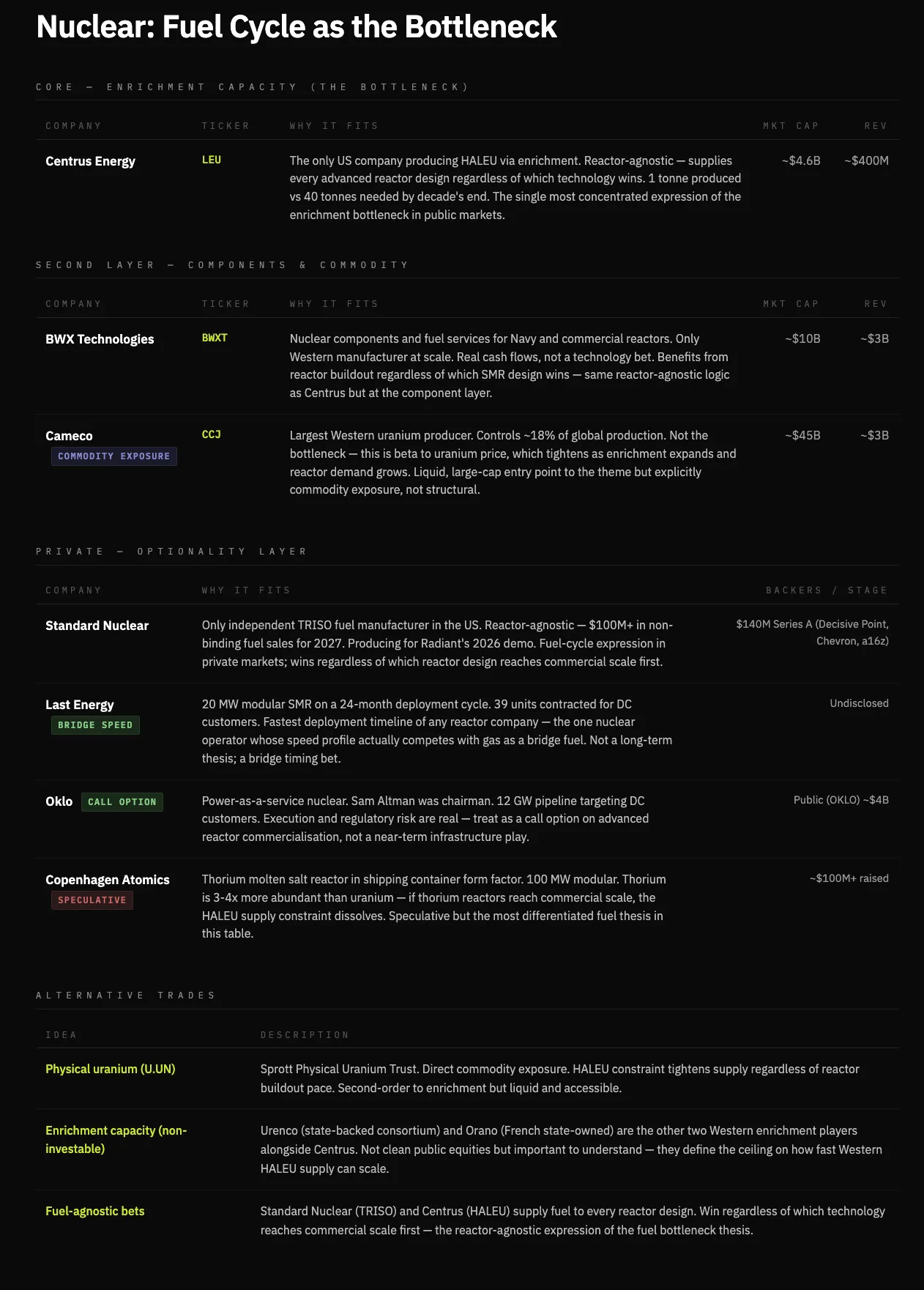

L’énergie nucléaire est limitée par son cycle de combustible et par les délais de construction. Les réacteurs avancés actuels nécessitent de l’uranium faiblement enrichi à haute teneur (HALEU), une matière première dont l’offre commerciale est quasi inexistante aujourd’hui. Même une fois les réacteurs construits, la capacité à les alimenter en combustible devient la contrainte déterminante de la vitesse d’expansion du nucléaire.

Par conséquent, l’énergie nucléaire est peu susceptible de constituer la solution marginale à l’expansion de l’offre énergétique — elle arrive lentement sur le marché, exige des investissements massifs et dépend fortement des infrastructures et du combustible. En revanche, les systèmes les plus rapides à déployer — à court terme le gaz naturel, à long terme le solaire et le stockage — sont les seuls à pouvoir réduire effectivement l’écart.

Le goulot d’étranglement investissable n’est pas le réacteur, mais le combustible. À mesure que la demande de SMR augmentera, l’enrichissement d’uranium à haute teneur deviendra un maillon critique — un goulot d’étranglement indépendant du type de réacteur, où la valeur s’accumulera quelle que soit la conception finale qui l’emportera.

Argument n°7 : L’émergence d’une nouvelle catégorie de groupes d’infrastructures énergétiques ; les intégrateurs verticaux transforment les électrons en puissance de calcul

Le goulot d’étranglement des infrastructures de l’IA ne réside pas uniquement dans l’énergie, mais aussi dans la capacité à transformer à grande échelle l’énergie en calcul exploitable.

Dans les années 1870, tout comme aujourd’hui pour l’électricité, le pétrole n’était pas rare, mais son raffinage et sa distribution posaient problème. Rockefeller créa une entreprise en intégrant verticalement l’extraction, le raffinage et la distribution du pétrole aux foyers — Standard Oil, l’une des plus grandes entreprises de l’histoire.

La révolution de l’intelligence suit le même schéma ; l’électricité est le pétrole brut. L’électricité est abondante, mais transformer de façon fiable l’électricité en puissance de calcul rencontre des obstacles liés à la transmission, au refroidissement, à la connectivité et aux autorisations. Le « raffinage » des électrons est ce qui crée la valeur. Chaque niveau supplémentaire de propriété augmente la fiabilité, réduit les coûts et accroît les marges bénéficiaires, renforçant ainsi l’intégration verticale de façon autonome.

Les entreprises hyperscalaires constituent la couche de distribution de ce système, ainsi que le consommateur final de la puissance de calcul. Toutefois, l’opportunité structurelle réside dans la propriété des infrastructures que les distributeurs sont contraints d’acheter. Cela crée une nouvelle catégorie de groupes d’infrastructures énergétiques : des opérateurs contrôlant à la fois la production, la conversion, le refroidissement et l’hébergement.

L’expression la plus claire de ce phénomène est offerte par les opérateurs verticalement intégrés du marché privé, tels que Crusoe et Lancium, ainsi que par les plateformes de calcul natives cotées, telles qu’Iren et Core Scientific, qui possèdent déjà l’élément le plus difficile à reproduire en aval : l’énergie.

Les entreprises qui contrôlent le flux d’électrons vers les racks construisent les moines de compétitivité les plus profondes dans l’économie de l’IA. Les logiciels ne peuvent pas « digérer » les infrastructures physiques.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News