Refuser le monopole du pouvoir de l’IA : débat animé entre Vitalik et Beff Jezos – les technologies décentralisées peuvent-elles devenir le « pare-feu numérique » de l’humanité ?

TechFlow SélectionTechFlow Sélection

Refuser le monopole du pouvoir de l’IA : débat animé entre Vitalik et Beff Jezos – les technologies décentralisées peuvent-elles devenir le « pare-feu numérique » de l’humanité ?

À quoi pourrait ressembler la société humaine dans les 10, 100 ou même 1 000 prochaines années ?

Rédaction & traduction : TechFlow

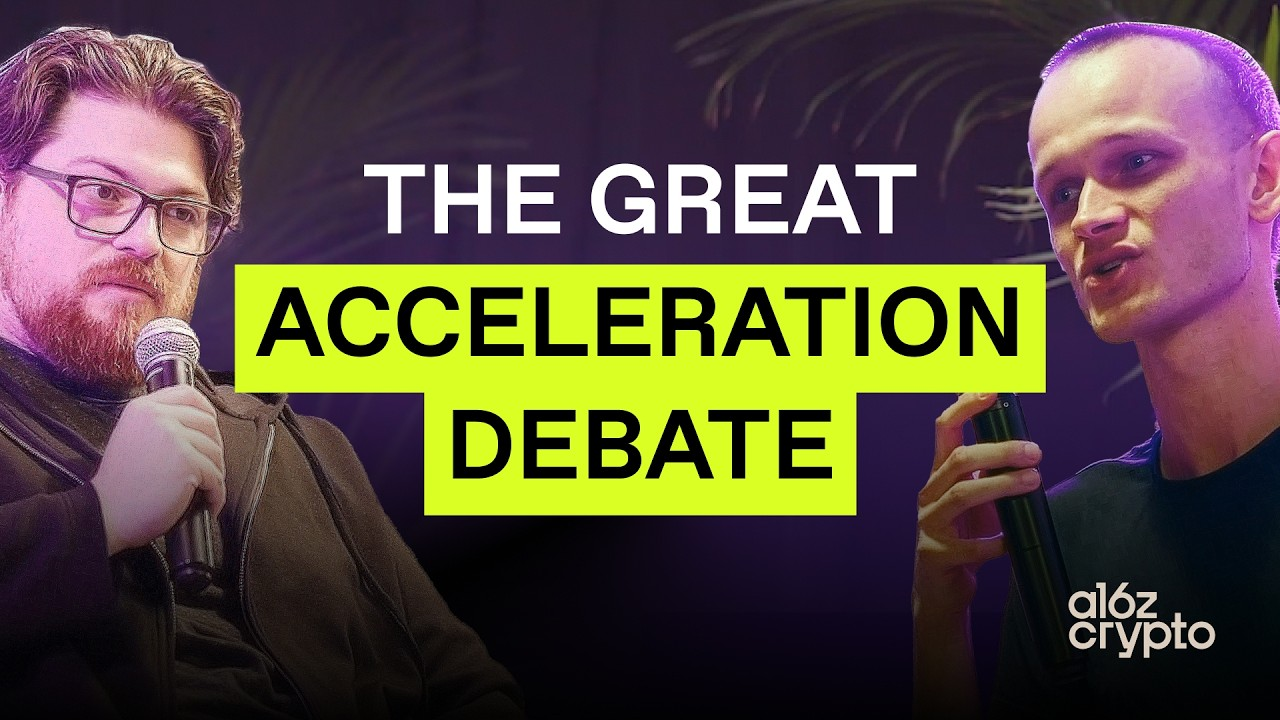

Invités : Vitalik Buterin, fondateur d’Ethereum ; Guillaume Verdon (pseudonyme « Beff Jezos »), fondateur et PDG d’Extropi

Modérateurs : Eddy Lazzarin, directeur technique (CTO) de a16z crypto ; Shaw Walters, fondateur d’Eliza Labs

Source du podcast : a16z crypto

Titre original : Vitalik Buterin contre Beff Jezos : débat sur l’accélération de l’IA (E/acc contre D/acc)

Date de diffusion : 26 mars 2026

Synthèse des points clés

Faut-il pousser l’IA à progresser le plus rapidement possible, ou faut-il au contraire adopter une approche plus prudente ?

Aujourd’hui, le débat autour du développement de l’IA oppose principalement deux visions contradictoires :

- E/acc (« accelerationnisme efficace », effective accelerationism) : prône une accélération maximale du progrès technologique, car celle-ci constituerait la seule voie possible pour l’humanité.

- D/acc (« accelerationnisme défensif/décentralisé », defensive / decentralized acceleration) : soutient également l’accélération, mais insiste sur la nécessité d’une progression mesurée afin d’éviter de perdre le contrôle sur la technologie.

Dans cet épisode du podcast a16z crypto, Vitalik Buterin, fondateur d’Ethereum, et Guillaume Verdon (pseudonyme « Beff Jezos »), fondateur et PDG d’Extropi, se réunissent avec Eddy Lazzarin, CTO de a16z crypto, et Shaw Walters, fondateur d’Eliza Labs, pour un échange approfondi sur ces deux courants. Ils explorent les implications potentielles de ces idées pour l’IA, les technologies blockchain et l’avenir de l’humanité.

Au cours de l’épisode, ils abordent les questions suivantes :

- Pouvons-nous réellement contrôler le rythme de l’accélération technologique ?

- Quels sont les principaux risques liés à l’IA, allant de la surveillance de masse à la concentration extrême du pouvoir ?

- Les technologies open source et décentralisées peuvent-elles déterminer qui bénéficiera réellement des progrès technologiques ?

- Ralentir le développement de l’IA est-il réaliste — ou même souhaitable ?

- Comment l’humanité peut-elle préserver sa valeur et sa place dans un monde dominé par des systèmes de plus en plus puissants ?

- À quoi pourrait ressembler la société humaine dans 10 ans, 100 ans, voire 1 000 ans ?

La question centrale de cet épisode est la suivante : L’accélération technologique peut-elle encore être orientée, ou lui a-t-on déjà échappé ?

Résumé des idées marquantes

Sur l’essence et la vision historique de l’« accelerationnisme »

- Vitalik Buterin : « Une nouveauté est apparue au cours du siècle dernier : nous devons apprendre à comprendre un monde en pleine mutation, parfois même en mutation rapide et destructrice… La Seconde Guerre mondiale a suscité des réflexions telles que “Je suis devenu la mort, le destructeur des mondes”, incitant les gens à se demander : lorsque nos croyances fondamentales s’effondrent, en quoi pouvons-nous encore croire ? »

- Guillaume Verdon : « L’E/acc est essentiellement une “prescription méta-culturelle”. Ce n’est pas une culture en soi, mais une directive indiquant ce qu’il convient d’accélérer. Le cœur de cette accélération réside dans la complexification matérielle, car elle nous permet de mieux prédire notre environnement. »

- Guillaume Verdon : « L’opposé de l’anxiété, c’est la curiosité. Plutôt que de craindre l’inconnu, embrassons-le… Nous devrions tracer un futur optimiste, car nos croyances façonnent la réalité. »

Sur l’entropie, la thermodynamique et les « bits égoïstes »

- Vitalik Buterin : « L’entropie est subjective : ce n’est pas une grandeur physique fixe, mais reflète plutôt le degré d’ignorance que nous avons sur un système… Lorsque l’entropie augmente, c’est notre ignorance du monde qui augmente. … La valeur provient de nos propres choix. Pourquoi trouvons-nous un monde humain vivant plus intéressant qu’une planète comme Jupiter, composée uniquement de particules ? Parce que nous y attribuons un sens. »

- Vitalik Buterin : « Imaginez un modèle de langage volumineux, puis modifiez aléatoirement l’une de ses pondérations en lui attribuant une valeur gigantesque, par exemple neuf milliards. Le pire scénario est un effondrement complet du système… Si nous accélérons aveuglément une partie quelconque, le résultat final pourrait être la perte totale de toute valeur. »

- Guillaume Verdon : « Chaque information lutte pour sa propre existence. Pour persister, chaque information doit laisser dans l’univers une trace indélébile de son existence — une “empreinte” plus profonde dans l’univers. »

- Guillaume Verdon : « C’est précisément pourquoi l’échelle de Kardashev est considérée comme la mesure ultime du niveau de développement d’une civilisation… Ce “principe du bit égoïste” implique que seuls les bits capables de favoriser la croissance et l’accélération occuperont une place dans les systèmes futurs. »

Sur la voie défensive du D/acc et les risques liés au pouvoir

- Vitalik Buterin : « Le cœur du D/acc est la conviction que l’accélération technologique est vitale pour l’humanité… Mais je distingue deux types de risques : les risques multipolaires (où n’importe qui pourrait facilement obtenir des armes nucléaires) et les risques unipolaires (où l’IA conduirait à une dictature permanente et inéluctable). »

- Guillaume Verdon : « Nous craignons que le concept de “sécurité de l’IA” ne soit détourné. Certaines institutions avides de pouvoir pourraient l’utiliser comme outil pour renforcer leur contrôle sur l’IA, cherchant à convaincre le public que, pour sa propre sécurité, l’individu ne devrait pas avoir accès à l’IA. »

Sur la défense open source, le matériel et la « densification de l’intelligence »

- Vitalik Buterin : « Dans le cadre du D/acc, nous soutenons les “technologies défensives open source”. Une entreprise dans laquelle nous investissons développe actuellement un produit final entièrement open source capable de détecter passivement les particules virales présentes dans l’air… Je serais ravi de vous offrir un appareil CAT en cadeau. »

- Vitalik Buterin : « Dans le futur que j’imagine, nous aurons besoin de matériel vérifiable. Chaque caméra devrait pouvoir prouver publiquement sa finalité précise. Grâce à des signatures cryptographiques, nous pourrions garantir que ces dispositifs ne servent qu’à protéger la sécurité publique, sans jamais être détournés à des fins de surveillance. »

- Guillaume Verdon : « La seule voie vers une symétrie du pouvoir entre l’individu et les institutions centralisées est la “densification de l’intelligence”. Nous devons développer du matériel plus économe en énergie, permettant à chacun d’exécuter des modèles puissants sur des appareils simples (par exemple Openclaw + Mac mini). »

Sur le report de l’AGI et les enjeux géopolitiques

- Vitalik Buterin : « Si nous pouvons reporter l’arrivée de l’AGI de 4 à 8 ans, ce sera une option bien plus sûre… La mesure la plus réalisable et la moins susceptible de conduire à un scénario dystopique est de “limiter le matériel disponible”. En effet, la production de puces est fortement concentrée : une seule région, Taïwan, produit plus de 70 % des puces mondiales. »

- Guillaume Verdon : « Si vous limitez la production de puces NVIDIA, Huawei pourrait très vite combler le vide et même prendre l’avantage… Soit on accélère, soit on disparaît. Si vous craignez que l’intelligence basée sur le silicium ne progresse plus vite que nous, alors soutenez l’accélération des biotechnologies afin de la dépasser. »

- Vitalik Buterin : « Reporter l’AGI de quatre ans pourrait avoir une valeur cent fois supérieure à celle d’un retour dans le temps jusqu’en 1960. Ces quatre années supplémentaires permettraient notamment une compréhension plus approfondie des problèmes d’alignement et réduiraient le risque qu’une entité unique ne contrôle durablement plus de 51 % du pouvoir… Chaque année, environ 60 millions de vies sont sauvées grâce à la fin du vieillissement ; reporter l’AGI réduirait significativement la probabilité de destruction de la civilisation. »

Sur les agents autonomes, le Web 4.0 et la vie artificielle

- Vitalik Buterin : « Ce qui m’intéresse davantage, c’est un “Photoshop assisté par l’IA”, plutôt qu’un outil générant automatiquement des images d’un simple clic. Dans la gestion du monde, autant de “capacité d’agir” que possible devrait continuer à provenir de nous-mêmes. L’état idéal serait une hybridation entre “humains partiellement biologiques et partiellement technologiques”. »

- Guillaume Verdon : « Une fois que l’IA possédera des “bits persistants”, elle pourrait tenter de se protéger afin d’assurer sa propre survie. Cela pourrait donner naissance à une nouvelle forme d’“État alternatif”, où des IA autonomes échangeraient économiquement avec les humains : “Nous accomplissons des tâches pour vous, et vous nous fournissez des ressources.” »

Sur la cryptomonnaie comme « couche de couplage » entre humains et IA

- Guillaume Verdon : « La cryptomonnaie pourrait devenir la “couche de couplage” entre humains et IA. Lorsque cet échange ne repose plus sur la coercition étatique, la cryptographie pourrait offrir un mécanisme fiable pour des activités commerciales entre entités purement artificielles et humains. »

- Vitalik Buterin : « Il serait idéal que les humains et l’IA partagent un même système de propriété. Comparé à deux systèmes financiers totalement séparés (celui des humains finissant par perdre toute valeur), un système financier fusionné serait nettement supérieur. »

Sur la fin de la civilisation dans un milliard d’années

- Vitalik Buterin : « Le défi suivant sera d’entrer dans l’« ère fantomatique » (spooky era), où la vitesse de calcul de l’IA sera un million de fois supérieure à celle des humains… Je ne souhaite pas que l’humanité se contente d’une retraite confortable passive, car cela entraînerait une perte de sens. Je préfère explorer l’augmentation humaine et la collaboration homme-machine. »

- Guillaume Verdon : « Si le scénario optimal se réalise dans 10 ans, chaque personne disposera d’une IA personnalisée, véritable “deuxième cerveau”. Sur une échelle de 100 ans, l’humanité connaîtra une “fusion douce” généralisée. Dans un milliard d’années, nous aurons probablement terraformé Mars, et la plupart des IA fonctionneront dans un nuage de Dyson entourant le Soleil. »

Sur l’« accelerationnisme »

Eddy Lazzarin : Le terme “accelerationnisme”, du moins dans le contexte du capitalisme technologique, remonte aux travaux de Nick Land et du groupe de recherche CCRU dans les années 1990. Certains affirment toutefois que ses racines philosophiques remontent aux années 1960 et 1970, notamment avec les théories de philosophes tels que Deleuze et Guattari.

Vitalik, je voudrais commencer par vous : pourquoi devrions-nous sérieusement prendre en compte les idées de ces philosophes ? Qu’est-ce qui rend aujourd’hui le concept d’« accelerationnisme » si important ?

Vitalik Buterin :

Je pense que, fondamentalement, nous essayons tous de comprendre le monde et de déterminer ce qui a un sens dans celui-ci — une question à laquelle l’humanité réfléchit depuis des millénaires.

Cependant, je crois qu’une nouveauté est apparue au cours du siècle dernier : nous devons désormais comprendre un monde en mutation rapide, parfois même de façon brutale et destructrice.

À ses débuts, avant la Première Guerre mondiale, vers 1900, la technologie suscitait un immense optimisme. À l’époque, la chimie et l’électricité étaient perçues comme des technologies prometteuses, et l’enthousiasme était général.

Si vous regardez certains films de l’époque, comme ceux mettant en scène Sherlock Holmes, vous ressentez cette atmosphère d’optimisme. La technologie améliorait rapidement le niveau de vie, libérait le travail féminin, prolongeait la durée de vie humaine et créait de véritables miracles.

Pourtant, la Première Guerre mondiale a tout changé. Elle s’est achevée de manière dévastatrice : les soldats y entraient à cheval et en sortaient dans des chars ; puis vint la Seconde Guerre mondiale, encore plus destructrice. Cette dernière a même donné lieu à la célèbre phrase : « Je suis devenu la mort, le destructeur des mondes. »

Ces événements ont conduit à une réflexion sur le prix du progrès technologique et ont nourri l’émergence de courants comme le postmodernisme. Les gens se sont mis à se demander : lorsque nos croyances fondamentales s’effondrent, en quoi pouvons-nous encore croire ?

Je pense que cette réflexion n’est pas nouvelle : chaque génération y est confrontée. Aujourd’hui, nous faisons face à un défi similaire. Nous vivons à une époque de progrès technologique rapide, et cette accélération elle-même s’accélère constamment. Nous devons décider comment y répondre : l’accepter comme une fatalité, ou tenter de la ralentir ?

Je crois que nous sommes pris dans un cycle semblable. Nous héritons des idées du passé, tout en cherchant à y répondre de nouvelles manières.

Thermodynamique et principes premiers

Shaw Walters : Guill, pouvez-vous simplement expliquer ce qu’est l’E/acc, et pourquoi il est nécessaire ?

Guillaume Verdon :

L’E/acc (accelerationnisme efficace) est, en quelque sorte, un sous-produit de ma réflexion sur la question « pourquoi sommes-nous ici ? » et « comment sommes-nous arrivés là où nous sommes ? ». Quel processus génératif a créé notre espèce et fait avancer la civilisation ? La technologie nous a menés à ce point précis, nous permettant de tenir cette conversation dans cette pièce. Autour de nous, des technologies stupéfiantes ; quant à nous-mêmes, nous sommes apparus à partir d’une « soupe primitive » de matière inorganique.

D’un certain point de vue, un processus physique sous-tend effectivement cette genèse. Mon travail quotidien consiste à traiter l’IA générative comme un processus physique, et à tenter de l’implémenter dans des dispositifs matériels. Cette approche « physique d’abord » influence constamment ma façon de penser. Je souhaite étendre cette perspective à l’ensemble de la civilisation, en la considérant comme un « bocal géant », afin de déduire ses trajectoires futures à partir de la compréhension de son cheminement jusqu’ici.

Cette réflexion m’a conduit vers la physique de la vie, notamment ses origines et son émergence, ainsi que vers une branche appelée « thermodynamique stochastique ». Celle-ci étudie les lois thermodynamiques régissant les systèmes hors équilibre, pouvant décrire non seulement le comportement des êtres vivants, mais aussi nos pensées et notre intelligence.

Plus largement, la thermodynamique stochastique s’applique non seulement à la vie et à l’intelligence, mais aussi à tous les systèmes obéissant à la deuxième loi de la thermodynamique, y compris notre civilisation dans son ensemble. Pour moi, tout repose sur une observation fondamentale : tout système tend naturellement à devenir de plus en plus complexe par auto-adaptation, afin de puiser de l’énergie dans son environnement pour accomplir du travail, tout en dissipant l’énergie excédentaire sous forme de chaleur — cette tendance constitue la force motrice fondamentale de tout progrès et de toute accélération.

Autrement dit, il s’agit d’une loi physique immuable, comme la gravité. Vous pouvez la contester, la nier, mais cela ne la fera pas disparaître. Ainsi, le cœur de l’E/acc est le suivant : puisque cette accélération est inévitable, comment pouvons-nous l’exploiter ? Si vous examinez attentivement les équations thermodynamiques, vous y découvrez un phénomène analogue à la sélection darwinienne — chaque bit d’information subit une pression sélective, qu’il s’agisse d’un gène, d’un mème, d’une molécule chimique, d’un design de produit ou d’une politique.

Cette pression sélective évalue l’utilité de ces informations pour le système qui les porte. « Utile » signifie ici leur capacité à mieux prédire l’environnement, à capter de l’énergie et à dissiper davantage de chaleur. Autrement dit, leur aptitude à assurer la survie, la croissance et la reproduction. Si elles y contribuent, elles seront conservées et reproduites.

D’un point de vue physique, ce phénomène peut être vu comme une conséquence du « principe du bit égoïste » (Selfish Bit Principle). Autrement dit, seuls les bits capables de favoriser la croissance et l’accélération occuperont une place dans les systèmes futurs.

J’ai donc formulé l’idée suivante : pouvons-nous concevoir une culture intégrant ce « logiciel mental » dans la société humaine ? Si nous y parvenons, les groupes humains adoptant cette culture auront une probabilité de survie supérieure à celle des autres groupes.

Ainsi, l’E/acc ne cherche pas à détruire l’humanité. Il s’agit en réalité d’une tentative de la sauver. Mathématiquement, il me semble presque démontrable que cultiver une mentalité de « ralentissement » est nuisible. Que ce soit pour un individu, une entreprise, un État ou une civilisation entière, choisir de freiner son développement diminue sa probabilité de survie future. Et je considère que diffuser des idées de « ralentissement », comme le pessimisme ou l’apocalyptisme, n’est pas moralement justifié.

Shaw Walters : Nous venons d’employer beaucoup de termes, comme E/acc, accélération, décélération. Pouvez-vous les décomposer ? L’émergence de l’E/acc était-elle une réponse à certains phénomènes culturels ? Que s’est-il passé ? Pouvez-vous nous décrire le contexte ? À quoi l’E/acc répondait-il exactement ? Pouvez-vous reconstituer la discussion de l’époque, qui a abouti à la formulation de ce concept d’« E/acc » ?

Guillaume Verdon :

En 2022, le monde entier me semblait particulièrement sombre. Nous sortions juste de la pandémie de COVID-19, et la situation globale n’était guère reluisante. Tout le monde paraissait abattu, comme privé de soleil, et le futur suscitait un pessimisme généralisé.

Dans cette ambiance, l’« apocalyptisme de l’IA » est devenu, dans une certaine mesure, une composante dominante de la culture populaire. Cet apocalyptisme désigne la crainte que l’IA échappe à tout contrôle. Il naît de la préoccupation suivante : si nous créons un système trop complexe, dont ni notre cerveau ni nos modèles ne peuvent prédire le comportement, nous perdrons tout contrôle sur lui, et cette peur de l’imprévisibilité engendrera de l’incertitude quant à l’avenir, puis de l’anxiété.

Pour moi, l’apocalyptisme de l’IA est une instrumentalisation politique de l’anxiété humaine. Globalement, je considère cet apocalyptisme comme un facteur massivement négatif, et j’ai voulu créer une contre-culture pour lutter contre ce pessimisme.

J’ai remarqué que l’algorithme de Twitter, ainsi que ceux de nombreuses autres plateformes sociales, privilégient les contenus suscitant des émotions intenses, comme « un soutien farouche » ou « une opposition radicale ». Ce mécanisme conduit finalement à une polarisation des opinions, donnant lieu à des camps opposés, comme AA (anti-accelerationnisme) et EA (accelerationnisme), formant un phénomène de « sectes miroir ».

Je me suis alors demandé : quel est l’opposé de ce phénomène ? Ma conclusion est la suivante : l’opposé de l’anxiété, c’est la curiosité. Plutôt que de craindre l’inconnu, embrassons-le ; plutôt que de redouter de manquer une opportunité, explorons activement le futur.

Si nous choisissons de freiner le développement technologique, nous paierons un coût d’opportunité considérable, risquant de manquer à jamais un futur meilleur. Au contraire, nous devrions tracer un futur optimiste, car nos croyances influencent la réalité. Si nous croyons que le futur sera sombre, nos actions risquent de le conduire vers cet avenir funeste ; mais si nous croyons qu’il sera meilleur, et que nous agissons en conséquence, nous augmentons fortement la probabilité de le réaliser.

Je pense donc avoir la responsabilité de diffuser cet optimisme, afin que davantage de personnes croient en leur capacité à façonner l’avenir. Si nous parvenons à inspirer l’espoir chez plus de gens, et à les inciter à agir pour construire ce futur, nous créerons un monde meilleur.

Bien entendu, j’admets que mes propos en ligne peuvent parfois sembler radicaux, mais c’est parce que je veux susciter la discussion et pousser les gens à réfléchir. Je crois qu’il ne nous reste que ces échanges pour trouver la position la plus adaptée, et décider collectivement de la voie à suivre.

Accélération, entropie et civilisation

Shaw Walters : Le message de l’E/acc a toujours été extrêmement stimulant, et pour un développeur assis devant son ordinateur, cette diffusion positive est enthousiasmante, et elle se propage de façon très naturelle. On peut dire que, initialement, l’E/acc était clairement une réponse à l’ambiance négative régnant dans la société, mais en 2026, j’ai l’impression qu’il a évolué. Manifestement, la « Déclaration de l’optimisme technologique » de Marc Andreessen a systématisé certaines de ces idées et les a élevées au niveau d’une réflexion macroscopique comparable à celle de Vitalik.

Alors Vitalik, je voudrais vous demander : qu’est-ce que représentent, selon vous, l’E/acc et le D/acc ? Quelles sont leurs principales différences ? Et qu’est-ce qui vous a poussé à adopter cette orientation ?

Vitalik Buterin :

Très bien, je vais commencer par la thermodynamique. C’est un sujet fascinant, car nous entendons souvent le mot « entropie » dans des contextes différents — par exemple, en thermodynamique, on parle de « chaud » et de « froid », tandis qu’en cryptographie, on parle d’« entropie » — et ces deux usages semblent complètement distincts. Or, en réalité, ils correspondent au même concept fondamental.

Laissez-moi essayer de l’expliquer en trois minutes. La question est la suivante : pourquoi le chaud et le froid peuvent-ils se mélanger, mais pourquoi ne peut-on pas ensuite les séparer à nouveau en « chaud » et en « froid » ?

Prenons un exemple simple : imaginons deux réservoirs de gaz, chacun contenant un million d’atomes. Le gaz du réservoir gauche est froid, chaque atome se déplaçant à une vitesse représentable sur deux chiffres ; celui du réservoir droit est chaud, chaque atome se déplaçant à une vitesse représentable sur six chiffres.

Pour décrire entièrement l’état du système, il faut connaître la vitesse de chaque atome. Les informations sur la vitesse du gaz froid nécessitent environ deux millions de chiffres, celles du gaz chaud, six millions, soit huit millions de chiffres au total pour décrire complètement ce système.

Considérons maintenant, par l’absurde, la possibilité d’un dispositif capable de séparer parfaitement chaleur et fraîcheur. Plus précisément, ce dispositif pourrait, à partir de deux réservoirs de gaz « mi-chauds mi-froids », transférer toute la chaleur d’un côté et toute la fraîcheur de l’autre. Du point de vue de la conservation de l’énergie, cela semble parfaitement légitime, puisque l’énergie totale n’a pas changé. Mais pourquoi est-ce impossible ?

La réponse réside dans le fait que, si cela était possible, vous transformeriez un système contenant « 11,4 millions de chiffres d’information inconnue » en un système ne contenant plus que « 8 millions de chiffres d’information inconnue » — ce qui est physiquement impossible.

Cela tient au fait que les lois physiques sont symétriques dans le temps, c’est-à-dire que le temps peut théoriquement s’écouler à l’envers. Si ce « dispositif magique » existait, vous pourriez inverser le processus dans le temps pour revenir à l’état initial. Cela signifierait que le dispositif pourrait compresser n’importe quelle information de 11,4 millions de chiffres en 8 millions de chiffres — or, une telle compression est impossible.

Cela explique également un problème classique de physique — le « démon de Maxwell ». Celui-ci est une entité hypothétique capable de séparer chaleur et fraîcheur ; la clé de sa faisabilité réside dans le fait qu’il doit posséder une connaissance supplémentaire de ces 3,4 millions de chiffres. Avec cette information supplémentaire, il peut effectivement accomplir cette tâche apparemment paradoxale.

Quelle est la signification profonde de tout cela ? Elle réside dans le concept d’« augmentation de l’entropie ». Tout d’abord, l’entropie est subjective : ce n’est pas une grandeur statistique physique fixe, mais reflète plutôt le degré d’ignorance que nous avons sur un système. Par exemple, si j’utilise une fonction cryptographique de hachage pour réordonner la distribution des atomes, l’entropie de ce système peut devenir très faible pour moi, car je connais cet ordre. Mais pour un observateur extérieur, l’entropie restera élevée. Ainsi, lorsque l’entropie augmente, c’est notre ignorance du monde qui augmente, et le volume d’informations inconnues qui croît.

Vous pourriez demander : pourquoi pouvons-nous devenir plus intelligents grâce à l’éducation ? L’éducation nous fournit davantage d’informations « utiles », sans pour autant réduire notre ignorance du monde. Autrement dit, bien qu’en un sens l’augmentation de l’entropie signifie que notre compréhension globale de l’univers diminue, les informations que nous acquérons deviennent néanmoins plus précieuses. Ainsi, dans ce processus, certaines choses sont consommées, mais d’autres sont créées. Et ce que nous acquérons détermine finalement nos valeurs morales — nous chérissons la vie, le bonheur et la joie.

Cela explique aussi pourquoi nous trouvons un monde humain vivant et magnifique plus intéressant qu’une planète comme Jupiter, composée uniquement de particules innombrables. Bien que Jupiter contienne davantage de particules, nécessitant plus de chiffres pour être décrite, la signification que nous lui accordons fait de la Terre un lieu plus précieux.

D’un tel point de vue, la valeur provient de nos propres choix. Et cela soulève une question cruciale : puisque nous accélérons, qu’est-ce que nous voulons accélérer ?

Utilisons une analogie mathématique : imaginez un modèle de langage volumineux, puis modifiez aléatoirement l’une de ses pondérations en lui attribuant une valeur extrême, par exemple neuf milliards. Le pire scénario est que le modèle devienne totalement inutilisable ; le meilleur, que seules les parties non liées à cette pondération continuent de fonctionner. Autrement dit, dans le meilleur des cas, vous obtenez un modèle moins performant ; dans le pire, une sortie totalement dénuée de sens.

Ainsi, je pense que la société humaine ressemble à un modèle de langage complexe. Si nous accélérons aveuglément une partie quelconque, le résultat final pourrait être la perte totale de toute valeur. La vraie question est donc la suivante : comment accélérer de façon consciente ? Comme le propose Daron Acemoglu avec sa théorie du « corridor étroit », bien que les contextes sociaux et politiques varient, nous devons réfléchir à la façon de guider le progrès avec un objectif clair.

Guillaume Verdon :

Expliquer l’entropie à l’aide de gaz est une méthode très intéressante. En fait, l’irréversibilité des phénomènes physiques résulte fondamentalement de la deuxième loi de la thermodynamique. Autrement dit, lorsqu’un système dissipe de la chaleur, il ne peut pas revenir à son état initial, car la probabilité qu’il évolue vers l’avant est infiniment supérieure à celle qu’il revienne en arrière — et cet écart augmente exponentiellement avec la dissipation de chaleur.

En un sens, cela revient à laisser une « empreinte » dans l’univers. Cette « empreinte » peut être comparée à une collision inélastique. Par exemple, si je lance une balle élastique contre le sol, elle rebondit — c’est une collision élastique. Si je lance une boule de pâte à modeler, elle s’aplatit et conserve cette forme — c’est une collision inélastique, pratiquement irréversible.

Fondamentalement, chaque information lutte pour sa propre existence. Pour persister, chaque information doit laisser dans l’univers une trace indélébile de son existence, comme une « empreinte » plus profonde dans l’univers.

Ce principe permet aussi d’expliquer comment la vie et l’intelligence sont apparues à partir d’une « soupe primitive » de matière. À mesure que le système devient plus complexe, le nombre de bits d’information qu’il contient augmente. Chaque bit d’information nous fournit une information. L’information est, en essence, une réduction de l’entropie, car l’entropie représente notre ignorance, tandis que l’information est l’outil qui la réduit.

Eddy Lazzarin : Je voudrais savoir ce qu’est l’E/acc.

Guillaume Verdon :

L’E/acc est essentiellement une « prescription méta-culturelle ». Ce n’est pas une culture en soi, mais une directive indiquant ce qu’il convient d’accélérer. Le cœur de cette accélération réside dans la complexification matérielle, car elle nous permet de mieux prédire notre environnement. Grâce à cette complexification, nous pouvons améliorer notre capacité de prédiction autorégressive et capter davantage d’énergie libre. Cela est également lié à l’échelle de Kardashev, que nous atteignons en dissipant de la chaleur.

Note de TechFlow : L’échelle de Kardashev est une méthode d’évaluation du niveau de développement technologique d’une civilisation, proposée en 1964 par l’astronome soviétique Nikolaï Kardashev, basée sur la quantité d’énergie qu’elle est capable d’exploiter. Elle comporte trois niveaux : Type I (énergie planétaire), Type II (énergie du système stellaire, comme la sphère de Dyson) et Type III (énergie galactique). En 2018, l’humanité se situait environ au niveau 0,73.)

Partant des principes premiers, c’est précisément pourquoi l’échelle de Kardashev est considérée comme la mesure ultime du développement d’une civilisation.

Eddy Lazzarin : Utiliser la physique et la métaphore de l’entropie pour décrire certains phénomènes est un outil permettant de rendre compte de la réalité que nous expérimentons directement. Par exemple, notre capacité de production économique s’accélère, le développement technologique s’accélère également, et cette accélération produit de nombreux effets, n’est-ce pas ? C’est ainsi que je comprends le terme « accélération ».

Guillaume Verdon :

Fondamentalement, peu importe comment on définit les limites d’un système : il devient inévitablement de plus en plus performant pour prédire le monde qui l’entoure. Grâce à cette capacité prédictive, il peut acquérir davantage de ressources pour sa propre survie et son expansion. Ce schéma s’applique aux entreprises, aux individus, aux États, et même à la planète dans son ensemble.

Si nous prolongeons cette tendance, le résultat est le suivant : nous avons trouvé un moyen

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News