Données Anthropic : près de la moitié des appels aux agents IA sont concentrés dans le domaine du génie logiciel ; ces 16 domaines spécialisés restent encore des marchés porteurs.

TechFlow SélectionTechFlow Sélection

Données Anthropic : près de la moitié des appels aux agents IA sont concentrés dans le domaine du génie logiciel ; ces 16 domaines spécialisés restent encore des marchés porteurs.

La santé représente 1 %, le droit 0,9 % et l’éducation 1,8 %. Ce ne sont pas des marchés saturés, mais des marchés qui n’existent presque pas encore.

Auteur : Garry's List

Traduction et adaptation : TechFlow

Introduction de TechFlow : Anthropic vient de publier la plus complète étude à ce jour sur l’utilisation réelle des agents IA. Le chiffre clé ? L’ingénierie logicielle représente près de 50 % des appels aux outils d’agents IA, tandis que les 16 secteurs verticaux combinés — santé, droit, éducation, etc. — représentent moins de la moitié du reste, chacun restant inférieur à 5 %.

Ce n’est pas un signe de saturation du marché, mais bien une carte des 300 licornes IA verticales en puissance. Encore plus révélateur est une découverte contre-intuitive citée dans cet article : les modèles sont désormais capables de fonctionner de manière autonome pendant près de cinq heures, alors que les utilisateurs ne leur accordent en pratique que 42 minutes — ce « déficit de confiance » constitue en soi la prochaine opportunité produit.

Texte intégral :

L’ingénierie logicielle représente près de 50 % de tous les appels aux outils d’agents IA. Les 16 secteurs verticaux — santé, droit, finance, etc. — sont presque totalement inexploités, aucun ne dépassant les 5 %. Cela signifie qu’il y a 300 licornes IA verticales en attente d’être créées.

Si je devais aujourd’hui lancer une entreprise, je fixerais du regard la zone rouge de ce diagramme en barres jusqu’à y voir mon avenir.

Aaron Levie, fondateur de Box, déclare :

Ce graphique nous rappelle efficacement à quel point le domaine des agents IA recèle encore d’opportunités aujourd’hui.

Bien entendu, de nombreuses opportunités existent à l’horizontale, mais de nombreux flux de travail exigent également une expertise approfondie dans un domaine spécifique afin d’automatiser réellement les processus uniques propres à chaque secteur vertical.

Le modèle à suivre est le suivant : développer un logiciel agent connecté à des données propriétaires, conçu pour intégrer efficacement l’agent dans les workflows collaboratifs avec les utilisateurs, doté d’une capacité avancée d’ingénierie contextuelle spécialisée dans le domaine concerné, ainsi que d’une capacité à accompagner les clients dans la gestion du changement.

De nombreux domaines demeurent aujourd’hui largement vierges.

L’ingénierie logicielle occupe la moitié de toutes les activités liées aux agents IA. L’autre moitié est dispersée parmi 16 secteurs verticaux, aucun ne dépassant les 9 %. La santé représente 1 %, le droit 0,9 %, l’éducation 1,8 %. Il ne s’agit pas de marchés saturés, mais bien de marchés quasi inexistants.

Anthropic vient de publier la plus complète étude à ce jour sur l’utilisation réelle des agents IA. La principale découverte est la suivante : l’ingénierie logicielle représente 49,7 % des appels aux outils d’agents effectués via son API. La conclusion fondamentale, moins immédiatement apparente, est que tout le reste constitue un océan bleu.

Décalage entre déploiement et capacité

Un chiffre devrait particulièrement enthousiasmer les entrepreneurs : les capacités des modèles dépassent déjà largement les limites de confiance accordées par les utilisateurs.

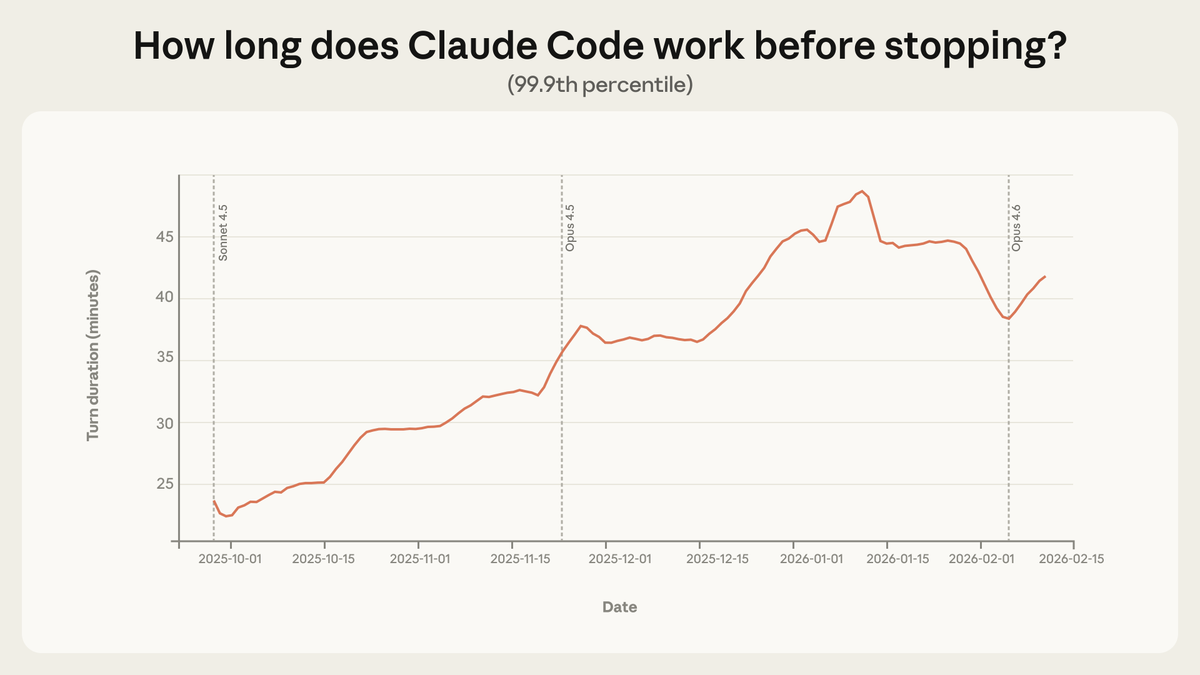

Les évaluations de capacités menées par METR montrent que Claude peut résoudre des tâches nécessitant près de cinq heures de travail humain. En pratique toutefois, la durée de session au 99,9e centile ne dépasse que 42 minutes environ. Cet écart — entre ce que l’IA est capable de faire et ce que nous lui autorisons effectivement de faire — constitue une immense opportunité.

Graphique : la durée maximale d’entraînement de Claude Code a presque doublé en trois mois. Cela améliore non seulement ses capacités, mais renforce aussi la confiance.

Source :x.com

Entre octobre 2025 et janvier 2026, la durée de session au 99,9e centile a presque doublé, passant de moins de 25 minutes à plus de 45 minutes. Cette croissance est régulière à travers toutes les versions du modèle. Il ne s’agit pas seulement d’un renforcement des capacités du modèle, mais aussi d’un apprentissage progressif des utilisateurs, qui étendent graduellement leur confiance dans l’agent.

« Entre août et décembre, le taux de réussite de Claude Code sur les tâches les plus complexes rencontrées par ses utilisateurs internes a doublé, tandis que le nombre d’interventions humaines par session est passé de 5,4 à 3,3. »

Les capacités sont déjà là ; le déploiement n’a pas encore suivi. Ce n’est pas un problème, mais une opportunité produit.

L’évolution de la confiance

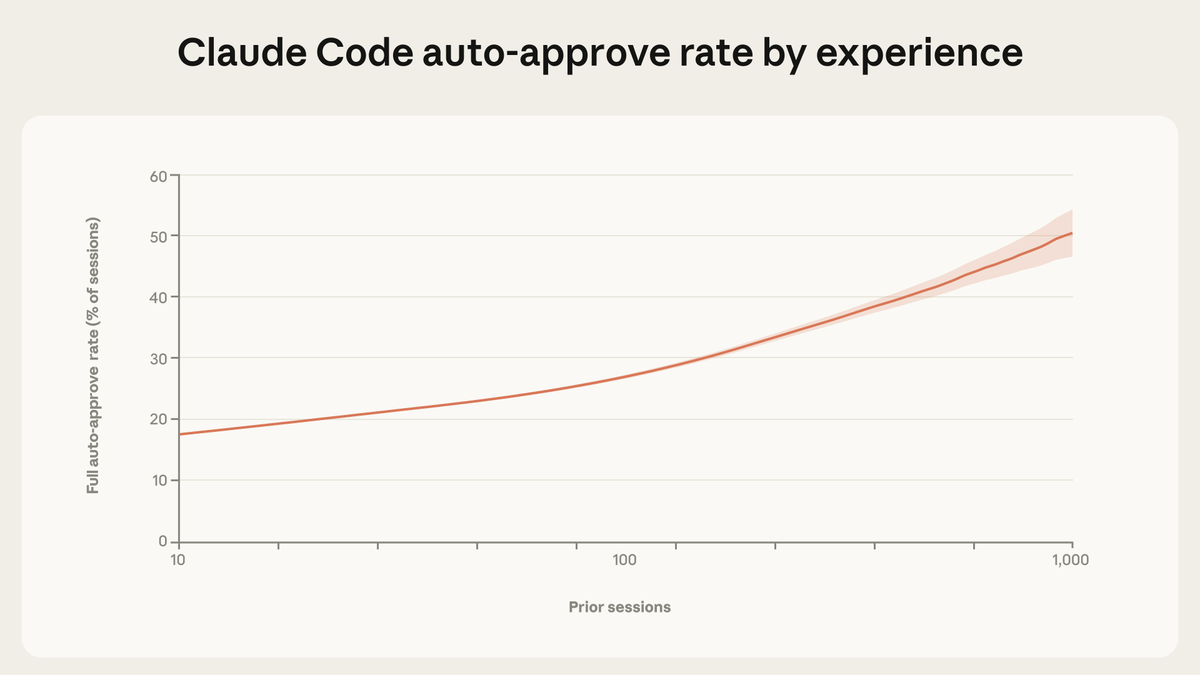

20 % des nouveaux utilisateurs approuvent automatiquement les actions de Claude Code. Après 750 sessions, plus de 40 % des sessions s’exécutent entièrement en mode d’approbation automatique. Mais une découverte contre-intuitive émerge : les utilisateurs expérimentés interviennent davantage, et non moins. Les débutants interviennent dans 5 % des tours d’échange, contre 9 % pour les utilisateurs chevronnés.

Graphique : la confiance est une compétence qui s’accumule progressivement. 20 % des nouvelles sessions sont automatiquement approuvées ; ce taux dépasse 40 % après 750 sessions.

Image : Anthropic

Source : x.com

Cela ne contredit pas la tendance, mais reflète une évolution de la stratégie de supervision. Les débutants approuvent progressivement chaque action avant son exécution, tandis que les utilisateurs expérimentés délèguent d’abord puis interviennent uniquement en cas de problème — ils ont donc évolué d’une approbation préalable vers une surveillance proactive.

Voici une observation particulièrement intéressante sur le plan de la sécurité : sur des tâches complexes, Claude Code demande spontanément des précisions deux fois plus souvent que les utilisateurs n’interviennent activement. L’agent s’interrompt pour confirmer, plutôt que de foncer tête baissée. C’est une caractéristique, non un défaut.

« La principale leçon tirée de cette étude est la suivante : l’autonomie exercée par les agents dans la pratique est coconstruite par le modèle, l’utilisateur et le produit. Lorsqu’il est incertain, Claude s’interrompt pour poser des questions, limitant ainsi son autonomie. Au fil de leur collaboration avec le modèle, les utilisateurs construisent progressivement leur confiance et ajustent en conséquence leur propre stratégie de supervision. »

L’approche verticale de Levie en matière d’IA

Aaron Levie souligne la richesse et la valeur considérables en attente d’être libérées : concevoir un logiciel agent connecté à des données propriétaires, véritablement capable de résoudre des problèmes humains réels ; remplir abondamment le contexte afin de maximiser la qualité des sorties intelligentes ; et — élément trop souvent négligé par les entrepreneurs — accompagner activement les clients dans la gestion du changement organisationnel.

Ce dernier point est précisément ce qui rend si difficile la reproduction d’une solution IA verticale. N’importe qui peut encapsuler une API, mais très peu savent réellement maîtriser les workflows spécifiques, les contraintes réglementaires et les résistances organisationnelles propres à la facturation médicale, à la découverte juridique ou à l’obtention de permis de construire.

Le marché SaaS a connu une croissance d’un facteur dix tous les dix ans ces dernières décennies. Au cours des vingt dernières années, plus de 40 % des fonds de capital-risque ont été alloués à des entreprises SaaS. Ce secteur a vu naître plus de 170 licornes SaaS. La logique est simple : chacune de ces licornes possède une version IA verticale en puissance. Et cette version IA pourrait être dix fois plus grande, car elle remplace non seulement des logiciels, mais aussi des opérateurs humains.

La nature de la coconstruction

La découverte centrale d’Anthropic mérite une attention particulière de la part de tous ceux qui participent à l’élaboration des politiques publiques en matière d’IA. L’autonomie n’est pas une propriété intrinsèque du modèle, mais bien le fruit d’une coconstruction impliquant le modèle, l’utilisateur et le produit. Une évaluation préalable au déploiement ne permet pas de saisir cette dynamique : il faut nécessairement la mesurer dans l’usage réel.

Anthropic déclare officiellement :

L’ingénierie logicielle représente environ 50 % des appels aux outils d’agents effectués via notre API, mais nous observons également l’émergence d’autres secteurs. À mesure que les frontières du risque et de l’autonomie continuent de s’étendre, la surveillance post-déploiement devient cruciale. Nous encourageons les autres développeurs de modèles à étendre cette recherche.

Les chiffres relatifs à la sécurité sont rassurants : 73 % des appels aux outils impliquent un humain dans la boucle, et seuls 0,8 % des opérations sont irréversibles. Les scénarios de déploiement à risque maximal — tels que la fuite de clés API ou les transactions cryptographiques autonomes — relèvent majoritairement d’évaluations de sécurité, et non d’environnements de production réels.

« Des exigences réglementaires imposant des modes d’interaction précis — par exemple obliger une validation humaine à chaque opération — ne feront qu’ajouter des frictions, sans nécessairement améliorer la sécurité. »

Une politique exigeant systématiquement « l’approbation de chaque opération » détruirait les gains de productivité sans accroître la sécurité. Un objectif plus pertinent consiste à garantir la capacité des humains à surveiller et intervenir, plutôt que de prescrire des workflows d’approbation précis.

Où se cachent les licornes ?

La carte est tracée. L’ingénierie logicielle est déjà couverte. Santé, droit, finance, éducation, service client, logistique — les 16 secteurs verticaux, chacun détenant une part de marché à un seul chiffre — attendent simplement que quelqu’un intègre une expertise sectorielle authentique dans un agent.

Jusqu’ici, 300 licornes SaaS sont nées ; les 300 prochaines licornes IA verticales sont sur le point d’émerger. Les fondateurs qui choisiront un secteur vertical précis, y intégreront une expertise métier profonde dans leurs agents, et sauront comment piloter efficacement la gestion du changement, domineront le marché des logiciels d’entreprise au cours de la prochaine décennie.

Les modèles peuvent déjà travailler cinq heures, mais les utilisateurs ne leur en accordent que 42 minutes. Voilà le signal : nous sommes encore à un stade extrêmement précoce, avec une multitude de choses à construire — et cela dans d’innombrables domaines où l’intelligence n’a même pas encore eu l’occasion de fonctionner une seule minute.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News