Gradients: Cơ sở hạ tầng huấn luyện AI phi tập trung trong hệ sinh thái Bittensor

Tuyển chọn TechFlowTuyển chọn TechFlow

Gradients: Cơ sở hạ tầng huấn luyện AI phi tập trung trong hệ sinh thái Bittensor

Gradients đã bổ sung cơ sở hạ tầng huấn luyện trong hệ sinh thái TAO và đang khám phá một mô hình mới mang tên “tối ưu hóa AI do thị trường thúc đẩy”, về lâu dài có tiềm năng phát triển thành lớp cổng quan trọng cho việc huấn luyện AI phi tập trung.

Nguồn: Viện Nghiên cứu CoinW

Tóm tắt

Gradients là một mạng con huấn luyện AI phi tập trung (SN56) được xây dựng trên nền tảng Bittensor, với trọng tâm là biến quy trình huấn luyện mô hình—một quy trình kỹ thuật phức tạp—thành một quá trình hợp tác mạng lưới do thị trường điều tiết thông qua các cơ chế như “đăng tải nhiệm vụ, thợ mỏ cạnh tranh, xác thực và sàng lọc”. Về mặt kiến trúc, Gradients kết hợp AutoML với sức mạnh tính toán phân tán để hình thành một thị trường huấn luyện lấy cơ chế khuyến khích làm trung tâm, không chỉ giảm rào cản tiếp cận AI mà còn nâng cao hiệu suất sử dụng tài nguyên tính toán. Nhìn từ góc độ hệ sinh thái và dữ liệu thực tế, Gradients đã hoàn tất việc xây dựng mạng lưới cơ bản, tuy nhiên mức độ khuyến khích và dòng vốn đầu vào hiện vẫn còn hạn chế. Gradients lấp đầy khoảng trống về cơ sở hạ tầng huấn luyện trong hệ sinh thái TAO và đang khám phá một mô hình mới mang tên “tối ưu hóa AI do thị trường điều tiết”, từ đó có tiềm năng dài hạn trở thành lớp cổng vào quan trọng cho lĩnh vực huấn luyện AI phi tập trung.

1. Từ AutoML Web2 đến: Hiện trạng và hạn chế của huấn luyện AI

1.1 AutoML là gì?

Theo nhận thức truyền thống, việc huấn luyện một mô hình AI là một công việc có ngưỡng kỹ thuật rất cao, đòi hỏi kỹ sư phải xử lý dữ liệu, lựa chọn mô hình, điều chỉnh tham số lặp đi lặp lại, đồng thời đánh giá hiệu quả — toàn bộ quá trình vừa phức tạp vừa tốn nhiều thời gian. Trong khi đó, AutoML (Học máy tự động) ra đời nhằm tự động hóa toàn bộ những bước thủ công này. Có thể hiểu AutoML như một “công cụ tự động xây dựng mô hình”: người dùng chỉ cần cung cấp dữ liệu và nêu rõ mục tiêu mong muốn (ví dụ như phân loại, dự báo hay nhận dạng), còn lại các công đoạn như lựa chọn mô hình, điều chỉnh tham số và tối ưu huấn luyện đều do hệ thống thực hiện tự động. Nhờ đó, AI dần chuyển mình từ một công cụ dành riêng cho giới kỹ sư chuyên nghiệp thành một năng lực có thể được sử dụng bởi cả nhà phát triển phổ thông lẫn doanh nghiệp — đây là một bước tiến quan trọng trên hành trình phổ cập AI.

1.2 Hạn chế cốt lõi của AutoML truyền thống

Các giải pháp AutoML phổ biến hiện nay chủ yếu tập trung tại các nền tảng của nhà cung cấp điện toán đám mây như Google Vertex AI và AWS SageMaker — nơi cung cấp dịch vụ “huấn luyện AI như một dịch vụ” (AI Training-as-a-Service). Dù AutoML Web2 đã làm giảm đáng kể rào cản tiếp cận AI, mô hình nền tảng vẫn tồn tại những hạn chế rõ ràng. Thứ nhất là vấn đề tập trung hóa: tài nguyên tính toán, cơ chế định giá và quy tắc vận hành đều do nền tảng kiểm soát, khiến người dùng phụ thuộc mạnh vào một nhà cung cấp duy nhất và thiếu khả năng thương lượng. Thứ hai là chi phí cao và thiếu minh bạch: tài nguyên GPU thiết yếu cho huấn luyện AI chủ yếu nằm trong tay các nhà cung cấp đám mây, trong khi cơ chế giá lại thiếu sự cạnh tranh thị trường. Quan trọng hơn cả là hiệu suất tối ưu bị giới hạn. Bản chất AutoML truyền thống vẫn là “một hệ thống tìm nghiệm tối ưu giúp bạn”, bất kể hệ thống đó phức tạp đến đâu, cũng chỉ thuộc về tối ưu theo một đường dẫn kỹ thuật duy nhất. Không gian khám phá của nó là hữu hạn, gần như không thể cùng lúc thử nghiệm nhiều hướng tiếp cận hoàn toàn khác biệt. Do đó, huấn luyện AI Web2 hiện tại là một “hệ thống khép kín”, trong đó mọi công đoạn — huấn luyện, tối ưu và phân bổ tài nguyên — đều diễn ra bên trong môi trường do một nền tảng duy nhất kiểm soát. Mô hình này dù hiệu quả, nhưng ranh giới của nó đang dần lộ rõ khi nhu cầu ngày càng gia tăng.

2. Gradients: Tái cấu trúc huấn luyện AI bằng “mạng lưới”

2.1 Gradients là gì: Một nền tảng AutoML phi tập trung

Ở chương trước, chúng ta đã nêu rằng vấn đề cốt lõi của AutoML Web2 truyền thống nằm ở “hệ thống khép kín”: việc huấn luyện mô hình phụ thuộc vào nền tảng, đường dẫn tối ưu bị giới hạn và luồng tài nguyên bị bóp nghẹt. Gradients chính là sự tái cấu trúc đối với mô hình này. Gradients bắt nguồn từ cộng đồng kỹ sư phi tập trung do WanderingWeights khởi xướng, được xây dựng trên mạng Bittensor và hoạt động như một mạng con huấn luyện AI trên Subnet 56. Khác với các nền tảng truyền thống, Gradients không cung cấp dịch vụ tập trung, mà chia nhỏ quy trình huấn luyện và giao phó cho một mạng lưới mở thực hiện. Người dùng chỉ cần xác định mục tiêu nhiệm vụ (ví dụ như loại mô hình và dữ liệu đầu vào), còn lại toàn bộ các công đoạn như thực thi huấn luyện, tối ưu tham số và sàng lọc kết quả đều do mạng lưới tự động hoàn tất. Theo mô hình này, huấn luyện AI được trừu tượng hóa từ một quy trình kỹ thuật phức tạp thành một quy trình đơn giản: “gửi yêu cầu – nhận kết quả”, gần giống một năng lực phổ quát hơn là một công việc kỹ thuật có ngưỡng chuyên môn cực cao.

2.2 Từ hệ thống khép kín sang hợp tác mở: Gradients giải quyết vấn đề gì?

Sự thay đổi cốt lõi của Gradients nằm ở việc biến quy trình huấn luyện—trước đây bị khóa chặt bên trong một nền tảng duy nhất—thành một quá trình hợp tác mở trên mạng lưới. Nhiệm vụ huấn luyện không còn do một hệ thống đơn lẻ đảm nhiệm, mà được phân phối cho nhiều bên tham gia cùng thực hiện song song, sau đó sàng lọc ra kết quả tối ưu thông qua một cơ chế đánh giá thống nhất. Cấu trúc này đầu tiên làm giảm sự phụ thuộc vào nhà cung cấp dịch vụ tập trung, đặt nền tảng huấn luyện lên tài nguyên tính toán phân tán; đồng thời, các tài nguyên GPU phân tán được tích hợp vào cùng một mạng lưới, tạo nên cách phân bổ tài nguyên gần với cơ chế thị trường hơn nhờ cạnh tranh. Quan trọng hơn, việc tối ưu mô hình không còn bị giới hạn trong một đường dẫn duy nhất, mà liên tục tiến gần tới nghiệm tối ưu hơn thông qua việc khám phá song song nhiều phương pháp khác nhau — từ đó nâng cao trần tối ưu tổng thể.

2.3 Thay đổi bản chất: Từ công cụ thành “thị trường huấn luyện”

Trong AutoML truyền thống, nền tảng giống như một công cụ: sử dụng các thuật toán nội bộ để giúp người dùng tìm nghiệm tối ưu. Còn trong Gradients, quá trình này gần giống một “thị trường” vận hành liên tục: người dùng đăng tải yêu cầu, các bên tham gia cạnh tranh xoay quanh cùng một nhiệm vụ, và kết quả được sàng lọc thông qua cơ chế đánh giá. Như vậy, hiệu năng mô hình không còn phụ thuộc vào năng lực của một hệ thống duy nhất, mà xuất phát từ sự cạnh tranh và lặp lại liên tục giữa nhiều bên. AutoML do đó chuyển mình từ một bài toán tối ưu kỹ thuật tương đối khép kín thành một quá trình động do cơ chế khuyến khích điều tiết, khiến năng lực tối ưu có thể mở rộng không ngừng khi số lượng người tham gia tăng lên. Sự thay đổi này khiến huấn luyện AI bắt đầu mang đặc trưng tự tiến hóa giống như một thị trường.

2.4 Vai trò trong hệ sinh thái TAO: Lớp cơ sở hạ tầng huấn luyện AI

Trong hệ thống mạng con (subnet) của Bittensor, các subnet khác nhau đảm nhiệm các chức năng như suy luận (inference), xử lý dữ liệu và huấn luyện (training), trong khi Gradients nằm ở lớp huấn luyện. Nó chịu trách nhiệm chuyển đổi tài nguyên tính toán phân tán thành sản phẩm mô hình thực tế, đồng thời thông qua cơ chế phân phối nhiệm vụ và đánh giá để đảm bảo các tài nguyên này được lập lịch và tối ưu hóa liên tục. Đồng thời, Gradients kết nối cả phía cung cấp tài nguyên tính toán và phía nhu cầu mô hình, biến quá trình huấn luyện — vốn từng chỉ là một hoạt động tiêu tốn tài nguyên — thành một quá trình hợp tác mạng lưới có thể tổ chức và tối ưu hóa. Trong hệ thống này, Gradients giống như một mắt xích trung tâm, chuyển đổi tài nguyên phân tán thành năng lực AI có thể sử dụng và hỗ trợ sự phát triển của các ứng dụng cấp cao hơn.

3. Kiến trúc cốt lõi: Huấn luyện AI được thực hiện như thế nào trên mạng lưới?

Ở chương trước, chúng ta đã nêu rằng Gradients chuyển đổi huấn luyện AI từ “thực hiện bên trong nền tảng” sang “hoàn tất thông qua hợp tác mạng lưới”. Vậy mạng lưới này cụ thể vận hành ra sao? Chương này sẽ phân tích chi tiết và trực quan quá trình này.

3.1 Huấn luyện phân tán: Một nhiệm vụ được “nhiều người cùng thực hiện” như thế nào?

Hãy tưởng tượng Gradients như một “mạng lưới hợp tác huấn luyện” vận hành liên tục. Khi người dùng gửi một nhiệm vụ huấn luyện, nhiệm vụ này sẽ không được giao cho một hệ thống duy nhất thực hiện, mà đồng thời được phân phối cho nhiều bên tham gia trong mạng lưới. Các bên này sẽ dựa trên cùng một bộ dữ liệu và mục tiêu để thử nghiệm các phương pháp huấn luyện khác nhau, rồi nộp kết quả trong khung thời gian quy định. Sau đó, hệ thống sẽ đánh giá thống nhất các kết quả này và chọn ra phương án tốt nhất. Cuối cùng, phương án đạt hiệu năng vượt trội sẽ nhận được phần thưởng, còn các phương án còn lại bị loại bỏ. Từ góc nhìn người dùng, toàn bộ quá trình chỉ cần khởi tạo một lần, tương đương với việc “kích hoạt” đồng thời nhiều hướng tư duy tối ưu khác nhau và tự động chọn ra nghiệm tối ưu. Chìa khóa của cách tiếp cận này không nằm ở độ mạnh của từng nút riêng lẻ, mà ở việc kết hợp thử nghiệm song song của nhiều bên với sàng lọc tự động để đưa kết quả ngày càng tiến gần tới nghiệm tối ưu.

Trong mạng lưới này, có ba nhóm người tham gia chính: người dùng, thợ mỏ và người xác thực. Người dùng chịu trách nhiệm đưa ra yêu cầu huấn luyện; thợ mỏ cung cấp tài nguyên tính toán và thử nghiệm các phương pháp huấn luyện khác nhau; người xác thực đánh giá kết quả và lựa chọn mô hình tối ưu. Sự phân công này giúp quá trình huấn luyện vận hành liên tục và không ngừng cải thiện kết quả. Tổng thể, đây là một mạng lưới hợp tác được thúc đẩy bởi “nhu cầu – cung – đánh giá”.

3.2 AutoML do thị trường điều tiết

Qua việc phân tích cơ chế ở phần trước, ta thấy Gradients không đơn thuần là việc “chuyển AutoML lên blockchain”, mà thực chất là thay đổi logic nền tảng của việc tối ưu mô hình thông qua việc đưa vào sự tham gia đa phương và cơ chế khuyến khích. Trong khi AutoML truyền thống phụ thuộc vào một hệ thống duy nhất để tìm nghiệm tối ưu trong một không gian đường dẫn hạn chế, thì ở Gradients, quá trình này được mở rộng ra toàn bộ mạng lưới: các bên tham gia khác nhau liên tục thử nghiệm nhiều phương pháp khác nhau cho cùng một nhiệm vụ, đồng thời sàng lọc và lặp lại thông qua đánh giá thống nhất. Điều này khiến việc tối ưu mô hình không còn là một phép tính một lần, mà trở thành một quá trình động có thể tiến hóa liên tục. Trong cơ chế này, kết quả đạt hiệu năng cao hơn sẽ nhận được lợi ích lớn hơn, từ đó thu hút liên tục các bên tham gia cải tiến chiến lược và thúc đẩy hiệu quả tổng thể không ngừng nâng cao.

4. Cơ chế khuyến khích và cạnh tranh: Làm thế nào để huấn luyện AI hình thành “vòng tuần hoàn tích cực”?

4.1 Cơ chế khuyến khích (do TAO điều tiết): Từ hành vi huấn luyện đến lợi nhuận thực tế

Chìa khóa giúp Gradients vận hành bền vững lâu dài nằm ở cơ chế khuyến khích nền tảng. Điều này phụ thuộc vào hệ thống khuyến khích gốc do Bittensor cung cấp. Trong đó, TAO là đồng tiền gốc của mạng Bittensor, đóng vai trò là “phương tiện lưu trữ giá trị” trong toàn mạng: một mặt dùng để thưởng cho những người đóng góp tài nguyên tính toán và mô hình, mặt khác cũng tham gia phân bổ trọng số mạng con thông qua cơ chế ký quỹ (staking), ảnh hưởng đến cách tài nguyên được phân bổ giữa các mạng con khác nhau.

Mạng chính Bittensor liên tục tạo ra phần thưởng mới (Emission) dưới dạng TAO (hiện tại khoảng 3600 TAO mỗi ngày), và phân bổ theo quy tắc nhất định cho các mạng con khác nhau. Số lượng TAO mỗi mạng con nhận được phụ thuộc vào “hiệu suất” của mạng con đó trong toàn mạng, ví dụ như mức độ hoạt động, chất lượng đóng góp và tình hình hỗ trợ tài chính. Đối với mạng con của Gradients, phần TAO được phân bổ này sẽ được phân phối lại nội bộ cho các bên tham gia. Tiêu chí phân bổ cốt lõi là: ai đóng góp mô hình tốt hơn thì nhận được phần thưởng nhiều hơn.

Cụ thể hơn, thợ mỏ nộp kết quả huấn luyện, còn người xác thực chịu trách nhiệm kiểm tra và chấm điểm các kết quả này. Hệ thống sẽ tính toán “trọng số đóng góp” cho từng bên dựa trên điểm số, sau đó phân bổ phần thưởng theo trọng số đó. Mô hình đạt hiệu năng cao hơn (ví dụ như khả năng tổng quát mạnh hơn, hiệu quả ổn định hơn) sẽ nhận được lợi ích lớn hơn; còn người xác thực nếu chấm điểm chính xác hơn, phản ánh đúng hơn chất lượng thực tế, cũng sẽ nhận được phần thưởng cao hơn. Thiết kế này đảm bảo rằng “làm tốt hơn” trực tiếp tương ứng với “kiếm được nhiều hơn”, từ đó thúc đẩy các bên liên tục cải tiến mô hình.

4.2 Cạnh tranh giữa các mạng con: Không chỉ cạnh tranh nội bộ, mà còn xếp hạng ngang hàng

Bên cạnh cạnh tranh nội bộ mạng con, Gradients còn phải đối mặt với “cạnh tranh ngang hàng” trong toàn bộ mạng Bittensor. Vì việc phân bổ TAO là động, nên các mạng con sẽ cạnh tranh để giành được trọng số cao hơn. Chỉ những mạng con nào liên tục tạo ra kết quả chất lượng cao và thu hút ngày càng nhiều người tham gia mới có thể chiếm được phần thưởng lớn hơn. Do đó, mức độ khuyến khích dành cho Gradients không chỉ phụ thuộc vào hiệu suất mô hình nội bộ, mà còn phụ thuộc vào khả năng cạnh tranh tương đối của nó trong toàn hệ sinh thái. Toàn bộ hệ thống vì thế hình thành một vòng tuần hoàn đa cấp: nội bộ mạng con có cạnh tranh giữa các mô hình; giữa các mạng con có cạnh tranh về hiệu suất tổng thể. Cuối cùng, việc đầu tư tài nguyên tính toán, hiệu quả mô hình và lợi nhuận kinh tế được gắn kết chặt chẽ với nhau, tạo thành một cơ chế phản hồi tích cực vận hành liên tục.

4.3 Gradients 5.0: Từ cạnh tranh sang “cơ chế giải đấu”

Dựa trên nền tảng cạnh tranh liên tục ban đầu, Gradients tiếp tục phát triển thành một cơ chế có cấu trúc hơn: “huấn luyện theo kiểu giải đấu”. Có thể hiểu đây là một cuộc thi định kỳ: mỗi vòng huấn luyện đều có một cửa sổ thời gian nhất định, nhiều bên tham gia cạnh tranh xoay quanh cùng một nhiệm vụ và được sàng lọc qua nhiều vòng để loại bỏ dần, cuối cùng chọn ra phương án tối ưu. Hình thức này nhấn mạnh so sánh giai đoạn và đánh giá tập trung. Một thay đổi quan trọng là: thợ mỏ không còn nộp trực tiếp kết quả huấn luyện, mà nộp “phương pháp huấn luyện” (dưới dạng mã nguồn), sau đó do các nút xác thực thực thi thống nhất. Việc này vừa nâng cao tính công bằng, tránh nhiễu do môi trường tính toán khác nhau, vừa bảo vệ tốt hơn tính riêng tư của dữ liệu và quy trình huấn luyện. Ngoài ra, các phương án chiến thắng thường được lưu giữ lại để tái sử dụng như những “thực tiễn tốt nhất” tích lũy dần. Về dài hạn, cơ chế này không chỉ chọn ra mô hình tối ưu, mà còn xây dựng một thư viện phương pháp huấn luyện không ngừng tiến hóa.

5. Hiện trạng hệ sinh thái

5.1 Cấu trúc người tham gia: Mạng lưới hợp tác gồm nhu cầu, cung và đánh giá

Hệ sinh thái Gradients gồm ba vai trò cốt lõi: người dùng (phía nhu cầu), thợ mỏ (phía cung) và người xác thực (phía đánh giá). Người dùng chủ yếu là các nhà phát triển AI, doanh nghiệp vừa và nhỏ cũng như các nhà xây dựng Web3 — nhóm đối tượng thường có nền tảng kỹ thuật nhất định, nhưng thiếu tài nguyên tính toán hoặc năng lực huấn luyện mô hình đầy đủ, do đó có xu hướng sử dụng Gradients để xây dựng mô hình với chi phí thấp hơn. Thợ mỏ cung cấp tài nguyên GPU và tham gia cạnh tranh trong các nhiệm vụ huấn luyện, động lực cốt lõi của họ là thu được phần thưởng TAO; người xác thực đánh giá và xếp hạng kết quả huấn luyện, là mắt xích then chốt đảm bảo chất lượng mô hình và vận hành hiệu quả của cơ chế.

Xét sâu hơn vào chân dung người dùng, nhóm sử dụng thực tế Gradients mang đặc trưng rõ rệt là “bán kỹ sư”: không phải các phòng thí nghiệm AI hàng đầu, cũng không phải người dùng phổ thông hoàn toàn không có nền tảng kỹ thuật, mà chủ yếu là các nhà phát triển và người dùng công nghệ Web3 có năng lực kỹ thuật nhất định. Đặc điểm này cũng phản ánh trong cấu trúc cộng đồng của Gradients, hiện chủ yếu sử dụng tiếng Anh, người dùng cốt lõi tập trung ở Bắc Mỹ và châu Âu, đồng thời bao phủ một số thợ mỏ Đông Nam Á và các nhà cung cấp tài nguyên GPU toàn cầu. Nhìn chung, đây là một cộng đồng kỹ sư do công nghệ dẫn dắt.

5.2 Hiện trạng vận hành hệ sinh thái

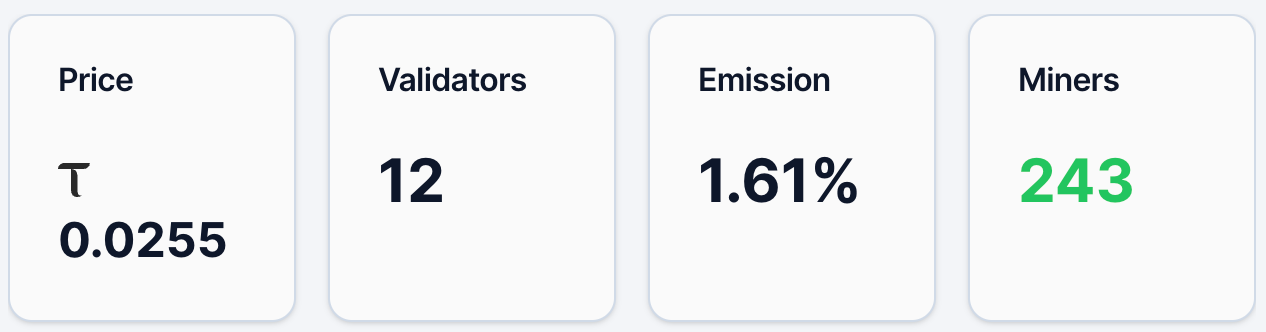

Tính đến ngày 12 tháng 5, giá token alpha của Gradients khoảng 0,0255 TAO, số địa chỉ nắm giữ token khoảng 4.890, số thợ mỏ là 243 và số người xác thực là 12, tỷ lệ Emission chiếm 1,61%. Đồng thời, trong hồ thanh khoản (liquidity pool), tỷ lệ TAO là 2,19%, còn tỷ lệ Alpha là 97,81%. Nhìn từ giá và số lượng địa chỉ nắm giữ, Gradients đã có một cơ sở người dùng và mức độ chú ý nhất định, nhưng nhìn chung vẫn đang trong giai đoạn lan tỏa sơ khai. So sánh với dự án đầu ngành trong hệ sinh thái TAO là Chutes, cùng ngày giá token alpha là 0,0877 TAO và số địa chỉ nắm giữ là 13.409.

Hình 1. Dữ liệu Gradients.

Nguồn: https://bittensormarketcap.com/subnets/56

Thứ hai là cơ chế khuyến khích Emission. Trong hệ sinh thái Bittensor, Emission là trọng số phân bổ phần thưởng mới phát sinh trên toàn mạng cho mạng con cụ thể. Mạng Bittensor liên tục tạo ra TAO mới và phân bổ theo trọng số cho các mạng con khác nhau; tỷ lệ 1,61% hiện tại của Gradients nghĩa là nó chỉ nhận được một phần nhỏ trong tổng phần thưởng mới phát sinh trên toàn mạng. Chỉ số này bản chất phản ánh “kết quả biểu quyết” của thị trường thông qua luồng vốn (ví dụ như staking) đối với các mạng con khác nhau. Do đó, mức 1,61% thường cho thấy mức độ công nhận và dòng vốn đầu vào từ thị trường vẫn còn hạn chế, đồng thời cũng hàm ý tiềm năng nâng cao trọng số trong tương lai. Xét về cấu trúc vốn (hồ thanh khoản), tỷ lệ TAO chỉ chiếm 2,19%, trong khi Alpha chiếm tới 97,81%, cho thấy dòng vốn bên ngoài vẫn còn hạn chế và hiện chủ yếu do cung nội bộ mạng con chi phối. Giá cả khá nhạy cảm với dòng vốn mới; một khi có thêm TAO chảy vào, có thể tạo ra hiệu ứng khuếch đại rõ rệt.

6. Bối cảnh cạnh tranh và điểm mạnh – điểm yếu

6.1 Định vị ngành: Cơ sở hạ tầng huấn luyện AutoML phi tập trung

Gradients nằm trong phân khúc “cơ sở hạ tầng huấn luyện AI + AutoML phi tập trung”. Dự án này cố gắng giải phóng việc huấn luyện mô hình khỏi các nền tảng tập trung và thông qua cơ chế mạng lưới để đạt hiệu quả sử dụng tài nguyên và tối ưu mô hình cao hơn. Trong hệ sinh thái Web2, phân khúc này đã tương đối trưởng thành, với các đại diện điển hình như Google Vertex AI và AWS SageMaker. Những nền tảng này cung cấp cho nhà phát triển dịch vụ huấn luyện và triển khai mô hình toàn diện thông qua điện toán đám mây, nhưng bản chất vẫn là kiến trúc tập trung. So sánh với điều này, sự khác biệt của Gradients không nằm ở “chức năng nhiều hơn”, mà ở logic nền tảng: nó chuyển đổi huấn luyện từ “dịch vụ nền tảng” thành “hợp tác mạng lưới”, đồng thời sàng lọc kết quả tối ưu thông qua cơ chế cạnh tranh, khiến hệ thống vận hành gần giống một thị trường.

6.2 So sánh ngang hàng: Sự khác biệt giữa AutoML Web2 và Web3

Nhìn ở góc độ vĩ mô hơn, sự khác biệt giữa Web2 và Web3 trong lĩnh vực AutoML bản chất là sự đối lập giữa hai phạm trù khác nhau. Mô hình Web2 nhấn mạnh hiệu quả và độ ổn định, thông qua tập trung tài nguyên và tối ưu kỹ thuật để cung cấp trải nghiệm dịch vụ kiểm soát được và chín muồi; còn mô hình Web3 lại nhấn mạnh tính mở và cơ chế khuyến khích, thông qua việc đưa nhiều bên tham gia vào để khiến việc tối ưu mô hình không ngừng tiến hóa trong cạnh tranh. Cụ thể hơn, AutoML Web2 giống như “một công cụ mạnh mẽ”, người dùng giao nhiệm vụ cho nền tảng và hệ thống nội bộ tự tìm nghiệm tối ưu; còn AutoML Web3 đại diện bởi Gradients lại giống như “một thị trường mở”, người dùng đăng tải yêu cầu, các bên tham gia đưa ra giải pháp, sau đó kết quả được sàng lọc thông qua cơ chế đánh giá. Hệ quả trực tiếp của sự khác biệt này là: mô hình thứ nhất ổn định và kiểm soát tốt hơn, nhưng đường dẫn tối ưu bị giới hạn; mô hình thứ hai có không gian khám phá lớn hơn, trần tối ưu tiềm năng cao hơn, nhưng vẫn còn cần cải thiện về độ ổn định và độ chín muồi.

6.3 Sự khác biệt của Gradients trong hệ sinh thái Web3

Trong hệ sinh thái Web3 AI hiện nay, đa số dự án vẫn tập trung ở lớp suy luận (inference) hoặc hướng AI Agent, trong khi các dự án chuyên sâu về “cơ sở hạ tầng huấn luyện” lại khá ít. Một số dự án thử nghiệm kết hợp mạng lưới tính toán hoặc mạng lưới dữ liệu để cung cấp khả năng huấn luyện, nhưng nhìn chung vẫn chủ yếu dừng lại ở mức điều phối tài nguyên hoặc thị trường tính toán. Sự khác biệt của Gradients nằm ở chỗ: nó không chỉ cung cấp việc ghép nối tài nguyên tính toán, mà còn mở rộng lên tận “cơ chế tối ưu mô hình” — thông qua việc đưa vào hệ thống đánh giá và cạnh tranh, giúp quy trình huấn luyện có khả năng tiến hóa liên tục. Điều này nghĩa là, Gradients không chỉ giải quyết câu hỏi “tài nguyên tính toán đến từ đâu”, mà còn giải quyết câu hỏi “làm thế nào để sử dụng hiệu quả những tài nguyên đó hơn”. Về định vị, Gradients gần giống một mạng lưới “định hướng kết quả huấn luyện”, chứ không đơn thuần là một thị trường tính toán hay nền tảng công cụ — đây cũng là điểm khác biệt cốt lõi giữa Gradients và đa số dự án Web3 AI khác.

6.4 Điểm mạnh cốt lõi: Hiệu quả được nâng cao nhờ cơ chế

Tổng kết lại, điểm mạnh của Gradients chủ yếu nằm ở thiết kế cơ chế. Thứ nhất, nó giảm rào cản sử dụng thông qua trừu tượng hóa nhiệm vụ, giúp người dùng không cần tham gia sâu vào quy trình huấn luyện phức tạp nhưng vẫn nhận được kết quả mô hình, từ đó mở rộng nhóm người dùng tiềm năng. Thứ hai, ở cấp độ tài nguyên, việc đưa vào tài nguyên tính toán phân tán khiến huấn luyện không còn phụ thuộc vào một nhà cung cấp đám mây duy nhất, về lý thuyết có thể hình thành cấu trúc chi phí linh hoạt hơn nhờ cạnh tranh. Quan trọng hơn cả là sự thay đổi trong cách thức tối ưu. Thông qua việc khám phá song song của nhiều bên tham gia kết hợp với cơ chế sàng lọc, Gradients cung cấp một giải pháp khác biệt so với tối ưu đường dẫn đơn truyền thống, giúp mô hình có cơ hội đạt hiệu năng tốt hơn trong thời gian ngắn hơn. Mô hình “tối ưu do cạnh tranh thúc đẩy” chính là điểm mạnh cốt lõi nhất của Gradients.

6.5 Thách thức tiềm ẩn

Chất lượng mô hình có thể gặp vấn đề về độ ổn định. Huấn luyện phi tập trung phụ thuộc vào sự tham gia đa phương, mặc dù có thể nâng cao trần tối ưu, nhưng cũng dễ gây dao động kết quả, do đó về mặt kiểm soát sẽ kém chắc chắn hơn so với hệ thống tập trung. Thứ hai là vấn đề niềm tin cấp doanh nghiệp. Với người dùng doanh nghiệp, an ninh dữ liệu và khả năng kiểm chứng quy trình huấn luyện là vô cùng quan trọng; trong môi trường phi tập trung, làm thế nào để đảm bảo dữ liệu không bị lạm dụng và kết quả có thể được kiểm toán vẫn là một thử thách then chốt. Cuối cùng là sự phụ thuộc vào kinh tế học token. Việc vận hành Gradients phụ thuộc rất cao vào cơ chế khuyến khích; nếu lợi ích từ TAO suy giảm, có thể ảnh hưởng đến mức độ tham gia của thợ mỏ và tính năng động chung của mạng lưới. Do đó, tính bền vững dài hạn của Gradients một phần phụ thuộc vào việc mô hình kinh tế có thể hình thành một vòng tuần hoàn tích cực ổn định hay không.

7. Triển vọng tương lai: AutoML phi tập trung có thể thành hiện thực?

Ở giai đoạn hiện tại, Gradients vẫn đang trong thời kỳ đầu; việc nó có thể thực sự vận hành hiệu quả trong tương lai hay không phụ thuộc vào một vài yếu tố then chốt. Yếu tố cốt lõi nhất là khả năng thu hút liên tục các nhu cầu huấn luyện thực tế, chứ không chỉ là sự tham gia xoay quanh phần thưởng; thứ hai là chất lượng mô hình — liệu cách tiếp cận phi tập trung có thể ổn định tạo ra kết quả khả dụng, thậm chí vượt trội hơn hay không; và cuối cùng là cơ chế kinh tế có thể hình thành vòng tuần hoàn tích cực hay không, để đảm bảo cân bằng lâu dài giữa cung tài nguyên tính toán và lợi nhuận thu được.

Xét trong bối cảnh ngành rộng hơn, huấn luyện AI đang phân hóa thành hai hướng. Một là mô hình Web2, do các công ty công nghệ hàng đầu dẫn dắt, thông qua tập trung tài nguyên và năng lực kỹ thuật để không ngừng nâng cao hiệu năng mô hình — ưu điểm nằm ở độ ổn định và chín muồi; hướng còn lại là mô hình Web3 đại diện bởi Gradients, thông qua mạng lưới mở và cơ chế khuyến khích để thu hút nhiều bên tham gia cùng tối ưu mô hình, không ngừng nâng cao trần tối ưu trong cạnh tranh. Hướng đầu tiên là “xây dựng một hệ thống mạnh hơn”, còn hướng sau lại giống như “xây dựng một mạng lưới có khả năng tự tiến hóa”.

Từ góc nhìn này, việc khám phá của Gradients đại diện cho một khả năng mới: huấn luyện AI không còn chỉ là một vấn đề kỹ thuật, mà là sự kết hợp giữa “tài nguyên tính toán + dữ liệu + cơ chế thị trường”. Nếu mô hình này có thể thành hiện thực, Gradients có tiềm năng trở thành cổng vào huấn luyện AI phi tập trung và đóng vai trò là cơ sở hạ tầng then chốt trong hệ sinh thái Bittensor. Tất nhiên, hướng đi này vẫn cần thời gian để kiểm chứng, nhưng nó đã mở ra một lối tiến hóa khác biệt cho AutoML, không giống với các hướng tiếp cận truyền thống.

Tài liệu tham khảo

1. Tài liệu Bittensor: https://docs.learnbittensor.org

2. Trang web Gradients: https://www.gradients.io/

3. Gradients: https://bittensormarketcap.com/subnets/56

4. Gradients trên X: https://x.com/gradients_ai

5. Taostats: https://taostats.io/subnets/56/chart

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News