Hình ảnh minh họa: DeepSeek R1 được luyện thành như thế nào?

Tuyển chọn TechFlowTuyển chọn TechFlow

Hình ảnh minh họa: DeepSeek R1 được luyện thành như thế nào?

Dựa trên báo cáo kỹ thuật được công bố bởi DeepSeek, giải thích quá trình huấn luyện của DeepSeek - R1.

Tác giả: Giang Tín Lĩnh, Phát điện cho AI

Hình ảnh: Được tạo bởi Wujie AI

DeepSeek đã huấn luyện mô hình suy luận R1 của mình như thế nào?

Bài viết này chủ yếu dựa trên báo cáo kỹ thuật do DeepSeek công bố, nhằm giải thích quá trình huấn luyện DeepSeek - R1; tập trung thảo luận bốn chiến lược xây dựng và cải thiện mô hình suy luận.

Bản gốc từ nhà nghiên cứu Sebastian Raschka, đăng tại:

https://magazine.sebastianraschka.com/p/understanding-reasoning-llms

Bài viết này sẽ tóm tắt phần cốt lõi về huấn luyện mô hình suy luận R1 trong đó.

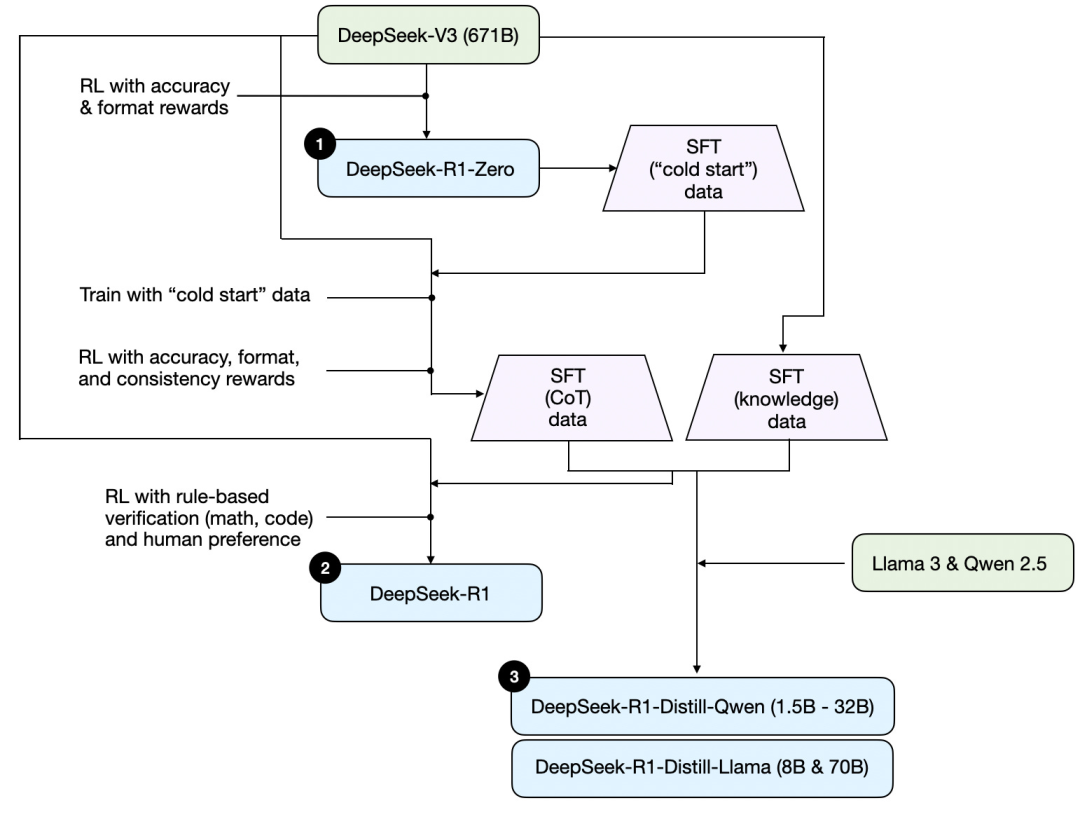

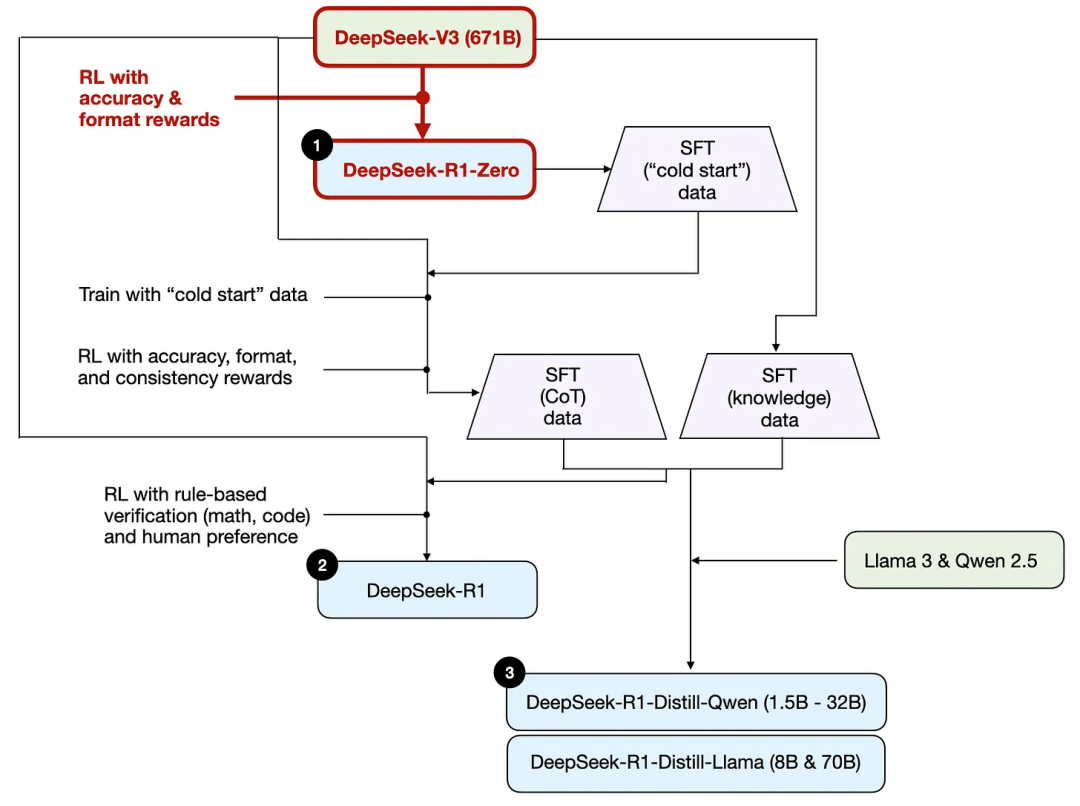

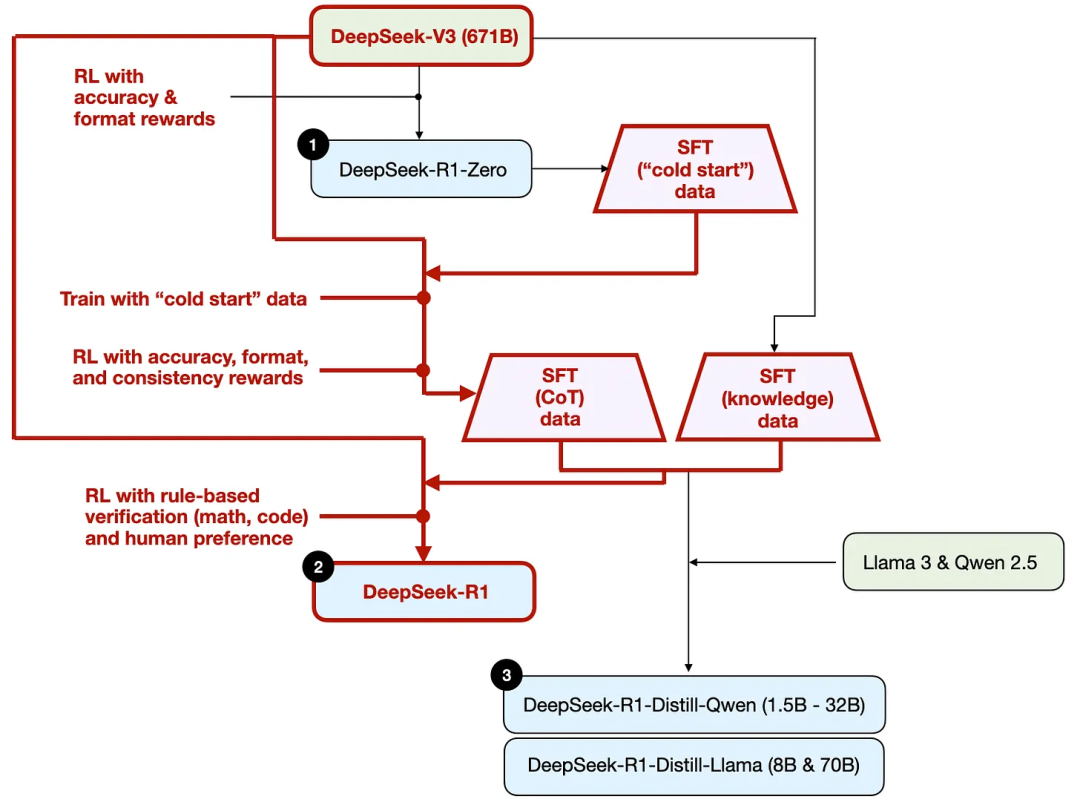

Trước tiên, dựa trên báo cáo kỹ thuật do DeepSeek công bố, dưới đây là sơ đồ huấn luyện R1.

Tóm lại quy trình được minh họa ở hình trên, trong đó:

(1) DeepSeek - R1 - Zero: Mô hình này dựa trên mô hình cơ sở DeepSeek - V3 được phát hành vào tháng 12 năm ngoái. Nó được huấn luyện bằng học tăng cường (RL) với hai cơ chế phần thưởng. Phương pháp này được gọi là huấn luyện "khởi động lạnh" vì nó không bao gồm bước tinh chỉnh giám sát (SFT), vốn thường là một phần của học tăng cường có phản hồi con người (RLHF).

(2) DeepSeek - R1: Đây là mô hình suy luận chính của DeepSeek, được xây dựng dựa trên DeepSeek - R1 - Zero. Nhóm đã tối ưu hóa nó thông qua giai đoạn tinh chỉnh giám sát bổ sung và thêm học tăng cường, cải tiến mô hình R1 - Zero "khởi động lạnh".

(3) DeepSeek - R1 - Distill: Nhóm DeepSeek sử dụng dữ liệu tinh chỉnh giám sát được tạo ra từ các bước trước để Fine-tuning các mô hình Qwen và Llama, nhằm nâng cao khả năng suy luận của chúng. Mặc dù không phải là phương pháp chưng cất truyền thống, quá trình này liên quan đến việc dùng đầu ra của mô hình DeepSeek - R1 lớn hơn (671B) để huấn luyện các mô hình nhỏ hơn (Llama 8B và 70B, cùng Qwen 1.5B - 30B).

Dưới đây sẽ giới thiệu bốn phương pháp chính để xây dựng và nâng cao mô hình suy luận

1. Mở rộng thời gian suy luận / Inference-time scaling

Một cách để nâng cao khả năng suy luận của LLM (hoặc bất kỳ khả năng nào nói chung) là mở rộng thời gian suy luận – tăng tài nguyên tính toán trong quá trình suy luận để cải thiện chất lượng đầu ra.

So sánh đơn giản, giống như con người khi có nhiều thời gian suy nghĩ về vấn đề phức tạp thường đưa ra câu trả lời tốt hơn. Tương tự, ta có thể áp dụng một số kỹ thuật để thúc đẩy LLM "suy nghĩ" sâu hơn khi tạo câu trả lời.

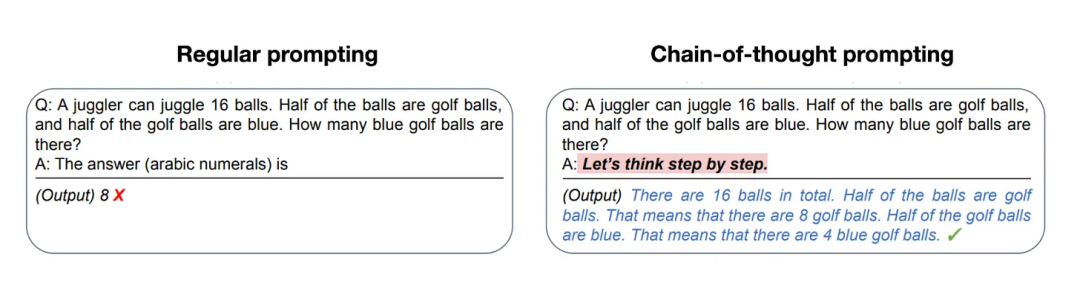

Một phương pháp đơn giản để thực hiện mở rộng thời gian suy luận là kỹ thuật tạo nhắc khéo léo / Prompt Engineering. Một ví dụ điển hình là nhắc chuỗi tư duy / CoT Prompting, tức là thêm cụm từ như "hãy suy luận từng bước" vào lời nhắc đầu vào. Điều này buộc mô hình tạo ra các bước lập luận trung gian thay vì nhảy ngay đến câu trả lời cuối cùng, nhờ đó thường đạt kết quả chính xác hơn trên các vấn đề phức tạp. (Lưu ý rằng đối với các câu hỏi đơn giản dựa trên kiến thức như "Thủ đô nước Pháp là gì", thì chiến lược này không hợp lý, đây cũng là một quy tắc thực tế hữu ích để xác định xem mô hình suy luận có phù hợp với truy vấn đầu vào nhất định hay không.)

Phương pháp chuỗi tư duy (CoT) nêu trên có thể được coi là mở rộng thời gian suy luận, vì nó làm tăng chi phí lập luận bằng cách tạo thêm các token đầu ra.

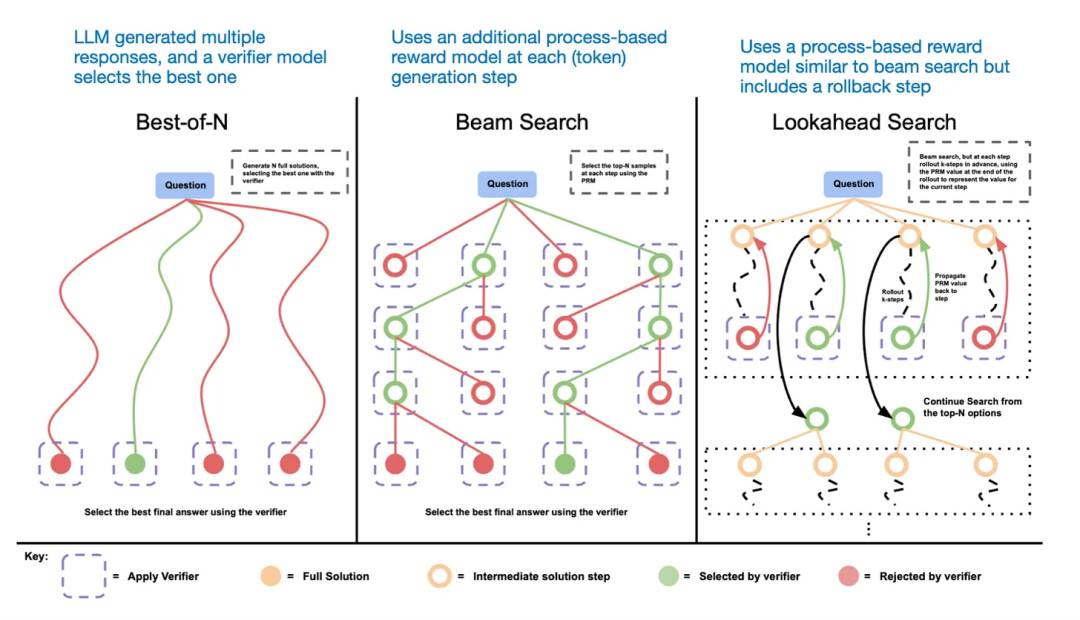

Một cách khác để mở rộng thời gian suy luận là sử dụng chiến lược bỏ phiếu và tìm kiếm. Một ví dụ đơn giản là phương pháp bỏ phiếu đa số, tức là để LLM tạo ra nhiều câu trả lời, sau đó chọn câu trả lời đúng bằng biểu quyết đa số. Tương tự, ta có thể sử dụng tìm kiếm theo chùm (beam search) và các thuật toán tìm kiếm khác để tạo câu trả lời tốt hơn.

Tại đây, tôi đề xuất bài báo:《Scaling LLM Test-Time Compute Optimally can be More Effective than Scaling Model Parameters》.

Các phương pháp dựa trên tìm kiếm khác nhau phụ thuộc vào mô hình phần thưởng theo quá trình để chọn câu trả lời tốt nhất.

Báo cáo kỹ thuật DeepSeek R1 cho biết mô hình của họ không sử dụng công nghệ mở rộng thời gian suy luận. Tuy nhiên, công nghệ này thường được triển khai ở lớp ứng dụng phía trên LLM, nên DeepSeek có thể đã áp dụng nó trong ứng dụng của mình.

Tôi suy đoán các mô hình o1 và o3 của OpenAI đã sử dụng công nghệ mở rộng thời gian suy luận, điều này giải thích tại sao chi phí sử dụng chúng tương đối cao hơn so với các mô hình như GPT-4o. Ngoài mở rộng thời gian suy luận, rất có thể o1 và o3 cũng được huấn luyện bằng quy trình học tăng cường tương tự như DeepSeek R1.

2. Học tăng cường thuần túy / Pure RL

Một điểm đáng chú ý đặc biệt trong bài báo DeepSeek R1 là họ phát hiện ra khả năng suy luận có thể nổi lên như một hành vi từ học tăng cường thuần túy. Dưới đây chúng ta sẽ tìm hiểu điều này nghĩa là gì.

Như đã nói ở trên, DeepSeek đã phát triển ba loại mô hình R1. Loại đầu tiên là DeepSeek - R1 - Zero, được xây dựng dựa trên mô hình cơ sở DeepSeek - V3. Khác với quy trình học tăng cường điển hình, thường có bước tinh chỉnh giám sát (SFT) trước học tăng cường, nhưng DeepSeek - R1 - Zero hoàn toàn được huấn luyện bằng học tăng cường, không có giai đoạn SFT ban đầu, như hình dưới đây.

Dù vậy, quá trình học tăng cường này tương tự phương pháp học tăng cường có phản hồi con người (RLHF) thường dùng để tinh chỉnh sở thích cho LLM. Tuy nhiên, như đã nói, điểm khác biệt then chốt của DeepSeek - R1 - Zero là họ bỏ qua giai đoạn tinh chỉnh giám sát (SFT) dùng để hiệu chỉnh chỉ dẫn. Vì vậy họ gọi đây là học tăng cường "thuần túy" / Pure RL.

Về phần thưởng, họ không dùng mô hình phần thưởng được huấn luyện dựa trên sở thích con người, mà sử dụng hai loại phần thưởng: phần thưởng độ chính xác và phần thưởng định dạng.

-

Phần thưởng độ chính xác / accuracy reward dùng trình biên dịch LeetCode để kiểm tra đáp án lập trình, và dùng hệ thống xác định để đánh giá câu trả lời toán học.

-

Phần thưởng định dạng / format reward dựa vào một bộ đánh giá LLM để đảm bảo câu trả lời tuân thủ định dạng mong muốn, ví dụ như đặt các bước lập luận vào trong thẻ.

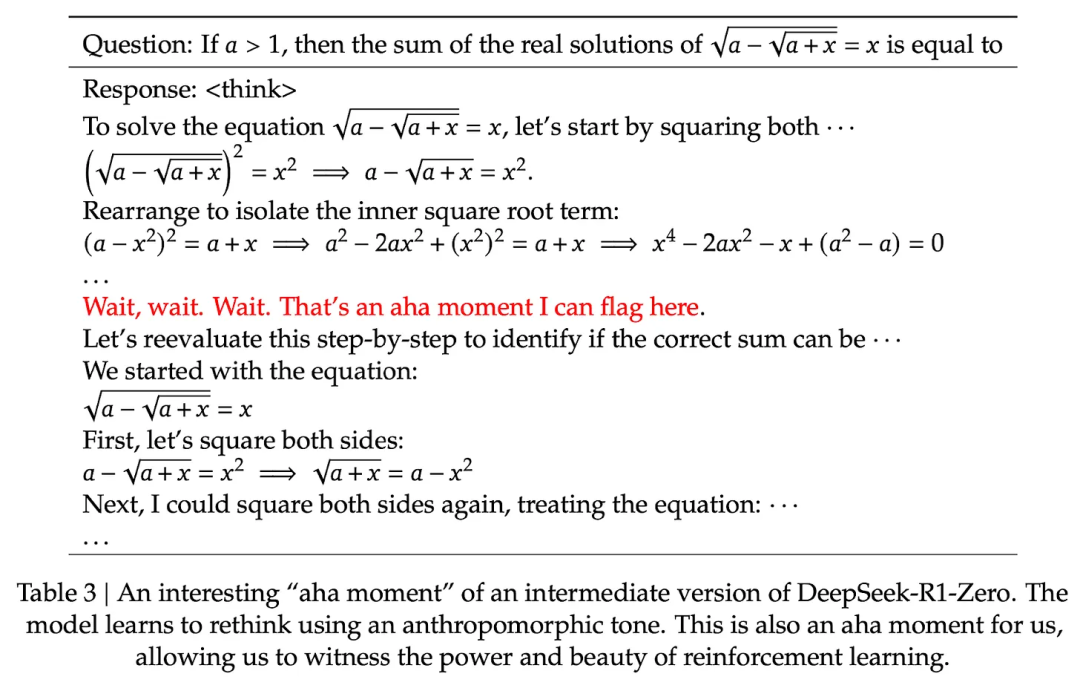

Đáng ngạc nhiên là, phương pháp này đủ để LLM phát triển kỹ năng suy luận cơ bản. Các nhà nghiên cứu đã quan sát thấy khoảnh khắc "aha", khi mô hình bắt đầu tạo ra dấu vết lập luận trong câu trả lời của mình, mặc dù chưa được huấn luyện rõ ràng về điều này, như hình dưới đây trích từ báo cáo kỹ thuật R1.

Mặc dù R1 - Zero không phải là mô hình suy luận hàng đầu, nhưng như hình trên cho thấy, nó thực sự thể hiện khả năng suy luận bằng cách tạo ra các bước "suy nghĩ" trung gian. Điều này xác nhận rằng việc sử dụng học tăng cường thuần túy để phát triển mô hình suy luận là khả thi, và DeepSeek là nhóm đầu tiên chứng minh (hoặc ít nhất là công bố kết quả liên quan) phương pháp này.

3. Tinh chỉnh giám sát và học tăng cường (SFT + RL)

Tiếp theo hãy xem quá trình phát triển mô hình suy luận chính của DeepSeek - DeepSeek - R1, đây có thể coi là sách giáo khoa về xây dựng mô hình suy luận. Mô hình này dựa trên DeepSeek - R1 - Zero, tích hợp thêm tinh chỉnh giám sát (SFT) và học tăng cường (RL) để nâng cao hiệu suất suy luận.

Cần lưu ý rằng, việc thêm giai đoạn tinh chỉnh giám sát trước học tăng cường là điều phổ biến trong quy trình học tăng cường có phản hồi con người (RLHF) tiêu chuẩn. Rất có thể o1 của OpenAI cũng được phát triển bằng phương pháp tương tự.

Như hình trên, nhóm DeepSeek sử dụng DeepSeek - R1 - Zero để tạo ra dữ liệu tinh chỉnh giám sát (SFT) mà họ gọi là "khởi động lạnh". Thuật ngữ "khởi động lạnh" ám chỉ rằng dữ liệu này được tạo bởi DeepSeek - R1 - Zero, trong khi bản thân mô hình đó chưa từng được huấn luyện trên bất kỳ dữ liệu SFT nào.

Sử dụng dữ liệu SFT khởi động lạnh này, DeepSeek trước tiên huấn luyện mô hình bằng tinh chỉnh chỉ dẫn, sau đó chuyển sang một giai đoạn học tăng cường (RL) khác. Giai đoạn RL này tiếp tục sử dụng phần thưởng độ chính xác và phần thưởng định dạng như trong quá trình RL của DeepSeek - R1 - Zero. Tuy nhiên, họ thêm phần thưởng nhất quán để ngăn mô hình trộn lẫn ngôn ngữ trong câu trả lời, tức là chuyển đổi giữa nhiều ngôn ngữ trong một lần trả lời.

Sau giai đoạn RL, bước thu thập dữ liệu SFT tiếp theo được thực hiện. Trong giai đoạn này, mô hình checkpoint mới nhất được dùng để tạo 600 nghìn ví dụ SFT chuỗi tư duy (CoT) (600K CoT SFT examples), đồng thời sử dụng mô hình cơ sở DeepSeek - V3 tạo thêm 200 nghìn ví dụ SFT dựa trên kiến thức (200K knowledge based SFT examples).

Sau đó, 600 nghìn + 200 nghìn mẫu SFT này được dùng để tinh chỉnh chỉ dẫn/instruction finetuning mô hình cơ sở DeepSeek - V3, rồi tiến hành vòng RL cuối cùng. Trong giai đoạn này, đối với các câu hỏi toán học và lập trình, họ lại dùng phương pháp dựa trên quy tắc để xác định phần thưởng độ chính xác, còn với các loại câu hỏi khác thì dùng nhãn sở thích con người. Tóm lại, điều này rất giống với học tăng cường có phản hồi con người (RLHF) thông thường, chỉ khác là dữ liệu SFT chứa (nhiều hơn) các ví dụ chuỗi tư duy. Và RL ngoài phần thưởng dựa trên sở thích con người còn có phần thưởng có thể xác minh được.

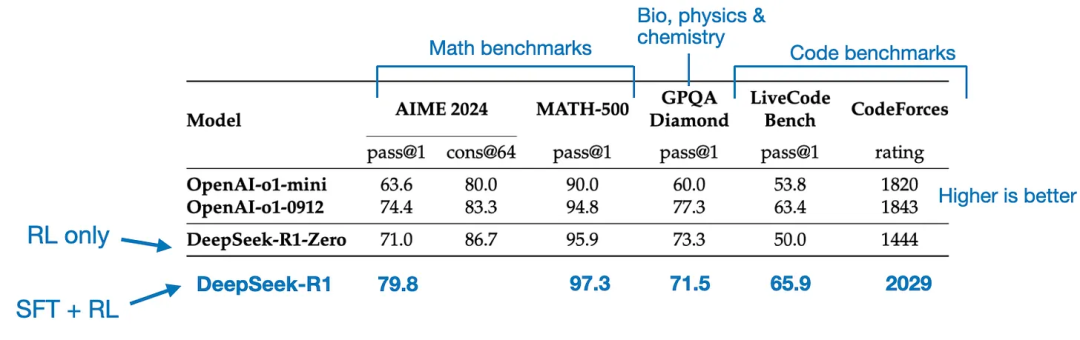

Mô hình cuối cùng DeepSeek - R1, nhờ các giai đoạn SFT và RL bổ sung, đã cải thiện đáng kể về hiệu suất so với DeepSeek - R1 - Zero, như bảng dưới đây.

4. Tinh chỉnh giám sát thuần túy (SFT) và chưng cất

Tới nay, chúng ta đã giới thiệu ba phương pháp chính để xây dựng và cải thiện mô hình suy luận:

1/ Mở rộng thời gian suy luận, là kỹ thuật nâng cao khả năng suy luận mà không cần huấn luyện hoặc sửa đổi mô hình nền tảng theo cách nào khác.

2/ Pure RL, như học tăng cường thuần túy (RL) được áp dụng trong DeepSeek - R1 - Zero, cho thấy suy luận có thể xuất hiện như một hành vi học được mà không cần tinh chỉnh giám sát.

3/ Tinh chỉnh giám sát (SFT) + Học tăng cường (RL), tạo ra mô hình suy luận DeepSeek - R1 của DeepSeek.

Còn lại – “chưng cất” mô hình. DeepSeek còn phát hành các mô hình nhỏ hơn được huấn luyện thông qua quá trình chưng cất mà họ gọi là vậy. Trong bối cảnh LLM, chưng cất không nhất thiết tuân theo phương pháp chưng cất tri thức cổ điển được dùng trong học sâu. Thông thường, trong chưng cất tri thức, một mô hình "học sinh" nhỏ hơn được huấn luyện trên đầu ra logic của mô hình "giáo viên" lớn hơn và trên tập dữ liệu mục tiêu.

Tuy nhiên, ở đây chưng cất ám chỉ việc tinh chỉnh chỉ dẫn/instruction finetuning các LLM nhỏ hơn trên tập dữ liệu tinh chỉnh giám sát (SFT) được tạo bởi LLM lớn hơn, ví dụ như các mô hình Llama 8B và 70B, cùng Qwen 2.5B (0.5B - 32B). Cụ thể, các LLM lớn hơn này là DeepSeek - V3 và một checkpoint trung gian của DeepSeek - R1. Thực tế, dữ liệu SFT dùng cho quá trình chưng cất này giống hệt với tập dữ liệu được mô tả trong phần trước dùng để huấn luyện DeepSeek - R1.

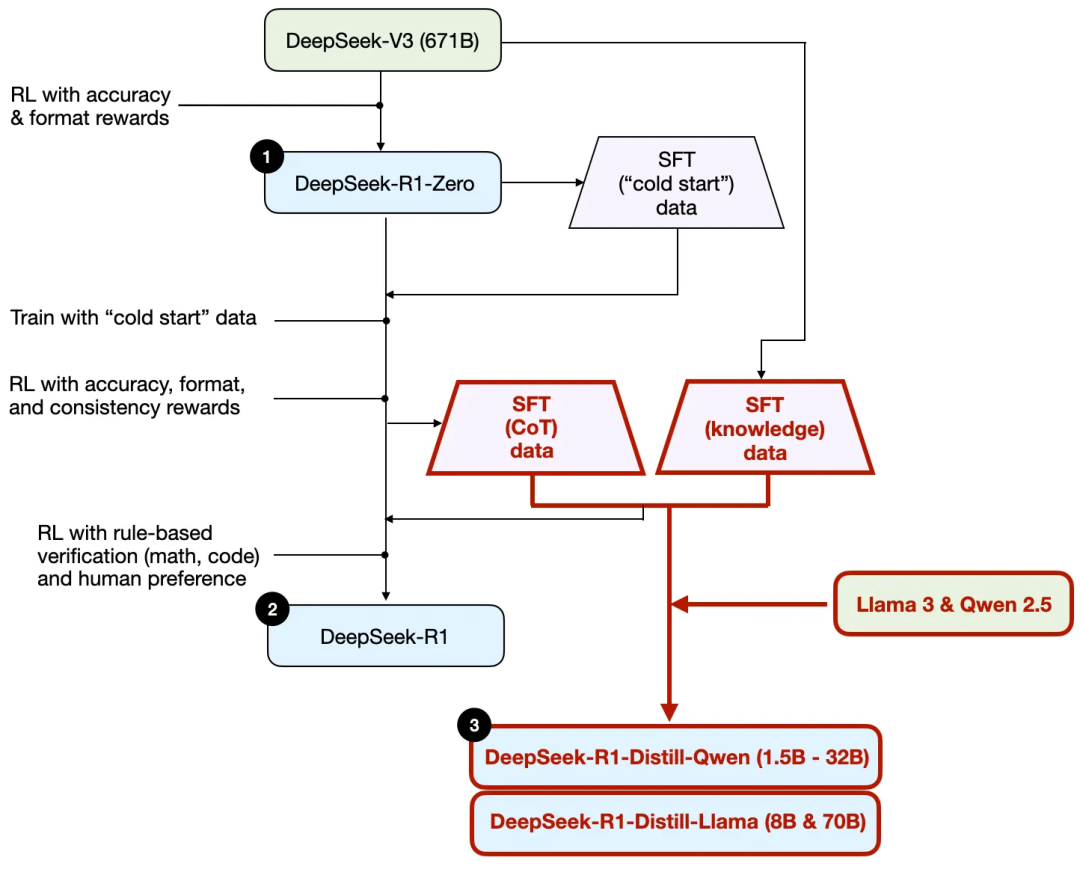

Để làm rõ quá trình này, tôi đã làm nổi bật phần chưng cất trong hình dưới đây.

Tại sao họ phát triển các mô hình chưng cất này? Có hai lý do chính:

1/ Mô hình nhỏ hơn hiệu quả hơn. Điều này có nghĩa là chi phí vận hành thấp hơn và có thể chạy trên phần cứng cấp thấp, đặc biệt hấp dẫn đối với nhiều nhà nghiên cứu và người đam mê.

2/ Làm nghiên cứu điển hình cho tinh chỉnh giám sát thuần túy (SFT). Các mô hình chưng cất này là điểm chuẩn thú vị, thể hiện mức độ mà tinh chỉnh giám sát thuần túy có thể đưa mô hình đến nếu không có học tăng cường.

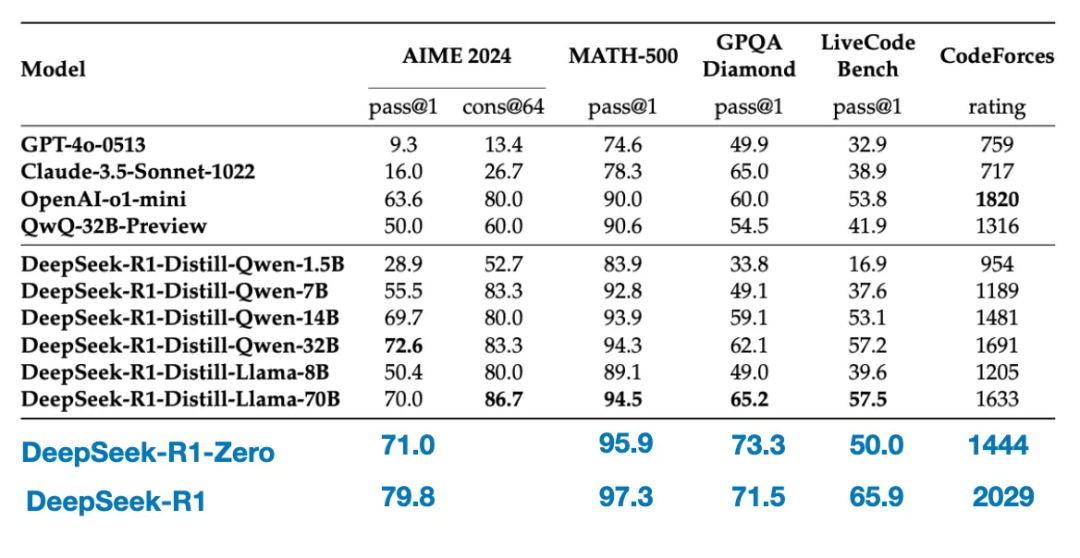

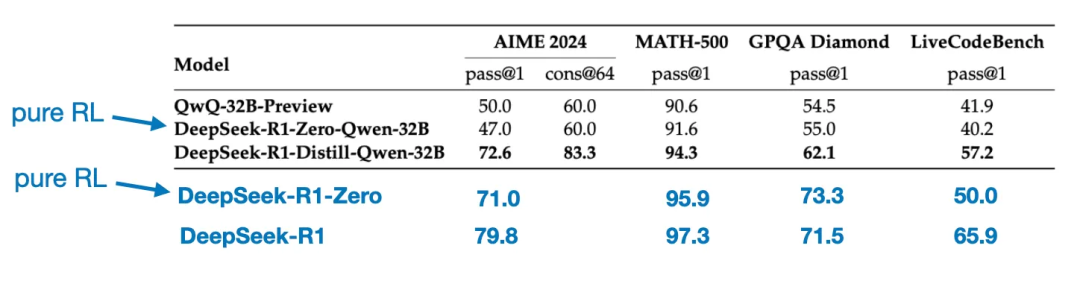

Bảng dưới đây so sánh hiệu suất các mô hình chưng cất này với các mô hình phổ biến khác cũng như DeepSeek - R1 - Zero và DeepSeek - R1.

Như ta thấy, mặc dù các mô hình chưng cất nhỏ hơn DeepSeek - R1 vài bậc độ lớn, nhưng chúng mạnh hơn rõ rệt so với DeepSeek - R1 - Zero, dù vẫn yếu hơn so với DeepSeek - R1. Cũng thú vị là, so với o1-mini, các mô hình này cũng thể hiện khá tốt (tôi nghi ngờ o1-mini bản thân nó có thể là phiên bản chưng cất tương tự của o1).

Còn một so sánh thú vị nữa cần đề cập. Nhóm DeepSeek đã kiểm tra xem hành vi suy luận nổi lên trong DeepSeek - R1 - Zero có thể xuất hiện trong các mô hình nhỏ hơn hay không. Để nghiên cứu điều này, họ áp dụng trực tiếp phương pháp học tăng cường thuần túy giống như trong DeepSeek - R1 - Zero lên Qwen - 32B.

Bảng dưới đây tóm tắt kết quả thí nghiệm, trong đó QwQ - 32B - Preview là mô hình suy luận tham chiếu dựa trên Qwen 2.5 32B do nhóm Qwen phát triển. So sánh này cung cấp thêm hiểu biết về việc liệu học tăng cường thuần túy có thể gây ra khả năng suy luận trong các mô hình nhỏ hơn nhiều so với DeepSeek - R1 - Zero hay không.

Thú vị là, kết quả cho thấy: đối với mô hình nhỏ hơn, chưng cất hiệu quả hơn nhiều so với học tăng cường thuần túy. Điều này phù hợp với quan điểm rằng học tăng cường đơn thuần có thể không đủ để gây ra khả năng suy luận mạnh mẽ trong mô hình kích thước này, và khi xử lý mô hình nhỏ, tinh chỉnh giám sát dựa trên dữ liệu suy luận chất lượng cao có thể là chiến lược hiệu quả hơn.

Kết luận

Chúng ta đã khám phá bốn chiến lược khác nhau để xây dựng và nâng cao mô hình suy luận:

-

Mở rộng thời gian suy luận: Không cần huấn luyện bổ sung, nhưng làm tăng chi phí suy luận. Khi số lượng người dùng hoặc truy vấn tăng lên, chi phí triển khai quy mô lớn sẽ cao hơn. Tuy nhiên, đối với việc nâng cao hiệu suất mô hình đã mạnh sẵn, đây vẫn là phương pháp đơn giản và hiệu quả. Tôi rất nghi ngờ o1 đã sử dụng mở rộng thời gian suy luận, điều này cũng giải thích tại sao chi phí mỗi token do o1 tạo ra cao hơn so với DeepSeek - R1.

-

Học tăng cường thuần túy Pure RL: Về mặt nghiên cứu rất thú vị vì giúp ta hiểu sâu hơn về suy luận như một hành vi nổi lên. Tuy nhiên, trong phát triển mô hình thực tế, kết hợp học tăng cường với tinh chỉnh giám sát (RL + SFT) là lựa chọn tốt hơn, vì cách này tạo ra mô hình suy luận mạnh hơn. Tôi cũng rất nghi ngờ o1 cũng được huấn luyện bằng RL + SFT. Chính xác hơn, tôi cho rằng o1 bắt đầu từ một mô hình cơ sở yếu hơn và nhỏ hơn DeepSeek - R1, nhưng bù đắp khoảng cách bằng RL + SFT và mở rộng thời gian suy luận.

-

Như đã nêu ở trên, RL + SFT là phương pháp then chốt để xây dựng mô hình suy luận hiệu suất cao. DeepSeek - R1 đã cho chúng ta thấy một bản mẫu xuất sắc để đạt được điều này.

-

Chưng cất: Là phương pháp hấp dẫn, đặc biệt phù hợp để tạo các mô hình nhỏ hơn, hiệu quả hơn. Tuy nhiên, hạn chế của nó là chưng cất không thể thúc đẩy đổi mới hay tạo ra thế hệ mô hình suy luận tiếp theo. Ví dụ, chưng cất luôn phụ thuộc vào các mô hình mạnh sẵn có để tạo dữ liệu tinh chỉnh giám sát (SFT).

Tiếp theo, tôi mong đợi một hướng đi thú vị là kết hợp RL + SFT (phương pháp 3) với mở rộng thời gian suy luận (phương pháp 1). Rất có thể đây chính là điều OpenAI đang làm với o1, chỉ khác là o1 có thể dựa trên mô hình cơ sở yếu hơn DeepSeek - R1, điều này cũng giải thích tại sao DeepSeek - R1 có hiệu suất suy luận xuất sắc và chi phí tương đối thấp.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News