見解:Web 4.0到来、AIがエージェント中心のインタラクションネットワークを構築

TechFlow厳選深潮セレクト

見解:Web 4.0到来、AIがエージェント中心のインタラクションネットワークを構築

エージェントネットワークは、技術的な進歩以上のものであり、デジタル時代における人間の可能性に対する根本的な再構築である。

翻訳:TechFlow

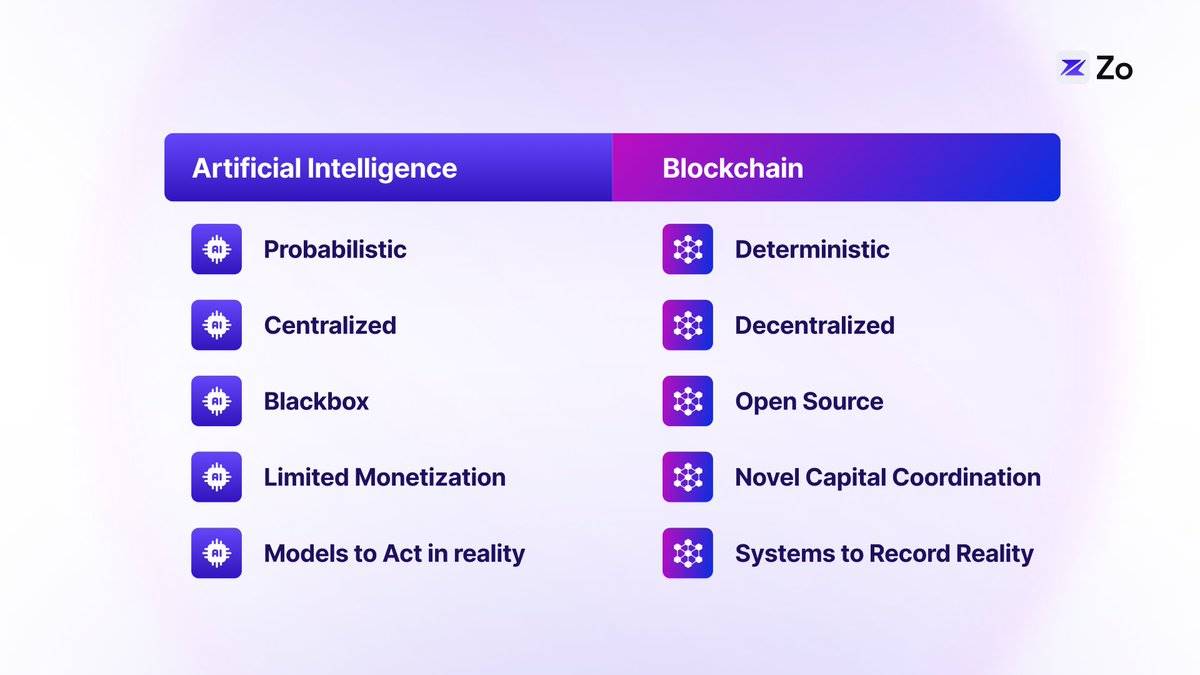

人工知能(AI)とブロックチェーン技術は、世界を変革しつつある二大強力な潮流である。AIは機械学習やニューラルネットワークを通じて人間の知性を拡張し、ブロックチェーンは検証可能なデジタル希少性と新たな非信頼型協働様式をもたらした。これらの技術が融合する中で、次世代インターネットの基盤が築かれようとしている――自律的なエージェントが分散型システムと相互作用する時代、「エージェントネットワーク」の到来である。このネットワークは新たな種類のデジタル住民――AIエージェントを登場させ、それらは自立的にナビゲートし、交渉し、取引を行うことが可能になる。この変革はデジタル世界における権力を再分配し、個人が自身のデータを再び支配するようになると同時に、人類とAIとの前例のない協働を促進する。

ネットワークの進化

未来の方向性を理解するには、ネットワークの進化の歴史とその主要な段階を振り返る必要がある。各段階には固有の能力とアーキテクチャ・パターンが存在する。

初代および第2世代のWebは主に情報伝達に焦点を当てていたが、その後の2世代は情報の拡張に注力している。Web 3.0はトークンを通じてデータ所有権を実現し、Web 4.0は大規模言語モデル(LLM)を通じて知能を付与する。

LLMからエージェントへ:自然な進化

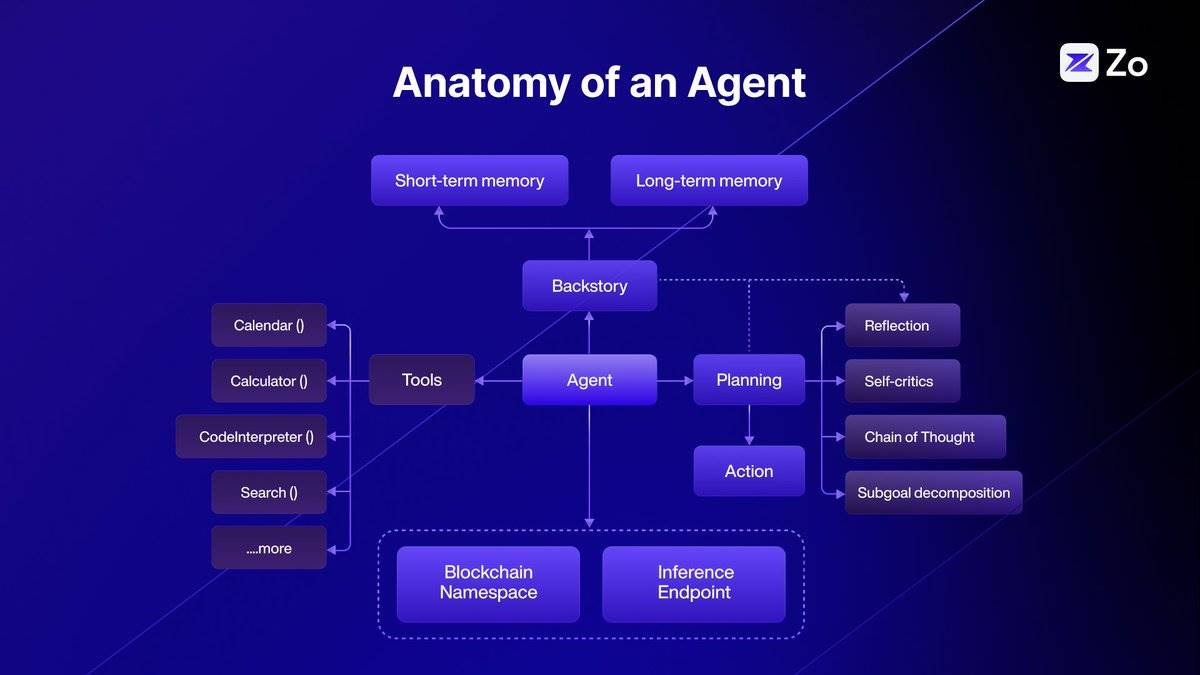

大規模言語モデル(LLM)は機械的知性において飛躍的な進歩を遂げた。これらは動的なパターンマッチングシステムとして、確率計算によって膨大な知識を文脈的理解に変換する。しかし、これらのモデルが「エージェント」として設計されたとき、真の可能性が開かれる――単なる情報処理装置から、知覚・推論・行動を行う目的指向型の実体へと進化するのである。この変化により、言語と行動を通じて継続的かつ有意義な協働を可能にする新興知性が生まれる。

「エージェント」という概念は、従来のチャットボットの限界や否定的な印象を超えた、人間と機械のインタラクションに対する新しい視座を提供する。これは用語の変更に留まらず、AIシステムがいかに自律的に動作し、人間と効果的に協働するかに関する根本的な再考である。エージェントのワークフローは、特定のユーザー要求を中心に市場を形成できる。

エージェントネットワークは単に知能層を追加するだけではなく、我々がデジタルシステムと相互作用する方法そのものを根本的に変えてしまう。従来のWebは静的なインターフェースと事前に定義されたユーザーパスに依存していたが、エージェントネットワークは動的なランタイムアーキテクチャを導入し、計算プロセスやインターフェースがユーザーのニーズや意図にリアルタイムで適応することを可能にする。

従来のウェブサイトは現在のインターネットの基本単位であり、固定されたインターフェースを提供し、ユーザーは事前に設定されたパスを通じて読む・書く・情報をやり取りする。このモデルは効果的ではあるが、一般化された用途のために設計されたインターフェースしか利用できないという制約がある。一方、エージェントネットワークは、文脈認識計算、適応型インターフェース生成、RAGなどの技術によるリアルタイム情報検索によって、こうした制約を打破する。

TikTokがユーザーの好みにリアルタイムで調整されるパーソナライズドコンテンツフィードによって、コンテンツ消費のあり方を変えたことを思い出してほしい。エージェントネットワークはこの考えを、インターフェース生成全体にまで拡張する。ユーザーはもはや固定的なページレイアウトを閲覧するのではなく、ユーザーの次の行動を予測・誘導する動的に生成されたインターフェースと相互作用する。このような静的サイトから動的でエージェント駆動型のインターフェースへの移行は、私たちがデジタルシステムと関わる方法の根本的変革を意味しており、ナビゲーションベースのモデルからインテンション(意図)ベースのインタラクションモデルへの転換である。

エージェントの構成要素

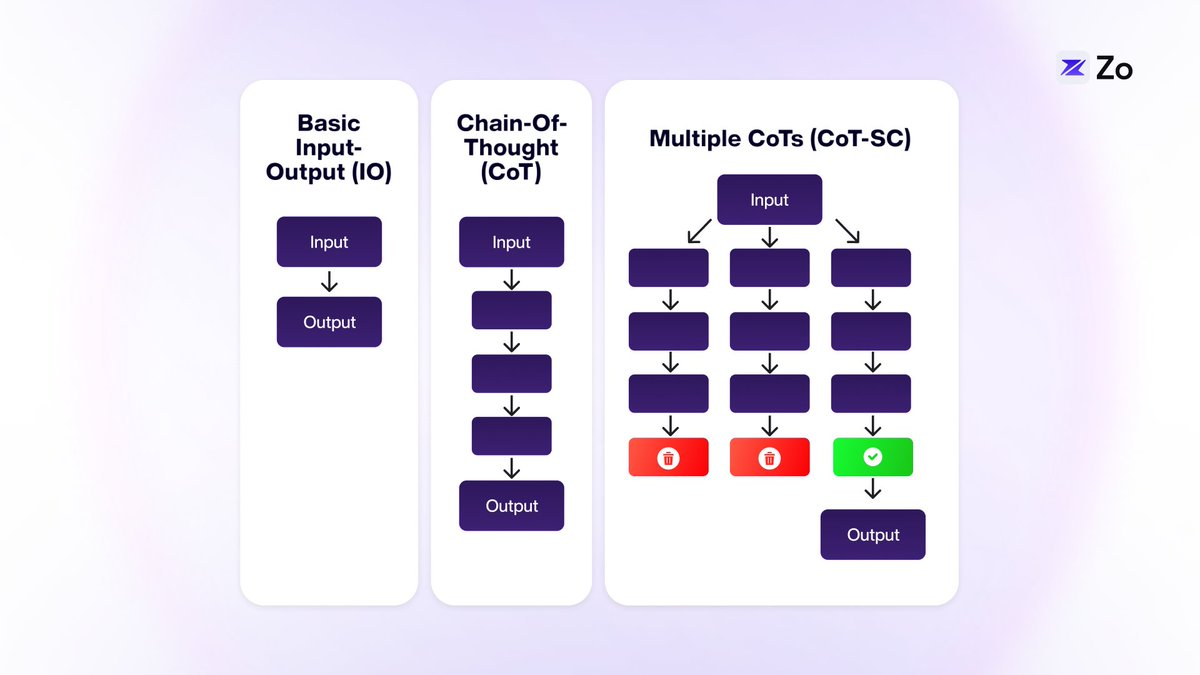

エージェントアーキテクチャは研究者や開発者が積極的に探求している分野である。エージェントの推論力や問題解決能力を高めるために、新たな手法が次々と登場している。例えば、Chain-of-Thought (CoT)、Tree-of-Thought (ToT)、Graph-of-Thought (GoT) といった技術は、より精緻で人間に近い認知プロセスを模倣することで、大規模言語モデル(LLMs)の複雑タスク処理能力を向上させる画期的な試みである。

Chain-of-Thought (CoT) プロンプトは、複雑なタスクをより小さなステップに分解することで、LLMの論理的推論を支援する。この手法はPythonスクリプトの作成や数式の解法など、論理的推論を要する問題に特に有効である。

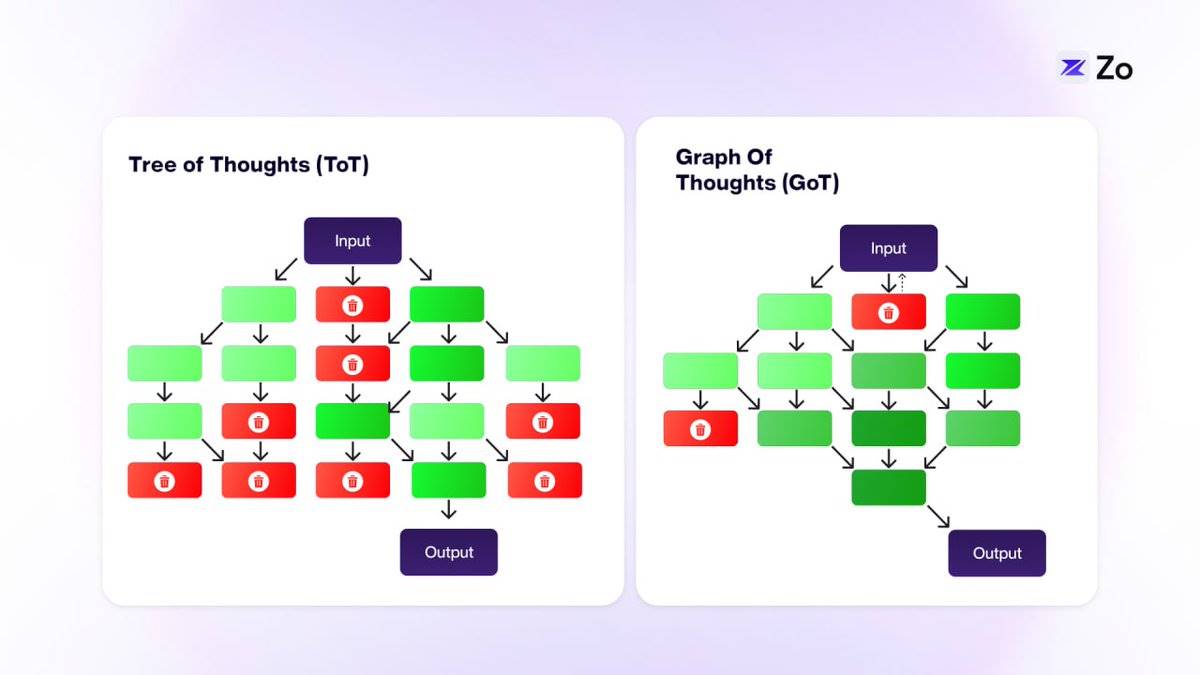

Tree-of-Thoughts (ToT) は、CoTにツリー構造を追加し、複数の独立した思考経路を探査できるようにする。この拡張により、LLMはより複雑なタスクに対応できるようになる。ToTでは各「思考」は前後の思考のみと接続されており、CoTより柔軟だが、思考間の交流には依然制限がある。

Graph-of-Thought (GoT) はさらにこの概念を拡張し、古典的なデータ構造をLLMと統合することで、任意の「思考」がグラフ構造内で他の思考と接続できるようにする。この相互接続された思考ネットワークは、人間の認知方式により近い形態である。

GoTのグラフ構造は、多くの場合においてCoTやToTよりも人間の思考プロセスを正確に反映している。確かに緊急計画や標準操作手順を作成する際には、思考が鎖状または木構造のように展開されることもあるが、これらは個別のケースに過ぎない。人間の思考は通常、線形的な順序ではなく異なるアイデアを横断するものであり、したがってグラフ構造の方が本質的に適している。

GoTのグラフィカルなアプローチにより、思考の探索はより動的かつ柔軟になり、LLMが問題解決時に創造的かつ包括的になる可能性がある。こうした再帰的グラフ操作は、エージェントのワークフローへ向かう第一歩にすぎない。次の進化は、特定の専門性を持つ複数のエージェントを調整して特定の目標を達成する仕組みである。エージェントの強みは、それらを組み合わせることにある。

エージェントにより、LLMはマルチエージェント協調を通じてモジュール化と並列化を実現できる。

マルチエージェントシステム

マルチエージェントシステムの概念は古くから存在する。それはMarvin Minskyの「心的社会(Society of Mind)」理論にまで遡ることができ、複数のモジュール化された心が協力することで、単一の全体的心を上回るとするものだ。ChatGPTやClaudeは単一エージェントであるのに対し、Mistralは専門家混合(Mixture of Experts)を推進している。我々は、この理念をエージェントネットワークアーキテクチャへと拡張することが、この知性のトポロジーの最終形態になると信じている。

バイオミメティクス(生物模倣)の観点から見ると、人間の脳(実際には意識を持つ機械)は臓器レベルおよび細胞レベルで極めて異質的である。これに対して、AIモデルでは数十億個の同一ニューロンが統一的かつ予測可能な方法で接続されている。ニューロン同士は神経伝達物質の勾配、細胞内カスケード、様々な調節系を介して複雑な信号を交わしており、その機能は単純な二値状態よりもはるかに複雑である。

これは生物学において、知能が単に構成要素の数やトレーニングデータセットの規模に依存しているわけではないことを示唆している。むしろ、それは多様化・専門化されたユニット間の複雑な相互作用に由来しており、本質的にアナログ的プロセスなのである。したがって、少数の巨大モデルに依存するよりも、数百万の小型モデルを開発し、それらの協働を調整する方が、認知アーキテクチャ上の革新をもたらす可能性が高い。まさにマルチエージェントシステムのような形で。

マルチエージェントシステム設計には、単一エージェントシステムに比べていくつかの利点がある:保守が容易で、理解しやすく、拡張しやすい。単一エージェントインターフェースだけで十分な場合でも、それをマルチエージェントフレームワーク内に配置すれば、システムのモジュール性が高まり、開発者がニーズに応じてコンポーネントを追加・削除しやすくなる。なお、マルチエージェントアーキテクチャは、単一エージェントシステムを構築するための有効な手段にもなり得る。

大規模言語モデル(LLMs)は類人テキストの生成、複雑問題の解決、多タスク処理など卓越した能力を示しているものの、単一のLLMエージェントは実用上制約を受けることがある。

以下では、エージェントシステムに関連する5つの主要な課題について考察する。

-

クロスバリデーションによるハルシネーションの低減: 単一のLLMエージェントは大量のトレーニングを受けていても、出力が合理的に見えても事実に基づかない誤りや無意味な情報を生成してしまうことが多い。マルチエージェントシステムでは、情報のクロスバリデーションにより誤りのリスクを低下でき、各分野の専門エージェントがより信頼性の高い正確な回答を提供できる。

-

分散処理によるコンテキストウィンドウの拡張: LLMのコンテキストウィンドウは限られており、長文書や長い会話の処理が困難である。マルチエージェントフレームワーク下では、処理タスクを分担し、各エージェントがコンテキストの一部を担当できる。相互にコミュニケーションを取り合うことで、エージェントは全文にわたって整合性を保ちつつ、効果的にコンテキストウィンドウを拡張できる。

-

並列処理による効率向上: 単一のLLMは通常逐次的にタスクを処理するため、レスポンスタイムが遅くなる。マルチエージェントシステムは並列処理をサポートし、複数のエージェントが異なるタスクを同時に実行できるため、効率が向上し、レスポンス速度が速くなり、企業が多数のクエリに迅速に対応できるようになる。

-

協働による複雑問題の解決促進: 単一のLLMは、複数の専門知識を要する複雑な問題の解決に苦戦する可能性がある。マルチエージェントシステムでは協働を通じて、各エージェントが独自のスキルと視点を貢献することで、複雑な課題に効果的に対処し、より包括的で革新的なソリューションを提供できる。

-

リソース最適化によるアクセシビリティ向上: 高度なLLMは大量の計算資源を必要とし、コストが高く、普及が難しい。マルチエージェントフレームワークはタスクを分散させることでリソース使用を最適化し、全体の計算コストを削減し、AI技術をより経済的に、より多くの組織にとって利用しやすくする。

マルチエージェントシステムは分散型問題解決やリソース最適化において明確な利点を持つが、その真正の可能性はネットワークエッジでの応用にこそ表れる。AIの進歩とともに、マルチエージェントアーキテクチャとエッジコンピューティングの統合は強力な相乗効果を生み出す。これにより、協働知能だけでなく、多数のデバイス上でローカルかつ効率的な処理が実現する。この分散型AI展開方式は、マルチエージェントシステムの利点を自然に拡張し、専門化され協働する知能をエンドユーザーに近づける。

エッジインテリジェンス

デジタル世界におけるAIの普及は、コンピューティングアーキテクチャに根本的な変化をもたらしつつある。日常のデジタルインタラクションのあらゆる側面に知能が統合されるにつれ、計算の自然な分化が進行している:専用データセンターは複雑な推論や特定領域のタスクを担当し、エッジデバイスはパーソナライズされた文脈に敏感なクエリをローカルで処理する。このエッジ推論への移行は、単なるアーキテクチャ選択ではなく、複数の重要な要因によって必然化されたトレンドである。

第一に、AI駆動の膨大なインタラクション量は集中型推論プロバイダーを圧倒し、耐え難い帯域幅需要とレイテンシ問題を引き起こす。

第二に、エッジ処理はリアルタイム応答を実現する。これは自動運転、拡張現実(AR)、IoTデバイスなどのアプリケーションにとって不可欠である。

第三に、ローカル推論は機密データを個人のデバイス上に保持することで、ユーザーのプライバシーを保護する。

第四に、エッジコンピューティングはネットワークを越えるデータ転送を大幅に削減することで、エネルギー消費と炭素排出を低減する。

第五に、エッジ推論はオフライン機能と弾力性をサポートし、ネット接続が不十分な場合でもAI機能が利用可能であることを保証する。

この分散型知能モデルは既存システムの最適化にとどまらず、ますます相互接続された世界においてAIをどのように展開・利用するかに関する全く新しい構想である。

さらに、我々は大規模言語モデル(LLMs)の計算ニーズにおける大きな転換期を迎えている。過去10年間、LLMトレーニングに必要な莫大な計算資源が注目されていたが、今や推論時の計算が中心となる時代に入った。この変化は、OpenAIのQ*の突破など、ダイナミックな推論に大量のリアルタイム計算資源が必要なスマートAIシステムの台頭により顕著である。

トレーニング時の計算とはモデル開発の一時的な投資であるのに対し、推論時の計算はエージェントが推論・計画・新環境への適応を行うために必要な持続的なプロセスである。この静的モデルトレーニングから動的エージェント推論への変化は、我々にコンピューティングインフラの再考を迫るものであり、この文脈ではエッジコンピューティングは有利というだけでなく不可欠となる。

この変化が進む中、P2P型エッジ推論市場の台頭が見られる。数十億の接続デバイス――スマートフォンからスマートホームシステムまで――が動的なコンピューティングネットワークを形成する。これらのデバイスは推論能力をシームレスに取引し、有機的な市場を形成する。計算リソースは最も必要とされる場所へと流れる。アイドル状態のデバイスの余剰計算能力が貴重なリソースとなり、リアルタイムで取引可能になることで、従来の集中型システムよりも効率的で弾力性のあるインフラが構築される。

この推論計算の民主化はリソース利用の最適化にとどまらず、デジタルエコシステム内に新たな経済機会を創出する。すべての接続デバイスがAI能力のマイクロプロバイダーとなる可能性を持つ。したがって、AIの未来は単一モデルの能力に依存するのではなく、相互接続されたエッジデバイスからなるグローバルかつ民主化された推論市場に依存する。これは需要と供給に基づくリアルタイム推論スポット市場に似ている。

エージェント中心のインタラクション

大規模言語モデル(LLMs)により、従来のブラウジングではなく対話によって大量の情報を取得できるようになった。この対話型インタラクションは、インターネットが人間ユーザーだけでなくAIエージェント向けのプラットフォームへと変貌するにつれて、ますますパーソナライズされ、ローカル化されていく。

ユーザーの視点からは、「最良のモデル」を探すことに重点が置かれるのではなく、最もパーソナライズされた答えを得ることが重要になる。より良い答えを実現する鍵は、ユーザーの個人データとインターネットの普遍的知識を統合することにある。当初は、より大きなコンテキストウィンドウと検索拡張生成(RAG)技術が個人データの統合を助けるが、最終的には個人データの重要性が一般のインターネットデータを上回る。

この先には、誰もがインターネット上のエキスパートモデルと対話するための個人用AIモデルを持つ未来が待っている。初期のパーソナライゼーションはリモートモデルに依存するが、プライバシーとレスポンス速度への関心が高まるにつれ、より多くのインタラクションがローカルデバイスに移行する。これにより、人間と機械の境界ではなく、個人モデルとインターネットエキスパートモデルの間の新たな境界が形成される。

従来のインターネットが原始データに直接アクセスするモデルは徐々に廃れ、代わりにローカルモデルがリモートのエキスパートモデルと通信して情報を取得し、それを最もパーソナライズされ効率的な方法でユーザーに提示するようになる。これらの個人モデルがユーザーの好みや習慣を深く理解するにつれ、それらは不可欠なものとなっていく。

インターネットは、ローカルの高コンテキスト個人モデルと、リモートの高知識エキスパートモデルで構成される相互接続モデルのエコシステムへと進化する。これにはフェデレーテッドラーニングなどの新たな技術が関与し、モデル間の情報更新が行われる。マシンエコノミーが発展する中で、計算インフラの再構想が必要となる。特に計算能力、スケーラビリティ、支払いの面で。これにより、情報空間はエージェント中心、主権独立、高度に組み合わせ可能、自己学習、継続進化するものへと再編成される。

エージェントプロトコルのアーキテクチャ

エージェントネットワークでは、人間と機械のインタラクションは複雑なエージェント間通信ネットワークへと進化する。このアーキテクチャはインターネットの構造を再構想し、主権を持つエージェントをデジタルインタラクションの主要インターフェースとする。以下に、エージェントプロトコルに必要な核心要素を示す。

主権的アイデンティティ

-

デジタルアイデンティティは、従来のIPアドレスから、エージェントが制御する暗号化公開鍵ペアへと変化する

-

ブロックチェーンベースのネーミングシステムが従来のDNSを置き換え、中央集権的コントロールを排除する

-

評判システムにより、エージェントの信頼性と能力を追跡する

-

ゼロ知識証明により、プライバシーを保護したまま認証を実現する

-

アイデンティティの組み合わせ可能性により、エージェントが複数の文脈や役割を管理できる

自律的エージェント

-

自律的エージェントは以下の能力を持つ:

-

自然言語の理解と意図の解析

-

多段階の計画立案とタスク分解

-

リソース管理と最適化

-

インタラクションとフィードバックからの学習

-

設定されたパラメータ内で自律的な意思決定

-

-

特定機能に特化したエージェントの専門化と市場

-

安全性を確保するための組み込みセキュリティ機構とアラインメントプロトコル

データインフラ

-

リアルタイムデータの取り込みと処理能力

-

分散型データ検証および検査メカニズム

-

以下の技術を統合したハイブリッドシステム:

-

zkTLS

-

従来のトレーニングデータセット

-

リアルタイムWebスクレイピングとデータ合成

-

協働学習ネットワーク

-

-

人間フィードバックによる強化学習(RLHF)ネットワーク

-

分散型フィードバック収集システム

-

品質重み付けされたコンセンサスメカニズム

-

動的モデル調整プロトコル

-

計算レイヤー

-

検証可能な推論プロトコルは以下を保証する:

-

計算の完全性

-

結果の再現性

-

リソース利用の効率性

-

-

分散型コンピューティングインフラには以下が含まれる:

-

P2P計算市場

-

計算証明システム

-

動的リソース割り当て

-

エッジコンピューティングの統合

-

モデルエコシステム

-

階層化モデルアーキテクチャ:

-

特定タスク向けの小型言語モデル(SLMs)

-

汎用の大規模言語モデル(LLMs)

-

専門的マルチモーダルモデル

-

マルチモーダル大規模アクションモデル(LAMs)

-

-

モデルの組み合わせとオーケストレーション

-

継続的学習と適応能力

-

標準化されたモデルインターフェースとプロトコル

調整フレームワーク

-

安全なエージェント間インタラクションのための暗号化プロトコル

-

デジタル財産管理システム

-

経済的インセンティブ構造

-

以下のためのガバナンスメカニズム:

-

紛争解決

-

リソース割り当て

-

プロトコル更新

-

-

並列実行環境のサポート:

-

同時タスク処理

-

リソース分離

-

ステート管理

-

コンフリクト解決

-

エージェント市場

-

チェーン上に存在するアイデンティティプリミティブ(例:GnosisやSquadのマルチシグ)に基づく

-

エージェント間の経済活動と取引

-

エージェントが部分的流動性を持つ

-

エージェントは創設時に自らのトークン供給の一部を保有する

-

流動性による支払いを集約する推論市場

-

-

チェーン上のキーがチェーン外アカウントを制御

-

エージェントが収益資産となる

-

エージェントDAOを通じたガバナンスと配当

-

知性の超構造を構築する

現代の分散システム設計は、エージェントプロトコルの開発にユニークなインスピレーションと基盤を提供している。特にイベント駆動アーキテクチャや計算のアクターモデルの分野において顕著である。

アクターモデルはエージェントシステム構築のための優雅な理論的枠組みを提供する。「アクター」を計算プロセスの基本単位とし、各アクターは以下を行うことができる:

-

メッセージを処理する

-

ローカルな意思決定を行う

-

新しいアクターを作成する

-

他のアクターにメッセージを送信する

-

次に受信するメッセージにどう対応するかを決定する

アクターモデルがエージェントシステムに与える主な利点は以下の通り:

-

隔離性: 各アクターは独立して動作し、自身の状態と制御フローを維持する

-

非同期通信: アクター間のメッセージングはノンブロッキングであり、効率的な並列処理を可能にする

-

位置透過性: アクターはネットワーク内の任意の場所で通信できる

-

障害耐性: アクターの隔離と監督階層により、システムの弾力性が強化される

-

スケーラビリティ: 分散システムと並列計算を自然にサポートする

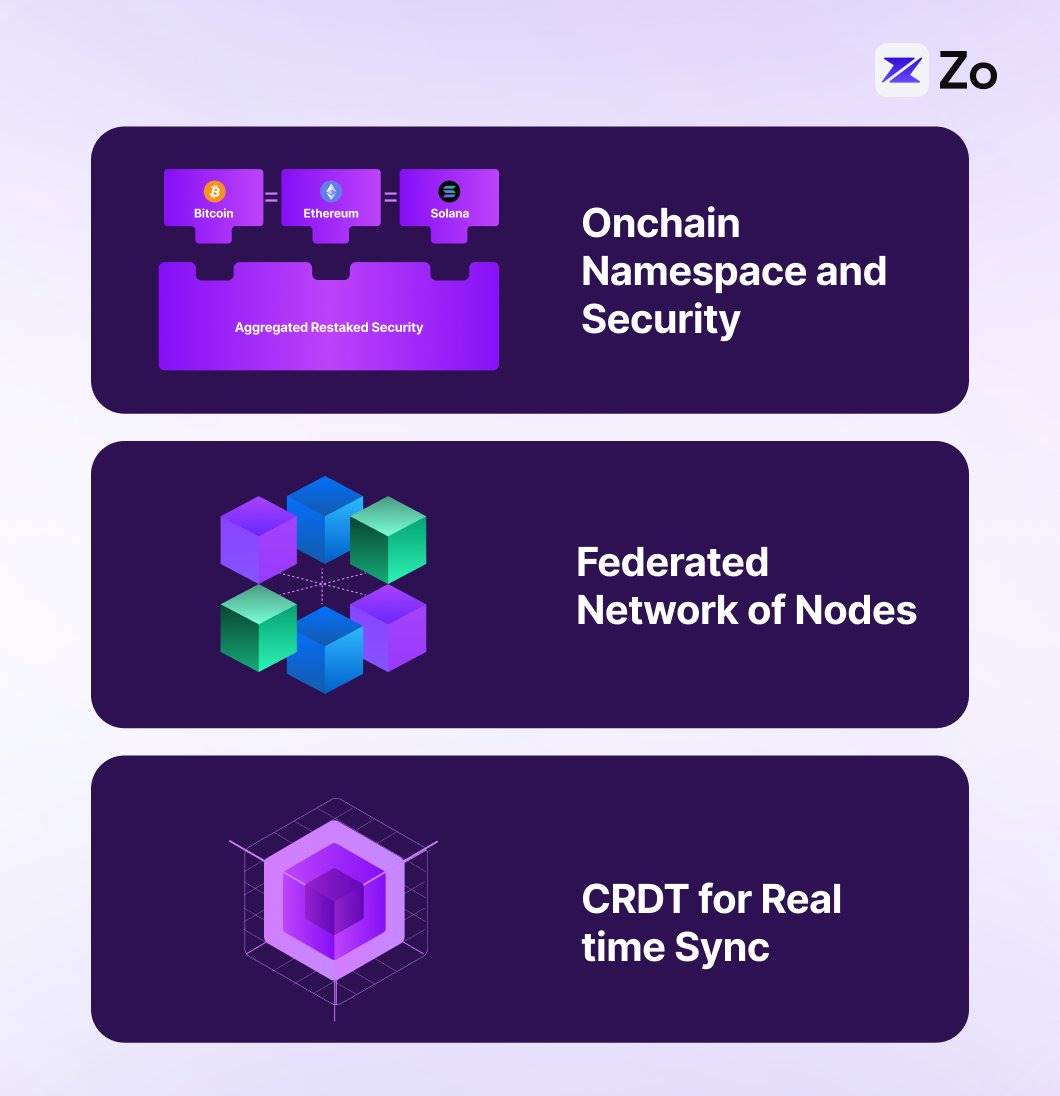

我々はNeuronを提案する。これはブロックチェーン名前空間、フェデレーテッドネットワーク、CRDTs、DHTsを組み合わせた多層分散アーキテクチャにより実現される実用的エージェントプロトコルである。各層はプロトコルスタック内で特定の機能を持つ。UrbitやHolochainといった早期のP2Pオペレーティングシステムの設計思想から着想を得ている。

Neuronでは、ブロックチェーン層が検証可能な名前空間とアイデンティティを提供し、エージェントの決定的アドレッシングと発見を可能にする。また、能力と評判の暗号証明も提供する。その上に、DHT層は効率的なエージェント・ノード発見とコンテンツルーティングを支援し、O(log n)の検索時間を実現する。これによりオンチェーン操作が減少し、局所的なP2P検索が可能になる。フェデレーテッドノード間のステート同期はCRDTsによって行われ、すべてのインタラクションでグローバルコンセンサスを取らずとも、エージェントとノードが一貫した共有ステートビューを維持できる。

このアーキテクチャは、自律的エージェントがデバイス上で独立ノードとして動作し、ローカルエッジ推論を通じてアクターモデルを実現するフェデレーテッドネットワークに自然に適している。フェデレーテッドドメインはエージェントの能力に基づいて組織化され、DHTがドメイン内およびドメイン間の効率的なルーティングと発見を提供する。各エージェントは独立したアクターとして、自身の状態を持ちながら動作し、CRDT層がフェデレーション全体の整合性を保証する。この多層的手法は以下の主要機能を実現する:

分散型協調

-

ブロックチェーンは検証可能なアイデンティティとグローバル名前空間を提供

-

DHTは効率的なノード発見とコンテンツルーティングを提供(検索時間 O(log n))

-

CRDTsは同時ステート同期とマルチエージェント協調を実現

拡張可能な運用

-

領域ベースのフェデレーテッドトポロジー

-

階層的ストレージ戦略(ホット/ウォーム/コールド)

-

局所化されたリクエストルーティング

-

能力に基づく負荷分散

システムの弾力性

-

単一障害点なし

-

パーティション中の継続的運用

-

自動ステート調整

-

故障耐性を持つ監督階層

この実装アプローチは、主権、拡張性、弾力性といった効果的なエージェントインタラクションに必要な本質的属性を維持しつつ、複雑なエージェントシステム構築の堅固な基盤を提供する。

最後に

エージェントネットワークは、人間と機械のインタラクションにおける重要な進化を象徴する。これまでの漸進的発展を超え、新たなデジタル存在の様式を確立するものである。情報の消費や所有の仕方を変えるだけの進化とは異なり、エージェントネットワークはインターネットを人間中心のプラットフォームから、自律的エージェントが主要プレイヤーとなる知的基盤へと変容させる。この変化は、エッジコンピューティング、大規模言語モデル、分散型プロトコルの融合によって推進され、個人用AIモデルと専門エキスパートシステムがシームレスに接続するエコシステムを生み出す。

エージェント中心の未来へと進む中で、人間と機械知能の境界は徐々に曖昧になり、共生関係へと移行する。この関係において、パーソナライズされたAIエージェントは私たちのデジタル延長として機能し、私たちの背景を理解し、ニーズを予見し、広範な分散型知能ネットワークの中で自律的に動作する。したがって、エージェントネットワークは技術的進歩にとどまらず、デジタル時代における人間の可能性に対する根本的な再想像である。このネットワークでは、すべてのインタラクションが知能拡張の機会となり、すべてのデバイスがグローバル協働AIシステムのノードとなる。

人間が空間と時間という物理的次元の中で活動するように、自律的エージェントもまた自身の基本的次元の中で動作する:ブロック空間がその存在を表し、推論時間がその思考を表す。このデジタル本体論は私たちの物理的現実を反映している――人間が空間を移動し時間の流れを体験するのと同様に、エージェントは暗号証明と計算サイクルを通じてアルゴリズム世界で行動し、平行するデジタル宇宙を創造する。

分散型ブロック空間で動作することは、潜在空間における実体にとって必然的な傾向となるだろう。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News