Né à la marge : comment les réseaux décentralisés de puissance de calcul transforment-ils Crypto et l'IA ?

TechFlow SélectionTechFlow Sélection

Né à la marge : comment les réseaux décentralisés de puissance de calcul transforment-ils Crypto et l'IA ?

D'un point de vue le plus réaliste, un réseau décentralisé de puissance de calcul doit prendre en compte à la fois les besoins actuels et les opportunités du marché futur.

Rédaction : Jane Doe, Chen Li

1 La convergence entre l'IA et la crypto

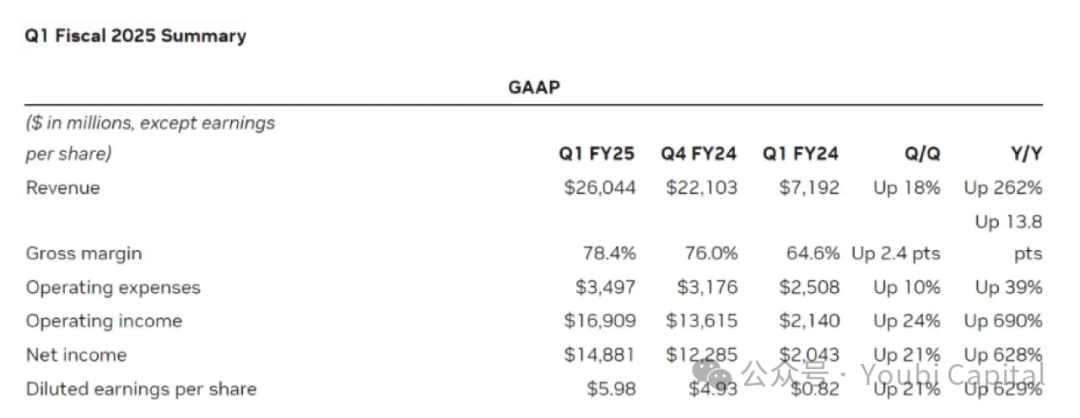

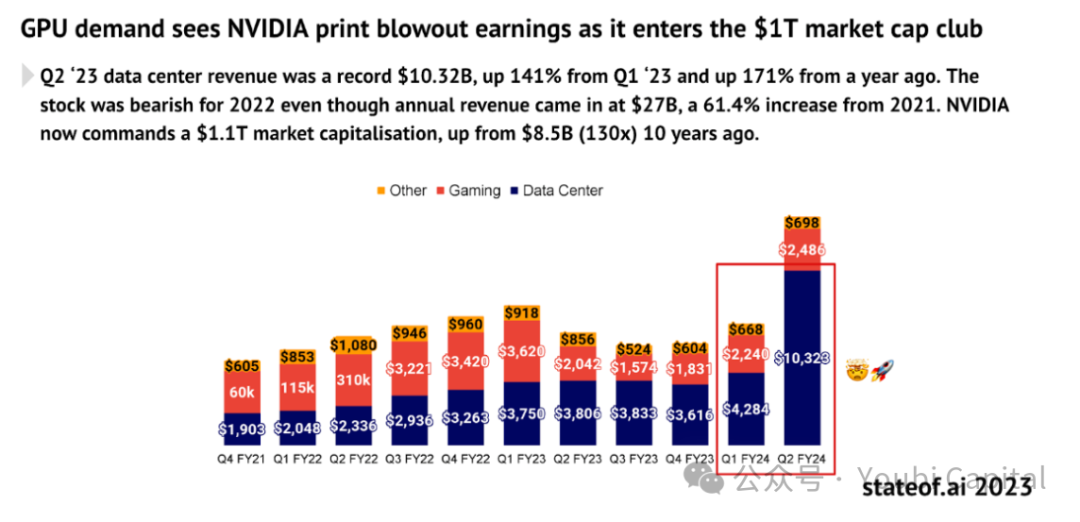

Le 23 mai, le géant des semi-conducteurs NVIDIA a publié ses résultats du premier trimestre de l'exercice 2025. Selon ce rapport, le chiffre d'affaires trimestriel de NVIDIA s'élève à 26 milliards de dollars. Le revenu provenant des centres de données a augmenté de 427 % par rapport à l'année précédente, atteignant un niveau remarquable de 22,6 milliards de dollars. Ce résultat financier exceptionnel, porté quasi seul par NVIDIA, illustre la demande explosive en puissance de calcul déclenchée par les entreprises technologiques mondiales dans la course à l'intelligence artificielle. Plus les grandes entreprises technologiques ambitionnent de jouer un rôle majeur dans le domaine de l'IA, plus leur besoin en puissance de calcul augmente de manière exponentielle. D'après les prévisions de TrendForce, en 2024, les quatre principaux fournisseurs américains de services cloud — Microsoft, Google, AWS et Meta — devraient représenter respectivement 20,2 %, 16,6 %, 16 % et 10,8 % de la demande mondiale en serveurs AI haut de gamme, soit plus de 60 % au total.

« Pénurie de puces » est resté un mot-clé récurrent ces dernières années. D'une part, les grands modèles linguistiques (LLM) nécessitent une puissance de calcul considérable pour l'apprentissage (training) et l'inférence (inference), et cette exigence croît exponentiellement avec chaque itération du modèle. D'autre part, de grandes entreprises comme Meta achètent massivement des puces, ce qui concentre les ressources mondiales en puissance de calcul entre les mains de quelques géants technologiques, rendant toujours plus difficile pour les petites entreprises d'accéder aux ressources dont elles ont besoin. Les difficultés rencontrées par les petites entreprises ne proviennent pas seulement de la pénurie d'offre due à la hausse de la demande, mais aussi de contradictions structurelles au niveau de l'offre. Actuellement, il existe encore de nombreuses unités graphiques (GPU) inutilisées : certains centres de données disposent de puissance de calcul inexploitée (avec un taux d'utilisation de seulement 12 à 18 %), et de nombreux équipements miniers sont désormais inactifs en raison de la baisse des profits. Bien que ces ressources ne conviennent pas toutes aux applications professionnelles telles que l'entraînement de modèles IA, le matériel grand public peut toutefois jouer un rôle important dans d'autres domaines comme l'inférence IA, le rendu de jeux cloud ou les téléphones virtuels. L'opportunité d'intégrer et d'utiliser ces ressources est donc immense.

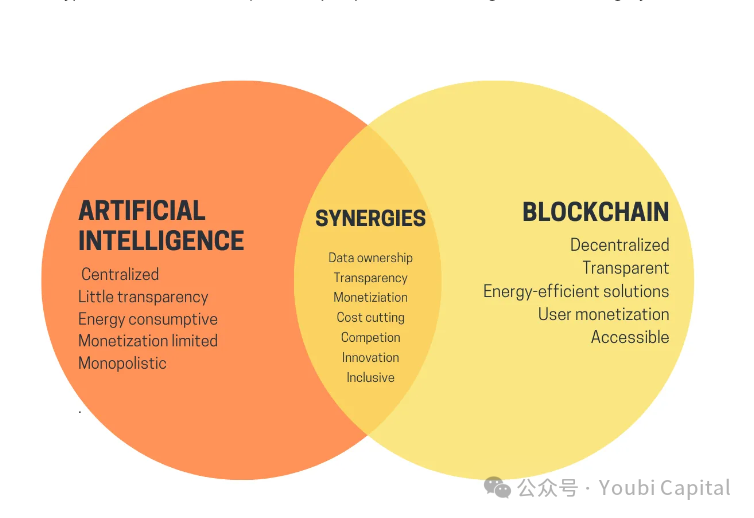

En tournant notre regard de l’IA vers la crypto, après trois ans de léthargie du marché cryptographique, une nouvelle vague haussière est enfin apparue, avec des records successifs du prix du bitcoin et l’émergence continue de nouveaux memecoins. Même si « IA » et « crypto » sont des termes à la mode depuis plusieurs années, l’intelligence artificielle et la blockchain, en tant que deux technologies majeures, semblent jusqu’à présent des lignes parallèles n’ayant pas encore trouvé de « point de convergence ». Au début de cette année, Vitalik a publié un article intitulé « The promise and challenges of crypto + AI applications », explorant les scénarios possibles de combinaison future entre IA et crypto. Dans cet article, il évoque plusieurs visions, notamment utiliser la blockchain et des techniques cryptographiques comme MPC pour décentraliser l’apprentissage et l’inférence des modèles IA, permettant ainsi de rendre la « boîte noire » de l’apprentissage automatique transparente et d’accroître la confiance (trustless) dans les modèles. Réaliser ces ambitions reste un long chemin. Cependant, l’un des cas d’usage mentionnés par Vitalik — utiliser les incitations économiques de la crypto pour renforcer l’IA — constitue une direction importante et réalisable à court terme. Les réseaux de calcul décentralisés représentent aujourd’hui l’un des scénarios les plus pertinents pour combiner IA et crypto.

2 Réseaux de calcul décentralisés

De nombreux projets se développent déjà dans l’espace des réseaux de calcul décentralisés. Leur logique fondamentale est similaire et peut être résumée ainsi : utiliser des tokens pour inciter les détenteurs de puissance de calcul à participer au réseau et fournir leurs ressources. Ces ressources fragmentées peuvent alors être agrégées en un réseau de calcul décentralisé de taille significative. Cela permet non seulement d’améliorer l’utilisation des ressources inactives, mais aussi de répondre aux besoins des clients à moindre coût, créant ainsi une situation gagnant-gagnant pour les offreurs et les demandeurs.

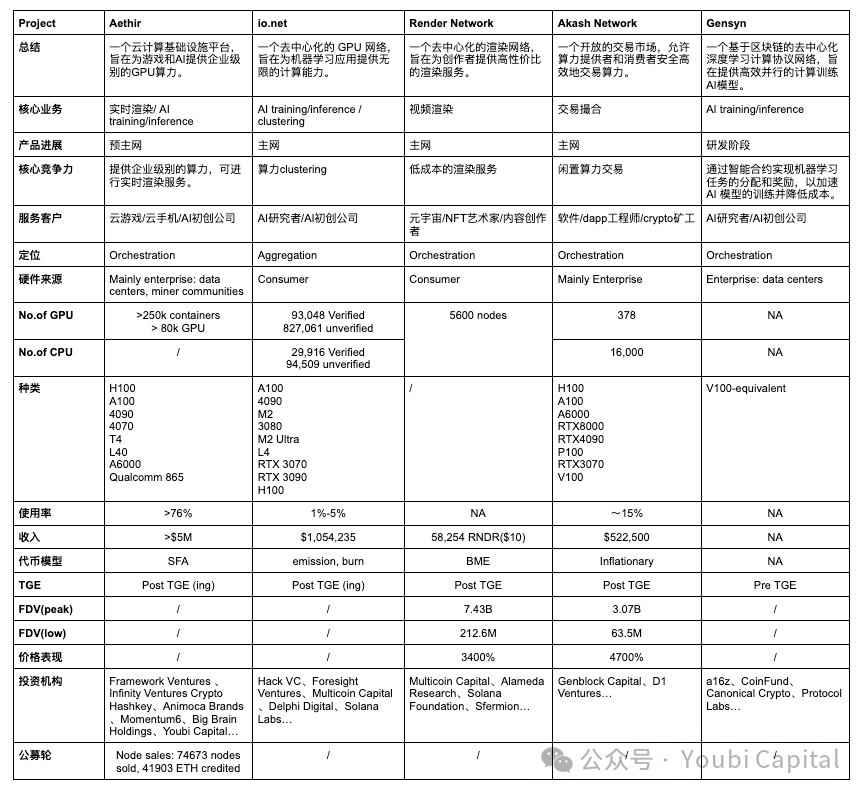

Afin d’aider le lecteur à saisir rapidement l’ensemble du secteur, cet article procédera à une analyse micro-macro des projets spécifiques et du paysage global, dans le but de fournir un cadre d’analyse permettant de comprendre les avantages concurrentiels clés de chaque projet ainsi que l’état général du développement du secteur. Nous présenterons et analyserons cinq projets : Aethir, io.net, Render Network, Akash Network et Gensyn, avant de conclure par une synthèse et une évaluation générale.

Du point de vue du cadre d’analyse, lorsqu’on examine un réseau de calcul décentralisé spécifique, on peut le décomposer en quatre composantes essentielles :

-

Réseau matériel : Intégration des ressources de calcul dispersées via des nœuds répartis dans le monde entier afin de partager les ressources et d’équilibrer la charge. Cette couche constitue la base du réseau de calcul décentralisé.

-

Marché biface : Mise en relation efficace des fournisseurs et des utilisateurs de puissance de calcul grâce à des mécanismes de tarification et de découverte adaptés, avec une plateforme d’échange sécurisée garantissant transparence, équité et fiabilité des transactions.

-

Mécanisme de consensus : Assure que les nœuds du réseau fonctionnent correctement et accomplissent bien leurs tâches. Il surveille deux niveaux : 1) Vérifier qu’un nœud est en ligne et prêt à accepter des tâches ; 2) Preuve de travail : confirmer qu’un nœud a exécuté sa tâche correctement sans avoir détourné ses ressources pour d’autres usages.

-

Incentivation par token : Le modèle de token vise à inciter davantage d’acteurs à fournir ou utiliser le service, tout en capturant cet effet de réseau pour permettre un partage des bénéfices au sein de la communauté.

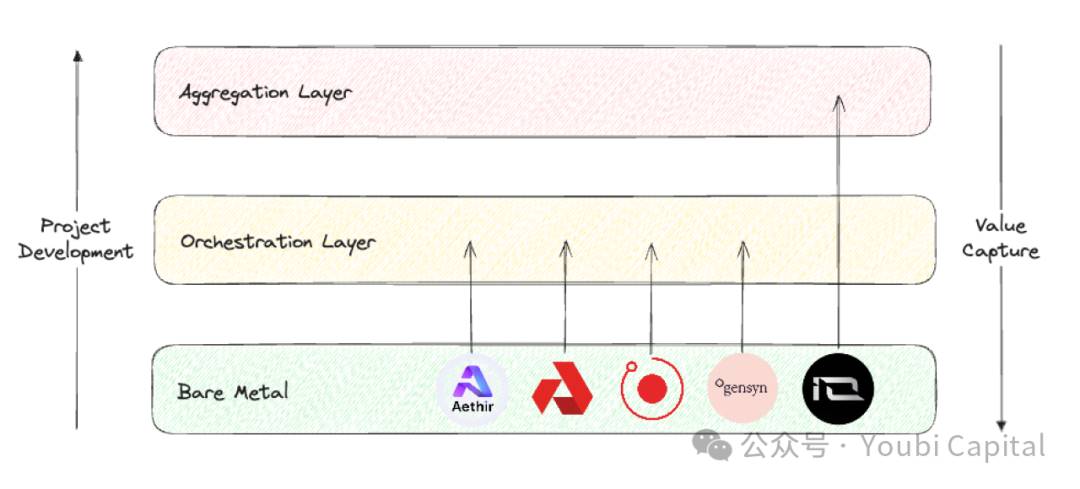

Pour prendre une vue d’ensemble du secteur des réseaux de calcul décentralisés, le rapport de Blockworks Research propose un excellent cadre d’analyse, divisant les projets selon trois couches distinctes :

-

Couche Bare metal : Couche de base de la pile de calcul décentralisé. Son objectif principal est de collecter les ressources brutes de calcul et de les rendre accessibles via API.

-

Couche Orchestration : Couche intermédiaire de la pile, chargée de coordonner et d’abstraire les opérations. Elle gère la planification, l’extension, les opérations, l’équilibrage de charge et la tolérance aux pannes. Son rôle principal est d’« abstraire » la complexité de gestion matérielle sous-jacente, offrant une interface utilisateur plus avancée et ciblée vers des segments spécifiques.

-

Couche Aggregation : Couche supérieure de la pile, responsable de l’intégration. Elle fournit une interface unique permettant aux utilisateurs d’exécuter diverses tâches de calcul (IA, rendu, zkML, etc.) au même endroit, agissant comme une couche d’orchestration et de distribution de multiples services de calcul décentralisés.

Source de l'image : Youbi Capital

Sur la base de ces deux cadres d’analyse, nous effectuerons une comparaison horizontale des cinq projets sélectionnés, et les évaluerons selon quatre dimensions : activités principales, positionnement sur le marché, infrastructure matérielle et performance financière.

2.1 Activités principales

D’un point de vue fondamental, les réseaux de calcul décentralisés sont fortement homogènes : ils reposent tous sur l’incitation par token pour mobiliser les détenteurs de puissance de calcul inutilisée. Autour de cette logique centrale, on peut distinguer les différences entre projets selon trois aspects :

-

Origine de la puissance de calcul inutilisée :

-

Il existe deux sources principales de puissance de calcul disponible : 1) Entreprises telles que centres de données ou mineurs disposant de ressources inutilisées ; 2) Utilisateurs individuels (retail) ayant du matériel inemployé. Les centres de données utilisent généralement du matériel professionnel, tandis que les particuliers optent souvent pour des puces grand public.

-

Aethir, Akash Network et Gensyn collectent principalement leur puissance de calcul auprès d’entreprises. Les avantages de cette approche incluent : 1) Des entreprises et centres de données disposent généralement de matériel de meilleure qualité et d’équipes de maintenance spécialisées, assurant des performances et une fiabilité élevées ; 2) Les ressources sont plus homogènes, et une gestion centralisée facilite la planification et la maintenance. Toutefois, cela impose aux projets des exigences élevées en termes de relations commerciales avec les entreprises détenant ces ressources. En outre, cela peut limiter la scalabilité et le degré de décentralisation.

-

Render Network et io.net reposent principalement sur l’incitation des particuliers à fournir leur puissance de calcul inutilisée. Les avantages de cette méthode sont : 1) Le coût explicite des ressources individuelles est faible, offrant des solutions de calcul plus économiques ; 2) Une meilleure scalabilité et un plus haut niveau de décentralisation, renforçant la résilience du système. Cependant, les ressources sont dispersées et hétérogènes, rendant la gestion et la coordination complexes. De plus, démarrer le réseau (kickstart) est plus difficile, et les appareils des particuliers posent des risques accrus de sécurité, notamment fuites de données ou détournement des ressources.

-

Consommateurs de puissance de calcul

-

En matière de consommateurs, Aethir, io.net et Gensyn ciblent principalement les entreprises (B2B). Pour les clients professionnels, les besoins en calcul haute performance liés à l’IA ou au rendu en temps réel des jeux sont importants. Ces charges de travail exigent des GPU haut de gamme ou du matériel spécialisé. De plus, les entreprises exigent une grande stabilité et fiabilité, nécessitant des accords de niveau de service (SLA) robustes, un support technique rapide et une continuité opérationnelle. En outre, le coût de migration est élevé : si le réseau décentralisé ne dispose pas d’un SDK mature permettant un déploiement facile (comme Akash Network, où l’utilisateur doit développer via des ports distants), il sera difficile de convaincre les clients de migrer. Sans un avantage de prix très marqué, la volonté de changement reste faible.

-

Render Network et Akash Network proposent principalement des services destinés aux particuliers (B2C). Pour servir les consommateurs, les projets doivent concevoir des interfaces simples et des outils faciles à utiliser, en veillant à l’expérience utilisateur. Comme les particuliers sont sensibles aux prix, les projets doivent proposer des tarifs compétitifs.

-

Type de matériel

-

Les ressources matérielles courantes incluent CPU, FPGA, GPU, ASIC et SoC. Chacun présente des différences notables en termes d’objectif de conception, de performances et de domaines d’application. En résumé, le CPU excelle dans les tâches de calcul généralistes, le FPGA brille par son traitement parallèle et sa programmabilité, le GPU domine le calcul parallèle, l’ASIC est le plus efficace pour des tâches spécifiques, tandis que le SoC intègre plusieurs fonctions en un seul composant, adapté aux applications hautement intégrées. Le choix dépend des besoins spécifiques, des performances requises et des contraintes budgétaires. La plupart des projets étudiés se concentrent sur la collecte de puissance GPU, en raison des caractéristiques du matériel et des types d’applications visées, car le GPU est particulièrement performant pour l’entraînement IA, le calcul parallèle et le rendu multimédia.

-

Bien que ces projets impliquent majoritairement des GPU, les différentes applications imposent des exigences variées, entraînant des optimisations hétérogènes en termes de cœur de calcul et de paramètres. Ces paramètres incluent le parallélisme/dépendances sérielles, la mémoire, la latence, etc. Par exemple, le rendu est mieux adapté aux GPU grand public qu’aux puissants GPU de data center, car il exige des capacités de traçage de rayons (ray tracing) élevées, que des puces comme les RTX 4090 optimisent via des cœurs RT dédiés. À l’inverse, l’entraînement et l’inférence IA nécessitent des GPU professionnels. Ainsi, Render Network peut rassembler des RTX 3090 et 4090 auprès des particuliers, tandis qu’io.net a besoin de GPU professionnels comme H100 ou A100 pour répondre aux besoins des startups IA.

2.2 Positionnement sur le marché

En ce qui concerne le positionnement des projets, les couches bare metal, orchestration et aggregation doivent résoudre des problèmes différents, avec des priorités d’optimisation et des capacités de capture de valeur distinctes.

-

La couche bare metal se concentre sur la collecte et l’utilisation des ressources physiques, la couche orchestration sur la planification et l’optimisation du calcul, en adaptant le matériel aux besoins des clients. La couche aggregation est polyvalente, axée sur l’intégration et l’abstraction de ressources diverses. Sur la chaîne de valeur, les projets devraient partir de la couche bare metal pour progressivement monter en amont.

-

En termes de capture de valeur, celle-ci augmente progressivement de la couche bare metal à la couche aggregation. La couche aggregation capte la plus grande valeur, car elle bénéficie du plus fort effet de réseau, touche directement le plus grand nombre d’utilisateurs, agissant comme une porte d’entrée du réseau décentralisé, occupant ainsi la position la plus valorisée dans la pile de gestion des ressources de calcul.

-

Toutefois, construire une plateforme d’agrégation est extrêmement complexe. Le projet doit résoudre simultanément des défis techniques, la gestion de ressources hétérogènes, la fiabilité et la scalabilité du système, la mise en œuvre de l’effet de réseau, la sécurité, la protection de la vie privée et une gestion opérationnelle complexe. Ces obstacles rendent le démarrage difficile et dépendent fortement du moment et de l’évolution du secteur. Tenter de créer une couche aggregation avant que la couche orchestration ne soit suffisamment mature et ne capte une part significative du marché est irréaliste.

-

Actuellement, Aethir, Render Network, Akash Network et Gensyn appartiennent à la couche orchestration, chacun ciblant un segment client spécifique. Aethir se concentre actuellement sur le rendu en temps réel pour les jeux cloud, offrant aux clients B2B environnement de développement et outils de déploiement ; Render Network se spécialise dans le rendu vidéo, Akash Network vise à être une place de marché similaire à Taobao, tandis que Gensyn se concentre sur l’entraînement IA. io.net vise la couche aggregation, mais ses fonctionnalités actuelles sont encore loin d’atteindre ce stade complet. Bien qu’il ait déjà intégré le matériel de Render Network et Filecoin, l’abstraction et l’intégration des ressources restent incomplètes.

2.3 Infrastructure matérielle

-

Actuellement, tous les projets ne publient pas de données détaillées sur leur réseau. En revanche, l’explorateur de io.net offre l’interface utilisateur la plus complète, affichant le nombre et type de GPU/CPU, les prix, la répartition géographique, l’utilisation du réseau, les revenus des nœuds, etc. Toutefois, fin avril, l’interface front-end de io.net a été attaquée : comme aucune authentification n’était en place pour les requêtes PUT/POST, des hackers ont pu altérer les données affichées. Cet incident souligne les risques liés à la confidentialité et à la fiabilité des données réseau pour les autres projets.

-

En termes de quantité et de modèle de GPU, io.net, en tant que plateforme d’agrégation, devrait théoriquement disposer du plus grand volume de matériel. Aethir suit de près, tandis que les autres projets manquent de transparence. Concernant les modèles, io.net combine des GPU professionnels comme A100 et des GPU grand public comme 4090, reflétant son positionnement d’agrégation. Il peut ainsi choisir le GPU le plus adapté à chaque tâche. Toutefois, la diversité des modèles et marques implique des pilotes et configurations différents, nécessitant des optimisations logicielles complexes, augmentant ainsi la difficulté de gestion.

-

Aethir a lancé son propre matériel minier. En mai, Aethir Edge, développé avec le soutien de Qualcomm, a été officiellement introduit. Ce dispositif remplace le modèle traditionnel de clusters GPU centralisés éloignés des utilisateurs, en déployant la puissance de calcul en périphérie (edge). Associant la puissance des clusters H100, Aethir Edge permettra de déployer des modèles pré-entraînés pour fournir des services d’inférence à coût optimal. Cette solution, plus proche de l’utilisateur, assure une rapidité de service accrue et un meilleur rapport qualité-prix.

-

En matière d’offre et de demande, prenons Akash Network comme exemple : ses statistiques indiquent environ 16 000 unités CPU et 378 GPU. Le taux d’utilisation est de 11,1 % pour les CPU et 19,3 % pour les GPU. Seuls les GPU professionnels H100 sont largement loués, tandis que la majorité des autres modèles restent inutilisés. Les autres réseaux connaissent une situation similaire : la demande globale reste faible, et hormis les puces populaires comme A100 ou H100, la plupart des ressources sont inactives.

-

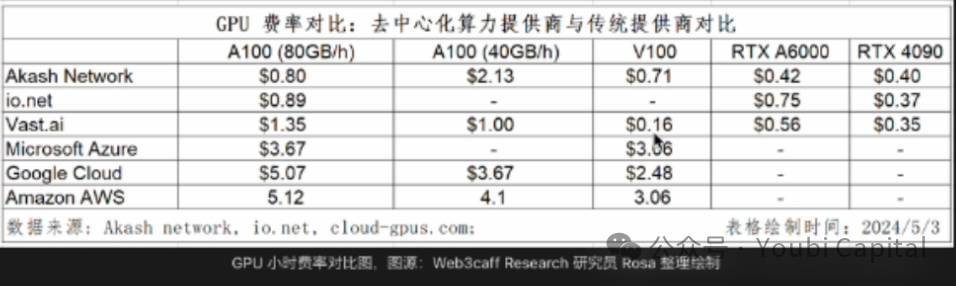

En termes d’avantage de prix, la différence avec les géants du cloud computing ou les fournisseurs traditionnels n’est pas marquée.

2.4 Performance financière

-

Quelle que soit la conception du modèle de token, une économie saine doit respecter plusieurs conditions fondamentales : 1) La demande du réseau doit se refléter dans le prix du token, c’est-à-dire que le token doit pouvoir capturer de la valeur ; 2) Tous les participants — développeurs, nœuds, utilisateurs — doivent bénéficier d’incitations équitables et durables ; 3) Garantir une gouvernance décentralisée, évitant une concentration excessive entre les mains d’initiés ; 4) Mettre en place un mécanisme raisonnable d’inflation/déflation et un calendrier de libération des tokens, afin d’éviter des fluctuations excessives nuisant à la stabilité et à la pérennité du réseau.

-

Si l’on classe schématiquement les modèles de token en deux catégories — BME (Burn and Mint Equilibrium) et SFA (Stake for Access) —, les pressions déflationnistes diffèrent : dans le modèle BME, les tokens sont brûlés après utilisation du service, donc la déflation dépend de la demande. Dans le modèle SFA, les fournisseurs doivent staker des tokens pour accéder au service, donc la déflation dépend de l’offre. Le modèle BME convient mieux aux biens non standardisés. Mais s’il n’y a pas assez de demande, il peut faire face à une inflation continue. Bien que les détails varient, Aethir penche plutôt vers SFA, tandis qu’io.net, Render Network et Akash Network adoptent une approche BME. Quant à Gensyn, son modèle n’est pas encore connu.

-

En termes de revenus, la demande se reflète directement dans le chiffre d’affaires global du réseau (sans compter les revenus des mineurs, qui incluent des subventions du projet). Selon les données publiques, io.net affiche les revenus les plus élevés. Bien que ceux d’Aethir ne soient pas encore publiés, le projet a annoncé avoir signé des commandes avec de nombreux clients B2B.

-

En ce qui concerne le prix du token, seuls Render Network et Akash Network ont effectué un ICO à ce jour. Aethir et io.net ont récemment lancé leurs tokens ; leurs performances restent à observer. Le plan de Gensyn n’est pas clair. En combinant les deux projets lancés et d’autres projets similaires hors du champ de cet article, dans l’ensemble, les réseaux de calcul décentralisés affichent des performances de prix très prometteuses, reflétant un potentiel de marché considérable et de hautes attentes communautaires.

2.5 Synthèse

-

Le secteur des réseaux de calcul décentralisés connaît une croissance rapide : de nombreux projets peuvent désormais servir des clients et générer des revenus. Le secteur a dépassé la phase purement narrative pour entrer dans une phase de livraison de services initiaux.

-

La faiblesse de la demande est un problème commun à tous ces réseaux. La demande à long terme des clients n’a pas encore été suffisamment validée ni explorée. Toutefois, cela n’a pas trop affecté les prix des tokens, qui affichent de bons résultats pour les projets lancés.

-

L’IA constitue la principale narration, mais pas la seule activité. Outre l’entraînement et l’inférence IA, la puissance de calcul peut aussi servir au rendu en temps réel des jeux cloud, aux services de cloud phone, etc.

-

Les réseaux de calcul sont fortement hétérogènes ; leur qualité et leur échelle doivent encore s’améliorer.

-

Pour les utilisateurs particuliers, l’avantage de coût n’est pas très marqué. Pour les entreprises, outre l’économie, des facteurs comme la stabilité, la fiabilité, le support technique, la conformité et l’assistance juridique sont cruciaux — domaines où les projets Web3 sont généralement moins performants.

3 Conclusion

La demande massive en puissance de calcul générée par l’essor explosif de l’IA ne fait aucun doute. Depuis 2012, la puissance utilisée pour l’entraînement des modèles d’IA croît de manière exponentielle, doublant tous les 3,5 mois (contre 18 mois pour la loi de Moore). Depuis 2012, la demande a augmenté de plus de 300 000 fois, contre seulement 12 fois selon la loi de Moore. On prévoit que le marché des GPU atteindra plus de 200 milliards de dollars dans cinq ans, avec un taux de croissance annuel composé de 32 %. AMD va plus loin : elle estime que le marché des puces GPU atteindra 400 milliards de dollars d’ici 2027.

Source de l'image : https://www.stateof.ai/

La croissance fulgurante de l’IA et d’autres charges de travail intensives (comme le rendu AR/VR) met en lumière les inefficacités structurelles des modèles traditionnels de cloud computing et du marché dominant du calcul. Théoriquement, les réseaux de calcul décentralisés, en exploitant les ressources distribuées inutilisées, peuvent offrir des solutions plus flexibles, moins coûteuses et plus efficaces pour répondre à cette demande massive. Par conséquent, la convergence entre crypto et IA recèle un potentiel colossal, mais elle fait face à une concurrence féroce avec les entreprises traditionnelles, à des barrières d’entrée élevées et à un environnement de marché complexe. Dans l’ensemble, parmi tous les secteurs de la crypto, les réseaux de calcul décentralisés constituent l’un des rares domaines verticaux susceptibles d’attirer une véritable demande.

Source de l'image : https://vitalik.eth.limo/general/2024/01/30/cryptoai.html

L’avenir est prometteur, mais le chemin sera sinueux. Pour atteindre ces objectifs, de nombreux défis doivent être relevés. En résumé : actuellement, proposer simplement des services cloud traditionnels laisse de très faibles marges. Du côté de la demande, les grandes entreprises construisent généralement leur propre puissance de calcul, tandis que les développeurs individuels optent pour les services cloud. Il reste à explorer et valider si les PME, véritables utilisateurs potentiels des réseaux décentralisés, auront une demande stable. D’autre part, l’IA est un marché vaste, aux perspectives immenses. Pour conquérir ce marché, les fournisseurs de calcul décentralisés devront évoluer vers des services de modèles ou d’IA, explorer davantage de cas d’usage crypto+IA, et élargir la valeur créée. Pourtant, plusieurs obstacles persistent :

-

Avantage de prix peu marqué : Les comparaisons montrent que l’avantage en coût des réseaux décentralisés n’est pas évident. Cela s’explique par le fait que pour les puces professionnelles très demandées comme H100 ou A100, le mécanisme de marché fixe naturellement des prix élevés. De plus, bien que ces réseaux exploitent des ressources inutilisées, ils souffrent d’un manque d’économies d’échelle, de coûts élevés en bande passante et réseau, et d’une complexité opérationnelle majeure, qui alourdissent les coûts cachés.

-

Spécificité de l’entraînement IA : Utiliser une approche décentralisée pour l’entraînement IA rencontre actuellement de graves obstacles techniques. Cela se voit dans le flux de travail des GPU : lors de l’entraînement d’un grand modèle linguistique, chaque GPU reçoit un lot de données prétraitées, calcule la propagation avant et arrière pour générer des gradients, puis synchronise et met à jour les paramètres du modèle avec les autres GPU. Ce processus se répète jusqu’à convergence. Cette synchronisation constante implique d’énormes transferts de données. Les stratégies de parallélisation, l’optimisation de la bande passante et de la latence, la réduction des coûts de communication — autant de questions encore mal résolues. Pour l’instant, former des modèles IA sur un réseau de calcul décentralisé n’est guère réaliste.

-

Sécurité des données et vie privée : Pendant l’entraînement des grands modèles linguistiques, chaque étape — distribution des données, entraînement, agrégation des gradients — peut compromettre la sécurité et la confidentialité. La protection de la vie privée des données est encore plus critique que celle des modèles. Tant que ce problème ne sera pas résolu, l’adoption à grande échelle restera impossible.

D’un point de vue réaliste, un réseau de calcul décentralisé doit concilier exploration immédiate de la demande et expansion future. Il lui faut définir précisément son produit et sa cible — par exemple, commencer par des projets non IA ou natifs Web3, s’attaquer à des besoins secondaires pour bâtir une base d’utilisateurs précoces. Parallèlement, il doit continuer d’explorer divers scénarios de convergence entre IA et crypto, repousser les limites technologiques et transformer ses services.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News