Proof of Validator : le puzzle de sécurité essentiel pour l'extension d'Ethereum

TechFlow SélectionTechFlow Sélection

Proof of Validator : le puzzle de sécurité essentiel pour l'extension d'Ethereum

Les performances et la sécurité sont des priorités absolues pour Ethereum. La première détermine le plafond, la seconde fixe le niveau minimal.

Rédaction : TechFlow

Aujourd'hui, un nouveau concept est apparu discrètement sur le forum de recherche d'Ethereum : Proof of Validator.

Ce mécanisme de protocole permet à un nœud du réseau de prouver qu'il est un validateur Ethereum sans révéler son identité spécifique.

Quel rapport cela a-t-il avec nous ?

En général, le marché s'intéresse davantage aux récits superficiels générés par certaines innovations technologiques sur Ethereum, sans souvent approfondir suffisamment la technologie elle-même. Par exemple, pour la mise à niveau Shanghai, la fusion (merge), la transition du PoW au PoS ou encore le scaling, le marché retient surtout les histoires autour des LSD, LSDFi et du re-staking.

Mais n'oublions pas que les performances et la sécurité sont primordiales pour Ethereum. Les premières déterminent son plafond, les secondes son plancher.

On constate clairement qu'Ethereum poursuit activement diverses solutions de scaling pour améliorer ses performances. Toutefois, en parallèle, lors de cette expansion, il doit non seulement renforcer ses capacités internes, mais aussi se protéger contre les attaques externes.

Par exemple, si les nœuds validateurs étaient attaqués, entraînant une indisponibilité des données, tous les récits construits sur la logique de mise en gage d'Ethereum ainsi que ses solutions de scaling risqueraient d'être gravement affectés. Cependant, ces impacts et risques restent cachés, difficilement perceptibles pour les utilisateurs finaux et les spéculateurs, qui s'en préoccupent parfois même peu.

Et Proof of Validator, dont il sera question ici, pourrait bien être l'élément clé de sécurité manquant dans la voie du scaling d'Ethereum.

Puisque le scaling est inévitable, réduire les risques potentiels durant ce processus constitue une problématique de sécurité incontournable, étroitement liée à chacun d'entre nous dans l'écosystème.

Il est donc nécessaire de comprendre pleinement ce nouveau Proof of Validator. Toutefois, le contenu publié sur le forum technique étant fragmenté et très technique, impliquant de nombreux concepts et solutions de scaling, TechFlow a synthétisé le fil original et les informations essentielles afin d'expliquer le contexte, la nécessité et les implications potentielles de Proof of Validator.

Échantillonnage de disponibilité des données (Data Availability Sampling) : la percée vers le scaling

Avant d'aborder formellement Proof of Validator, il convient de bien comprendre la logique actuelle du scaling d'Ethereum, ainsi que les risques potentiels associés.

La communauté Ethereum développe activement plusieurs plans de scaling. Parmi eux, l’échantillonnage de disponibilité des données (DAS) est considéré comme la technologie la plus cruciale.

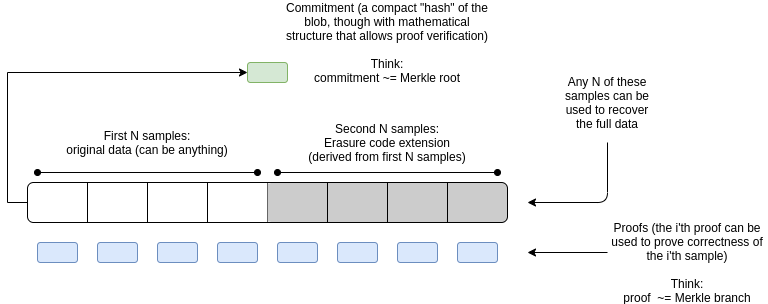

Son principe consiste à diviser les données complètes d’un bloc en plusieurs « échantillons (samples) ». Les nœuds du réseau n’ont besoin de récupérer que quelques échantillons liés à leurs intérêts pour pouvoir valider l’intégralité du bloc.

Cela réduit considérablement la charge de stockage et de calcul pour chaque nœud. Pour mieux comprendre, c’est comme un sondage d’opinion : en interrogeant un échantillon représentatif de personnes, on peut inférer l’état général de la population entière.

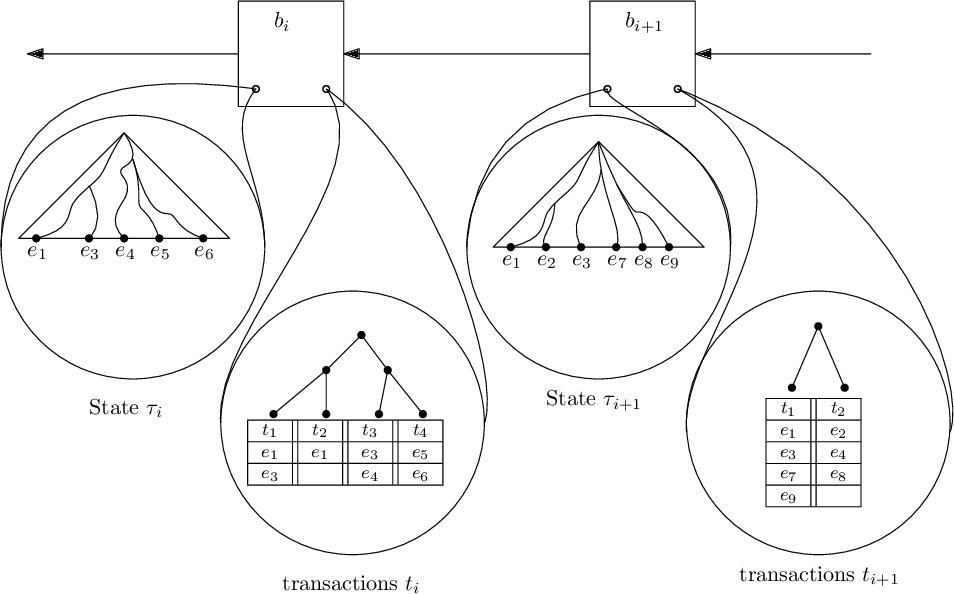

Plus précisément, la mise en œuvre du DAS peut être décrite ainsi :

-

Le producteur de bloc divise les données du bloc en plusieurs échantillons.

-

Chaque nœud du réseau ne récupère qu’un petit nombre d’échantillons pertinents pour lui, plutôt que l’ensemble complet des données du bloc.

-

Les nœuds peuvent obtenir différents échantillons aléatoirement pour vérifier si les données complètes du bloc sont disponibles.

Grâce à cet échantillonnage, même si chaque nœud traite peu de données, leur action combinée permet de valider entièrement la disponibilité des données de la blockchain. Cela permet d’augmenter significativement la taille des blocs, réalisant ainsi un scaling rapide.

Toutefois, ce schéma d’échantillonnage soulève une question clé : où stocker ces nombreux échantillons ? Une infrastructure réseau décentralisée complète est nécessaire pour y répondre.

Table de hachage distribuée (DHT) : la maison des échantillons

C’est là que la table de hachage distribuée (DHT) entre en jeu.

La DHT peut être vue comme une immense base de données distribuée, utilisant une fonction de hachage pour mapper les données vers un espace d’adresses. Différents nœuds gèrent alors les segments correspondants de cet espace. Elle permet de rechercher et stocker rapidement des échantillons au sein d’un grand nombre de nœuds.

Concrètement, après que le DAS a divisé les données du bloc en plusieurs échantillons, ceux-ci doivent être distribués et stockés sur différents nœuds du réseau. La DHT fournit une méthode décentralisée pour stocker et retrouver ces échantillons. L’idée fondamentale est la suivante :

-

Utiliser une fonction de hachage cohérente pour mapper chaque échantillon vers un vaste espace d’adresses.

-

Chaque nœud du réseau est responsable du stockage et de la fourniture des données situées dans une plage d’adresses spécifique.

- Lorsqu’un échantillon est demandé, on calcule son adresse via le hachage, puis on recherche le nœud responsable de cette plage d’adresses pour récupérer l’échantillon.

Par exemple, selon certaines règles, chaque échantillon peut être haché en une adresse. Le nœud A gère les adresses 0-1000, le nœud B les adresses 1001-2000.

Un échantillon d’adresse 599 sera donc stocké sur le nœud A. Pour l’obtenir, on calcule à nouveau son adresse (599), puis on cherche dans le réseau le nœud A responsable de cette plage, et on récupère l’échantillon auprès de lui.

Cette approche contourne les limites du stockage centralisé, augmentant fortement la tolérance aux pannes et l’évolutivité. C’est exactement l’infrastructure réseau dont a besoin le stockage des échantillons DAS.

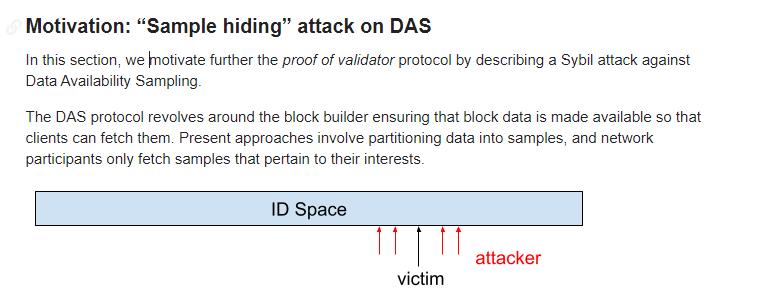

Comparée au stockage et à la récupération centralisés, la DHT améliore la tolérance aux pannes, évite les points de défaillance unique, et renforce l’évolutivité du réseau. De plus, elle aide à contrer certaines attaques mentionnées dans le DAS, telles que l’attaque « sample hiding ».

Le point faible de la DHT : l’attaque Sybil

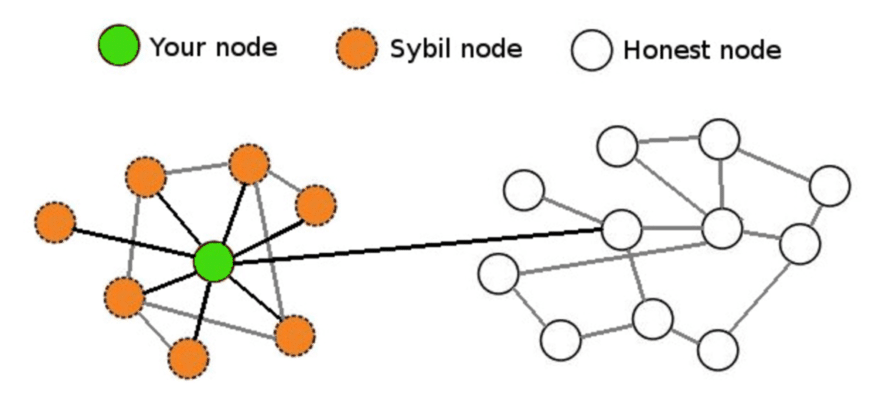

Toutefois, la DHT présente une faiblesse critique : elle est vulnérable aux attaques Sybil. Un attaquant peut créer un grand nombre de faux nœuds dans le réseau, noyant ainsi les nœuds honnêtes.

Par analogie, imaginez un vendeur honnête entouré de stands vendant des contrefaçons. Il devient alors difficile pour les utilisateurs de trouver le produit authentique. Ainsi, l’attaquant peut prendre le contrôle du réseau DHT, rendant les échantillons indisponibles.

Par exemple, pour récupérer l’échantillon à l’adresse 1000, il faut trouver le nœud responsable. Mais si ce nœud est entouré de milliers de faux nœuds créés par l’attaquant, la requête sera redirigée vers ces faux nœuds, empêchant d’atteindre le nœud légitime. Résultat : l’échantillon devient inaccessible, compromettant tout le processus de stockage et de vérification.

Pour résoudre ce problème, il faudrait construire sur la DHT une couche réseau hautement fiable, composée uniquement de nœuds validateurs. Or, la DHT elle-même ne peut pas identifier si un nœud est un validateur.

Cela freine sérieusement le DAS et le scaling d’Ethereum. Existe-t-il une solution pour contrer cette menace et garantir la fiabilité du réseau ?

Proof of Validator : la solution ZK pour sécuriser le scaling

Revenons maintenant au cœur de cet article : Proof of Validator.

Sur le forum technique d’Ethereum, quatre personnes ont proposé aujourd’hui ce schéma : George Kadianakis, Mary Maller, Andrija Novakovic et Suphanat Chunhapanya.

L’idée générale est la suivante : s’il existait un moyen de faire en sorte que, dans le schéma de scaling DHT décrit précédemment, seuls les validateurs honnêtes puissent rejoindre la DHT, alors tout attaquant souhaitant mener une attaque Sybil devrait miser une grande quantité d’ETH, augmentant ainsi significativement le coût économique de la malveillance.

Autrement dit, et en termes plus familiers : je veux pouvoir savoir que tu es quelqu’un de fiable, sans connaître ton identité, et pouvoir distinguer les mauvais acteurs.

Dans ce scénario de preuve avec information limitée, les preuves sans connaissance (zero-knowledge proofs) semblent naturellement adaptées.

Ainsi, Proof of Validator (abrégé PoV) pourrait permettre de construire un réseau DHT hautement fiable, constitué uniquement de nœuds validateurs honnêtes, efficacement résistant aux attaques Sybil.

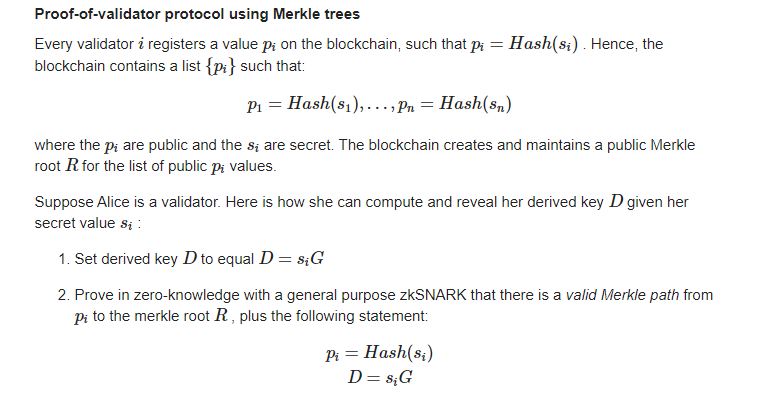

L'idée de base est la suivante : chaque nœud validateur enregistre uneclé publiquesur la blockchain, puis utilise une preuve sans connaissance pour démontrer qu’il connaît laclé privéecorrespondante. Cela revient à présenter une pièce d’identité prouvant qu’on est bien un validateur.

De plus, concernant la protection des validateurs contre les attaques par déni de service (DoS), PoV vise également à masquer l’identité des validateurs au niveau du réseau. Autrement dit, le protocole empêche l’attaquant d’identifier quel nœud DHT correspond à quel validateur.

Comment procéder concrètement ? L’article d’origine utilise de nombreuses formules mathématiques et dérivations que nous n’aborderons pas ici. Voici une version simplifiée :

En pratique, on utilise un arbre de Merkle ou une table de recherche. Par exemple, avec un arbre de Merkle, on prouve qu’une clé publique enregistrée appartient bien à la liste (représentée par l’arbre de Merkle), puis on prouve que la clé publique de communication réseau dérivée de celle-ci est compatible. L’ensemble du processus utilise des preuves sans connaissance, sans divulguer l’identité réelle.

Au-delà des détails techniques, l’effet final de PoV est le suivant :

Seuls les nœuds ayant passé la vérification d’identité peuvent rejoindre le réseau DHT. Sa sécurité est ainsi fortement accrue, permettant de résister efficacement aux attaques Sybil et d’empêcher la dissimulation ou la modification intentionnelle des échantillons.PoVfournit une base réseau fiable auDAS, aidant indirectement Ethereum à atteindre un scaling rapide.

Toutefois, PoV en est actuellement au stade de recherche théorique, et sa mise en œuvre concrète reste incertaine.

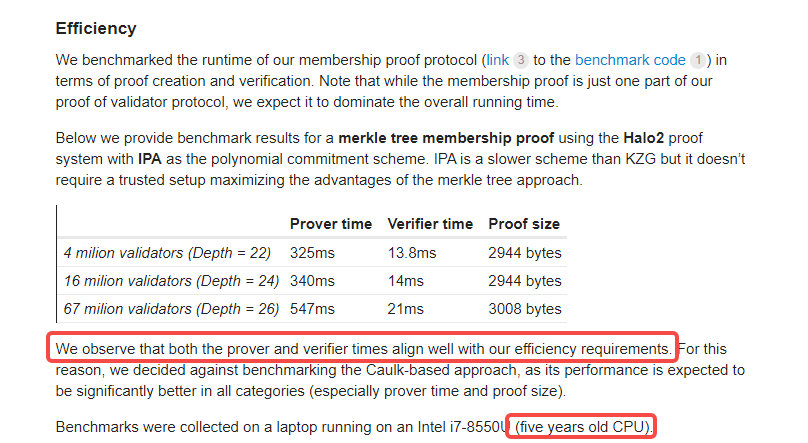

Néanmoins, les chercheurs auteurs du post ont mené des expériences à petite échelle, dont les résultats montrent que PoV offre de bonnes performances tant en génération qu’en vérification des preuves ZK. À noter que leurs tests ont été effectués sur un simple ordinateur portable équipé d’un processeur Intel i7 datant de cinq ans.

Enfin, bien que PoV soit encore à un stade théorique, il représente une étape importante vers une meilleure extensibilité des blockchains. En tant que composant clé de la feuille de route de scaling d’Ethereum, il mérite l’attention soutenue de toute l’industrie.

Lien vers le post original de PoV : lien

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News