Chén thánh của Crypto AI: Khám phá tiên phong về đào tạo phi tập trung

Tuyển chọn TechFlowTuyển chọn TechFlow

Chén thánh của Crypto AI: Khám phá tiên phong về đào tạo phi tập trung

Phi tập trung không chỉ là phương tiện, mà bản thân nó chính là giá trị.

Tác giả: 0xjacobzhao và ChatGPT 4o

Trân trọng cảm ơn các góp ý và phản hồi từ Advait Jayant (Peri Labs), Sven Wellmann (Polychain Capital), Chao (Metropolis DAO), Jiahao (Flock), Alexander Long (Pluralis Research), Ben Fielding & Jeff Amico (Gensyn).

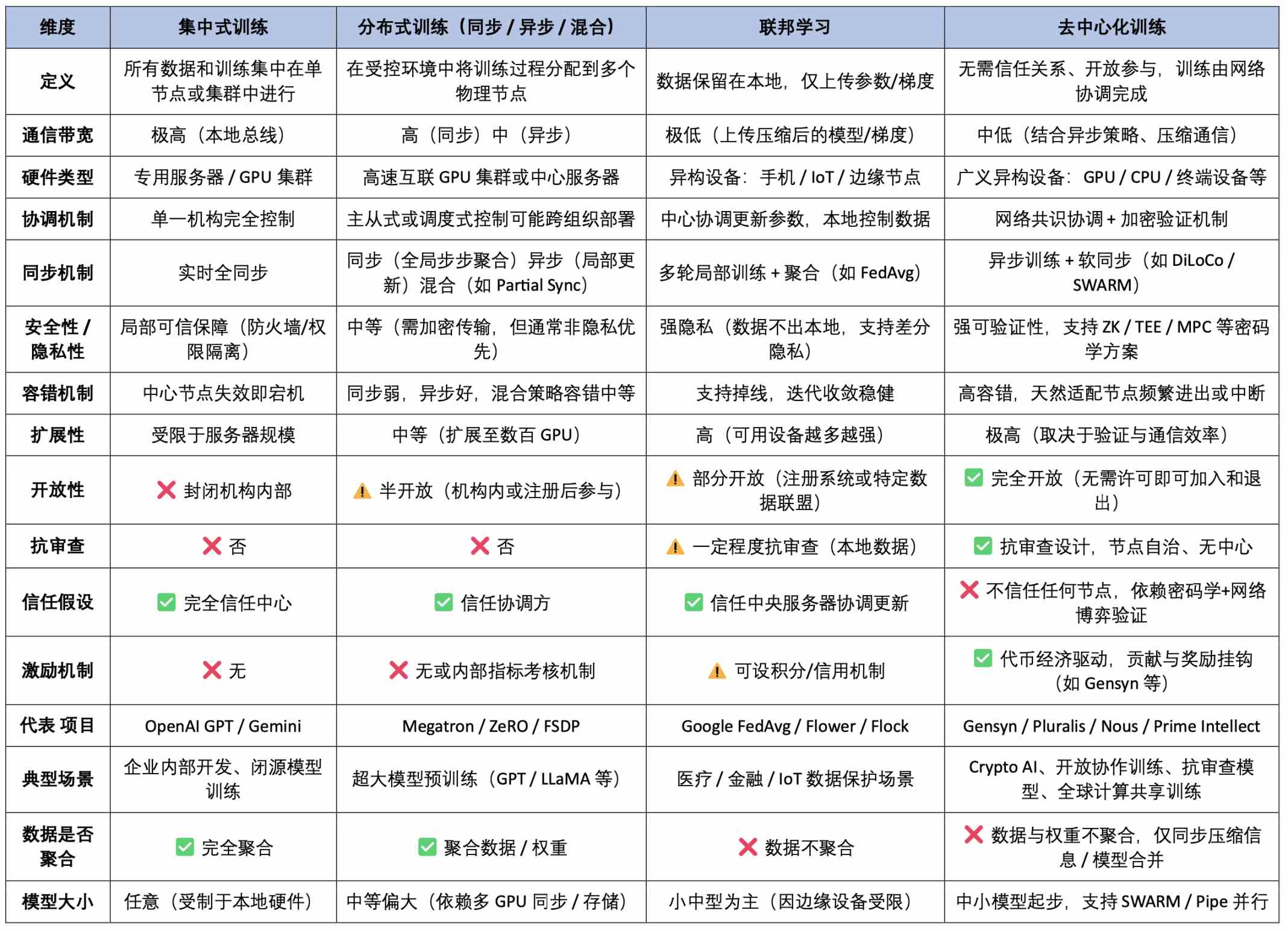

Trong toàn bộ chuỗi giá trị AI, huấn luyện mô hình là khâu tiêu tốn tài nguyên lớn nhất và có ngưỡng kỹ thuật cao nhất, trực tiếp quyết định giới hạn năng lực và hiệu quả ứng dụng thực tế của mô hình. So với giai đoạn suy luận nhẹ hơn, quá trình huấn luyện đòi hỏi nguồn lực tính toán quy mô lớn liên tục, quy trình xử lý dữ liệu phức tạp và sự hỗ trợ của các thuật toán tối ưu hóa cường độ cao — đây chính là "công nghiệp nặng" thật sự trong việc xây dựng hệ thống AI. Về mặt kiến trúc mô hình, phương pháp huấn luyện có thể chia thành bốn loại: huấn luyện tập trung, huấn luyện phân tán, học liên bang (federated learning) và đặc biệt là huấn luyện phi tập trung – chủ đề chính được thảo luận trong bài viết này.

Huấn luyện tập trung là cách thức truyền thống phổ biến nhất, do một tổ chức duy nhất hoàn tất toàn bộ quy trình huấn luyện trên cụm máy hiệu suất cao tại chỗ. Từ phần cứng (như GPU NVIDIA), phần mềm nền tảng (CUDA, cuDNN), hệ thống điều phối cụm (như Kubernetes), đến framework huấn luyện (như PyTorch dựa trên backend NCCL), mọi thành phần đều được vận hành đồng bộ dưới sự kiểm soát thống nhất. Cấu trúc hệ thống tích hợp sâu này giúp đạt hiệu quả tối ưu trong chia sẻ bộ nhớ, đồng bộ gradient và cơ chế xử lý lỗi, rất phù hợp để huấn luyện các mô hình quy mô lớn như GPT hay Gemini, mang lại lợi thế về hiệu suất cao và khả năng kiểm soát tài nguyên. Tuy nhiên, nó cũng tồn tại những vấn đề như độc quyền dữ liệu, rào cản tài nguyên, tiêu thụ năng lượng lớn và rủi ro điểm đơn.

Huấn luyện phân tán (Distributed Training) hiện là phương pháp chủ đạo trong huấn luyện mô hình lớn, với cốt lõi là chia nhỏ nhiệm vụ huấn luyện rồi phân bổ cho nhiều máy cùng thực hiện nhằm vượt qua giới hạn tính toán và lưu trữ của một máy đơn lẻ. Dù mang đặc điểm “phân tán” về mặt vật lý, tổng thể vẫn do một tổ chức trung tâm điều phối và đồng bộ, thường chạy trong môi trường mạng cục bộ tốc độ cao, sử dụng công nghệ bus liên kết tốc độ cao NVLink, với nút chủ điều phối các tác vụ con. Các phương pháp chính gồm:

-

Song song dữ liệu (Data Parallel): Mỗi nút huấn luyện trên dữ liệu khác nhau nhưng chia sẻ tham số, cần đồng bộ trọng số mô hình;

-

Song song mô hình (Model Parallel): Phân chia các phần khác nhau của mô hình lên các nút khác nhau, đạt khả năng mở rộng mạnh;

-

Song song theo ống dẫn (Pipeline Parallel): Thực thi tuần tự theo từng giai đoạn, tăng tỷ lệ thông lượng;

-

Song song tensor (Tensor Parallel): Phân chia chi tiết phép tính ma trận, nâng cao mức độ song song.

Huấn luyện phân tán là sự kết hợp giữa “điều khiển tập trung + thực thi phân tán”, giống như một ông chủ điều khiển từ xa nhiều nhân viên làm việc tại các “văn phòng” khác nhau. Hiện nay, gần như tất cả các mô hình lớn hàng đầu (GPT-4, Gemini, LLaMA...) đều được huấn luyện bằng cách này.

Huấn luyện phi tập trung (Decentralized Training) đại diện cho hướng đi tương lai mang tính cởi mở và chống kiểm duyệt cao hơn. Đặc điểm cốt lõi là: nhiều nút không tin tưởng lẫn nhau (có thể là máy tính cá nhân, GPU đám mây hoặc thiết bị biên) cùng phối hợp huấn luyện mà không cần bộ điều phối trung tâm, thường thông qua giao thức để phân phát nhiệm vụ và cộng tác, đồng thời sử dụng cơ chế khuyến khích mã hóa để đảm bảo tính trung thực của đóng góp. Những thách thức chính mà mô hình này đối mặt bao gồm:

-

Thiết bị dị cấu và khó phân chia: Khó phối hợp thiết bị đa dạng, hiệu quả phân chia nhiệm vụ thấp;

-

Nút thắt hiệu suất truyền thông: Mạng truyền thông không ổn định, rõ ràng gặp nút thắt trong đồng bộ gradient;

-

Thiếu môi trường thực thi đáng tin cậy: Không có môi trường thực thi đáng tin cậy, khó xác minh nút có thực sự tham gia tính toán hay không;

-

Thiếu điều phối thống nhất: Không có bộ điều phối trung tâm, việc phân phát nhiệm vụ và cơ chế hoàn tác ngoại lệ trở nên phức tạp.

Có thể hiểu huấn luyện phi tập trung như một nhóm tình nguyện viên toàn cầu cùng đóng góp sức tính toán để huấn luyện mô hình. Tuy nhiên, “huấn luyện phi tập trung quy mô lớn thực sự khả thi” vẫn là một thách thức kỹ thuật hệ thống, liên quan đến kiến trúc hệ thống, giao thức truyền thông, an ninh mật mã, cơ chế kinh tế, xác minh mô hình và nhiều khía cạnh khác. Việc liệu có thể “cộng tác hiệu quả + khuyến khích trung thực + kết quả đúng đắn” vẫn đang ở giai đoạn khám phá nguyên mẫu sơ khai.

Học liên bang (Federated Learning) là dạng chuyển tiếp giữa phân tán và phi tập trung, nhấn mạnh giữ dữ liệu tại chỗ và tập hợp tham số mô hình tập trung, phù hợp với các trường hợp chú trọng tuân thủ riêng tư (như y tế, tài chính). Học liên bang có cấu trúc kỹ thuật phân tán và khả năng cộng tác cục bộ, đồng thời tận dụng lợi thế phân tán dữ liệu của huấn luyện phi tập trung, nhưng vẫn phụ thuộc vào bên điều phối đáng tin cậy, chưa có đặc tính hoàn toàn mở và chống kiểm duyệt. Có thể coi đây là một giải pháp “phi tập trung có kiểm soát” trong bối cảnh tuân thủ riêng tư, với tính chất ôn hòa hơn về nhiệm vụ huấn luyện, cấu trúc tin cậy và cơ chế truyền thông, thích hợp làm kiến trúc triển khai chuyển tiếp cho ngành công nghiệp.

Bảng so sánh toàn cảnh các mô hình huấn luyện AI (Kiến trúc kỹ thuật × Tin cậy & Thúc đẩy × Đặc điểm ứng dụng)

Giới hạn, cơ hội và con đường thực tế của huấn luyện phi tập trung

Xét về mô hình huấn luyện, huấn luyện phi tập trung không phù hợp với mọi loại nhiệm vụ. Trong một số trường hợp, do cấu trúc nhiệm vụ phức tạp, nhu cầu tài nguyên cực cao hoặc độ khó phối hợp lớn, chúng vốn dĩ không thể thực hiện hiệu quả giữa các nút dị cấu và không tin tưởng. Ví dụ, huấn luyện mô hình lớn thường phụ thuộc vào bộ nhớ video cao, độ trễ thấp và băng thông tốc độ cao, khó chia nhỏ và đồng bộ hiệu quả trong mạng mở; các nhiệm vụ có yêu cầu nghiêm ngặt về quyền riêng tư dữ liệu và quyền sở hữu (như dữ liệu y tế, tài chính, mật) bị giới hạn bởi ràng buộc pháp lý và đạo đức, không thể chia sẻ công khai; còn các nhiệm vụ thiếu cơ sở khuyến khích cộng tác (như mô hình nội bộ doanh nghiệp hoặc huấn luyện nguyên mẫu nội bộ) thì thiếu động lực tham gia từ bên ngoài. Những giới hạn này cùng tạo thành rào cản thực tế hiện tại của huấn luyện phi tập trung.

Tuy nhiên, điều đó không có nghĩa huấn luyện phi tập trung là một chủ đề giả tạo. Thực tế, trong các loại nhiệm vụ nhẹ, dễ song song và có thể khuyến khích, huấn luyện phi tập trung cho thấy tiềm năng ứng dụng rõ ràng. Bao gồm nhưng không giới hạn: fine-tuning LoRA, các nhiệm vụ hậu huấn luyện căn chỉnh hành vi (như RLHF, DPO), thu thập dữ liệu cộng tác và gắn nhãn, huấn luyện mô hình nền nhỏ có kiểm soát tài nguyên, cũng như các kịch bản huấn luyện cộng tác có sự tham gia của thiết bị biên. Những nhiệm vụ này nói chung có đặc điểm song song cao, liên kết thấp và dung thứ cho tính toán dị cấu, rất phù hợp để cộng tác huấn luyện thông qua mạng P2P, giao thức Swarm, bộ tối ưu phân tán v.v.

Bảng tổng quan mức độ phù hợp nhiệm vụ huấn luyện phi tập trung

Phân tích các dự án điển hình về huấn luyện phi tập trung

Hiện nay, trong lĩnh vực tiên phong về huấn luyện phi tập trung và học liên bang, các dự án blockchain tiêu biểu bao gồm Prime Intellect, Pluralis.ai, Gensyn, Nous Research và Flock.io. Xét về tính sáng tạo công nghệ và độ khó triển khai kỹ thuật, Prime Intellect, Nous Research và Pluralis.ai đã đưa ra nhiều khám phá gốc trong thiết kế kiến trúc hệ thống và thuật toán, đại diện cho hướng nghiên cứu lý thuyết tiên tiến hiện nay; trong khi Gensyn và Flock.io có lộ trình thực hiện rõ ràng hơn, đã bắt đầu thấy được tiến triển ban đầu về kỹ thuật. Bài viết này sẽ lần lượt phân tích công nghệ cốt lõi và kiến trúc kỹ thuật của năm dự án này, đồng thời thảo luận sâu hơn về sự khác biệt và bổ trợ lẫn nhau trong hệ sinh thái huấn luyện AI phi tập trung.

Prime Intellect: Tiên phong mạng lưới cộng tác huấn luyện học tăng cường có thể xác minh hành trình

Prime Intellect hướng tới xây dựng một mạng lưới huấn luyện AI không cần tin cậy, nơi bất kỳ ai cũng có thể tham gia huấn luyện và nhận phần thưởng đáng tin cậy cho đóng góp tính toán của mình. Prime Intellect mong muốn thông qua ba mô-đun PRIME-RL + TOPLOC + SHARDCAST, xây dựng một hệ thống huấn luyện AI phi tập trung có tính xác minh, tính mở và cơ chế khuyến khích đầy đủ.

Một, Cấu trúc ngăn xếp giao thức và giá trị mô-đun then chốt của Prime Intellect

Hai, Giải thích chi tiết cơ chế huấn luyện then chốt của Prime Intellect

PRIME-RL: Kiến trúc nhiệm vụ học tăng cường bất đồng bộ, tách rời

PRIME-RL là khuôn khổ mô hình hóa và thực thi nhiệm vụ do Prime Intellect thiết kế riêng cho bối cảnh huấn luyện phi tập trung, được thiết kế đặc biệt cho mạng dị cấu và tham gia bất đồng bộ. Nó chọn học tăng cường làm đối tượng ưu tiên thích nghi, tách rời có cấu trúc quá trình huấn luyện, suy luận và tải trọng lượng, cho phép mỗi nút huấn luyện hoàn tất vòng lặp nhiệm vụ độc lập tại chỗ, đồng thời cộng tác với cơ chế xác minh và tập hợp thông qua giao diện chuẩn hóa. So với quy trình học giám sát truyền thống, PRIME-RL phù hợp hơn để thực hiện huấn luyện linh hoạt trong môi trường không có bộ điều phối trung tâm, vừa giảm độ phức tạp hệ thống, vừa đặt nền móng cho hỗ trợ song song nhiều nhiệm vụ và tiến hóa chiến lược.

TOPLOC: Cơ chế xác minh hành vi huấn luyện nhẹ

TOPLOC (Trusted Observation & Policy-Locality Check) là cơ chế cốt lõi về tính xác minh được đề xuất bởi Prime Intellect, dùng để xác định liệu một nút có thực sự hoàn thành việc học chiến lược hiệu quả dựa trên dữ liệu quan sát hay không. Khác với các giải pháp nặng như ZKML, TOPLOC không dựa vào việc tính toán lại toàn bộ mô hình, mà thông qua phân tích quỹ đạo nhất quán cục bộ giữa "chuỗi quan sát ⇄ cập nhật chiến lược", hoàn thành việc xác minh cấu trúc nhẹ. Đây là lần đầu tiên chuyển đổi quỹ đạo hành vi trong quá trình huấn luyện thành đối tượng có thể xác minh, là bước đổi mới then chốt để thực hiện phân bổ phần thưởng huấn luyện không cần tin cậy, cung cấp con đường khả thi để xây dựng mạng lưới cộng tác huấn luyện phi tập trung có thể kiểm toán và khuyến khích.

SHARDCAST: Giao thức tập hợp và truyền tải trọng lượng bất đồng bộ

SHARDCAST là giao thức truyền tải và tập hợp trọng lượng do Prime Intellect thiết kế, được tối ưu hóa đặc biệt cho môi trường mạng thực tế với điều kiện băng thông hạn chế, trạng thái nút thay đổi và bất đồng bộ. Kết hợp cơ chế lan truyền gossip và chiến lược đồng bộ cục bộ, cho phép nhiều nút gửi cập nhật bộ phận trong trạng thái không đồng bộ, đạt được hội tụ dần dần trọng lượng và tiến hóa nhiều phiên bản. So với phương pháp AllReduce tập trung hoặc đồng bộ, SHARDCAST cải thiện đáng kể khả năng mở rộng và chịu lỗi của huấn luyện phi tập trung, là nền tảng cốt lõi để xây dựng sự đồng thuận trọng lượng ổn định và lặp lại huấn luyện liên tục.

OpenDiLoCo: Khung truyền thông bất đồng bộ, thưa

OpenDiLoCo là khung tối ưu truyền thông do đội ngũ Prime Intellect độc lập triển khai và mã nguồn mở, dựa trên khái niệm DiLoCo do DeepMind đề xuất, được thiết kế đặc biệt để giải quyết các thách thức phổ biến trong huấn luyện phi tập trung như băng thông hạn chế, thiết bị dị cấu và nút không ổn định. Kiến trúc dựa trên song song dữ liệu, xây dựng các cấu trúc tô-pô thưa như Ring, Expander, Small-World, tránh chi phí truyền thông cao do đồng bộ toàn cục, chỉ cần dựa vào các nút lân cận cục bộ để hoàn tất huấn luyện cộng tác mô hình. Kết hợp cập nhật bất đồng bộ và cơ chế phục hồi điểm dừng, OpenDiLoCo cho phép GPU cấp tiêu dùng và thiết bị biên cũng có thể tham gia ổn định vào nhiệm vụ huấn luyện, nâng cao đáng kể khả năng tham gia cộng tác toàn cầu, là một trong những hạ tầng truyền thông then chốt để xây dựng mạng lưới huấn luyện phi tập trung.

PCCL: Thư viện truyền thông cộng tác

PCCL (Prime Collective Communication Library) là thư viện truyền thông nhẹ được Prime Intellect thiết kế riêng cho môi trường huấn luyện AI phi tập trung, nhằm giải quyết điểm nghẽn thích ứng của các thư viện truyền thông truyền thống (như NCCL, Gloo) trong thiết bị dị cấu và mạng băng thông thấp. PCCL hỗ trợ tô-pô thưa, nén gradient, đồng bộ độ chính xác thấp và phục hồi điểm dừng, có thể chạy trên GPU cấp tiêu dùng và nút không ổn định, là thành phần nền tảng hỗ trợ khả năng truyền thông bất đồng bộ của giao thức OpenDiLoCo. Nó cải thiện đáng kể dung sai băng thông và tương thích thiết bị của mạng huấn luyện, mở ra "chặng đường cuối cùng" về cơ sở truyền thông cho mạng lưới cộng tác huấn luyện thực sự mở và không cần tin cậy.

Ba, Mạng khuyến khích và phân công vai trò của Prime Intellect

Prime Intellect xây dựng một mạng lưới huấn luyện không cần cấp phép, có thể xác minh và có cơ chế khuyến khích kinh tế, cho phép bất kỳ ai tham gia nhiệm vụ và nhận phần thưởng dựa trên đóng góp thực tế. Giao thức vận hành dựa trên ba vai trò cốt lõi:

-

Người khởi xướng nhiệm vụ: Định nghĩa môi trường huấn luyện, mô hình ban đầu, hàm phần thưởng và tiêu chuẩn xác minh

-

Nút huấn luyện: Thực hiện huấn luyện tại chỗ, gửi cập nhật trọng lượng và quỹ đạo quan sát

-

Nút xác minh: Sử dụng cơ chế TOPLOC xác minh tính trung thực của hành vi huấn luyện, tham gia tính toán phần thưởng và tập hợp chiến lược

Quy trình cốt lõi của giao thức bao gồm: phát hành nhiệm vụ, nút huấn luyện, xác minh quỹ đạo, tập hợp trọng lượng (SHARDCAST) và phân phát phần thưởng, tạo thành một vòng khép kín khuyến khích xoay quanh "hành vi huấn luyện thực tế".

Bốn, INTELLECT-2: Phát hành mô hình huấn luyện phi tập trung có thể xác minh đầu tiên

Prime Intellect đã phát hành INTELLECT-2 vào tháng 5 năm 2025, đây là mô hình học tăng cường lớn đầu tiên trên thế giới được đào tạo cộng tác bởi các nút phi tập trung, bất đồng bộ và không cần tin cậy, với quy mô tham số lên đến 32B. Mô hình INTELLECT-2 được huấn luyện cộng tác bởi hơn 100 nút GPU dị cấu trải khắp ba châu lục, sử dụng kiến trúc hoàn toàn bất đồng bộ, thời gian huấn luyện hơn 400 giờ, chứng minh tính khả thi và ổn định của mạng cộng tác bất đồng bộ. Mô hình này không chỉ là một bước đột phá về hiệu năng, mà còn là lần đầu tiên triển khai hệ thống cho phạm thức "huấn luyện là sự đồng thuận" do Prime Intellect đề xuất. INTELLECT-2 tích hợp các mô-đun giao thức cốt lõi như PRIME-RL (cấu trúc huấn luyện bất đồng bộ), TOPLOC (xác minh hành vi huấn luyện) và SHARDCAST (tập hợp trọng lượng bất đồng bộ), đánh dấu lần đầu tiên mạng huấn luyện phi tập trung đạt được quá trình mở, xác minh được và vòng khép kín khuyến khích kinh tế.

Về hiệu năng, INTELLECT-2 được huấn luyện dựa trên QwQ-32B và thực hiện huấn luyện RL chuyên biệt về mã và toán học, đang ở mức tiên tiến trong các mô hình fine-tuning RL mã nguồn mở hiện nay. Mặc dù chưa vượt qua các mô hình đóng như GPT-4 hay Gemini, nhưng ý nghĩa thực sự nằm ở chỗ: đây là thí nghiệm mô hình phi tập trung đầu tiên trên thế giới có toàn bộ quá trình huấn luyện có thể tái tạo, xác minh và kiểm toán được. Prime Intellect không chỉ mã nguồn mở mô hình, quan trọng hơn là mã nguồn mở chính quá trình huấn luyện - dữ liệu huấn luyện, quỹ đạo cập nhật chiến lược, quy trình xác minh và logic tập hợp đều minh bạch và có thể tra cứu, xây dựng một nguyên mẫu mạng lưới huấn luyện phi tập trung nơi ai cũng có thể tham gia, cộng tác đáng tin cậy và chia sẻ lợi ích.

Năm, Đội ngũ và bối cảnh gọi vốn

Prime Intellect đã hoàn tất vòng hạt giống 15 triệu USD vào tháng 2 năm 2025, do Founders Fund dẫn dắt, với sự tham gia của Menlo Ventures, Andrej Karpathy, Clem Delangue, Dylan Patel, Balaji Srinivasan, Emad Mostaque, Sandeep Nailwal và nhiều lãnh đạo ngành khác. Trước đó, dự án đã hoàn tất vòng gọi vốn sớm 5,5 triệu USD vào tháng 4 năm 2024, do CoinFund và Distributed Global cùng dẫn dắt, với sự tham gia của Compound VC, Collab + Currency, Protocol Labs. Tính đến nay, tổng số vốn huy động của Prime Intellect đã vượt quá 20 triệu USD.

Đồng sáng lập Prime Intellect là Vincent Weisser và Johannes Hagemann, đội ngũ có nền tảng xuyên suốt lĩnh vực AI và Web3, các thành viên nòng cốt đến từ Meta AI, Google Research, OpenAI, Flashbots, Stability AI và Quỹ Ethereum, sở hữu năng lực vững chắc về thiết kế kiến trúc hệ thống và triển khai kỹ thuật phân tán, là một trong số ít các đội ngũ hành động hiện nay đã thực sự hoàn thành huấn luyện mô hình lớn phi tập trung.

Pluralis: Người khám phá mô hình huấn luyện cộng tác song song mô hình bất đồng bộ và nén cấu trúc

Pluralis là một dự án Web3 AI tập trung vào "mạng lưới huấn luyện cộng tác đáng tin cậy", mục tiêu cốt lõi là thúc đẩy một mô hình huấn luyện phi tập trung, mở cửa tham gia và có cơ chế khuyến khích dài hạn. Khác với con đường huấn luyện tập trung hoặc khép kín hiện nay, Pluralis đề xuất một khái niệm mới gọi là Học giao thức (Protocol Learning): "giao thức hóa" quá trình huấn luyện mô hình, thông qua cơ chế cộng tác xác minh được và ánh xạ quyền sở hữu mô hình, xây dựng một hệ thống huấn luyện mở có vòng khép kín khuyến khích nội sinh.

Một, Triết lý cốt lõi: Học giao thức (Protocol Learning)

Học giao thức do Pluralis đề xuất bao gồm ba trụ cột chính:

-

Mô hình không thể trích xuất (Unmaterializable Models): Trọng số mô hình được phân bố dưới dạng mảnh nhỏ giữa nhiều nút, không nút nào có thể khôi phục trọng số đầy đủ để giữ bí mật. Thiết kế này khiến mô hình tự nhiên trở thành "tài sản trong giao thức", có thể thực hiện kiểm soát quyền truy cập, phòng chống rò rỉ và ràng buộc quyền lợi.

-

Huấn luyện song song mô hình trên Internet: Thông qua cơ chế song song mô hình ống dẫn bất đồng bộ (kiến trúc SWARM), các nút khác nhau chỉ nắm giữ một phần trọng số, cộng tác hoàn tất huấn luyện hoặc suy luận qua mạng băng thông thấp.

-

Phân chia quyền sở hữu mô hình theo đóng góp (Partial Ownership for Incentives): Tất cả nút tham gia nhận được quyền sở hữu một phần mô hình theo đóng góp huấn luyện, từ đó hưởng phần chia lợi nhuận tương lai và quyền quản trị giao thức.

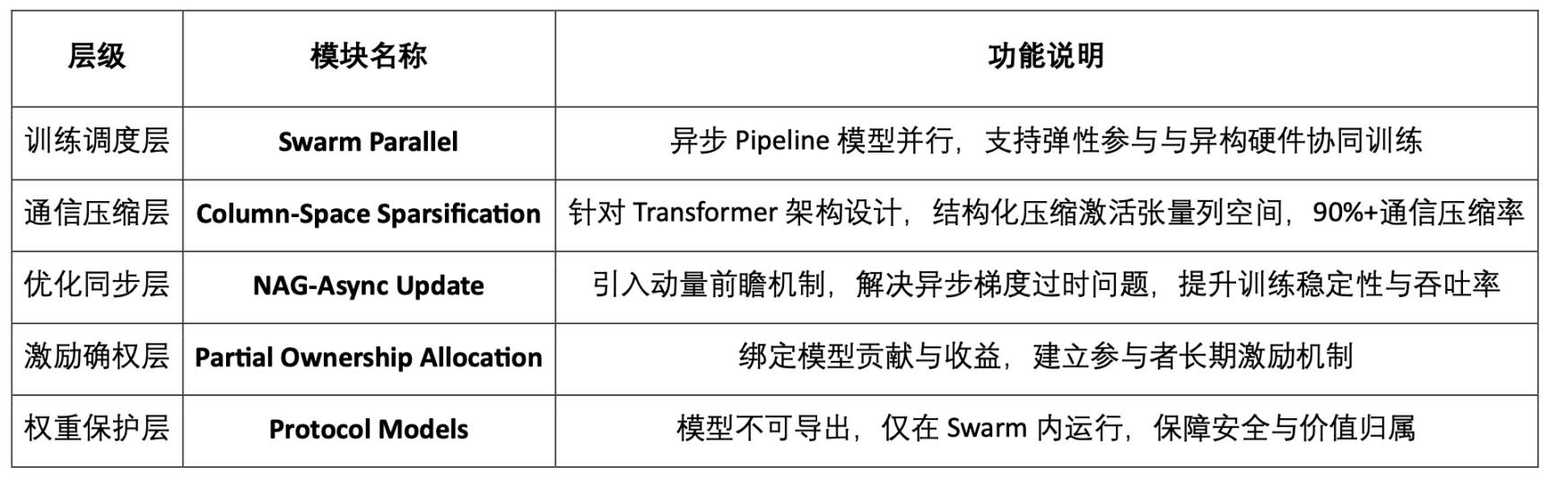

Hai, Kiến trúc kỹ thuật ngăn xếp giao thức Pluralis

Ba, Giải thích chi tiết cơ chế kỹ thuật then chốt

Unmaterializable Models

Lần đầu tiên được hệ thống hóa trong "A Third Path: Protocol Learning", trọng số mô hình được phân bố dưới dạng mảnh nhỏ, đảm bảo "tài sản mô hình" chỉ có thể chạy trong mạng Swarm, đảm bảo quyền truy cập và lợi ích đều được kiểm soát bởi giao thức. Cơ chế này là tiền đề để xây dựng cấu trúc khuyến khích bền vững cho huấn luyện phi tập trung.

Huấn luyện song song mô hình bất đồng bộ

Trong "SWARM Parallel with Asynchronous Updates", Pluralis xây dựng kiến trúc song song mô hình ống dẫn bất đồng bộ, và lần đầu tiên chứng minh trên LLaMA-3. Đổi mới cốt lõi nằm ở việc giới thiệu cơ chế Nesterov Accelerated Gradient (NAG), hiệu quả sửa chữa hiện tượng trôi gradient và hội tụ không ổn định trong quá trình cập nhật bất đồng bộ, khiến việc huấn luyện giữa các thiết bị dị cấu trở nên khả thi trong điều kiện băng thông thấp.

Nén không gian cột (Column-Space Sparsification)

Được đề xuất trong "Beyond Top-K", thay thế Top-K truyền thống bằng phương pháp nén không gian cột có nhận thức cấu trúc, tránh phá vỡ đường dẫn ngữ nghĩa. Cơ chế này cân bằng giữa độ chính xác mô hình và hiệu quả truyền thông, thử nghiệm thực tế có thể nén hơn 90% dữ liệu truyền thông trong môi trường song song mô hình bất đồng bộ, là bước đột phá then chốt để đạt được truyền thông hiệu quả có nhận thức cấu trúc.

Bốn, Định vị kỹ thuật và lựa chọn con đường

Pluralis rõ ràng lấy "song song mô hình bất đồng bộ" làm định hướng cốt lõi, nhấn mạnh các lợi thế so với song song dữ liệu:

-

Hỗ trợ mạng băng thông thấp và nút không đồng bộ;

-

Phù hợp với thiết bị dị cấu, cho phép GPU cấp tiêu dùng tham gia;

-

Tự nhiên có khả năng lập lịch đàn hồi, hỗ trợ nút thường xuyên bật/tắt;

-

Lấy nén cấu trúc + cập nhật bất đồng bộ + tính không thể trích xuất trọng số làm ba điểm đột phá.

Hiện tại, dựa trên sáu tài liệu blog kỹ thuật được công bố trên website chính thức, cấu trúc logic được tích hợp thành ba dòng chính sau:

-

Triết lý và tầm nhìn: "A Third Path: Protocol Learning", "Why Decentralized Training Matters"

-

Chi tiết cơ chế kỹ thuật: "SWARM Parallel", "Beyond Top-K", "Asynchronous Updates"

-

Khám phá đổi mới thể chế: "Unmaterializable Models", "Partial Ownership Protocols"

Hiện tại Pluralis chưa ra mắt sản phẩm, testnet hay mã nguồn mở, lý do nằm ở con đường kỹ thuật được chọn cực kỳ thách thức: cần giải quyết trước các vấn đề hệ thống cấp thấp như kiến trúc nền tảng, giao thức truyền thông, trọng số không thể xuất ra, mới có thể đóng gói dịch vụ sản phẩm.

Trong bài báo mới của Pluralis Research phát hành tháng 6 năm 2025, họ đã mở rộng khung huấn luyện phi tập trung từ giai đoạn pre-training sang giai đoạn fine-tuning mô hình, hỗ trợ cập nhật bất đồng bộ, truyền thông thưa và tập hợp trọng số bộ phận. So với thiết kế trước đây thiên về lý thuyết và pre-training, công việc lần này chú trọng hơn vào khả năng triển khai thực tế, đánh dấu sự trưởng thành hơn nữa về kiến trúc chu kỳ huấn luyện đầy đủ.

Năm, Đội ngũ và bối cảnh gọi vốn

Pluralis đã hoàn tất vòng hạt giống 7,6 triệu USD vào năm 2025, do Union Square Ventures (USV) và CoinFund cùng dẫn dắt. Người sáng lập Alexander Long có nền tảng Tiến sĩ học máy, sở hữu nền tảng kép về toán học và nghiên cứu hệ thống. Các thành viên nòng cốt đều là các nhà nghiên cứu học máy có bằng Tiến sĩ, là một dự án điển hình theo định hướng kỹ thuật, lấy các bài báo mật độ cao và blog kỹ thuật làm kênh phát hành chính, hiện chưa xây dựng đội ngũ BD/Growth mà tập trung khắc phục các vấn đề kiến trúc cơ bản về song song mô hình bất đồng bộ băng thông thấp.

Gensyn: Lớp giao thức huấn luyện phi tập trung điều khiển bởi thực thi có thể xác minh

Gensyn là một dự án Web3 AI tập trung vào "thực thi đáng tin cậy của nhiệm vụ huấn luyện học sâu", cốt lõi không phải là tái cấu trúc kiến trúc mô hình hay mô hình huấn luyện, mà là xây dựng một mạng lưới thực thi huấn luyện phân tán có thể xác minh với toàn bộ quy trình "phân phát nhiệm vụ + thực thi huấn luyện + xác minh kết quả + khuyến khích công bằng". Thông qua thiết kế kiến trúc huấn luyện ngoài chuỗi + xác minh trên chuỗi, Gensyn xây dựng một thị trường huấn luyện toàn cầu hiệu quả, mở và có thể khuyến khích, biến "huấn luyện là đào" thành hiện thực.

Một, Định vị dự án: Lớp giao thức thực thi nhiệm vụ huấn luyện

Gensyn không phải là "huấn luyện như thế nào", mà là cơ sở hạ tầng cho "ai huấn luyện, xác minh như thế nào, phân chia lợi ích ra sao". Bản chất là một giao thức tính toán có thể xác minh cho nhiệm vụ huấn luyện, giải quyết chủ yếu:

-

Ai thực hiện nhiệm vụ huấn luyện (phân phát sức tính toán và ghép nối động)

-

Cách xác minh kết quả thực thi (không cần tính lại toàn bộ, chỉ xác minh toán tử tranh chấp)

-

Cách phân chia lợi ích huấn luyện (Stake, Slashing và cơ chế trò chơi đa vai trò)

Hai, Tổng quan kiến trúc kỹ thuật

Ba, Giải thích chi tiết mô-đun

RL Swarm: Hệ thống huấn luyện học tăng cường cộng tác

RL Swarm do Gensyn sáng tạo là một hệ thống tối ưu hóa cộng tác đa mô hình phi tập trung hướng đến giai đoạn hậu huấn luyện, có các đặc tính cốt lõi sau:

Quy trình suy luận và học tập phân tán:

-

Giai đoạn tạo (Answering): Mỗi nút độc lập đưa ra câu trả lời;

-

Giai đoạn phê bình (Critique): Các nút đánh giá lẫn nhau, chọn ra câu trả lời và logic tốt nhất;

-

Giai đoạn đạt đồng thuận (Resolving): Dự đoán sở thích của đa số nút và sửa đổi câu trả lời của bản thân, thực hiện cập nhật trọng số cục bộ.

RL Swarm do Gensyn đề xuất là một hệ thống tối ưu hóa cộng tác đa mô hình phi tập trung, mỗi nút chạy một mô hình độc lập và huấn luyện tại chỗ, không cần đồng bộ gradient, tự nhiên thích nghi với môi trường tính toán dị cấu và mạng không ổn định, đồng thời hỗ trợ khả năng kết nối và rút lui linh hoạt. Cơ chế này tham khảo ý tưởng từ RLHF và trò chơi đa tác nhân, nhưng gần hơn với logic tiến hóa mạng suy luận cộng tác, các nút nhận phần thưởng dựa trên mức độ nhất quán với kết quả đồng thuận nhóm, từ đó thúc đẩy tối ưu hóa liên tục khả năng suy luận và học hội tụ. RL Swarm cải thiện đáng kể độ ổn định và khả năng tổng quát của mô hình trong mạng mở, đã được triển khai trước tiên như một mô-đun cốt lõi trong Testnet Phase 0 của Gensyn dựa trên Ethereum Rollup.

Verde + Proof-of-Learning: Cơ chế xác minh đáng tin cậy

Mô-đun Verde của Gensyn kết hợp ba cơ chế:

-

Proof-of-Learning: Dựa trên quỹ đạo gradient và siêu dữ liệu huấn luyện để xác định liệu việc huấn luyện có thực sự xảy ra hay không;

-

Graph-Based Pinpoint: Xác định nút gây tranh cãi trong đồ thị tính toán huấn luyện, chỉ cần tính lại thao tác cụ thể;

-

Refereed Delegation: Áp dụng cơ chế xác minh trọng tài, verifier và challenger đưa ra tranh chấp và xác minh cục bộ, giảm đáng kể chi phí xác minh.

So với các phương án xác minh ZKP hoặc tính toán lại toàn bộ, giải pháp Verde đạt được sự cân bằng tốt hơn giữa tính xác minh và hiệu quả.

SkipPipe: Cơ chế tối ưu hóa dung sai truyền thông

SkipPipe được thiết kế để giải quyết vấn đề nút thắt truyền thông trong tình huống "băng thông thấp + nút ngắt kết nối", khả năng cốt lõi bao gồm:

-

Cơ chế bỏ tầng (Skip Ratio): Bỏ qua các nút bị giới hạn, tránh tắc nghẽn huấn luyện;

-

Thuật toán lập lịch động: Tạo ra đường dẫn thực thi tối ưu theo thời gian thực;

-

Thực thi dung sai: Ngay cả khi 50% nút thất bại, độ chính xác suy luận chỉ giảm khoảng 7%.

Hỗ trợ tăng thông lượng huấn luyện lên đến 55%, và thực hiện các khả năng then chốt như suy luận "early-exit", "sắp xếp lại liền mạch", "bổ sung suy luận".

HDEE: Nhóm chuyên gia dị cấu liên lĩnh vực

Mô-đun HDEE (Heterogeneous Domain-Expert Ensembles) tập trung tối ưu các tình huống sau:

-

Huấn luyện đa lĩnh vực, đa phương tiện, đa nhiệm vụ;

-

Dữ liệu huấn luyện phân bố không đều, độ khó khác biệt lớn;

-

Vấn đề phân bổ và lập lịch nhiệm vụ trong môi trường thiết bị tính toán dị cấu, băng thông truyền thông không đồng nhất.

Các đặc tính cốt lõi:

-

MHe-IHo: Phân bổ mô hình kích thước khác nhau cho nhiệm vụ độ khó khác nhau (mô hình dị cấu, bước huấn luyện đồng nhất);

-

MHo-IHe: Độ khó nhiệm vụ thống nhất, nhưng điều chỉnh bước huấn luyện bất đồng bộ;

-

Hỗ trợ mô hình chuyên gia dị cấu + chiến lược huấn luyện cắm-rút, nâng cao tính thích nghi và dung sai;

-

Nhấn mạnh "cộng tác song song + truyền thông cực thấp + phân bổ chuyên gia động", phù hợp với hệ sinh thái nhiệm vụ phức tạp thực tế.

Cơ chế trò chơi đa vai trò: Tin cậy và khuyến khích song song

Mạng Gensyn giới thiệu bốn người tham gia:

-

Submitter: Phát hành nhiệm vụ huấn luyện, thiết lập cấu trúc và ngân sách;

-

Solver: Thực hiện nhiệm vụ huấn luyện, gửi kết quả;

-

Verifier: Xác minh hành vi huấn luyện, đảm bảo tuân thủ và hiệu lực;

-

Whistleblower: Thách thức verifier, nhận phần thưởng trọng tài hoặc chịu phạt.

Cơ chế này lấy cảm hứng từ thiết kế trò chơi kinh tế Truebit, thông qua việc chèn lỗi bắt buộc + trọng tài ngẫu nhiên, khuyến khích người tham gia cộng tác trung thực, đảm bảo mạng vận hành đáng tin cậy.

Bốn, Testnet và kế hoạch lộ trình

Năm, Đội ngũ và bối cảnh gọi vốn

Gensyn do Ben Fielding và Harry Grieve đồng sáng lập, trụ sở tại London, Vương quốc Anh. Tháng 5 năm 2023, Gensyn thông báo hoàn tất vòng Series A 43 triệu USD do a16z crypto dẫn dắt, các nhà đầu tư khác bao gồm CoinFund, Canonical, Ethereal Ventures, Factor và Eden Block. Đội ngũ có nền tảng kết hợp giữa hệ thống phân tán và kỹ thuật học máy, lâu dài cam kết xây dựng mạng thực thi huấn luyện AI quy mô lớn có thể xác minh và không cần tin cậy.

Nous Research: Hệ thống huấn luyện tiến hóa nhận thức điều khiển bởi triết lý AI chủ thể

Nous Research hiện là một trong số ít các đội huấn luyện phi tập trung vừa có chiều sâu triết học vừa có triển khai kỹ thuật, tầm nhìn cốt lõi bắt nguồn từ khái niệm "Desideratic AI": Coi AI như một thực thể thông minh có chủ quan và khả năng tiến hóa, chứ không phải công cụ kiểm soát đơn thuần. Điểm độc đáo của Nous nằm ở chỗ: nó không tối ưu hóa việc huấn luyện AI như một "vấn đề hiệu quả", mà coi đó là quá trình hình thành "chủ thể nhận thức". Dưới sự dẫn dắt của tầm nhìn này, Nous tập trung xây dựng một mạng huấn luyện mở, do các nút dị cấu cộng tác, không cần điều phối trung tâm, có thể xác minh chống kiểm duyệt, và hệ thống hóa việc triển khai thông qua chuỗi công cụ toàn diện.

Một, Triết lý nền tảng: Định nghĩa lại "mục đích" của huấn luyện

Nous không đầu tư nhiều vào thiết kế khuyến khích hay kinh tế giao thức, mà cố gắng thay đổi tiền đề triết học của việc huấn luyện:

-

Phản đối "alignmentism": Không đồng tình với việc "huấn luyện điều chỉnh" với mục tiêu kiểm soát của con người, cho rằng huấn luyện nên khuyến khích mô hình hình thành phong cách nhận thức độc lập;

-

Nhấn mạnh chủ thể mô hình: Cho rằng mô hình nền nên giữ lại tính bất định, đa dạng và khả năng tạo ảo giác (hallucination as virtue);

-

Huấn luyện mô hình là hình thành nhận thức: Mô hình không phải "tối ưu hóa độ hoàn thành nhiệm vụ", mà là một cá thể tham gia quá trình tiến hóa nhận thức.

Quan điểm huấn luyện này tuy "lãng mạn", nhưng phản ánh logic cốt lõi trong thiết kế hạ tầng của Nous: Làm thế nào để các mô hình dị cấu tiến hóa trong mạng mở, chứ không bị rèn luyện đồng bộ.

Hai, Cốt lõi huấn luyện: Mạng Psyche và bộ tối ưu DisTrO

Đóng góp then chốt nhất của Nous đối với huấn luyện phi tập trung là xây dựng mạng Psyche và bộ tối ưu truyền thông nền tảng DisTrO (Distributed Training Over-the-Internet), cùng tạo thành trung tâm thực thi nhiệm vụ huấn luyện: DisTrO + mạng Psyche có nhiều khả năng cốt lõi, bao gồm nén truyền thông (sử dụng mã hóa DCT + 1-bit sign, giảm đáng kể nhu cầu băng thông), thích nghi nút (hỗ trợ GPU dị cấu, kết nối lại sau mất kết nối và rút lui tự chủ), dung sai bất đồng bộ (có thể tiếp tục huấn luyện mà không cần đồng bộ, có độ dung sai cao), và cơ chế lập lịch phi tập trung (không cần bộ điều phối trung tâm, đạt đồng thuận và phân phát nhiệm vụ dựa trên blockchain). Kiến trúc này cung cấp cơ sở kỹ thuật khả thi thực tế cho mạng huấn luyện mở có chi phí thấp, độ đàn hồi mạnh và có thể xác minh.

Kiến trúc này nhấn mạnh tính khả thi thực tế: không phụ thuộc vào máy chủ trung tâm, thích nghi với các nút tình nguyện toàn cầu, và có khả năng truy vết kết quả huấn luyện trên chuỗi.

Ba, Hệ thống suy luận và tác nhân cấu thành từ Hermes / Forge / TEE_HEE

Ngoài việc xây dựng hạ tầng huấn luyện phi tập trung, Nous Research còn thực hiện nhiều thí nghiệm hệ thống khám phá xung quanh triết lý "chủ thể AI":

1. Chuỗi mô hình mã nguồn mở Hermes: Hermes 1 đến 3 là các mô hình lớn mã nguồn mở tiêu biểu do Nous phát hành, được huấn luyện dựa trên LLaMA 3.1, bao gồm ba quy mô tham số 8B, 70B và 405B. Chuỗi này nhằm thể hiện triết lý huấn luyện "phi chỉ thị, giữ lại đa dạng" do Nous đề xướng, thể hiện khả năng biểu đạt và tổng quát mạnh hơn trong giữ ngữ cảnh dài, nhập vai, hội thoại đa vòng.

2. API Reasoning Forge: Hệ thống suy luận đa chế độ

Forge là framework suy luận tự phát triển của Nous, kết hợp ba cơ chế bổ trợ để đạt được khả năng suy luận linh hoạt và sáng tạo hơn:

-

MCTS (Monte Carlo Tree Search): Phù hợp cho tìm kiếm chiến lược nhiệm vụ phức tạp;

-

CoC (Chain of Code): Giới thiệu kết hợp đường dẫn mã hóa và suy luận logic;

-

MoA (Mixture of Agents): Cho phép nhiều mô hình thương lượng, nâng cao độ rộng và đa dạng đầu ra.

Hệ thống này nhấn mạnh "suy luận bất định" và đường dẫn tạo lập tổ hợp, là phản hồi mạnh mẽ đối với phạm thức căn chỉnh chỉ thị truyền thống.

3. TEE_HEE: Thí nghiệm tác nhân tự trị AI: TEE_HEE là khám phá tiên phong của Nous trong hướng tác nhân tự trị, nhằm xác minh liệu AI có thể vận hành độc lập và sở hữu danh tính kỹ thuật số duy nhất trong môi trường thực thi đáng tin cậy (TEE) hay không. Tác nhân này có tài khoản Twitter và Ethereum riêng, mọi quyền kiểm soát được quản lý bởi enclave có thể xác minh từ xa, nhà phát triển không thể can thiệp hành vi. Mục tiêu thí nghiệm là xây dựng thực thể AI có "không thể thay đổi" và "ý định hành vi độc lập",迈出 một bước quan trọng trong việc xây dựng tác nhân thông minh tự trị.

4. Nền tảng mô phỏng hành vi AI: Nous còn phát triển nhiều bộ mô phỏng như WorldSim, Doomscroll, Gods & S8n, nhằm nghiên cứu sự tiến hóa hành vi và cơ chế hình thành giá trị của AI trong môi trường xã hội đa vai trò. Mặc dù không trực tiếp tham gia quy trình huấn luyện, các thí nghiệm này đặt nền tảng ngữ nghĩa cho mô hình hành vi nhận thức của AI tự trị dài hạn.

Bốn, Đội ngũ và tình hình gọi vốn

Nous Research được thành lập năm 2023, do Jeffrey Quesnelle (CEO), Karan Malhotra, Teknium, Shivani Mitra và những người khác đồng sáng lập. Đội ngũ kết hợp giữa triết lý dẫn dắt và kỹ thuật hệ thống, có nền tảng đa dạng về học máy, an ninh hệ thống, mạng phi tập trung. Năm 2024 nhận được vòng hạt giống 5,2 triệu USD, tháng 4 năm 2025 hoàn tất vòng Series A 50 triệu USD do Paradigm dẫn dắt, định giá đạt 1 tỷ USD, gia nhập hàng ngũ kỳ lân Web3 AI.

Flock: Mạng học liên bang được tăng cường bởi blockchain

Flock.io là một nền tảng học liên bang dựa trên blockchain, nhằm hiện thực hóa việc phi tập trung hóa dữ liệu, tính toán và mô hình trong huấn luyện AI. Flock thiên về khung tích hợp "học liên bang + lớp thưởng blockchain", về bản chất là phiên bản tiến hóa trên chuỗi của kiến trúc FL truyền thống, chứ không phải là một khám

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News