Bài phát biểu toàn văn tại sự kiện COMPUTEX 2024 của Jensen Huang: Chúng ta đang trải qua thời kỳ lạm phát điện toán

Tuyển chọn TechFlowTuyển chọn TechFlow

Bài phát biểu toàn văn tại sự kiện COMPUTEX 2024 của Jensen Huang: Chúng ta đang trải qua thời kỳ lạm phát điện toán

Tại hội nghị ComputeX 2024 ở Đài Bắc, CEO Jensen Huang của Nvidia đã trình bày những thành tựu mới nhất của công ty trong lĩnh vực tính toán tăng tốc và AI tạo sinh.

Biên tập: Youxin

Tối ngày 2 tháng 6, tại hội nghị ComputeX 2024 ở Đài Bắc, CEO của NVIDIA Jensen Huang đã trình bày những thành tựu mới nhất của công ty trong lĩnh vực tính toán tăng tốc và AI tạo sinh, đồng thời phác họa tầm nhìn về tương lai của công nghệ tính toán và robot.

Bài phát biểu này bao quát từ các công nghệ nền tảng AI đến ứng dụng trong ngành công nghiệp, robot tương lai, minh chứng rõ ràng cho thành tựu vượt bậc của NVIDIA trong việc thúc đẩy sự đổi mới công nghệ tính toán.

Huang nói rằng NVIDIA nằm tại điểm giao thoa giữa đồ họa máy tính, mô phỏng và trí tuệ nhân tạo – chính là linh hồn của công ty. Mọi thứ được thể hiện hôm nay đều là mô phỏng, là kết quả tổng hợp từ toán học, khoa học, khoa học máy tính và kiến trúc máy tính tuyệt vời. Chúng không phải hoạt ảnh, mà do NVIDIA tự tạo ra, và tất cả đã được tích hợp vào thế giới ảo Omniverse.

Tính toán tăng tốc và AI

Huang nhấn mạnh, mọi thứ chúng ta thấy đều dựa trên hai công nghệ nền tảng: tính toán tăng tốc và AI chạy bên trong Omniverse. Hai lực lượng tính toán này sẽ tái cấu trúc lại toàn bộ ngành công nghiệp máy tính. Ngành công nghiệp này đã tồn tại 60 năm. Trên nhiều phương diện, hầu hết những gì đang làm hôm nay đều bắt nguồn từ năm 1964 – một năm sau khi ông sinh ra.

IBM System 360 đã giới thiệu CPU, tính toán đa năng, tách biệt phần cứng và phần mềm thông qua hệ điều hành, xử lý đa nhiệm, hệ thống IO, DMA và nhiều công nghệ khác vẫn được dùng ngày nay. Tính tương thích kiến trúc, khả năng tương thích ngược, tính tương thích trong dòng sản phẩm – gần như mọi khái niệm cơ bản về máy tính mà chúng ta biết, đều đã được định hình từ năm 1964. Tất nhiên, cuộc cách mạng PC đã dân chủ hóa tính toán, đưa máy tính vào tay mỗi người và vào từng gia đình.

Năm 2007, iPhone khởi đầu kỷ nguyên điện toán di động, đặt máy tính vào túi quần chúng ta. Kể từ đó, mọi thiết bị đều luôn kết nối và vận hành liên tục thông qua đám mây di động. Trong suốt 60 năm qua, chỉ có vài lần – thực tế là rất ít – xảy ra những bước chuyển biến công nghệ lớn, những thay đổi căn bản trong kiến trúc tính toán. Và giờ đây, chúng ta lại đang tiến gần đến một lần như vậy.

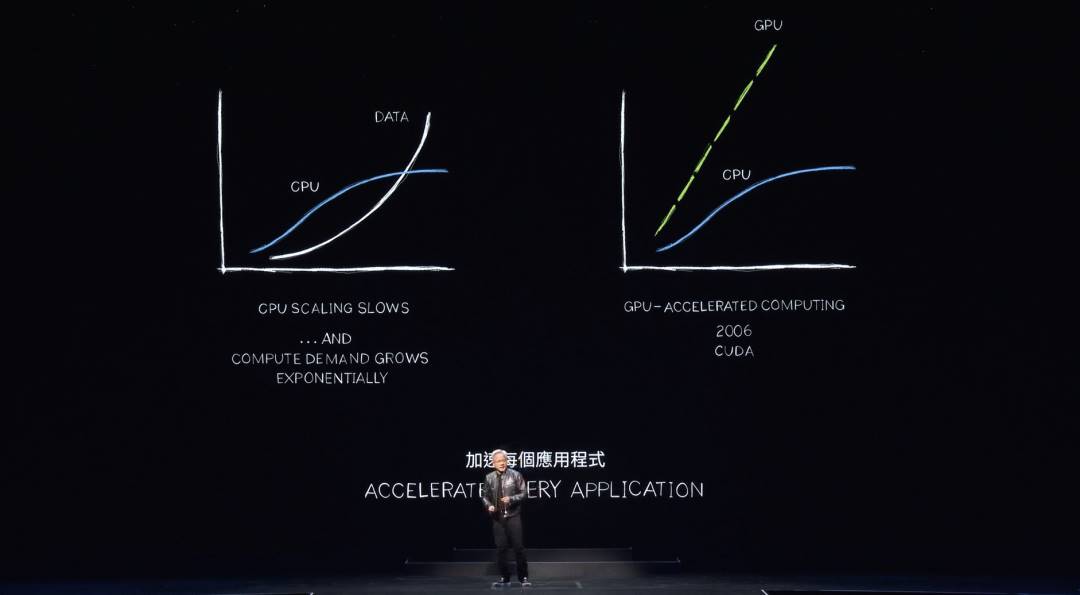

Có hai vấn đề cốt lõi đang diễn ra. Thứ nhất, hiệu suất của bộ xử lý trung tâm (CPU) – trái tim của ngành công nghiệp máy tính – đang tăng trưởng chậm lại đáng kể. Tuy nhiên, khối lượng tính toán cần thiết lại tiếp tục tăng theo cấp số nhân. Nếu nhu cầu xử lý dữ liệu tiếp tục tăng theo cấp số nhân trong khi hiệu suất không theo kịp, lạm phát tính toán sẽ xảy ra. Thực tế, hiện tượng này đã xuất hiện. Lượng điện tiêu thụ toàn cầu bởi các trung tâm dữ liệu đang tăng mạnh. Chi phí tính toán cũng đang leo thang. Chúng ta đang trải nghiệm tình trạng lạm phát tính toán.

Tất nhiên, tình trạng này không thể kéo dài. Dữ liệu sẽ tiếp tục tăng theo cấp số nhân, còn hiệu suất CPU sẽ không bao giờ phục hồi trở lại mức cũ. Nhưng chúng ta có giải pháp tốt hơn. Trong gần hai thập kỷ, NVIDIA đã nghiên cứu tính toán tăng tốc. CUDA tăng cường cho CPU, dỡ bỏ và tăng tốc những tác vụ mà bộ xử lý chuyên dụng có thể thực hiện tốt hơn. Thật vậy, hiệu suất đạt được rất ấn tượng. Rõ ràng rằng khi hiệu suất CPU tăng trưởng chậm lại và cuối cùng dừng hẳn, chúng ta nên tăng tốc mọi thứ.

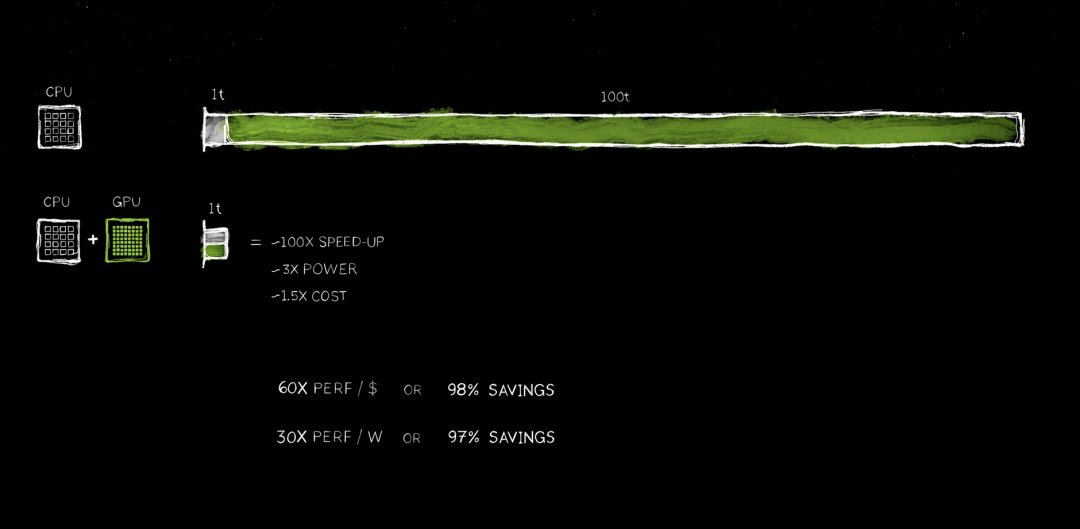

Huang dự đoán, mọi ứng dụng đòi hỏi xử lý nặng sẽ được tăng tốc, và chắc chắn mỗi trung tâm dữ liệu trong tương lai gần sẽ được tăng tốc. Hiện nay, việc tăng tốc tính toán là hoàn toàn hợp lý. Nếu bạn xem xét một ứng dụng, với 100t đại diện cho 100 đơn vị thời gian – có thể là 100 giây hoặc 100 giờ. Trong nhiều trường hợp, như bạn biết, hiện nay có những ứng dụng AI đang chạy trong 100 ngày.

Mã 1T ám chỉ mã cần xử lý tuần tự, nơi CPU đơn luồng rất quan trọng. Logic điều khiển hệ điều hành cực kỳ then chốt, yêu cầu thực thi tuần tự lệnh này sau lệnh kia. Tuy nhiên, có rất nhiều thuật toán, ví dụ như xử lý đồ họa máy tính, có thể hoạt động hoàn toàn song song. Xử lý đồ họa, xử lý ảnh, mô phỏng vật lý, tối ưu hóa tổ hợp, xử lý đồ thị, xử lý cơ sở dữ liệu, và đặc biệt là đại số tuyến tính nổi tiếng trong học sâu – những thuật toán này đều rất phù hợp để tăng tốc nhờ xử lý song song.

Do đó, một kiến trúc mới đã được phát minh: thêm GPU vào CPU. Bộ xử lý chuyên dụng này có thể tăng tốc các tác vụ mất hàng trăm đơn vị thời gian xuống còn cực kỳ nhanh chóng. Bởi vì hai bộ xử lý này có thể làm việc song song, độc lập và tự trị, chúng có thể rút ngắn một tác vụ vốn mất 100 đơn vị thời gian xuống còn 1 đơn vị thời gian. Mức độ tăng tốc là khó tin, hiệu quả rõ rệt – tốc độ tăng gấp 100 lần, nhưng điện năng tiêu thụ chỉ tăng khoảng ba lần, chi phí chỉ tăng khoảng 50%. Điều này đã diễn ra trong ngành PC: NVIDIA thêm một GPU GeForce 500 đô la vào một PC giá 1000 đô la, hiệu suất tăng vọt. NVIDIA cũng làm điều tương tự trong trung tâm dữ liệu: thêm 500 triệu đô la GPU vào một trung tâm dữ liệu trị giá một tỷ đô la, đột nhiên nó trở thành một nhà máy AI. Điều này đang xảy ra khắp nơi trên thế giới.

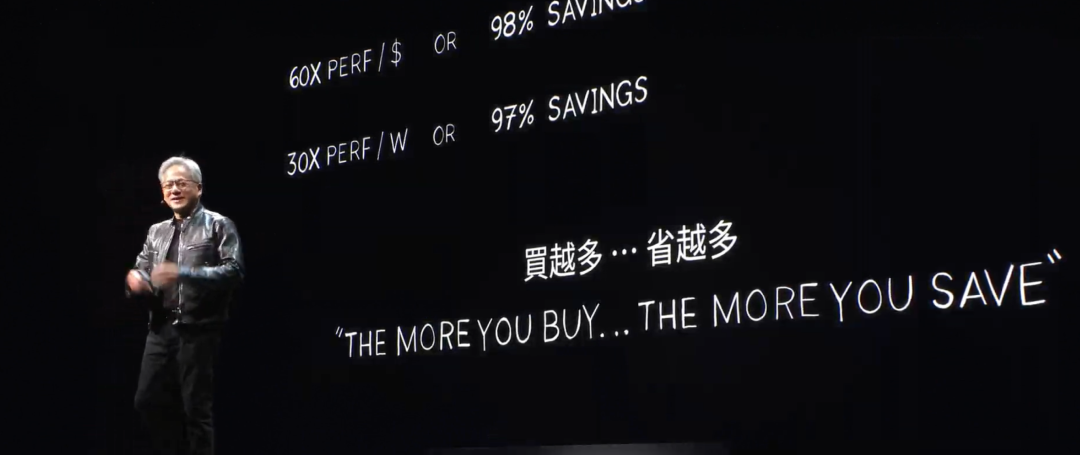

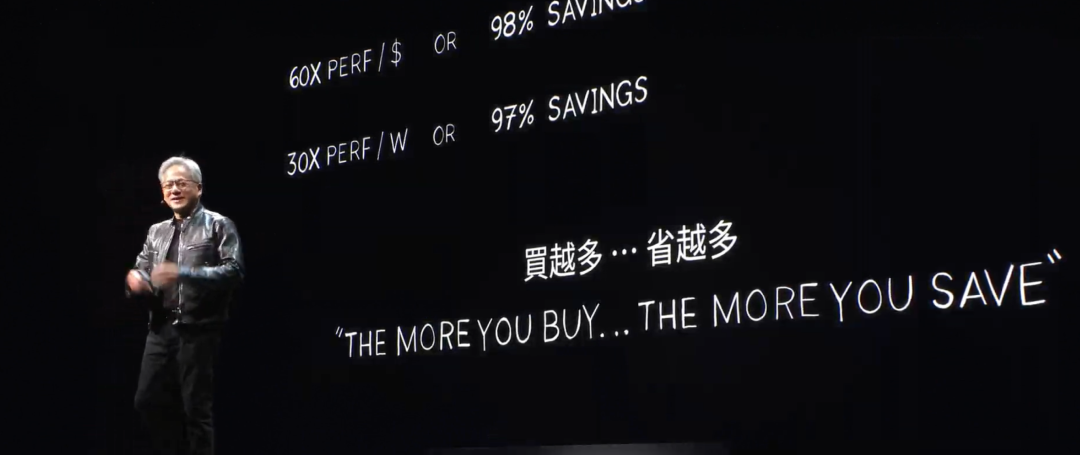

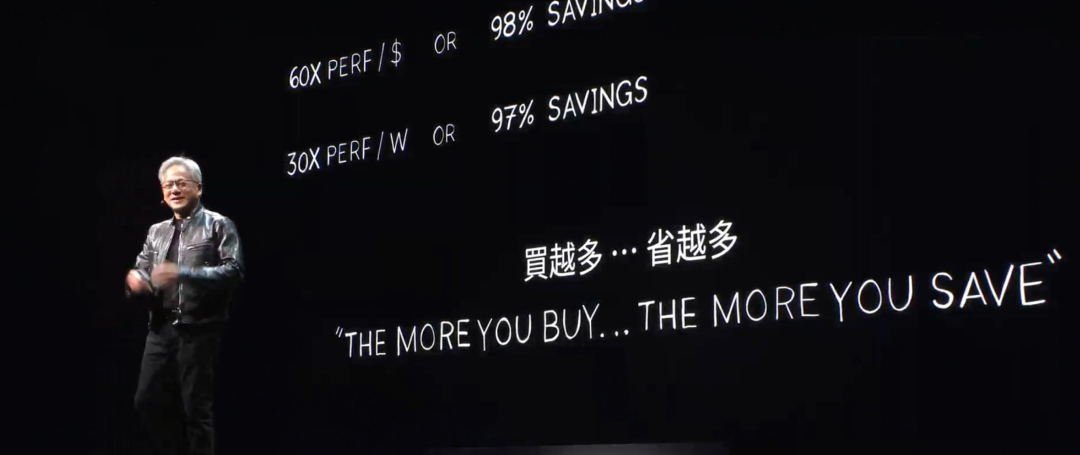

Số tiền tiết kiệm được thật đáng kinh ngạc. Cứ mỗi một đô la chi ra, bạn nhận được hiệu suất tăng gấp 60 lần, tốc độ tăng gấp 100 lần, điện năng tăng ba lần, chi phí tăng 1,5 lần. Mức tiết kiệm này là phi thường, có thể đo lường bằng đô la Mỹ.

Rõ ràng là nhiều công ty đang chi hàng trăm triệu đô la để xử lý dữ liệu trên đám mây. Nếu những quy trình này được tăng tốc, không khó để tưởng tượng khoản tiết kiệm lên tới hàng trăm triệu đô la. Bởi vì chúng ta đã trải qua một thời gian dài lạm phát trong tính toán chung.

Giờ đây, khi quyết định tăng tốc tính toán, có một lượng lớn tổn thất bị lãng phí trước đây có thể được thu hồi, và nhiều lãng phí bị kìm nén có thể được giải phóng khỏi hệ thống. Điều này sẽ chuyển hóa thành tiết kiệm tiền bạc và năng lượng – cũng là lý do tại sao Huang thường nói: "Bạn càng mua nhiều, bạn càng tiết kiệm nhiều".

Huang cũng nói rằng tính toán tăng tốc thực sự mang lại kết quả phi thường, nhưng không hề dễ dàng. Tại sao nó tiết kiệm nhiều tiền như vậy, nhưng trong một thời gian dài con người lại không làm? Vì nó quá khó. Không có phần mềm nào có thể chạy qua trình biên dịch C rồi đột nhiên ứng dụng nhanh hơn 100 lần. Điều đó thậm chí là phi logic. Nếu có thể làm vậy, họ đã cải tiến CPU từ lâu rồi.

Thực tế, phần mềm phải được viết lại hoàn toàn – đây là phần khó nhất. Phần mềm phải được viết lại toàn bộ để có thể biểu đạt lại các thuật toán vốn viết cho CPU, sao cho chúng có thể được tăng tốc, dỡ tải và chạy song song. Bài tập khoa học máy tính này cực kỳ khó khăn.

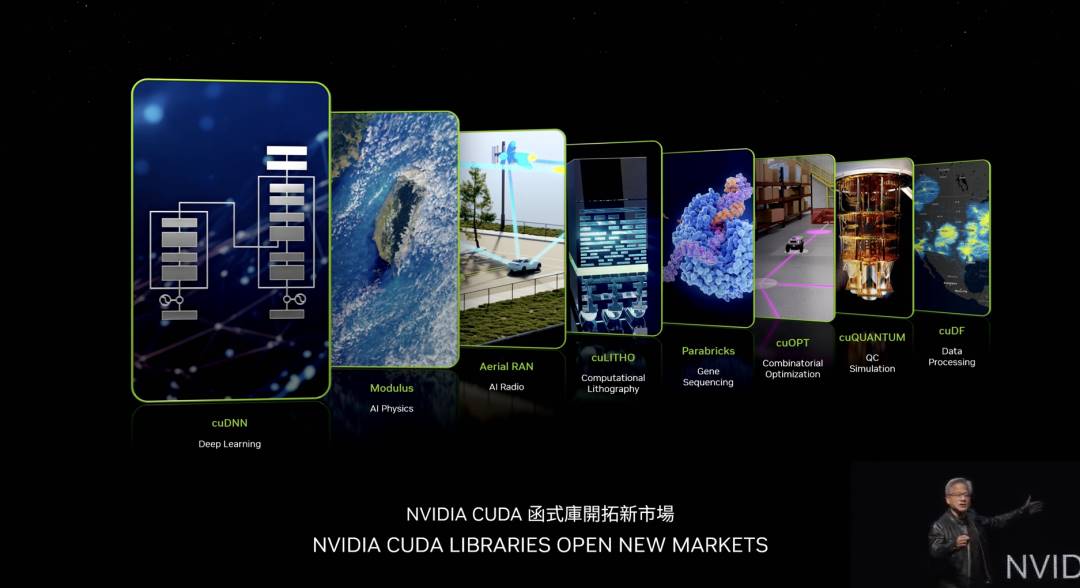

Huang nói rằng trong 20 năm qua, NVIDIA đã giúp cả thế giới dễ dàng hơn. Tất nhiên, có thư viện học sâu cuDNN nổi tiếng – thư viện xử lý mạng thần kinh. NVIDIA có một thư viện vật lý AI, có thể dùng trong động lực học chất lỏng và nhiều ứng dụng khác, nơi mạng thần kinh phải tuân theo các định luật vật lý. NVIDIA có một thư viện tuyệt vời gọi là Arial Ran, là một vô tuyến 5G được tăng tốc CUDA, có thể định nghĩa và tăng tốc mạng viễn thông giống như cách chúng ta định nghĩa Internet. Khả năng tăng tốc này cho phép chúng ta biến toàn bộ viễn thông thành một nền tảng giống như nền tảng điện toán đám mây.

cuLITHO là một nền tảng khắc quang tính toán, có thể xử lý phần tính toán nặng nhất trong sản xuất chip – chế tạo mặt nạ. TSMC đang sử dụng cuLITHO trong sản xuất, tiết kiệm rất nhiều năng lượng và tiền bạc. Mục tiêu của TSMC là tăng tốc toàn bộ hệ thống để chuẩn bị cho các thuật toán mới hơn và các transistor nhỏ hơn, hẹp hơn. Parabricks là thư viện giải trình gen của NVIDIA, là thư viện giải trình gen có thông lượng cao nhất thế giới. cuOpt là một thư viện đáng kinh ngạc cho tối ưu hóa tổ hợp, tối ưu hóa lập kế hoạch tuyến đường, giải bài toán người bán hàng du lịch – một bài toán cực kỳ phức tạp.

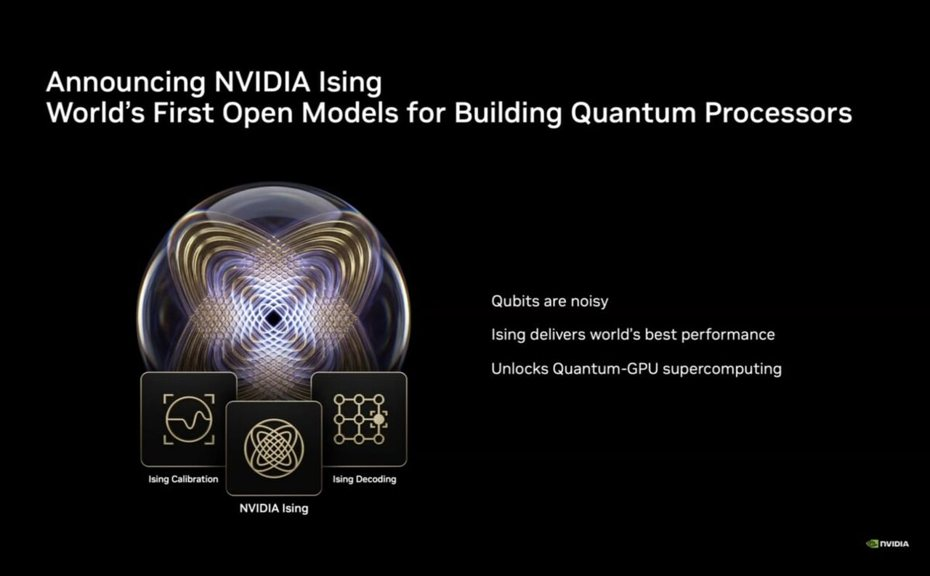

Các nhà khoa học thường tin rằng cần máy tính lượng tử để giải bài toán này. Nhưng NVIDIA đã tạo ra một thuật toán chạy trên tính toán tăng tốc, tốc độ cực nhanh, lập kỷ lục thế giới 23 lần. cuQuantum là hệ thống mô phỏng máy tính lượng tử. Nếu bạn muốn thiết kế một máy tính lượng tử, bạn cần một máy mô phỏng. Nếu bạn muốn thiết kế thuật toán lượng tử, bạn cần một máy mô phỏng lượng tử. Làm sao bạn thiết kế những máy tính lượng tử, tạo ra những thuật toán lượng tử đó nếu máy tính lượng tử chưa tồn tại? Bạn sử dụng máy tính nhanh nhất thế giới hiện nay – tất nhiên là NVIDIA CUDA. Trên đó, NVIDIA có một máy mô phỏng có thể mô phỏng máy tính lượng tử. Nó được hàng trăm nghìn nhà nghiên cứu trên toàn thế giới sử dụng, được tích hợp vào mọi framework tính toán lượng tử hàng đầu, và phổ biến trong các trung tâm siêu tính toán khoa học.

cuDF là một thư viện xử lý dữ liệu đáng kinh ngạc. Xử lý dữ liệu chiếm phần lớn chi phí trên đám mây ngày nay, và tất cả những thứ này nên được tăng tốc. cuDF tăng tốc các thư viện chính được dùng rộng rãi trên thế giới như Spark – nhiều công ty có thể đang dùng Spark, Pandas, một thư viện mới tên Polars, và tất nhiên là NetworkX – một thư viện cơ sở dữ liệu đồ thị. Đây chỉ là một vài ví dụ, còn rất nhiều cái khác nữa.

Huang nói rằng NVIDIA buộc phải tạo ra những thư viện này để hệ sinh thái có thể tận dụng tính toán tăng tốc. Nếu NVIDIA không tạo ra cuDNN, thì chỉ có CUDA thôi là không đủ để khiến các nhà khoa học học sâu khắp thế giới sử dụng, vì khoảng cách giữa CUDA và các thuật toán được dùng trong TensorFlow và PyTorch là quá xa. Điều đó gần như làm đồ họa máy tính mà không có OpenGL, hoặc xử lý dữ liệu mà không có SQL. Những thư viện chuyên biệt này là bảo bối của NVIDIA, tổng cộng có 350 thư viện. Chính những thư viện này đã giúp NVIDIA mở rộng ra hàng loạt thị trường.

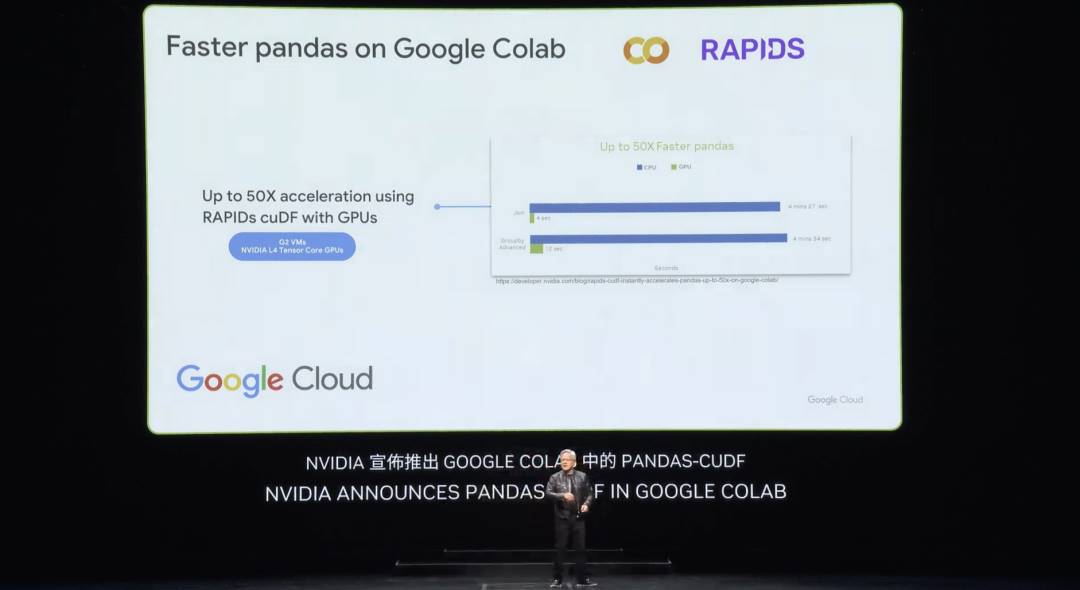

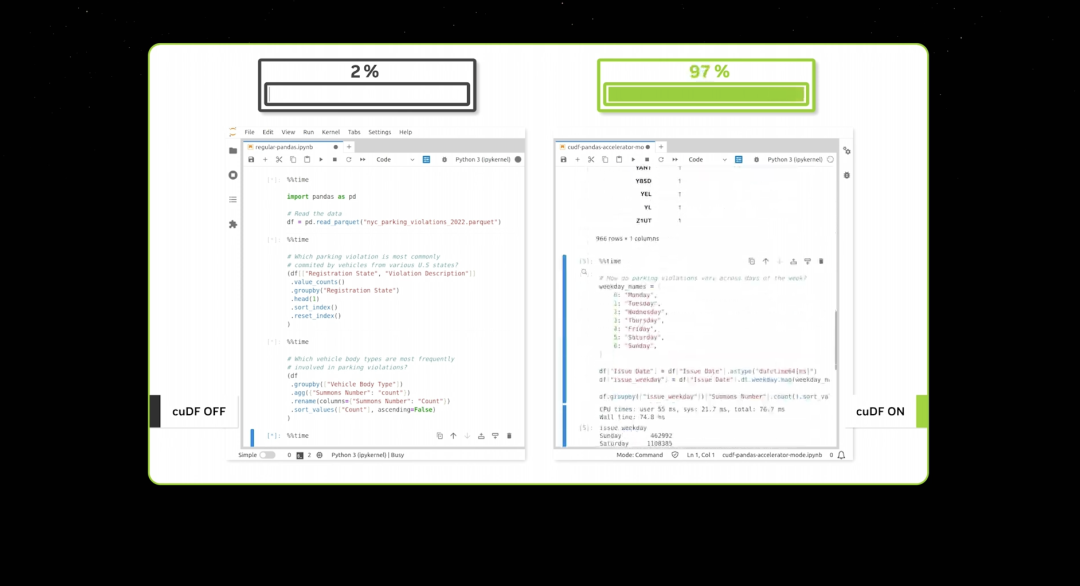

Tuần trước, Google tuyên bố tăng tốc Pandas trên đám mây – thư viện khoa học dữ liệu phổ biến nhất thế giới. Nhiều người trong số các bạn có lẽ đã dùng Pandas, nó được 10 triệu nhà khoa học dữ liệu toàn cầu sử dụng, được tải xuống 170 triệu lần mỗi tháng. Nó là bảng tính của các nhà khoa học dữ liệu. Bây giờ, chỉ cần một cú nhấp chuột, bạn có thể dùng Pandas được tăng tốc bởi cuDF trên nền tảng Colab của Google Cloud, hiệu quả tăng tốc thật sự rất ấn tượng.

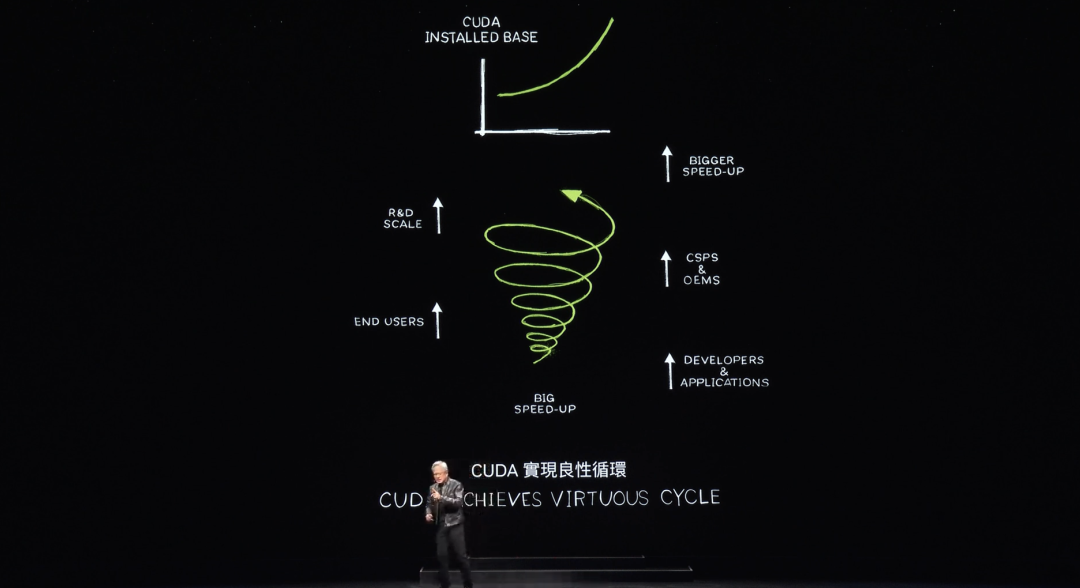

Khi bạn tăng tốc xử lý dữ liệu nhanh đến vậy, việc trình diễn thực sự không mất nhiều thời gian. Giờ đây CUDA đã đạt đến điểm tới hạn mà người ta hay nói đến, nhưng thậm chí còn tốt hơn. CUDA hiện nay đã tạo ra một vòng lặp tích cực.

Điều này hiếm khi xảy ra. Nếu nhìn lại lịch sử tất cả các nền tảng kiến trúc máy tính. Lấy vi xử lý CPU làm ví dụ, nó đã tồn tại 60 năm và không thay đổi ở tầng lớp này. Phương thức tính toán này, tính toán tăng tốc đã tồn tại, việc tạo ra một nền tảng mới cực kỳ khó khăn, vì nó là bài toán "gà hay trứng trước".

Nếu không có nhà phát triển nào dùng nền tảng của bạn, thì hiển nhiên cũng sẽ không có người dùng. Nhưng nếu không có người dùng, thì không có cơ sở cài đặt. Nếu không có cơ sở cài đặt, các nhà phát triển sẽ không quan tâm. Các nhà phát triển muốn viết phần mềm cho cơ sở cài đặt lớn, nhưng cơ sở cài đặt lớn cần rất nhiều ứng dụng để thu hút người dùng tạo nên cơ sở đó.

Vòng luẩn quẩn "gà hay trứng" này rất hiếm khi bị phá vỡ. NVIDIA đã dành 20 năm, một thư viện lĩnh vực này đến một thư viện lĩnh vực khác, một thư viện tăng tốc đến một thư viện tăng tốc khác, giờ đây có 5 triệu nhà phát triển trên toàn thế giới đang dùng nền tảng của NVIDIA.

NVIDIA phục vụ mọi ngành công nghiệp, từ chăm sóc sức khỏe, tài chính, ngành công nghiệp máy tính, ô tô, gần như mọi ngành chính, mọi lĩnh vực khoa học, vì kiến trúc của NVIDIA có quá nhiều khách hàng, các nhà sản xuất OEM và nhà cung cấp dịch vụ đám mây quan tâm đến việc xây dựng hệ thống NVIDIA. Những nhà sản xuất hệ thống tuyệt vời như ở Đài Loan này quan tâm đến việc xây dựng hệ thống NVIDIA, điều này làm tăng lựa chọn hệ thống trên thị trường, tất nhiên mang lại cơ hội lớn hơn để chúng tôi mở rộng quy mô, quy mô R&D, từ đó tăng tốc ứng dụng hơn nữa.

Mỗi lần tăng tốc ứng dụng, chi phí tính toán lại giảm xuống. Tăng tốc 100 lần chuyển hóa thành tiết kiệm 97%, 96%, 98%. Vì vậy, khi chúng ta tăng tốc từ 100 lần lên 200 lần, rồi lên 1000 lần, chi phí biên của tính toán tiếp tục giảm.

NVIDIA tin rằng bằng cách giảm mạnh chi phí tính toán, thị trường, các nhà phát triển, các nhà khoa học, các nhà sáng chế sẽ tiếp tục khám phá ngày càng nhiều thuật toán, những thuật toán tiêu thụ ngày càng nhiều tài nguyên tính toán, cuối cùng sẽ có bước nhảy vọt về chất, chi phí biên tính toán thấp đến mức một cách sử dụng tính toán mới xuất hiện.

Thực tế, đây chính xác là điều đang xảy ra. Trong nhiều năm, NVIDIA đã giảm chi phí tính toán biên cho một thuật toán cụ thể xuống một triệu lần trong 10 năm qua. Vì vậy, bây giờ việc huấn luyện một LLM chứa toàn bộ dữ liệu internet là hoàn toàn hợp lý và bình thường, không ai nghi ngờ. Ý tưởng rằng bạn có thể tạo ra một máy tính có thể xử lý quá nhiều dữ liệu để tự viết phần mềm của mình. Sự xuất hiện của AI là vì niềm tin hoàn toàn rằng nếu làm tính toán rẻ hơn, sẽ luôn có người tìm ra một mục đích tuyệt vời.

Ngày nay, CUDA đã đạt được vòng lặp tích cực. Cơ sở cài đặt đang tăng, chi phí tính toán đang giảm, điều này dẫn đến nhiều nhà phát triển hơn đưa ra nhiều ý tưởng hơn, thúc đẩy nhu cầu nhiều hơn. Giờ đây chúng ta đang ở một điểm khởi đầu rất quan trọng.

Huang sau đó đề cập đến ý tưởng Trái đất 2, tạo ra một bản sao kỹ thuật số của Trái đất, thông qua mô phỏng Trái đất, có thể dự đoán tương lai tốt hơn, từ đó tránh thiên tai tốt hơn, hiểu rõ hơn tác động của biến đổi khí hậu, để thích nghi tốt hơn.

Các nhà nghiên cứu phát hiện ra CUDA vào năm 2012, đó là lần đầu tiên NVIDIA tiếp xúc với AI, một ngày rất quan trọng. May mắn được hợp tác với các nhà khoa học để làm cho học sâu trở thành hiện thực.

AlexNet đạt được bước đột phá lớn trong thị giác máy tính. Nhưng quan trọng hơn, hãy lùi lại một bước để hiểu bối cảnh, nền tảng của học sâu, cũng như tác động và tiềm năng lâu dài của nó. NVIDIA nhận ra công nghệ này có tiềm năng mở rộng lớn. Một thuật toán được phát minh và phát hiện từ vài thập kỷ trước, đột nhiên, nhờ nhiều dữ liệu hơn, mạng lớn hơn và đặc biệt là nhiều tài nguyên tính toán hơn, học sâu đạt được những thành tựu mà thuật toán con người không thể làm được.

Bây giờ hãy tưởng tượng, nếu tiếp tục mở rộng kiến trúc, mạng lớn hơn, dữ liệu nhiều hơn và tài nguyên tính toán nhiều hơn, có thể đạt được điều gì. Sau năm 2012, NVIDIA đã thay đổi kiến trúc GPU, thêm các lõi Tensor. NVIDIA phát minh ra NVLink, đó là 10 năm trước, CUDA, sau đó là TensorRT, NCCL, mua lại Mellanox, TensorRT-ML, máy chủ suy luận Triton, tất cả được tích hợp vào một chiếc máy tính hoàn toàn mới. Không ai hiểu, không ai yêu cầu, không ai hiểu ý nghĩa của nó.

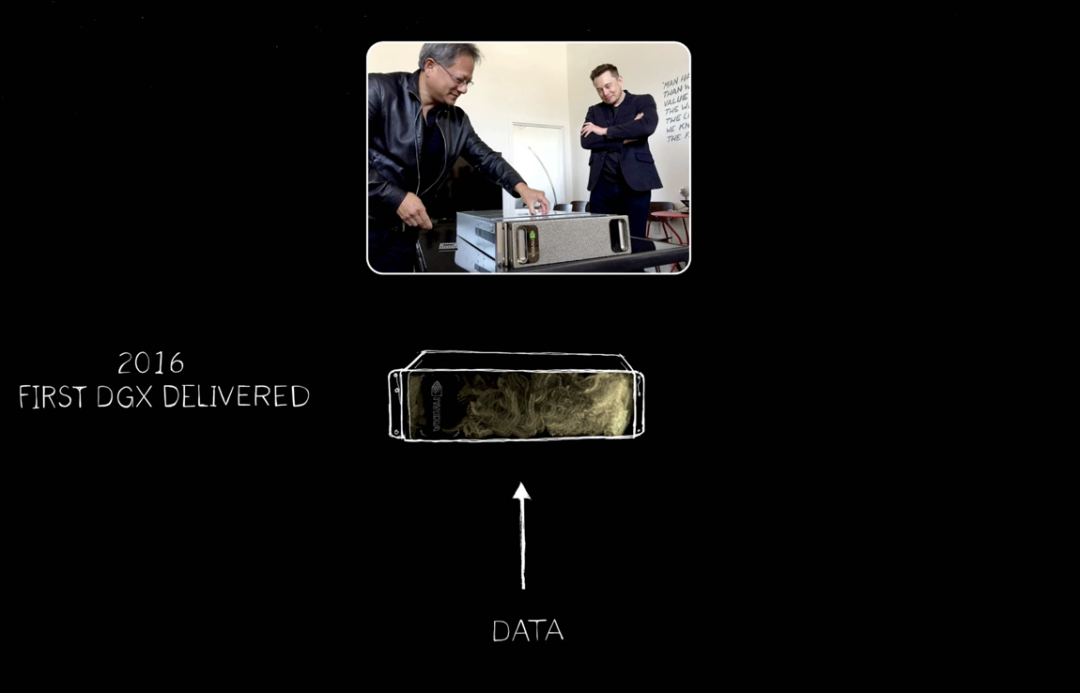

Thật vậy, Huang chắc chắn rằng không ai muốn mua nó, NVIDIA công bố nó tại GTC, OpenAI, một công ty nhỏ ở San Francisco, yêu cầu NVIDIA cung cấp cho họ một chiếc.

Năm 2016, Huang giao chiếc DGX đầu tiên cho OpenAI, siêu máy tính AI đầu tiên trên thế giới. Sau đó, tiếp tục mở rộng, từ một siêu máy tính AI, một thiết bị AI, đến siêu máy tính lớn, thậm chí còn lớn hơn.

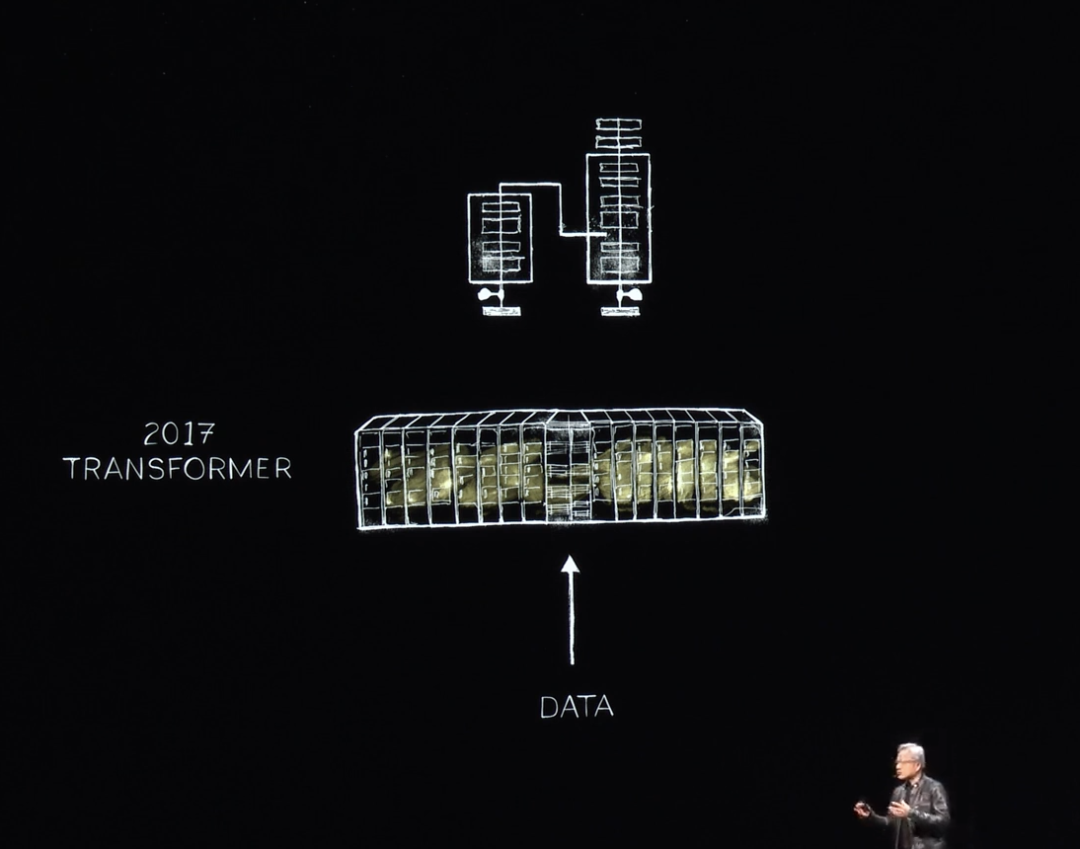

Đến năm 2017, thế giới phát hiện ra Transformer, cho phép huấn luyện lượng dữ liệu lớn, nhận diện và học các mẫu chuỗi dài. Bây giờ, NVIDIA có thể huấn luyện các LLM này, hiểu và đạt được đột phá trong hiểu ngôn ngữ tự nhiên. Tiếp tục tiến lên, xây dựng các hệ thống lớn hơn.

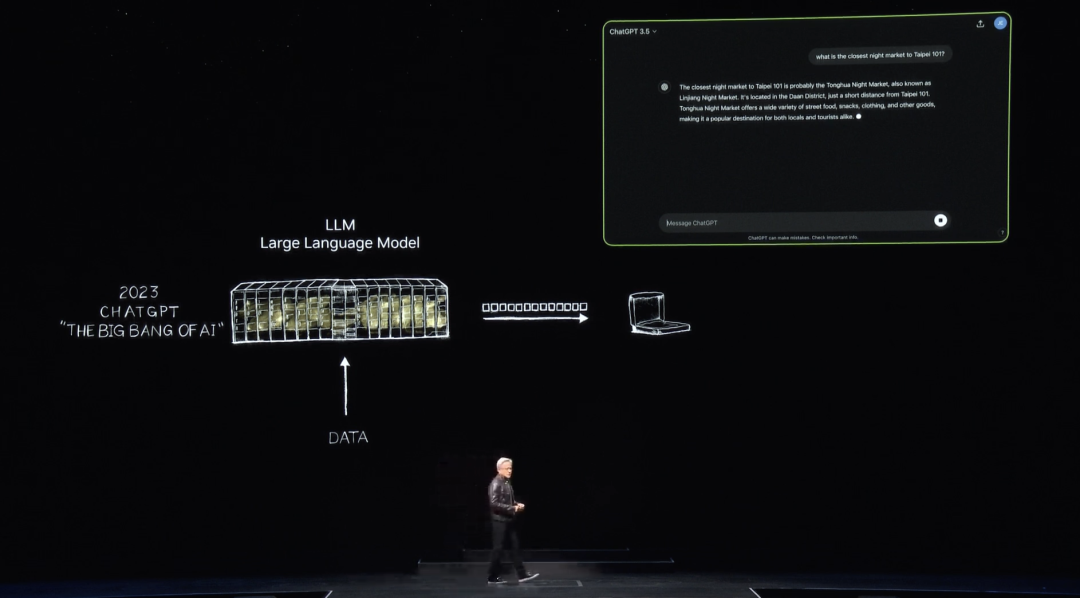

Sau đó vào tháng 11 năm 2022, sử dụng hàng ngàn GPU của NVIDIA và siêu máy tính AI rất lớn, OpenAI phát hành ChatGPT, đạt một triệu người dùng trong năm ngày, một trăm triệu trong hai tháng, trở thành ứng dụng phát triển nhanh nhất trong lịch sử.

Trước khi ChatGPT được giới thiệu với thế giới, AI luôn là về nhận thức, hiểu ngôn ngữ tự nhiên, thị giác máy tính, nhận dạng giọng nói. Tất cả đều về nhận thức và phát hiện. Lần đầu tiên, thế giới giải quyết được AI tạo sinh, từng token một, và những token này là từ. Tất nhiên, một số token hiện nay có thể là hình ảnh, biểu đồ, bảng, bài hát, từ, giọng nói, video. Những token này có thể là bất cứ thứ gì bạn hiểu được ý nghĩa của nó, chúng có thể là token hóa chất, token protein, token gen. Những gì bạn thấy trước đó trong dự án Trái đất 2, là tạo ra token thời tiết.

Chúng ta có thể hiểu, chúng ta có thể học vật lý. Nếu bạn có thể học vật lý, bạn có thể dạy mô hình AI vật lý. Mô hình AI có thể học ý nghĩa của vật lý, sau đó có thể tạo ra vật lý. Chúng ta thu nhỏ nó xuống 1 km, không phải bằng lọc, mà bằng tạo sinh. Vì vậy, chúng ta có thể tạo ra gần như bất kỳ token có giá trị nào bằng phương pháp này. Chúng ta có thể tạo ra điều khiển vô-lăng cho xe hơi, tạo ra hành động cho cánh tay robot. Mọi thứ chúng ta có thể học, giờ đây đều có thể tạo sinh.

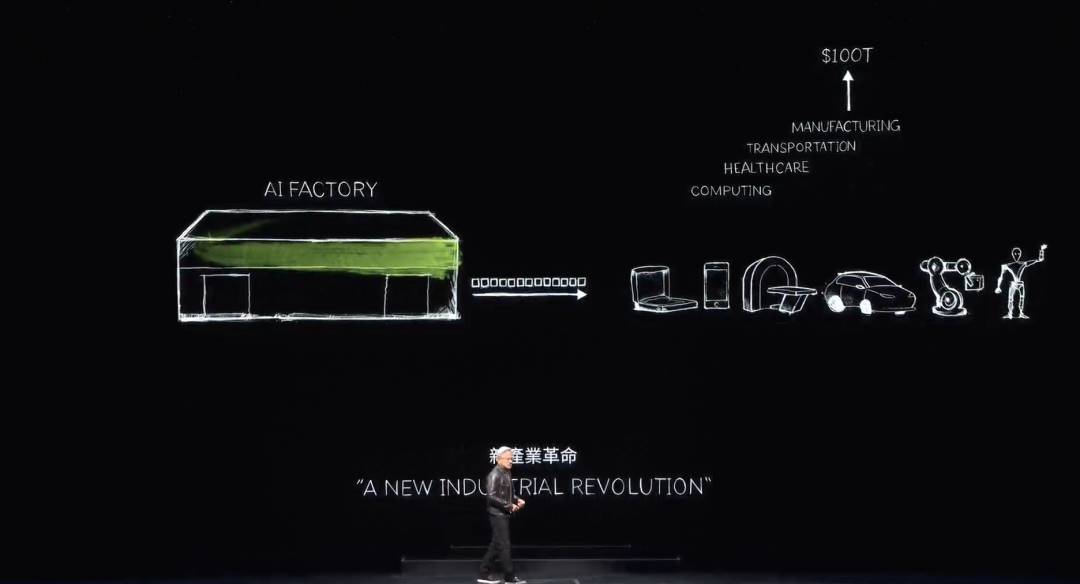

Nhà máy AI

Bây giờ chúng ta đã bước vào kỷ nguyên AI tạo sinh. Nhưng điều thực sự quan trọng là, chiếc máy tính ban đầu là siêu máy tính này giờ đây đã phát triển thành một trung tâm dữ liệu, nó chỉ tạo ra một thứ duy nhất, đó là token, nó là một nhà máy AI, nhà máy AI này đang tạo ra, sáng tạo và sản xuất một mặt hàng mới có giá trị to lớn.

Cuối những năm 1890, Nikola Tesla phát minh ra máy phát điện xoay chiều, và NVIDIA phát minh ra máy phát AI. Máy phát điện tạo ra electron, máy phát AI của NVIDIA tạo ra token, hai thứ này đều có cơ hội khổng lồ trên thị trường, có thể thay thế cho nhau trong gần như mọi ngành công nghiệp, cũng là lý do tại sao đây là một cuộc cách mạng công nghiệp mới.

NVIDIA giờ đây có một nhà máy mới, sản xuất một mặt hàng mới cho mỗi ngành công nghiệp, mặt hàng này có giá trị phi thường. Phương pháp này có khả năng mở rộng cao, và tính lặp lại của phương pháp này cũng rất cao.

Chú ý rằng mỗi ngày có quá nhiều mô hình AI tạo sinh khác nhau được phát minh. Mỗi ngành công nghiệp giờ đây đang đổ xô vào. Lần đầu tiên, ngành công nghiệp IT trị giá 3 nghìn tỷ đô la đang tạo ra thứ gì đó có thể trực tiếp phục vụ ngành công nghiệp trị giá 100 nghìn tỷ đô la. Không còn chỉ là công cụ lưu trữ thông tin hoặc xử lý dữ liệu, mà là một nhà máy tạo ra trí tuệ cho mỗi ngành công nghiệp. Điều này sẽ trở thành một ngành công nghiệp sản xuất, nhưng không phải sản xuất máy tính, mà là sử dụng máy tính để sản xuất.

Điều này chưa từng xảy ra trong lịch sử. Tính toán tăng tốc mang lại AI, mang lại AI tạo sinh, giờ đây mang lại cuộc cách mạng công nghiệp. Tác động đến ngành công nghiệp cũng rất rõ rệt, có thể tạo ra một mặt hàng mới, một sản phẩm mới cho nhiều ngành công nghiệp, gọi là token, nhưng tác động đến chính ngành công nghiệp của chúng ta cũng rất sâu sắc.

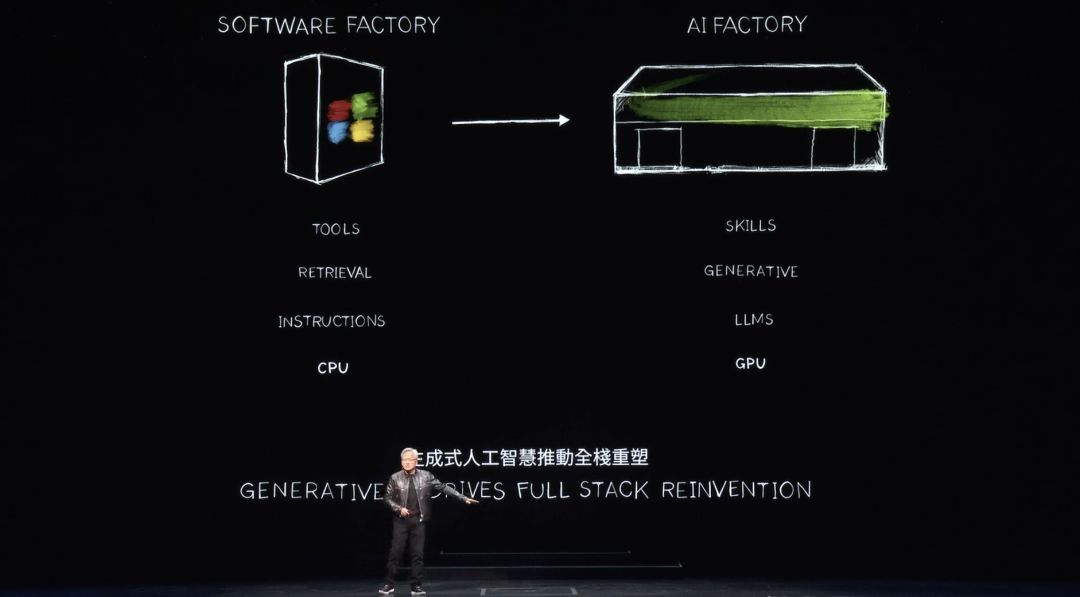

60 năm qua, mỗi tầng lớp của tính toán đều thay đổi, từ tính toán chung CPU sang tính toán GPU tăng tốc, máy tính cần lệnh. Giờ đây máy tính xử lý LLM, mô hình AI. Còn mô hình tính toán trước đây dựa trên truy xuất. Gần như mỗi lần bạn chạm vào điện thoại, nó sẽ truy xuất cho bạn một đoạn văn bản, hình ảnh hoặc video đã ghi sẵn, và sắp xếp lại dựa trên hệ thống gợi ý để trình bày cho bạn.

Huang nói rằng trong tương lai, máy tính sẽ tạo sinh dữ liệu càng nhiều càng tốt, chỉ truy xuất thông tin cần thiết. Lý do là dữ liệu tạo sinh cần ít năng lượng hơn để lấy thông tin. Dữ liệu tạo sinh cũng liên quan đến ngữ cảnh hơn. Nó sẽ mã hóa kiến thức, hiểu bạn. Bạn không còn yêu cầu máy tính lấy thông tin hay tệp tin nữa, mà yêu cầu nó trả lời câu hỏi của bạn trực tiếp. Máy tính sẽ không còn là công cụ bạn sử dụng, mà là tạo sinh kỹ năng, thực hiện nhiệm vụ.

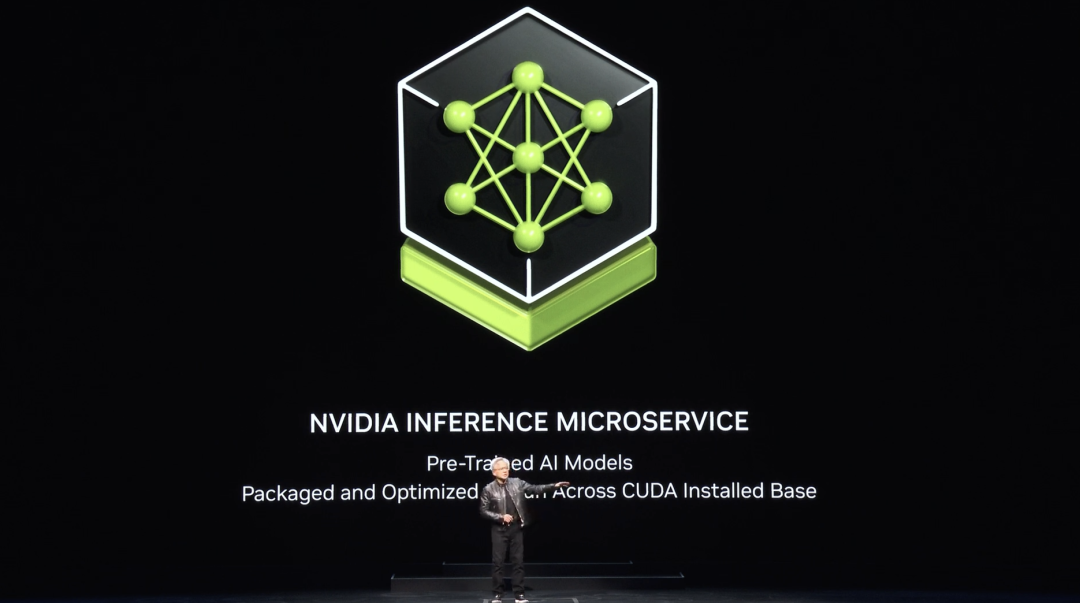

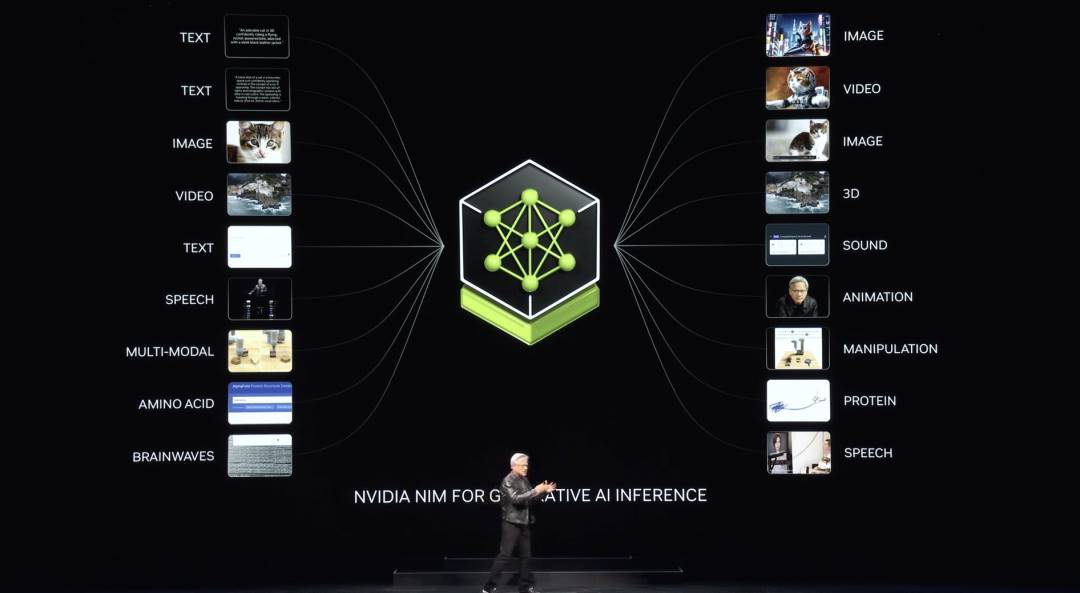

NIMs, Dịch vụ vi mô suy luận của NVIDIA

Thay vì một ngành công nghiệp sản xuất phần mềm, đây là một ý tưởng cách mạng vào đầu những năm 90. Nhớ lại ý tưởng đóng gói phần mềm của Microsoft đã cách mạng hóa ngành công nghiệp PC. Không có phần mềm đóng gói, chúng ta sẽ làm gì với PC? Nó thúc đẩy ngành công nghiệp này, giờ đây NVIDIA có một nhà máy mới, một máy tính mới. Chúng ta sẽ chạy một loại phần mềm mới trên đó, gọi là NIMs, Dịch vụ vi mô suy luận của NVIDIA.

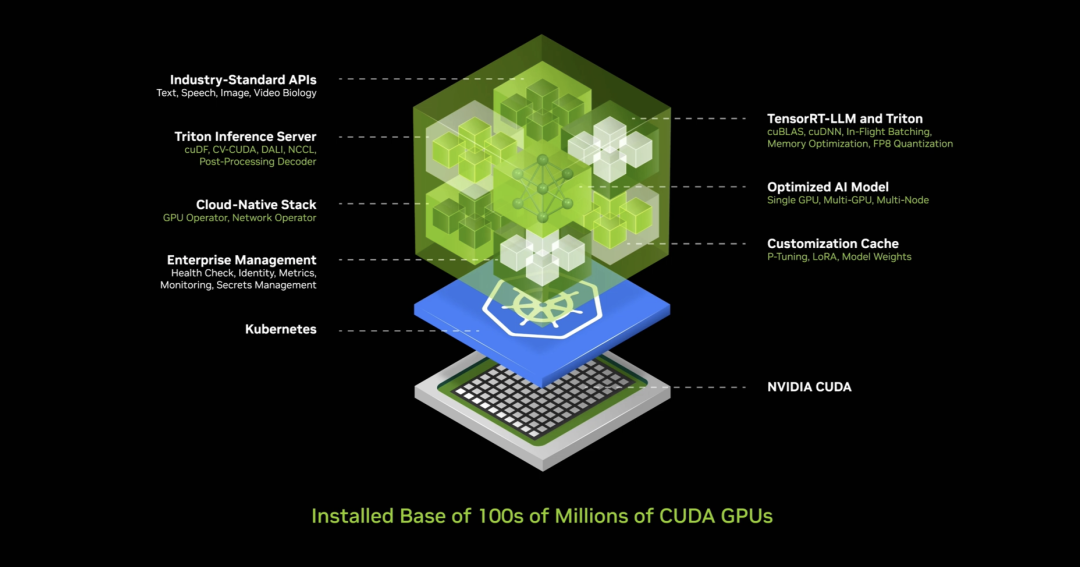

NIM chạy bên trong nhà máy này, NIM này là một mô hình đã được huấn luyện trước, nó là một AI. Bản thân AI này cực kỳ phức tạp, nhưng ngăn xếp tính toán để chạy AI thì cực kỳ phức tạp. Khi bạn dùng ChatGPT, ngăn xếp đằng sau nó là một lượng lớn phần mềm. Đằng sau nó là prompt, là một lượng lớn phần mềm, cực kỳ phức tạp, vì mô hình lớn, có hàng tỷ đến hàng nghìn tỷ tham số. Nó không chỉ chạy trên một máy tính, mà trên nhiều máy tính. Nó phải phân bổ khối lượng công việc giữa nhiều GPU, sử dụng song song tensor, song song ống dẫn, song song dữ liệu, các loại song song khác nhau, song song chuyên gia, để phân bổ khối lượng công việc giữa nhiều GPU, xử lý càng nhanh càng tốt.

Bởi vì nếu bạn đang vận hành trong một nhà máy, thông lượng của bạn liên quan trực tiếp đến doanh thu. Thông lượng của bạn liên quan trực tiếp đến chất lượng dịch vụ, thông lượng của bạn liên quan trực tiếp đến số lượng người có thể sử dụng dịch vụ của bạn.

Hiện nay chúng ta đang sống trong một thế giới mà việc sử dụng thông lượng trung tâm dữ liệu là cực kỳ quan trọng. Trước đây điều này quan trọng, nhưng không quan trọng như bây giờ. Trước đây điều này quan trọng, nhưng người ta không đo lường nó. Ngày nay, mọi tham số đều được đo lường, thời gian khởi động, thời gian chạy, mức sử dụng, thông lượng, thời gian rảnh, v.v., vì đây là một nhà máy. Khi một thứ là nhà máy, hoạt động của nó liên quan trực tiếp đến hiệu suất tài chính của công ty, điều này cực kỳ phức tạp đối với hầu hết các công ty.

Vì vậy NVIDIA đã làm gì? NVIDIA tạo ra chiếc hộp AI này, chiếc hộp chứa đầy phần mềm, bên trong hộp gồm CUDA, cuDNN, TensorRT, dịch vụ suy luận Triton. Nó có bản chất đám mây, có thể tự động mở rộng trong môi trường Kubernetes, nó có dịch vụ quản lý và móc nối để giám sát AI của bạn. Nó có API chung, API chuẩn, bạn có thể trò chuyện với chiếc hộp này. Tải xuống NIM này, bạn có thể trò chuyện với nó, miễn là máy tính của bạn có CUDA, giờ đây tất nhiên là phổ biến khắp nơi. Nó có sẵn trên mọi đám mây, từ mọi nhà sản xuất máy tính. Nó có sẵn trên hàng trăm triệu PC, toàn bộ phần mềm được tích hợp, 400 phụ thuộc được gói gọn trong một.

NVIDIA đã kiểm thử NIM này, mọi mô hình đã được huấn luyện trước đều được kiểm thử trên toàn bộ cơ sở cài đặt, tất cả các phiên bản khác nhau của Pascal, Ampere và Hopper, và các phiên bản khác nhau. Tôi thậm chí quên mất một số tên. Một phát minh khó tin, là một trong những thứ tôi yêu thích nhất.

Huang nói rằng NVIDIA có tất cả các phiên bản khác nhau này, dù dựa trên ngôn ngữ hay thị giác, hay hình ảnh, hoặc dùng trong chăm sóc sức khỏe, sinh học số, có phiên bản con người số, chỉ cần truy cập ai.nvidia.com.

Huang cũng nói rằng hôm nay NVIDIA vừa phát hành NIM Llama3 được tối ưu hóa hoàn toàn trên HuggingFace, nó có sẵn để bạn thử, bạn thậm chí có thể lấy nó đi. Nó được cung cấp miễn phí cho bạn. Bạn có thể chạy nó trên đám mây, trên bất kỳ đám mây nào. Bạn có thể tải xuống container này, đặt vào trung tâm dữ liệu của riêng bạn, và có thể cung cấp cho khách hàng của bạn.

NVIDIA có các phiên bản cho nhiều lĩnh vực khác nhau, vật lý, một số dùng cho truy xuất ngữ nghĩa, gọi là RAGs, ngôn ngữ thị giác, nhiều ngôn ngữ khác nhau. Cách bạn sử dụng chúng là kết nối các dịch vụ vi mô này vào các ứng dụng lớn.

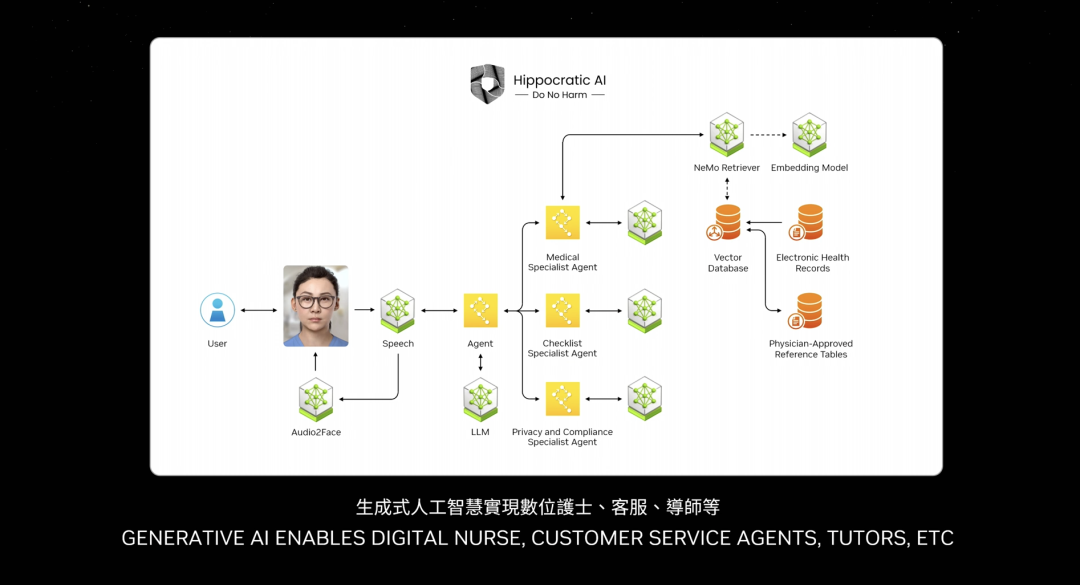

Một trong những ứng dụng quan trọng nhất trong tương lai đương nhiên là dịch vụ khách hàng. Gần như mọi ngành công nghiệp đều cần Agent. Điều này đại diện cho hàng nghìn tỷ đô la dịch vụ khách hàng. Y tá theo một nghĩa nào đó cũng là Agent dịch vụ khách hàng, một số y tá không kê đơn hoặc không chẩn đoán về cơ bản là dịch vụ khách hàng bán lẻ, thực phẩm nhanh, tài chính, bảo hiểm. Hàng chục triệu dịch vụ khách hàng giờ đây có thể được tăng cường bằng mô hình ngôn ngữ và AI. Vì vậy, những chiếc hộp bạn thấy về cơ bản chính là NIMs.

Một số NIM là Agent suy luận, nhận nhiệm vụ, xác định nhiệm vụ, phân tích thành kế hoạch. Một số NIM truy xuất thông tin. Một số NIM có thể tìm kiếm. Một số NIM có thể sử dụng công cụ, như cuOpt mà Huang đã đề cập trước đó. Nó có thể sử dụng công cụ chạy trên SAP. Do đó nó phải học một ngôn ngữ đặc biệt gọi là ABAP. Có lẽ một số NIM phải thực hiện truy vấn SQL. Vì vậy, tất cả các NIM này đều là chuyên gia, giờ đây được lắp ráp thành một đội.

Vậy điều gì đã thay đổi? Tầng ứng dụng đã thay đổi. Ứng dụng trước đây được viết bằng lệnh, giờ đây là ứng dụng lắp ráp đội AI. Rất ít người biết cách viết chương trình, nhưng gần như ai cũng biết cách phân tích vấn đề và lắp ráp đội ngũ. Tôi tin rằng trong tương lai, mỗi công ty sẽ có một tập hợp lớn NIM. Bạn sẽ tải xuống các chuyên gia mình muốn, kết nối chúng thành một đội, bạn thậm chí không cần biết chính xác cách kết nối chúng. Bạn chỉ cần giao nhiệm vụ cho một Agent, một NIM, để nó xác định cách phân bổ nhiệm vụ. Agent lãnh đạo đội đó sẽ phân tích nhiệm vụ và phân công cho các thành viên trong đội. Các thành viên đội sẽ thực hiện nhiệm vụ, gửi kết quả về cho lãnh đạo đội, lãnh đạo đội sẽ suy luận kết quả và trình bày thông tin cho bạn, giống như con người, đây là hình thái tương lai của ứng dụng, trong tương lai gần.

Tất nhiên, bạn có thể tương tác với các dịch vụ AI lớn này thông qua nhắc nhở bằng văn bản và giọng nói. Tuy nhiên, có nhiều ứng dụng muốn tương tác dưới dạng con người. NVIDIA gọi chúng là con người số, và đã nghiên cứu công nghệ con người số trong một thời gian dài.

Huang tiếp tục giới thiệu, con người số có tiềm năng trở thành Agent tương tác tuyệt vời với bạn, làm cho tương tác hấp dẫn hơn, đồng cảm hơn. Tất

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News