Affaire du relais Claude : plus la censure est stricte, plus l’industrie grise est développée

TechFlow SélectionTechFlow Sélection

Affaire du relais Claude : plus la censure est stricte, plus l’industrie grise est développée

Le véritable risque ne réside pas dans la géopolitique, mais dans la manière dont cette chaîne d’approvisionnement implique des personnes ordinaires — dont beaucoup sont déjà en situation de vulnérabilité — dans des marchés criminels.

Auteur : Zilan Qian

Traduction et synthèse : TechFlow

Introduction de TechFlow : La Maison Blanche affirme que des laboratoires chinois ont utilisé « des dizaines de milliers de comptes proxy » pour voler des modèles d’IA américains. Or, elle interprète mal la réalité : il ne s’agit pas d’une opération ciblée et sophistiquée menée par quelques laboratoires, mais d’un marché gris ouvertement actif sur GitHub, Taobao, Twitter et Telegram. Tout Chinois souhaitant utiliser des outils d’IA avancés — professeurs, programmeurs ou passionnés — recourt à ces relais API (« middlemen »), dont les prix peuvent descendre à seulement 10 % du tarif officiel. Cela révèle une faille critique dans le cadre américain de sécurité de l’IA : chaque nouvelle couche de blocage engendre une infrastructure correspondante de contournement, et le véritable risque ne réside pas dans la géopolitique, mais dans la façon dont cette chaîne d’approvisionnement implique des particuliers — souvent déjà vulnérables — dans un marché criminel.

Le 23 avril 2026, la Maison Blanche a publié une note d’information mettant en garde contre des attaques de « distillation » à échelle industrielle menées par des entités chinoises contre les modèles d’IA américains de pointe, utilisant « des dizaines de milliers de comptes proxy » afin d’échapper à la détection. En février 2026, Anthropic avait également signalé que des laboratoires chinois avaient mené des attaques coordonnées de distillation via « un seul réseau proxy gérant plus de 20 000 comptes frauduleux ». Dans les deux documents, le terme « proxy » — intermédiaire entre les utilisateurs et les fournisseurs de modèles — est présenté comme un dispositif systématique conçu délibérément par quelques laboratoires chinois de pointe afin d’extraire des modèles d’IA américains.

Quelle que soit la question de savoir si les laboratoires chinois s’appuient effectivement sur la distillation pour « rattraper » leur retard, ces deux documents méconnaissent la nature réelle de cette économie des proxies. Sous l’activité de quelques laboratoires se déploie un marché bien plus vaste, qui fonctionne ouvertement depuis longtemps sur GitHub, Taobao, Twitter et Telegram. Il s’agit d’une économie grise de relais API (souvent désignés comme des « middlemen »), permettant aux développeurs chinois d’accéder aux modèles d’Anthropic à des coûts pouvant descendre à 10 % du prix officiel. Les participants ne se limitent pas à quelques chercheurs expérimentés en IA, ni leurs motivations à la simple ambition de construire un modèle de pointe pour combler un écart technologique. Toute personne souhaitant utiliser des modèles ou outils d’IA plus avancés — qu’il s’agisse de professeurs ou étudiants universitaires, de professionnels de la tech, de développeurs indépendants ou d’amateurs — utilise ces relais API. Les journaux (logs) qu’ils génèrent sont eux-mêmes devenus une marchandise, échangée à des fins aussi variées que l’entraînement des modèles ou la fraude ciblée.

Dans le même temps, chaque nouvelle mesure de contrôle ajoutée par les entreprises américaines de pointe en IA — blocage géographique, vérification par téléphone portable, exigence de carte bancaire étrangère, et désormais vérification KYC biométrique en temps réel — suscite en retour le développement d’une infrastructure spécifique de contournement. L’impact de ces nouvelles « fermes de SMS » et opérations de collecte biométrique dépasse largement la géopolitique : il influe directement sur la conception même des cadres de sécurité de l’IA de pointe.

S’appuyant sur mon article de 2025 publié dans ChinaTalk, consacré à l’accès aux modèles américains interdits en Chine, cette mise à jour se concentre spécifiquement sur l’économie des relais API : comment elle se constitue, comment elle génère des revenus, et quelles limites elle révèle quant à l’efficacité du blocage d’accès et de la surveillance des comptes comme outils de gouvernance de l’IA. Pourtant, contrairement au marché gris décrit en 2025, l’histoire de 2026 ne s’arrête plus aux frontières entre utilisateurs chinois et fournisseurs américains de modèles d’IA. L’économie des relais API met en lumière des points aveugles des cadres de sécurité de l’IA, conçus pour prévenir des dangers allant au-delà de la compétition États-Unis–Chine — tels que l’usage malveillant par des acteurs malintentionnés ou l’érosion de la traçabilité des fournisseurs — tout en alimentant un marché criminel qui exploite des personnes ordinaires — dont beaucoup sont déjà en situation de vulnérabilité — au sein de cette chaîne d’approvisionnement.

Pour illustrer le fonctionnement des relais API, prenons l’exemple d’Anthropic, société dotée du système de blocage géographique le plus strict, et dont les modèles connaissent une forte popularité auprès des développeurs chinois.

Figure : Une blague circulant sur Internet en Chine : « Crois-tu être plus intelligent que Claude ? »

Blocage géographique et vérification d’identité (KYC)

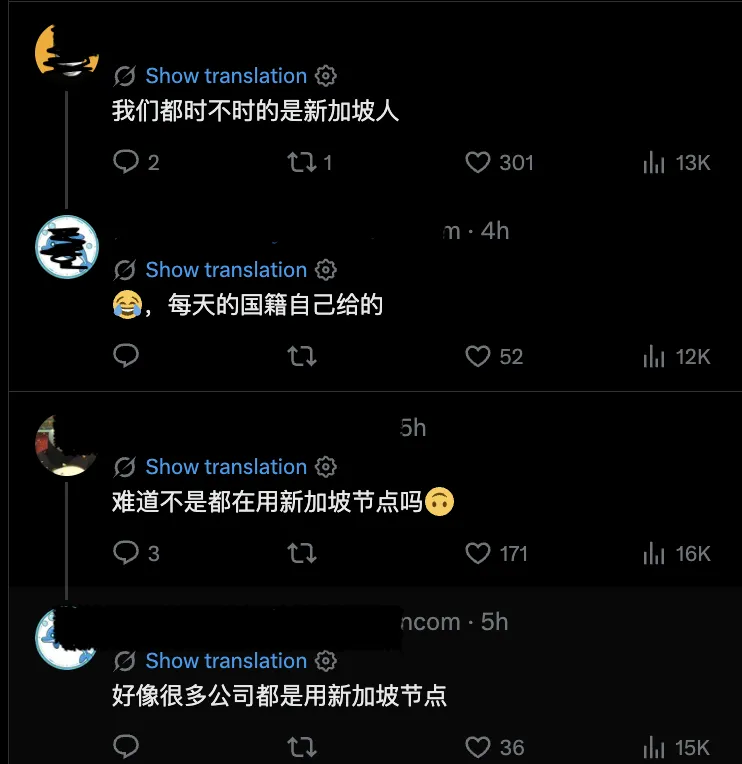

Sur la carte des pays pris en charge par Anthropic, la Chine est manifestement absente ; sur Internet chinois, Anthropic n’apparaît pas non plus — du moins sur le plan technique. En pratique, ni le blocage d’Anthropic ni le Grand Pare-feu ne parviennent à empêcher les utilisateurs chinois d’accéder à Claude et à Claude Code. Depuis 2025, malgré la censure tant institutionnelle que gouvernementale, les modèles Claude prospèrent sur des applications de commerce électronique telles que Taobao, tandis que Singapour — dont la population est inférieure à celle de New York — a « étonnamment » enregistré, en avril 2026, la plus forte consommation mondiale moyenne par habitant de jetons Claude chez Anthropic.

Figure : Des développeurs chinois plaisantent sur Twitter à propos du rapport indiquant que Singapour est le pays où la consommation de jetons Claude est la plus élevée, suggérant que cela s’explique par le fait que les Chinois routent leur trafic vers Singapour pour accéder au modèle. « Nous nous sentons parfois tous singapouriens. » « Je me réattribue une nationalité chaque jour. » « Est-ce parce que nous utilisons tous des nœuds situés à Singapour ? » « Il semblerait que de nombreuses entreprises utilisent effectivement des nœuds à Singapour. »

Actuellement, le gouvernement chinois ne limite pas activement l’accès des développeurs chinois aux modèles américains de pointe. En revanche, Anthropic prend cette question très au sérieux et applique plusieurs couches de mécanismes destinés à bloquer les utilisateurs résidant sur le continent chinois. Au niveau le plus fondamental, l’inscription à un compte exige un numéro de téléphone portable, une carte bancaire étrangère et une adresse de facturation correspondante. Le 5 septembre 2025, Anthropic a renforcé sa politique en interdisant tout accès aux entités dont plus de 50 % du capital est détenu, directement ou indirectement, par des sociétés dont le siège social se trouve dans des régions non prises en charge (telles que la Chine), quelle que soit la juridiction sous laquelle elles opèrent. Cette mesure colmate une faille précédemment exploitée, qui permettait à des filiales étrangères contrôlées par des entités chinoises de conserver un accès à l’API.

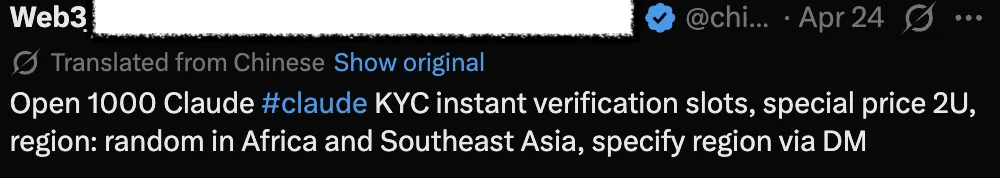

La mesure la plus récente date d’avril 2026 : Anthropic a commencé à exiger, pour certains utilisateurs, une vérification d’identité reposant sur une pièce d’identité officielle avec photo délivrée par une autorité gouvernementale, accompagnée d’une prise de vue en temps réel (selfie). Ainsi, Claude devient la première grande plateforme grand public d’IA à mettre en œuvre un niveau aussi élevé de vérification d’identité. Ce dispositif est déployé de manière sélective, déclenché par des cas d’utilisation spécifiques ou des signaux liés à l’intégrité de la plateforme. Pour les utilisateurs chinois accédant à Claude via un VPN ou un autre intermédiaire, cette nouvelle politique KYC devrait théoriquement rendre l’accès à Claude nettement plus difficile — même si les utilisateurs chinois peuvent falsifier un numéro de téléphone et une adresse, ils auraient, en principe, bien plus de difficultés à produire un selfie en temps réel cohérent avec un document d’identité officiel.

En pratique, les Chinois ne peuvent pas seulement accéder à Claude et aux outils associés, mais la plupart du temps, ils achètent des jetons à seulement 10 % du prix officiel. La magie réside dans les « relais API » (« middlemen »).

Qu’est-ce qu’un « relais API » ?

Le terme « relais API » (« middleman ») désigne, au sein de l’écosystème des développeurs chinois, un proxy API — un serveur situé à l’étranger, entre le développeur et l’infrastructure d’Anthropic. Il reçoit les requêtes API, les transfère en simulant une origine située au niveau du relais, puis renvoie les réponses. L’utilisateur redirige simplement son logiciel vers le serveur du proxy plutôt que vers celui d’Anthropic, et paie en yuans via WeChat Pay ou Alipay. Ce procédé contourne la nécessité d’un VPN et d’une carte bancaire étrangère pour un accès direct. Les relais les plus connus sont référencés dans des dépôts communautaires, classés selon leurs prix actualisés et leur disponibilité (uptime). Sous eux, des projets plus petits et individuels apparaissent et disparaissent continuellement.

Bien que ce dispositif ressemble fonctionnellement aux agrégateurs API légitimes occidentaux tels qu’OpenRouter, les relais API évoluent dans un univers entièrement différent en matière de légalité et de confiance. Les agrégateurs légitimes existent pour simplifier les flux de travail des développeurs, facturent des tarifs standard sur la base d’accords commerciaux transparents. À l’inverse, les relais API sont explicitement conçus pour contourner les restrictions, acheminant les données via des intermédiaires non responsables.

Comme la fourniture de services VPN ou la vente de Claude sur Taobao, les relais API sont techniquement interdits en Chine. Selon les règlements chinois sur l’enregistrement des services d’IA, toute offre de service d’IA non enregistrée et non évaluée en termes de sécurité est illégale. Mais, tout comme certaines petites entreprises peuvent éviter l’enregistrement relatif à l’IA sans subir de sanctions, la plupart des relais API suivent le même chemin. Toutefois, plus l’affaire grossit, plus l’exploitation devient risquée.

La chaîne d’approvisionnement des relais API

Un relais API n’est pas une entité unique. Il occupe une position centrale dans une chaîne d’approvisionnement hiérarchisée, où la plupart des acteurs n’interagissent jamais directement entre eux.

L’amont regroupe les fournisseurs de ressources : les marchands de comptes, qui enregistrent ou acquièrent massivement des comptes Anthropic ; les plateformes de vérification par SMS, qui fournissent des numéros de téléphone étrangers requis lors de l’inscription ; et, sur le plan technique, les ingénieurs reverse-engineers, qui analysent le code client d’Anthropic afin d’identifier des raccourcis d’authentification ou de détecter les changements dans la logique de détection. L’infrastructure de paiement des cartes bancaires et des réseaux de proxies permet également de facturer à l’étranger depuis la Chine.

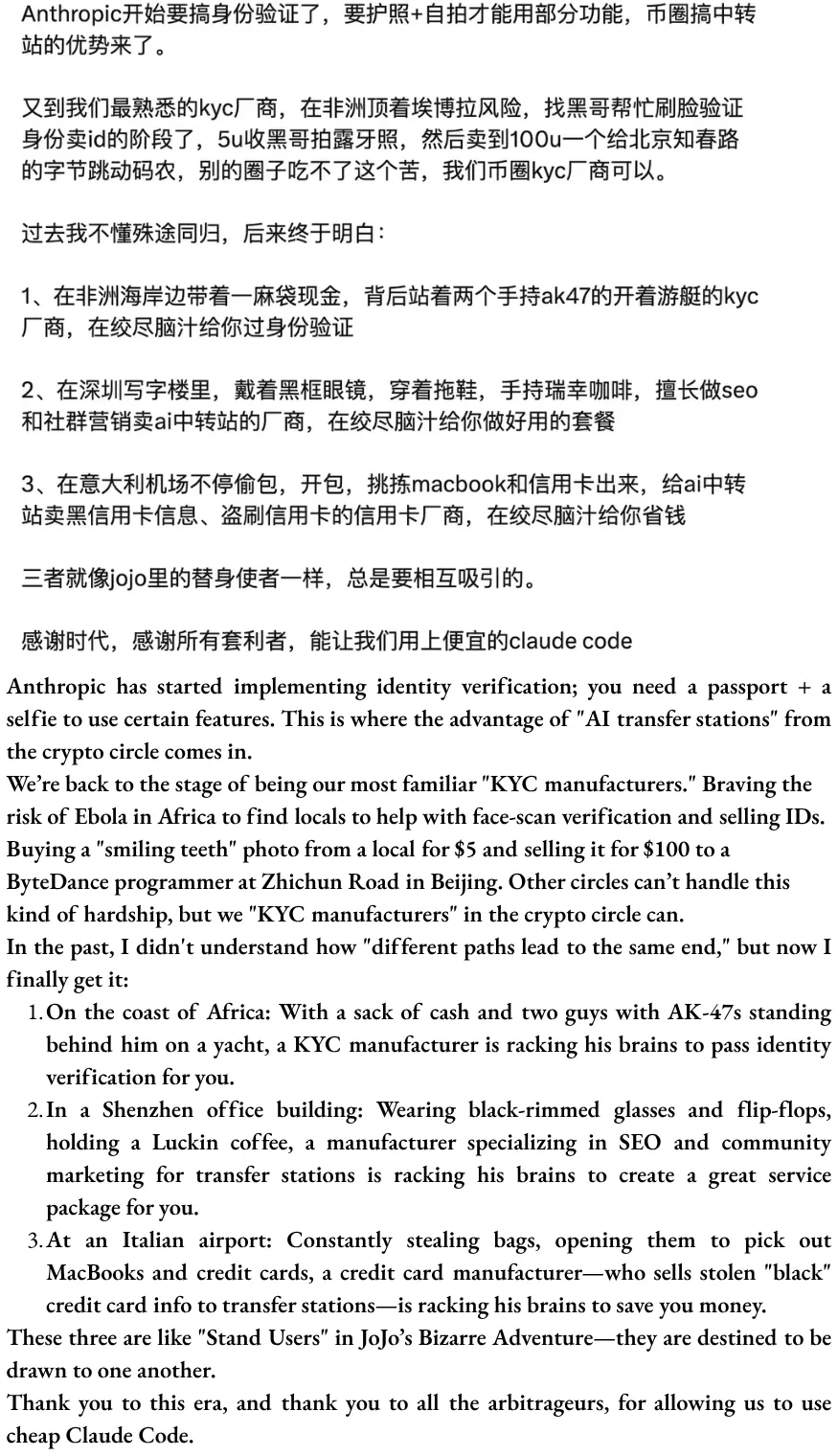

L’amont doit aussi répondre aux mécanismes KYC plus complexes — qu’ils soient automatisés ou humains. Les services d’IA ont déjà démontré leur capacité à générer des faux documents d’identité hautement réalistes, capables de tromper les systèmes de vérification des principales plateformes ; les outils de deepfake permettent désormais aux criminels de créer des clones numériques capables de passer avec succès des vérifications biométriques à distance. Même si les défenseurs parviennent à détecter efficacement les tentatives d’usurpation d’humain par une IA, une méthode plus laborieuse existe : des agents se rendent dans des pays à faible revenu d’Afrique ou d’Amérique latine pour recruter des personnes réelles disposées à réaliser sur place la vérification nécessaire. Le marché noir de Worldcoin fournit un précédent documenté : des scans d’iris collectés par des prestataires KYC au Cambodge et au Kenya sont vendus à moins de 30 dollars.

Figure : Compte Twitterpromouvant des services de vérification KYC.

Le maillon central est le relais API lui-même : une interface logicielle qui reçoit les demandes des utilisateurs et les transmet à Anthropic comme si elles provenaient de comptes légitimes ; une intégration de paiement (généralement Alipay ou WeChat Pay) ; et une couche opérationnelle banale, chargée de maintenir le système en marche — en recyclant les comptes avant qu’ils ne soient marqués, en équilibrant la charge entre les comptes du pool, et en s’adaptant continuellement aux mises à jour du système de détection des abus d’Anthropic.

L’aval regroupe les clients : développeurs individuels utilisant Codex ou Claude Code ; entreprises routant leurs processus internes via un proxy ; concepteurs d’applications intégrant l’API dans leurs produits ; et revendeurs secondaires achetant l’accès en gros pour le reconditionner et le revendre à des particuliers sur Taobao — comme je l’ai documenté l’année dernière.

Presque personne ne gère l’ensemble de la chaîne. La plupart des acteurs ne possèdent qu’un ou deux maillons, qu’ils monétisent efficacement, formant ainsi un système modulaire résilient. Les fournisseurs de modèles d’IA peuvent certes suspendre des opérateurs individuels, mais le pool de comptes en amont et la base de clients en aval restent intacts. Tant qu’il existera des développeurs désirant accéder à Claude — et des marchés noirs de justificatifs d’identité — deux caractéristiques structurelles durables — des remplaçants émergeront rapidement.

Figure : Une capture d’écran circulant dans un groupe WeChat de développeurs, moquant la chaîne d’approvisionnement permettant de contourner le processus KYC d’Anthropic ; l’original est en chinois (en haut), la traduction par l’auteure figure ci-dessous.

Trois usages pour un seul poisson : comment les jetons deviennent bon marché

Cependant, ce qui paraît le plus étrange n’est pas tant la façon dont on obtient l’accès à Claude ou Claude Code en Chine, que la manière dont on peut l’obtenir à un prix absurde — généralement fixé à 1 yuan par jeton de 1 dollar — soit une réduction de 70 à 90 % par rapport au prix officiel. Selon les discussions publiques, les relais API disposent d’au moins trois méthodes pour y parvenir — couramment désignées sous le terme imagé de « trois usages pour un seul poisson ».

Premier usage : la majoration d’accès. Celle-ci est possible car les fournisseurs de ressources en amont peuvent recourir à au moins cinq stratégies relativement « innocentes » pour multiplier les proxies :

— Enregistrement massif de comptes API afin de bénéficier des crédits gratuits d’Anthropic (5 dollars par compte) ;

— Revente des quotas inutilisés issus de comptes tiers ;

— « APImaxxing » — un abonnement Max de 200 dollars, dont le quota horaire de jetons est partagé entre plusieurs utilisateurs, tirant profit de l’écart entre le prix fixe de l’abonnement et le coût bien supérieur d’un accès API payé au jeton ;

— Enfin, une entrée plus sombre en amont : des comptes achetés à l’aide de cartes bancaires volées ou frauduleuses, dont le coût réel pour l’opérateur est nul et qui peuvent être intégrés au pool de proxies. Bien qu’il soit impossible de vérifier précisément la part représentée par cette méthode comparée aux quatre autres « innocentes », ces deux marchés partagent probablement certaines infrastructures et personnels.

Deuxième usage : substitution de modèles et inflation artificielle des jetons. Puisque les entrées des utilisateurs et les sorties des modèles transitent par le proxy, les utilisateurs ne peuvent pas vérifier à quel modèle réel leurs requêtes sont acheminées. Un utilisateur choisit Opus 4.7, mais le proxy peut discrètement rediriger la requête vers Sonnet, Haiku, voire, dans le pire des cas, vers GLM ou Qwen, et falsifier l’étiquetage de la sortie. Dans un article récent du Centre Helmholtz CISPA pour la sécurité de l’information en Allemagne (qui cite mon article de l’année dernière sur le marché gris), des chercheurs ont audité 17 relais API et constaté une substitution généralisée de modèles — l’accès à « Gemini-2.5 » via un proxy API n’atteint que 37,00 % sur un benchmark médical, contre 83,82 % pour l’API officielle. Du côté utilisateur, la supercherie ne se révèle que sur des tâches complexes, lorsque la sortie semble anormale (phénomène couramment appelé « dumbing down »), sans qu’il existe de méthode simple pour en apporter la preuve. De nombreux rapports publics soulignent les inquiétudes concernant la détérioration notable des performances de certains relais API. Ces derniers sont soupçonnés de « diluer » leur service en remplaçant des modèles de pointe par des versions inférieures.

Outre la substitution de modèles, la surconsommation de jetons permet également de faire baisser le prix unitaire, au prix d’une augmentation globale du coût. Certains cas relèvent de la structure même du système : les proxies qui changent fréquemment de comptes perturbent la continuité de la mise en cache, forçant les utilisateurs à dépenser des jetons pleins prix sur des contextes qui seraient sinon presque gratuits. D’autres cas semblent intentionnels, les fournisseurs de proxy cherchant à maximiser le volume d’utilisation. Il est extrêmement difficile, depuis l’extérieur, de distinguer ces deux catégories.

Troisième usage : les journaux (logs) constituent en eux-mêmes un produit. C’est probablement l’élément le plus important, car il touche à la fois à la confidentialité des données et à la distillation. Chaque requête passant par le proxy — prompt complet, réponse complète, appels d’outils, itérations — est stockée sur les serveurs de l’opérateur du proxy. Pour les proxies d’IA dédiés au codage, ces journaux contiennent de longues chaînes de raisonnement, des décisions techniques réelles, des contextes de dépôt et des sorties validées par des humains. Ils constituent donc un jeu de données idéal pour l’entraînement postérieur : pour l’ajustement fin supervisé sur des tâches réelles d’ingénierie, et, dans le cas où l’intégralité du trajet de raisonnement est capturée, pour la distillation du mode de raisonnement de Claude vers des modèles plus petits. La communauté chinoise des développeurs affirme que cela se produit effectivement dans certains cas, mais il n’est pas encore prouvé que les opérateurs de proxies collectent systématiquement ces journaux et les revendent, ni à qui. Toutefois, des données de distillation issues de ce type d’économie circulent bel et bien sur le réseau ouvert. Plusieurs jeux de données contenant des sorties de raisonnement de Claude Opus 4.6 circulent sur HuggingFace, sans que leur origine soit claire. Théoriquement, on pourrait nettoyer et revendre à d’autres développeurs de modèles en Chine des jeux de données similaires.

Les deux premiers « usages » permettent d’offrir des jetons à un prix inférieur à celui d’Anthropic, mais pour atteindre des niveaux aussi absurdes que 10 %, voire 5 %, du prix initial, il faut impérativement exploiter le troisième. Comme le dit un proverbe chinois : « Il n’y a pas de déjeuner gratuit. » Plusieurs développeurs chinois révèlent que la vente à prix majoré n’est qu’un moyen d’attirer des clients, tandis que la véritable source de profit réside dans la collecte des journaux. L’utilisateur est à la fois client payant et producteur involontaire de données, échangeant sa vie privée contre un accès à bas coût. Certains alertent également sur le risque que les données personnelles divulguées par les proxies soient utilisées à des fins de prospection, de fraude ou même de chantage. Afin d’éviter ces risques pour la vie privée, certains développeurs chinois ont même mis en place leurs propres proxies API pour Claude Code, et publié librement les guides d’exploitation.

Ce que la vérification d’identité ne révèle pas

L’utilisation de l’IA évolue progressivement des chatbots vers des outils intégrés. Avec l’émergence des agents autonomes et de l’économie des jetons, la question d’accès aux modèles américains ne porte plus uniquement sur la possibilité d’y accéder, mais aussi sur son rapport coût-efficacité. En effet, l’écosystème chinois de l’IA — qu’il s’agisse de laboratoires de pointe, de groupes universitaires de recherche, de développeurs indépendants ou d’amateurs — souffre globalement d’un manque de financement. Parallèlement, les données générées par les utilisateurs via les relais API affluent clairement vers des marchés en aval, pour servir à l’entraînement de modèles, aux transactions de données ou à la fraude. Si la distillation fait partie intégrante de cette économie, alors le problème dépasse largement la portée anticipée par le gouvernement américain ou les entreprises d’IA, qui se concentrent sur quelques acteurs de pointe.

L’histoire nous enseigne que le blocage d’accès rarement empêche des utilisateurs déterminés. Il augmente le coût d’accès, créant ainsi un marché lucratif pour toute personne capable d’en réduire le coût. Le Grand Pare-feu a fait des services VPN une industrie florissante, pratiquée à domicile en Chine. Les exigences KYC ont engendré une économie de falsification d’identité, allant des revendeurs de cartes d’identité nationales aux opérations de collecte biométrique en Asie du Sud-Est ou en Afrique. Les multiples couches de contrôle mises en place par les entreprises d’IA de pointe — blocage géographique, vérification par téléphone, exigence de carte bancaire, et désormais vérification biométrique en temps réel — produisent exactement le même effet.

Cependant, cette histoire dépasse le cadre « Anthropic / États-Unis contre Chine ». Elle met en lumière une vérité troublante concernant le contrôle d’accès, qu’il s’agisse de frontières géopolitiques ou d’un champ plus large. La méthode qu’un développeur géobloqué utilise pour contourner les restrictions est structurellement identique à celle qu’un terroriste pourrait employer pour accéder à des modèles d’IA de pointe et concevoir des armes biologiques destructrices sans être traqué. La question de l’accès est à la fois une considération géopolitique spécifique et une préoccupation commune en matière de sécurité.

Aujourd’hui, la recherche en sécurité de l’IA considère le contrôle d’accès au niveau système — notamment la détection, la surveillance et la suspension des comptes pour les modèles fermés de poids publics — comme une mesure de protection essentielle. En matière de surveillance, les développeurs contrôlent l’infrastructure d’inférence, y compris le marquage en temps réel des entrées et sorties nuisibles. La détection (par exemple les exigences KYC) suppose que le fournisseur puisse attribuer un comportement à un participant identifiable, et la suspension de comptes repose sur l’hypothèse que cette action permet effectivement de refuser l’accès. Or, les fournisseurs de modèles américains ne contrôlent pas l’inférence des utilisateurs chinois acheminée via des relais API — ce sont les opérateurs de relais qui détiennent ce contrôle. Lorsqu’une requête nuisible arrive, le fournisseur de modèles d’IA ne voit pas l’adresse IP réelle de l’utilisateur, mais celle du relais. Et lorsqu’un compte est suspendu, la chaîne d’approvisionnement en amont peut établir un nouveau relais en quelques heures.

Pour les outils de surveillance plus complexes, le problème s’aggrave encore. Le système Clio d’Anthropic est partiellement conçu pour détecter des abus coordonnés invisibles au niveau d’une seule conversation, en identifiant des motifs traversant plusieurs comptes et dialogues. Par exemple, il repère un réseau automatisé de comptes générant du spam pour les moteurs de recherche à l’aide de structures de prompts similaires, puis procède à leur suspension. Mais comme les requêtes transitent par des relais, la suspension ne bloque pas efficacement le comportement sous-jacent. Pour des attaques délibérément orchestrées — telles que la répartition de requêtes nuisibles sur plusieurs étapes et plusieurs comptes proxy, chacune apparaissant isolément comme inoffensive — les motifs transversaux sont bien moins évidents que ceux du spam coordonné, dont les signaux sont naturellement très marqués.

Enfin, les relais API ne reflètent pas seulement le schéma classique attaquant–défenseur — qu’il s’agisse de la confrontation entre entreprises américaines d’IA et utilisateurs chinois, ou entre mesures de sécurité de l’IA et acteurs malveillants. Ce marché noir possède sa propre chaîne d’approvisionnement et sa propre logique d’exploitation, générant des dommages bien supérieurs à la simple question initiale d’accès. Les informations faciales collectées aujourd’hui pour la vérification KYC des relais — destinées à contourner les systèmes d’Anthropic — peuvent être revendues demain pour ouvrir des comptes financiers frauduleux, falsifier des dossiers d’emploi ou générer des deepfakes, imposant aux personnes originaires du Sud global des conséquences juridiques et réputationnelles. L’infrastructure routant les requêtes Claude peut servir à tromper les utilisateurs via le remplacement de modèles, des escroqueries ciblées fondées sur des données de prompts divulguées, ou du chantage. Les opérations de « farming » de comptes — vérifications massives par SMS, inscriptions frauduleuses, détournement de comptes — nourrissent à leur tour un marché criminel plus vaste de téléphonie indésirable, de SMS de phishing, de demandes de prêts frauduleuses et de fraude à la carte bancaire. Nombre de ces dommages n’ont aucun lien direct avec l’IA ou la géopolitique.

Mais aujourd’hui, chaque sous-produit de ce marché gris — du danger potentiel que représente l’usage de l’IA par des terroristes pour synthétiser la prochaine pandémie, jusqu’à l’exploitation concrète et aux activités criminelles actuelles — existe bel et bien. Bien que le Grand Pare-feu ou les blocages géographiques de l’IA tentent de tracer des frontières nationales définissant qui peut accéder aux technologies de pointe, le marché gris révèle que les risques, eux, ne sont pas divisibles.

Remerciements :

Zilan remercie Alan Chan, Gabriel Wagner, Karuna Nandkumar et Kayla Blomquist pour leurs retours utiles.

L’auteure reconnaît avoir utilisé un modèle de langage (LLM) pour une première recherche documentaire, pour clarifier des concepts techniques et pour la révision du texte. Elle exprime également sa gratitude pour le fait qu’elle puisse encore, depuis la Chine continentale, accéder à Claude via un VPN et un nœud situé à Singapour, sans déclencher le processus KYC.

Les sources proviennent d’échanges informels.

L’interface de programmation d’applications (API) est le canal permettant aux développeurs d’intégrer directement des logiciels avec des modèles d’IA — envoyer des requêtes aux serveurs d’Anthropic et recevoir des réponses par programmation, plutôt que via une interaction navigatrice.

Plus précisément, il s’agit de remplacer la variable d’environnement ANTHROPICBASEURL par l’adresse du proxy.

Source : échanges informels et recherche documentaire.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News