GitHub Copilot 改收費,揭開了 AI 行業最大的謊言

TechFlow Selected深潮精選

GitHub Copilot 改收費,揭開了 AI 行業最大的謊言

OpenAI、Anthropic、微軟同時在虧本養你,但這場遊戲快撐不住了。

作者:Ed Zitron

編譯:深潮 TechFlow

深潮導讀:微軟終於撐不住了,GitHub Copilot 從月費制改為按 token 計費。這不是產品升級,而是整個 AI 行業補貼騙局的集體破產——OpenAI、Anthropic 們用月費掩蓋真實成本,讓用戶每花 1 美元就燒掉 8-13 美元的算力,訓練出一代根本不可能持續的使用習慣。當價格迴歸現實,你會發現那些"革命性"的 AI 工具,可能只是昂貴的玩具。

我剛寫了一篇關於 OpenAI 如何幹掉 Oracle 的文章,今天這篇用了其中一些材料。這是我寫過最好的文章之一,我非常自豪。

訂閱付費版既超值,也讓我能每週寫出這些大型、深度研究的免費文章。

昨天早上,GitHub Copilot 用戶得到了我一週前報道過的消息確認——所有 GitHub Copilot 計劃將在 2026 年 6 月 1 日改為按使用量計費。

微軟不再給用戶一定數量的"請求次數",而是根據用戶實際使用的模型成本收費,微軟稱這是"……朝著可持續、可靠的 Copilot 業務和所有用戶體驗邁出的重要一步。"用戶現在能用多少,取決於他們訂閱費能買多少 token(比如每月 19 美元的計劃能用 19 美元的 token)。

翻譯:我們不能繼續補貼 GitHub Copilot 用戶了,否則 Amy Hood(微軟 CFO)會開始用棒球棒打人。

這份公告本身就是個有趣的預覽,展示了這些價格變動會如何被包裝:

Copilot 已經不是一年前的產品了。它已經從編輯器內的助手進化為一個能運行長時間、多步驟編碼會話的智能體平臺,使用最新模型,在整個代碼庫中迭代。智能體使用正在成為默認模式,這帶來了顯著更高的計算和推理需求。現在,一個快速的聊天問題和一個數小時的自主編碼會話,用戶付的錢可能是一樣的。GitHub 一直在吸收這種使用背後不斷攀升的推理成本,但目前基於請求次數的高級模式已經不可持續了。按使用量計費解決了這個問題。它更好地將定價與實際使用對齊,幫助我們維持長期服務可靠性,並減少限制重度用戶的需要。

你看,不是微軟在補貼近兩百萬人的算力,而是 AI 變得如此強大、複雜,基本上成了一個不同的產品!

雖然 Copilot 可能"不是一年前的產品了",但底層經濟錯配幾乎沒變:微軟三年來一直允許用戶每月燒掉超過訂閱費的 token。根據《華爾街日報》2023 年 10 月的報道:

個人用戶每月支付 10 美元使用這個 AI 助手。根據一位知情人士透露的數據,今年前幾個月,該公司平均每個用戶每月虧損超過 20 美元,有些用戶每月讓公司花掉 80 美元。

自然,GitHub Copilot 用戶現在造反了,說產品"死了"、"徹底毀了"。

我兩年前在《次貸 AI 危機》中就預言過這一天:

那一天終於到了,因為你用的每一個 AI 服務都在補貼算力,每一個服務都因此虧錢:

當你為 AI 創業公司的服務付費時——當然包括 OpenAI 和 Anthropic——你支付的是月費,比如 Anthropic 的 Claude 每月 20、100 或 200 美元,Perplexity 每月 20 或 200 美元,或者 OpenAI 每月 8、20 或 200 美元的訂閱。在一些企業場景中,你會得到某些工作單位的"額度",比如 Lovable 在每月 25 美元的訂閱中給用戶"100 個月度額度",以及 25 美元的雲託管(到 2026 年第一季度末),額度可以跨月滾存。當你使用這些服務時,相關公司要麼按每百萬 token 的費率向 AI 實驗室付費,要麼(對於 Anthropic 和 OpenAI)向雲服務商支付租用 GPU 運行模型的費用。一個 token 基本上是 3/4 個單詞。作為用戶,你感受不到 token 消耗,只是輸入和輸出的過程。AI 實驗室用"tokens"、"消息"或帶百分比計的 5 小時速率限制來掩蓋服務成本,你作為用戶,並不真正知道這一切要花多少錢。在後端,AI 創業公司在瘋狂燒錢,直到最近 Anthropic 還允許你每花 1 美元訂閱費就燒掉高達 8 美元的算力。OpenAI 也允許你這樣做,雖然很難衡量具體多少。

AI 創業公司和雲服務巨頭以為,他們能用補貼、虧損的產品吸引足夠多的人,讓用戶上癮到當企業提價時也拒絕更換。我想他們還以為,token 成本會隨時間下降,但實際發生的是——雖然一些模型的價格可能降了,但更新的"推理"模型燒掉更多 token,這意味著推理成本不知怎麼隨時間變得更高了。

兩個假設都錯了,因為月訂閱模式對任何連接大語言模型的服務來說都說不通。

生成式 AI 的核心經濟模式已經崩潰

這樣想吧。當 Uber(不,這和 Uber 完全不一樣)開始提高打車價格時,底層經濟邏輯沒變,呈現給乘客和司機的也沒變——用戶為一次行程付費,司機因一次行程收費。司機仍然要付油費、車險、當地政府可能要求的許可證,以及車輛可能產生的融資成本,這些成本不由 Uber 補貼。Uber 的鉅額虧損來自補貼、無休止的營銷費用,以及註定失敗的無人駕駛汽車等研發努力。

生成式 AI 訂閱和 Uber 完全不同

為了說明 AI 定價錯配的規模,我要請你想象一個 Uber 有著非常不同商業模式的平行歷史。

生成式 AI 訂閱就像如果 Uber 每月收 20 美元讓你打 100 次 100 英里以內的車,汽油 150 美元一加侖,而且 Uber 付油費,因為有人堅持認為石油總有一天會便宜到不值得計量。

Uber 最終會決定開始收取用戶月費來獲得打車資格,然後按用戶消耗的汽油收費。突然間用戶從每月 20 美元打 100 次車,變成支付 20 美元獲得打車資格加上 10 英里行程 26 美元的油費。用戶自然會有點不爽。

雖然這聽起來有點誇張,但實際上是生成式 AI 行業正在發生的事情的相當準確的隱喻,尤其是在 GitHub Copilot。

GitHub Copilot 之前的定價允許每月 300 次高級請求,以及使用 GPT-5 mini 等模型的"無限聊天請求"。每個請求(引用微軟的話)是"……你要求 Copilot 為你做某事的任何交互",在基於請求的系統後期,更昂貴的模型會佔用更多請求,比如 Claude Opus 4.6 佔用三次高級請求。當你用完高級請求時,Copilot 會讓你在本月剩餘時間裡隨意使用那些更便宜的模型。

情況也並非一直如此。直到 2025 年 5 月,微軟還給用戶無限使用模型,即便如此用戶也對產品有任何限制感到憤怒。

微軟——像每家 AI 公司一樣——通過銷售不可持續的服務欺騙了客戶,因為銷售基於月訂閱的 LLM 驅動服務從來、從來都說不通。

如果你想知道基於 token 計費的服務可能要花多少錢,GitHub Copilot 子版塊的一位用戶發現,過去一次高級請求的 token 消耗大約是 11 美元,因為一次"請求"涉及在上下文窗口中使用 60,000 個 token、幾個工具,以及一堆內部"輪次"(模型在做的事情)來產生輸出。

還有容易產生幻覺的大語言模型的底層不可靠性。雖然一次高級請求陷入死循環並吐出半殘代碼可能令人沮喪,但當你自己付費時,同樣的故障就沒那麼容易原諒了。

用戶也被訓練成以一種完全不同於基於 token 計費的方式使用產品,我想很多人甚至都沒真正意識到他們燒了多少"tokens",或者某項特定任務需要多少,這會根據你使用的模型而變化。

這和 Uber 完全不同,任何告訴你相反的人都是在試圖為惡劣行為辯護。Uber 可能提高了價格,但它不必戲劇性地改變平臺的底層經濟邏輯,用戶也不必完全改變他們使用產品的方式,因為 Uber 突然開始按每加侖收費。

月度 AI 訂閱都是 AI 補貼騙局的一部分,是刻意將生成式 AI 與其實際成本分離的企圖

從來沒有——也永遠不會有——一種經濟上可行的方式來提供由 LLM 驅動的服務,除非按每個用戶實際的 token 消耗收費,而在欺騙這些用戶的過程中,這些公司創造了具有虛幻好處和可疑投資回報的產品。

這多年來一直顯而易見。

從經濟學角度看,月訂閱只有在成本相對靜態時才合理。健身房可以銷售會員資格,因為大致知道設備磨損多少、課程運營成本、以及電、員工和水在特定時期內可能花多少錢。

Google Workspace 的客戶——至少在 AI 之前——的成本是訪問或存儲文檔的費用,以及 Google Docs 和其他服務的持續成本。數字存儲成本相對較低(而且與 LLM 不同,Google Workspace 對計算需求不高),意味著一個特別重度的 Google Drive 用戶不會侵蝕他們月訂閱的利潤。

然而這些服務故意隱藏 token 數量或某項特定活動花了多少錢,這意味著用戶並不真正知道速率限制意味著什麼,這意味著速率限制的每次突然變化都讓客戶拼命想弄清楚他們能用服務做多少實際工作。

這是一種虐待性、操縱性和欺騙性的經商方式,它存在的唯一目的是讓 Anthropic、OpenAI 和其他 AI 公司能夠擴大用戶基礎,因為大多數 AI 用戶完全通過能夠每花 1 美元訂閱費就燒掉 8 到 13.5 美元的 token 這個視角來感知其真實或想象的好處。

這種故意的欺騙行為只有一個目標:確保大多數人永遠不會接觸到生成式 AI 的真實成本。當《大西洋月刊》寫一篇關於 Claude Code 是 Anthropic 的"ChatGPT 時刻"的激情檄文時,它基於的是每月 20 美元的訂閱,而不是 Anthropic 提供它所花費的底層 token 消耗,這反過來讓作者原諒模型可能犯的"小錯誤",或者當它"在更復雜的編程任務上卡住"時。

如果作者為她實際的 token 消耗付費,而且每次卡住都導致 15 美元的 token 費用,我不認為她會如此原諒這些故障。

但這都是騙局的一部分。

非常、非常重要的是,主流媒體中寫 AI 的人實際上不理解這些服務要花多少錢,而且任何關於 ChatGPT 或 Claude Code 等服務的主流文章都是由幾乎不知道每項單獨任務可能讓用戶花多少錢的人寫的。

記住:生成式 AI 服務大多是實驗性產品,功能不像任何其他現代軟件或硬件。人們不能就這樣走到 ChatGPT 或 Claude 面前開始要求它工作。

我是說,你可以,但如果你提示不對、不理解它如何工作、或者在你餵給它的東西里犯錯,或者如果它就是搞錯了,它會吐出你不喜歡的東西,這反過來意味著你需要再次提示它。LLM 本質上是不可預測的。

你無法保證 LLM 會執行某個特定動作,或者它會呈現給你一個基於現實的結果。你無法確定某項特定任務——即使是你過去用 LLM 做過很多次的——可能要花多少錢,你也無法確定模型何時可能發瘋刪掉什麼東西,或者乾脆不做某事卻聲稱它做了。

如果用戶被迫支付實際費率,我想很多人會立刻放棄產品,因為如果你瞎折騰探索 LLM 能做什麼,很容易就燒掉 5 美元的 token。

旁註:事實上,你可以在從未得到你想要的結果的情況下燒掉大量錢,因為 LLM 根本不是真正的人工智能!沒有任何真正理解其侷限性的人可以輕易燒掉 30、50 甚至 100 美元,試圖說服 LLM 做它堅稱自己能做的事。有個術語形容這個。諂媚。LLM 通常被設計為肯定用戶,即使他們在說危險的瘋話,這可以延伸到說"你想要這個技術上或經濟上完全不可行的大事?"當然可以!這就是為什麼行業如此努力地掩蓋這些成本——這就是他媽的敲竹槓!

我認為大多數 AI 訂閱轉向基於 token 的計費是不可避免的,尤其是 Anthropic 和 OpenAI 現在都已經對企業客戶這樣做了。

普通公司能負擔得起轉向基於 Token 計費嗎?Anthropic 估計用戶每天在 Claude Code 上花 13-30 美元(每年 7000 多美元),大型組織每年花費數十萬或數百萬美元

正如我上週討論的,Uber 的 CTO 在一個會議上說它在幾個月內就花完了 2026 年的整個 AI 預算,高盛建議一些公司在 AI token 上花費高達員工薪酬的 10%,有可能在未來幾個季度增加到 100%。

這是訓練每一個 AI 用戶儘可能多地使用這些服務同時掩蓋其真實成本的直接結果。每一家要求每一個員工"儘可能多地使用 AI"的大公司都是在基本上忽略或完全脫離其實際 token 消耗的情況下這樣做的,而隨著公司被迫支付實際成本,我不確定你如何能在經濟上證明對這項技術的任何投資是合理的。

當然,你會說工程師"更快地交付代碼"之類的廢話,我懂。但到底快了多少?你因此賺了或省了多少錢?如果你把 10%的人力成本花在 AI token 上,這筆額外開支有沒有從其他地方補回來?我不確定有。我不確定任何在 token 上投入巨資的企業看到了投資回報,這也是為什麼每項關於 AI 投資回報率的研究都找不到多少存在證據。

大多數情況下,你讀到的那些對生成式 AI 各種可能性津津樂道的人,都是在不用承擔真實成本的情況下體驗它的。每個在 Twitter 上沒完沒了寫他們整個工程團隊瘋狂使用 Claude Code 的瘋子,用的都是每人每月 125 美元的 Teams 訂閱,使用限制和 Anthropic 面向消費者的 100 美元月費訂閱差不多。每個在 LinkedIn 上堅稱自己用某個 Perplexity 產品"幾分鐘完成數小時工作"的怪物,最多也就是每月花 200 美元買 Perplexity 的 Max 訂閱。

實際上,那個 10 人、每月 1250 美元的 Teams 訂閱,很可能每月要燒掉 5000 到 10000 美元的 API 調用費用,甚至更多。Anthropic 增長主管 Amol Avasare 上週說,他們的 Max 訂閱是為重度聊天使用設計的,而不是人們用 Claude Code 和 Cowork 做的那些事,並明確表示 Anthropic 現在在考慮"不同的選項來繼續提供優質體驗",換句話說就是"我們會在某個時候調整價格"。

我不確定人們是否意識到這些 token 有多貴,特別是涉及大型代碼庫並頻繁調用編碼和基礎設施工具的編程項目。一個每月花 200 美元的人能負擔得起 350、400 或 500 美元嗎?他們能承受某個月花費超過這個數字嗎?如果預算超支了怎麼辦?或者他們真的負擔不起完成工作所需的費用怎麼辦?

給你一個更實際的例子,直到 4 月初,Anthropic 自己的 Claude Code 開發者文檔(存檔)還寫著"[使用 Claude Code 的用戶]平均成本是每個開發者每天 6 美元,90%的用戶每日成本保持在 12 美元以下。"截至本週,文檔現在這樣寫:

Claude Code 按 API token 消費收費。訂閱計劃定價(Pro、Max、Team、Enterprise)請見 claude.com/pricing。每個開發者的成本因模型選擇、代碼庫大小和使用模式(如運行多個實例或自動化)而差異很大。在企業部署中,平均成本約為每個開發者每個活躍日 13 美元,每月 150-250 美元,90%用戶的成本保持在每個活躍日 30 美元以下。要估算你團隊的開支,從小型試點組開始,使用下面的跟蹤工具建立基準,然後再推廣。

如果我們假設一個月平均有 21 個工作日,Claude Code 用戶的平均成本約為每月 273 美元,或每年 3276 美元。按每個工作日 30 美元算,就是每月 630 美元,或每年 7560 美元。

這些數字驚人,更驚人的是,如果你使用 Anthropic 任何較新的模型,你不可能只花每天 30 美元。Claude Opus 4.7 的費用是每百萬輸入 token 5 美元,每百萬輸出 token 25 美元。一百萬 token 約等於 5 萬行代碼,假設你使用所謂的最先進模型,你肯定至少會跑完一百萬 token,如果你不太清楚該用哪個模型做特定任務,這個數字會急劇上升。

讓我們再玩玩這個 30 美元的數字。

對於 10 人開發團隊,一年就是 75600 美元,而且我們只算工作日。

如果你有三個月提高到平均每個工作日 50 美元,就漲到 88200 美元

如果你加一個月超過 100 美元,一年就要花 102900 美元。

如果你每天花 300 美元,10 個人一年就要花 756000 美元。

雖然這在資金充足的創業公司或 Meta 這樣的香蕉共和國的備用金思維裡可能可行,但任何真正在意成本的企業都很難證明在一項"提高生產力"的服務上額外花費五位數或六位數是合理的,而這種提高似乎沒人能衡量。

現在,我認為大多數公司分為三類:

Spotify 或 Uber 這樣大型組織裡的企業部署,有痴迷 AI 的 CEO,允許預算不受控制。我也會說資金充足的大型創業公司也是這種情況。

我也會說資金充足的大型創業公司也是這種情況。

使用補貼的"Teams"訂閱的小型創業公司。

付月費訪問 Claude 或其他 AI 訂閱的個人用戶。

大型組織仍然可以說他們在為軟件工程師燒掉數百萬美元的 AI token,理由是"最優秀的工程師"不寫任何代碼這一可疑好處。

只需要一次糟糕的財報電話會議就能改變這種敘事。在某個時刻,投資者——即使是那些一直在吹大 AI 泡沫的腦殘蠢貨——也會開始質疑不斷攀升的研發成本(AI token 消耗通常隱藏在這裡),當公司的收入增長跟不上時。這很可能導致更多裁員來控制成本,就像 Meta 那樣,然後在有人問"這些東西真的幫我們更快更好地完成工作了嗎?"時最終收縮。

我還認為,在六個月內,那些在 AI token 上燒掉 10%或更多人力成本的創業公司,很難說服投資者這樣做是必要的。

一旦所有人都切換到基於 token 的計費,我不確定我們還會看到那麼多關於生成式 AI 的炒作。

AI 數據中心和算力的經濟學不合理

人們談論 AI 數據中心的方式完全脫離現實,我認為人們沒有意識到整個時代變得多麼荒謬。

AI 數據中心建設成本高、運營成本高,實際收入卻很少

根據 TD Cowen 的 Jerome Darling,關鍵 IT(GPU 和相關硬件)成本約為 3000 萬美元,每兆瓦數據中心容量成本 1400 萬美元。數據中心似乎需要一到三年不等的時間,這還是假設有電力供應的情況下。

到 2028 年底據稱要建成的 114GW 數據中心中,只有 15.2GW 在以任何方式、形態或形式施工。而"施工中"可能只意味著"地上有個坑"。它不意味著——也不應該意味著——該設施將提供的容量會很快可用。

讓我們從簡單開始:每當你想到"100MW",就想"44 億美元",其中很大一部分用於 NVIDIA GPU。

因此,每個 AI 數據中心一開始就虧損數百萬美元,即使採用六年折舊計劃,也要多年才能還清……而且隨著 NVIDIA 的年度升級週期,一旦你完成第一個客戶合同,那些 GPU 不太可能賺那麼多錢。

還不清楚 AI 算力的客戶群是否存在於 OpenAI 和 Anthropic 之外,這兩家的需求佔在建 AI 數據中心的 50%,如果他們中任何一家沒錢付款,就會造成巨大的系統性弱點。

無論如何,也不清楚這些數據中心收取什麼樣的持續費率。雖然現貨價格可能在每小時 4.50 美元左右/B200 GPU,但長期合同價格通常低得多,一位創始人(據 The Information)說他們為一年期承諾支付約每 GPU 每小時 3.70 美元。

需要明確的是,我們必須區分現貨成本——在別人服務器上隨機啟動 GPU 的成本——和合約算力,後者佔數據中心資本支出的大部分。大多數數據中心建設時打算有一兩個大客戶,這意味著這些客戶可能談判到更便宜的混合費率。

因此,許多數據中心的收費遠低於每小時 3.70 美元,因為他們按每兆瓦(或千瓦)價格計費。

這就是經濟學開始崩潰的地方。

100MW 數據中心的崩潰經濟學——每小時 2.55 美元,100%入駐率下毛利率 16%,因債務而無利可圖

這是 100 兆瓦數據中心的起始成本。一個 100MW 的數據中心可能只有 85MW 的實際可計費容量,根據與熟悉超大規模計費的消息源討論,他們預計每兆瓦收入約 1250 萬美元,或年收入約 10.63 億美元。

現在,我應該明確,你知道的大多數數據中心公司實際上並不建造它們,而是把這項工作留給 Applied Digital 這樣的公司,它們也被稱為"託管合作伙伴"。例如,CoreWeave 向 Applied Digital 支付託管費用以使用其北達科他州的數據中心。CoreWeave 負責數據中心內的所有 GPU 和其他技術。

為了解釋經濟不匹配,我將使用一個理論示例,一個租給理論 AI 算力公司的數據中心。

該數據中心的 GPU 很可能是 NVIDIA 的 Blackwell 芯片。更有可能的是,該數據中心使用 8 個 B200 GPU 的 pod,零售價約 45 萬美元一個,或每個 GPU 56250 美元。基於 85MW 的關鍵 IT 負載,每兆瓦的全部資本支出約為 36.78,或總 IT 資本支出約 31.26 億美元,或約 26.7 億美元的 GPU。

假設這個數據中心在北達科他州 Ellendale,這意味著工業電價約為每千瓦時 6.31 美分,每年電費約 5540 萬美元。根據與消息源的討論,我估計維護、人員、電源更換等持續成本約佔收入的 12%,或每年約 1.28 億美元,使我們達到 1.834 億美元的成本。

等等,抱歉。你還得根據關鍵 IT 支付託管費,根據 Brightlio,該費用通常約為每千瓦每月 180-200 美元,取決於部署的規模和位置,雖然我讀到過低至 130 美元,這是我採用的數字,或每年約 1.33 億美元。這使我們達到 3.164 億美元。

嗯,這仍然少於 10.6 億美元,所以我們還好,對吧?

錯!你有 31.26 億美元的 IT 設備要折舊,六年折舊下來每年約 5.21 億美元。那就是每年 8.374 億美元,給你留下約 1.686 億美元的年利潤,或約 16.7%的毛利率……

……如果你一直保持 100%的入駐率!你看,數據中心可能需要一兩個月來安裝這些 GPU 並讓客戶入駐,在此期間你的收入為零,損失卻大得多,因為你一直在支付託管、電力和運營成本,儘管費率低得多(我為 10%的電力和 15%的託管/運營成本建模),這意味著你每天損失約 327 萬美元。

為了這個例子,我們假設你需要額外一個月才能讓這東西運行起來,這意味著你已經支付了約 1.02 億美元,再也拿不回來了,使我們包括折舊在內的年度總成本達到 9.394 億美元,或 6.6%的毛利率。

等等,該死,你沒用債務買這些 GPU 吧?你用了?有多糟?哦天哪——你得到了一筆六年期的資產支持貸款,貸款價值比為 80%,意味著你以 6%的利率借了 28 億美元。

你的銀行出於永恆的慷慨,給了你一筆交易——12 個月的寬限期,你只付利息……約 1.68 億美元,這使我們第一年的總成本(為公平起見不包括延遲的一個月)達到約 10.05 億美元……收入 10.6 億美元。

那是 5.19%的毛利率,而你甚至還沒開始還本金。當那發生時,你每月要還 5410 萬美元的貸款,接下來五年總計每年約 6.49 億美元,約 14.8 億美元,或約負 40%的毛利率。

我必須明確,這是如果你有 100%的利用率,而且租戶每次都按時付款。

Stargate Abilene 是場災難——每 GPU 每小時 2.94 美元,年收入 100 億美元,進度落後數年,只有一個每年虧損數十億美元的租戶

讓我們談談應該是數據中心歷史上最具經濟可行性的單一項目——一個由 Oracle 為世界上最大的 AI 公司建造的大型園區,Oracle 是一個擁有數十年曆史的近超大規模企業,有向企業和政府銷售昂貴數據庫和業務管理軟件的歷史。

哈,我當然是在開玩笑,這地方就是個該死的噩夢。

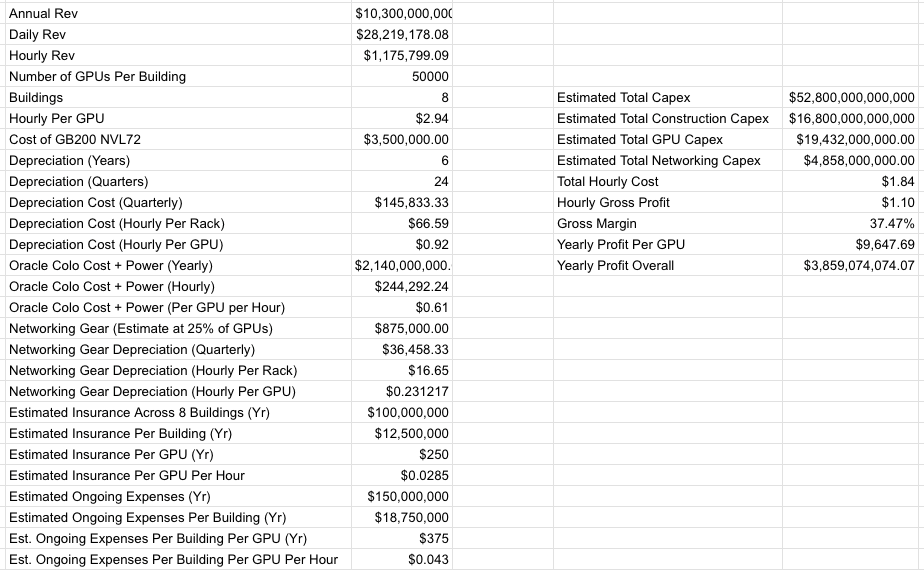

Stargate Abilene,一個八棟建築、1.2GW 的數據中心園區,約 824MW 的關鍵 IT,首次宣佈於 2024 年 7 月。截至 2026 年 4 月 27 日,只有兩棟建築運營併產生收入,第三棟幾乎沒有任何 IT 設備。我估計 Stargate Abilene 的總成本約為 528 億美元。

根據我自己的報道,Oracle 預計從 Stargate Abilene 獲得約 100 億美元的年收入,我估計從它為一個客戶建造的 7.1GW 數據中心容量中獲得約 750 億美元的總收入:OpenAI。正如我還報道的,Oracle 在 2024 年估計 Abilene 每年至少要支付 21.4 億美元的託管和電費,支付給土地開發商 Crusoe。

我還應該補充,看起來 Oracle 正在支付 Abilene 的所有建設成本。

根據我的計算和報道,我估計 Abilene 一旦全面運營,粗略毛利率約為 37.47%:

我必須明確,37.47%的毛利率可能太高了,因為我不知道 Oracle 真實的保險或人員成本的準確數字,只有基於本刊查看的文檔的估計。我還應該明確,Oracle 正在把整個該死的未來押在像 Stargate Abilene 這樣的項目上,預先產生數十億美元的成本,這項業務即使 OpenAI 及時支付每一筆款項,也需要多年才能盈利。

遺憾的是,我無法確定 Abilene 有多少是靠債務支付的。我只知道 Oracle 在 2025 年 9 月通過發行不同規模的債券籌集了約 180 億美元,期限從 7 年到 40 年不等,而且在最近一個季度的財報中出現了 247 億美元的負現金流。

我確實知道的是,Oracle 與開發商 Crusoe 簽訂了一份為期 15 年的租約,而且 Oracle 的未來嚴重依賴 OpenAI 持續付款的能力,而這又取決於 Oracle 能否完成 Stargate Abilene 項目。

我還需要明確,每年 38.5 億美元的利潤只有在 OpenAI 按時付款、以最快速度入駐 Abilene 且一切按計劃進行的情況下才可能實現。

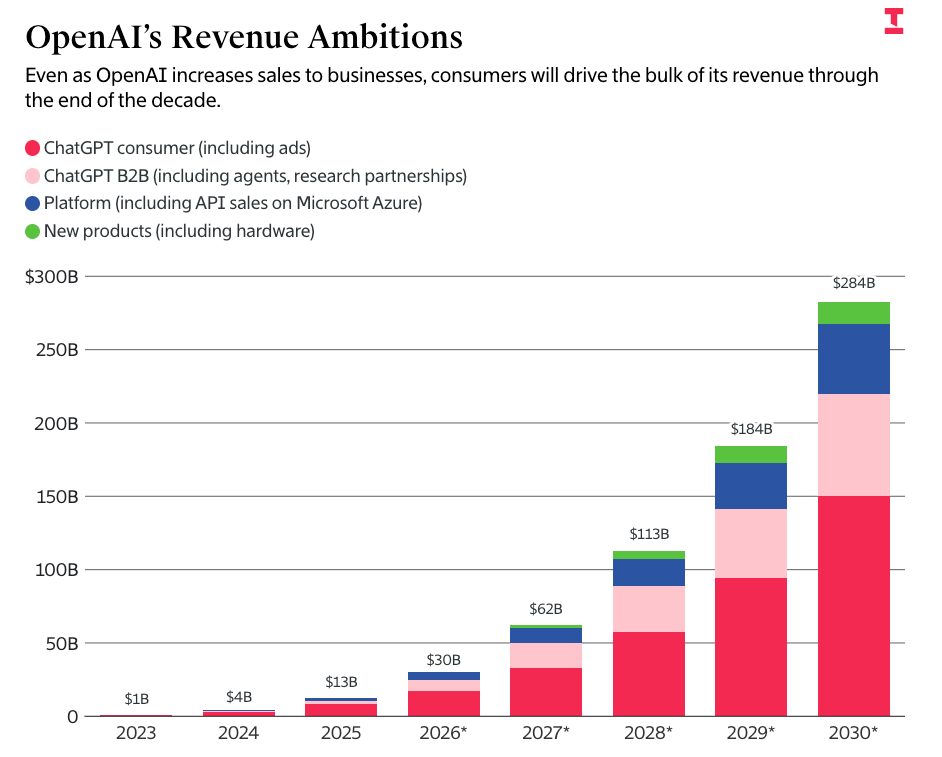

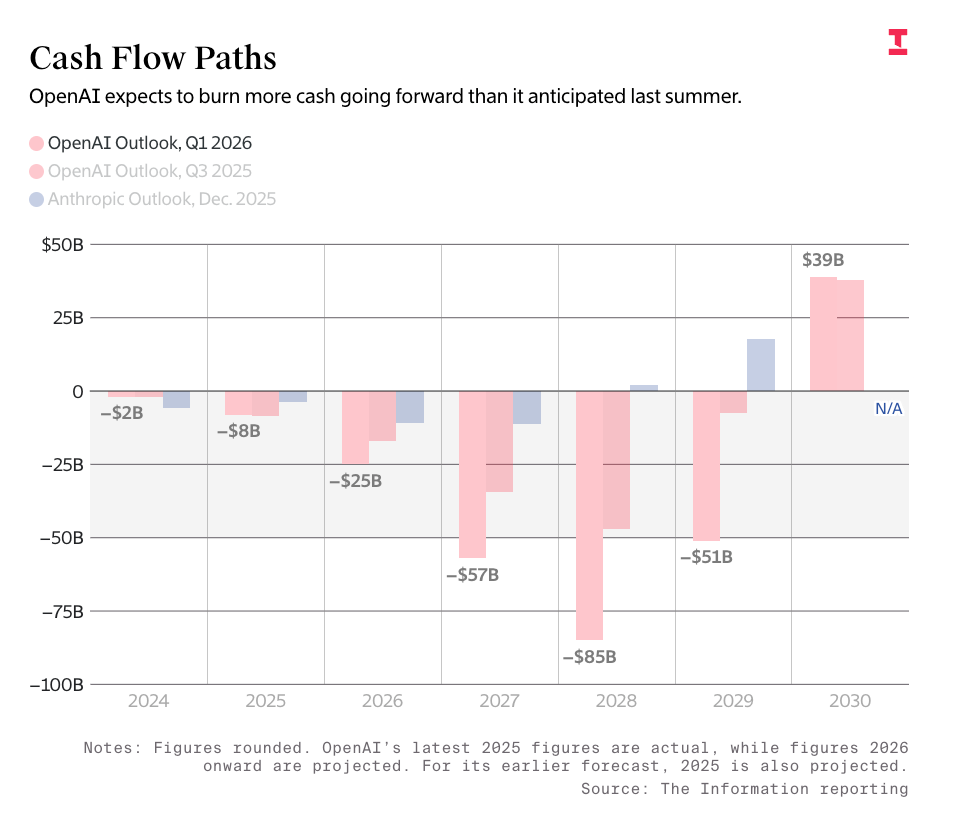

如果 OpenAI 無法在未來 4 年內籌集 8520 億美元的收入、融資和債務,Stargate 數據中心項目將拖垮 Oracle

遺憾的是,完全相反的情況發生了:

根據 DatacenterDynamics 的報道,首批 200MW 的電力本應在"2025 年"投入使用。隨著時間推移,入駐本應在 2025 年上半年開始,"有潛力在 2025 年達到 1GW",在 2026 年中期完成全部 1.2GW 容量,在 2026 年中期通電,在 2026 年底前部署 64,000 個 GPU。截至 2025 年 9 月 30 日,"兩棟建築已上線"。截至 2025 年 12 月 12 日,Oracle 聯席 CEO Clay Magouyurk 表示 Abilene"按計劃推進","已交付超過 96,000 個 NVIDIA Grace Blackwell GB200",也就是兩棟建築的 GPU 數量。四個月後的 2026 年 4 月 22 日,Oracle 在推特上表示"……在 Abilene,200MW 已經投入運營,八棟建築園區的交付仍按計劃進行。"目前不清楚這是 200MW 的關鍵 IT 容量還是 Abilene 園區的總可用電力。無論如何,這隻夠支持兩棟建築,這意味著 Oracle 絕對不是"按計劃推進"。

這是一個巨大的問題。OpenAI 只能為實際存在的算力付費,而只有 206MW 的關鍵 IT 容量真正產生收入,第三棟建築至少還需要一個月(如果不是一個季度的話)才能投入使用。

然而,整個 Stargate 數據中心項目還有一個更大、更根本的問題——只有在 OpenAI 實現其荒謬的、卡通般的預測時,這一切才有意義。

正如我在週五討論的:

我再重複一遍這些數字:正在建設的 7.1GW Stargate 數據中心完工後將產生約 750 億美元的年收入,總成本超過 3400 億美元。Oracle 的自由現金流為負 247 億美元,其他業務線正在停滯,這使得其負利潤到低利潤的雲業務成為唯一的增長引擎。為了真正能夠支付其算力合同——包括與亞馬遜、微軟、CoreWeave、谷歌、Cerberas 以及 Oracle 的合同——OpenAI 必須在四年內籌集或賺取 8520 億美元的收入和/或融資,這需要其業務每年增長超過 250%,到 2030 年底實際增長 10 倍,屆時它必須找到一種方式實現現金流為正,這些數字才有意義。明確一點,OpenAI 的預測是在未來四年內賺取 6730 億美元,併為此燒掉 2180 億美元。這是一項極其無利可圖的業務,即使它能盈利,也必須賺取比現在多得多的錢才能持續向 Oracle 付款。

我計算出 750 億美元這個數字,是假設 Vera Rubin GPU 在剩餘的 4.64GW 關鍵 IT 容量上每兆瓦算力獲得約 1400 萬美元(這個數字我已經與熟悉數據中心行業的消息源確認過),這是我預計構成剩餘 Stargate 數據中心的容量。

OpenAI 的數字直接來自 The Information 報道的 OpenAI 預測燒錢率和收入的洩露信息,該公司預計到 2030 年底將產生 6730 億美元的收入,併為此燒掉 8520 億美元:

我必須明確,任何記者重複這些數字而不指出它們有多愚蠢的人都應該感到有點羞愧。根據我週五的付費內容:

換句話說,OpenAI 預測兩年後的收入將超過臺積電,三年後的年收入幾乎與 Meta 相當,到 2030 年底的年收入將與微軟相當(過去 12 個月約 3000 億美元)。

如果 OpenAI 無法為這些算力付費,Oracle 就會倒閉,因為它僅為建設 Stargate 的數據中心就承擔了約 1150 億美元的債務,還需要另外 1500 億美元來完成它們:

Oracle 是一家目前年收入約 640 億美元的公司,上個季度的自由現金流為負 247 億美元。它在 2025 年 9 月發行了 180 億美元的債券,在 2026 年 2 月發行了 250 億美元的債券,在 3 月的某個時候進行了 200 億美元的市場配售,儘管被稱為"已完成"數月,但似乎只是最近才完成了 380 億美元的 Stargate 威斯康星州和 Shackelford 項目融資。我還將與 Stargate 密歇根州相關的 140 億美元數據中心債務包括在內。無論如何,Oracle 資本不足以完成 Stargate Abilene。它至少還需要 1500 億美元才能完成這項工作,這還是假設其他合作伙伴承擔約 300 億美元成本的情況下。老實說,可能還要更多。

我真的需要明確,Oracle 沒有其他途徑在沒有 OpenAI 的情況下實現這筆收入,而且這些項目完全是使用數據中心本身的預計現金流來融資和支付的。

我甚至不是唯一擔心這一點的人,OpenAI 的 Sarah Friar 在公司未能達到用戶和收入目標後也表達了類似的擔憂,據《華爾街日報》報道:

OpenAI 最近未能達到其新用戶和收入目標,這些挫折讓一些公司領導層擔心它是否能夠支持其在數據中心上的大規模支出。首席財務官 Sarah Friar 告訴其他公司領導層,她擔心如果收入增長不夠快,公司可能無法支付未來的計算合同,據知情人士透露。董事會成員最近幾個月也更仔細地審查了公司的數據中心交易,並質疑首席執行官 Sam Altman 在業務放緩的情況下仍努力獲取更多算力的做法,知情人士說。

如果這還不讓你擔心,或許這會:

她向高管和董事會成員強調了 OpenAI 需要改善其內部控制,警告公司尚未準備好滿足上市公司所需的嚴格報告標準。一些知情人士說,Altman 傾向於更激進的 IPO 時間表。

這聽起來確實像一家能夠在十年末賺取 8520 億美元的公司!

Anthropic 和 OpenAI 一樣糟糕,承諾從谷歌和亞馬遜獲取多達 10GW(年收入超過 1000 億美元)的算力

雖然我經常批評 OpenAI 的荒謬承諾,但 Anthropic 也不遑多讓,承諾從谷歌和亞馬遜各獲取"多達"5GW 的容量,根據容量規模,我估計這筆交易包括約 1000 億美元的實際算力承諾。

現在,我應該補充的是,谷歌和亞馬遜比 Oracle 更精明、更不絕望,這意味著如果 Anthropic 最終資金耗盡,它們可以承受這一打擊。交易中的"多達"部分給了它們一些 Oracle 根本沒有的急需的迴旋餘地。

儘管如此,要真正履行其承諾,Anthropic 到 2030 年底每年必須同意在算力上花費 250 億到 1000 億美元。

Anthropic 的首席財務官在 3 月表示,該公司在整個存續期間創造了 50 億美元的收入。

需要 1568 億美元的 AI 年度算力收入來支持正在建設的 15.2GW AI 數據中心,需要 1.18 萬億美元來支持所有宣佈的 114GW

圍繞 Jensen Huang 聲稱定期出貨的數千億美元 GPU 的近乎色情的興奮,掩蓋了一個有問題的疑問:賣給誰,Jensen?

如果我們假設正在建設的 15.2GW 數據中心容量(預計 2028 年底前完工)的 PUE 約為 1.35,那麼我們就有大約 11.2GW 的關鍵 IT 容量。按每兆瓦 1400 萬美元計算,要使這些數據中心物有所值,大約需要 1568 億美元的年度 GPU 租賃收入。

當你計算到 2028 年底理論上上線的 114GW 容量時,這個數字攀升至 1.18 萬億美元的年收入。

為了給你一些背景,CoreWeave——擁有 Meta、OpenAI、谷歌(為 OpenAI)、微軟(為 OpenAI)、Anthropic 和 NVIDIA 作為客戶的最大新雲服務商——創造了約 51 億美元的收入,並預計 2026 年將創造 120 億到 130 億美元。

究竟誰是所有這些算力的客戶,當所有容量建成時,他們購買的可能性有多大?雖然許多不同的數據中心聲稱其存在的前幾年有租戶,但這些租戶只能在數據中心完工後才開始付費,如果是 AI 初創公司,我認為合理的問題是:當它建成時,它們是否還存在。

記住:AI 算力的客戶主要是試圖將資本支出移出資產負債表的超大規模雲服務商或無利可圖的 AI 初創公司。Anthropic 和 OpenAI 都打算在未來幾年燒掉數百億美元,而且它們都沒有盈利途徑。

這意味著 AI 算力收入的很大一部分——如果不是大部分——依賴於持續的風險投資和債務流入,而這兩者只有在投資者仍然相信生成式 AI 將是世界上最大、最巨大的事物時才可能實現。

這究竟如何運作?誰在為這些數據中心容量付費?這是為誰準備的?實際需求在哪裡?

如果這種需求存在,客戶他媽的怎麼付款?

生成式 AI 無利可圖且不可持續,而且只會越來越貴

儘管有多個故事說它們將在 2028 年或 2029 年實現盈利,但沒有人能向我解釋 OpenAI 或 Anthropic 實際上如何實現盈利,特別是考慮到它們的利潤率都比預期更差,即使這些利潤率剔除了數十億美元的訓練成本。

我他媽的提這個問題已經好幾年了。每次我們得到關於 Anthropic 或 OpenAI 的新更新時,我們都會聽說它們又比預期多損失了數十億美元,利潤率正在下降,成本正在飆升,儘管承諾會發生完全相反的情況,但一切都更貴了。

即使是 Cursor,一家曾短暫(在被馬斯克的 SpaceX 偽收購之前)聲稱擁有正毛利率的公司,截至 1 月實際上有負 23%的毛利率,如果你包括非付費用戶的成本,則為負 31%,如果你真的關心你的會計,你他媽的應該包括這些。神秘的是,報道聲稱 Cursor 的利潤率"最近轉為正數",但神奇地不知道有多少,或者這是如何發生的,或者除了一個可能幫助公司被出售的細節之外的任何其他細節。

我也不明白這些 AI 數據中心如何真正有意義,即使它們在前幾年有客戶付費。經濟學是為完美而構建的,容錯率為零。它們必須有一致的 100%利用率和入駐率,否則它們最終會燒掉數百萬美元,並且無法削減由科技行業最昂貴錯誤造成的長達數年的折舊牆。

即使它們以某種方式成功,這些也是利潤率平庸的可憐生意——最多 70%,假設持續付款、入駐和六年他媽的折舊才能真正實現收支平衡,考慮到年度升級週期使整個事情在你完成支付時幾乎過時,這可能很困難。

而這還沒有考慮到大多數客戶都是無利可圖、不可持續的初創公司。

我真的不知道這一切如何解決。

LLM 是一場騙局,客戶被欺騙了

我意識到這似乎有點過分,但我真誠地相信,基於訂閱的 AI 服務是一種相當於欺詐的欺騙行為,因為它們歪曲了核心單位經濟學,從而歪曲了大型語言模型的可能性。通過以月費率向用戶出售產品並基於其可用性創建習慣,Anthropic 和 OpenAI 等公司以這樣的方式歪曲了它們的業務,以至於它們的大多數用戶正在與產品互動,並基於在當前形式下不可持續且無法維護的產品構建工作流程。

我需要非常明確,Anthropic 提供的產品——由於最近的速率限制變化——與你到處讀到的產品有很大不同(而且差得多)。Anthropic 有意識地故意營銷一個它知道會在三個月內消失的產品。Dario Amodei 不在乎,只要媒體繼續報道他今天編造的數十億年化收入或他發佈的任何旨在摧毀某家已經看到增長放緩的倒黴公共 SaaS 公司的新產品。

媒體成員,我懷著充分的尊重說這句話:Anthropic 正在虐待其客戶,它這樣做是因為它相信它可以逃脫懲罰。這家公司不尊重你,事實上對你持有相當程度的蔑視,這就是為什麼它不費心快速修復其服務或以任何連貫的方式解釋它們為什麼損壞。

這就是為什麼 Anthropic 他媽的謊稱 Claude Mythos 太強大而無法發佈(實際上是容量問題),而實際上它只是另一個他媽的大型語言模型空頭支票——因為它認為你會購買它出售的任何東西,而且它已經準確地弄清楚瞭如何包裝它,給你足夠合理的"證據",快速瀏覽系統卡將讓你和你的編輯相信你所說的任何內容。

他們也知道你會急於報道它,而不是等待看看實際專家怎麼說。

AI 就是一場騙局,騙局的運作方式如下。AI 被以最快速度推到我們面前,以效率最低但最易接觸的形式呈現,即便這種形式永遠不可能產生任何可持續的商業模式。媒體被催促著立刻宣稱"這就是未來",讓所有人都認同這是當下的大事,儘可能多地使用它。更關鍵的是,以訂閱制的形式讓人們體驗它,這樣人們永遠不會問提供服務的成本是多少。

敘事早已被打包好了。因為很少有討論大語言模型的人真正瞭解其實際成本,他們很容易含糊地說"這就像 Uber 一樣",因為那是一家虧了很多錢但沒倒閉的公司。這樣說比說"等等,你是說 OpenAI 今年將虧損 50 億美元?"要容易得多。

這樣想:作為記者、投資者、高管或普通的 LinkedIn 發言者,你可能零零散散讀到過每百萬輸入 tokens 5 美元、每百萬輸出 tokens 25 美元的數字,但你從未真正體驗過虧錢的速度,而這對真正理解這個產品至關重要。Anthropic 和 OpenAI 故意混淆了這種體驗,創建了預計在 2026 年燒掉數百億美元、到 2030 年燒掉數千億美元的業務,這一切都因為大多數人基於訂閱體驗來評判生成式 AI。

大語言模型是賭場,你一直在用莊家的錢賭博,同時鼓勵人們押注自己的錢,賭能否從特定模型中獲得一單位的工作成果。

這是故意的。他們從不想讓你思考成本,因為一旦你真正開始思考成本,整件事就顯得有點瘋狂。我真誠相信基於大語言模型的訂閱服務將完全消失,至少在任何生成代碼的產品規模上是這樣。在此過程中,Amodei 和 Altman 將收尾他們的騙局,或者至少他們自己這麼認為。

問題是這些人現在簽了太多協議,無法全身而退。

OpenAI 的 CFO 現在已多次表示,她不認為 OpenAI 已為 IPO 做好準備,並對其增長和持續履約能力有重大擔憂。重複之前的引述:

據知情人士透露,首席財務官 Sarah Friar 曾告訴其他公司領導層,她擔心如果收入增長不夠快,公司可能無法支付未來的計算合同費用。

這是一個閃爍的紅色警報,在一個理性的市場中會讓 Oracle 的股價陷入螺旋式下跌,因為 OpenAI 攀升至年收入超 2800 億美元對 Oracle 不耗盡資金至關重要。在理性的媒體環境中,這會在每個群聊和 Slack 頻道引發擔憂浪潮,質疑 OpenAI 是否真能撐下去。

這是公司開始走向衰亡前發生的事。OpenAI 的增長恰恰在需要加速時放緩了。它需要在 2030 年前將當前業務規模擴大 10 倍才能履行義務。OpenAI 的 CFO——最清楚情況的人——正在說她擔心如果收入不增長,OpenAI 連算力合同都付不起。這是一個巨大的、閃爍的警示燈!這不是演習!

但真正讓我擔心的是《華爾街日報》評論說,Friar 認為 OpenAI"尚未準備好滿足上市公司所需的嚴格報告標準"。

這他媽是什麼意思?抱歉?這家公司據稱已融資 1220 億美元,據稱價值 8520 億美元,預計到 2030 年底將燒掉 8520 億美元。它的賬目不清楚嗎?OpenAI 無法滿足什麼"嚴格報告標準"?

如果不是因為這家公司去年佔了所有風險投資資金的約 20%,而且我走到哪都得聽 Altman、Brockman 和 OpenAI 其他人對普通人應該做什麼的無休止空談,同時他們優雅地發佈垃圾軟件、花別人的錢,我一般不會這麼刨根問底。

鑑於 Anthropic 和 OpenAI 消耗的關注度,這兩家公司作為產品和業務都應該完美無缺。但兩者都通過不同程度的經濟和效能欺騙來銷售,混淆真相,好讓他們的 CEO 能積累金錢、權力和關注。這是對優質軟件和品味的侮辱——史上最昂貴、最不可靠的應用,它們的錯誤被原諒,平庸被慶祝,基礎設施被譽為資本的惰性之神。

生成式 AI 是一種侮辱。它不可靠,經濟賬算不過來,產出無法證明其存在的正當性,而騙局的實施者是無聊、笨拙、貪婪的人,與社會和任何可能反對他們的人脫節。它需要竊取所有人的藝術,破壞環境,提高我們的電費,持續威脅經濟毀滅,無休止地喧嚷"一切都因為 AI 變糟了",這一切只是為了推廣只有願意忽視基本財務或常識的人才能為其辯護的軟件。

這一切都太昂貴,而且太他媽無聊了。它無聊得令人生厭。它讓人主動感到煩躁。每個告訴你自己多麼頻繁使用 AI 的故事聽起來都像是他們陷入了虐待關係和/或加入了邪教,迴盪著微妙的絕望,彷彿在說"你真的需要和我一起做這件事,因為它太好了,而我似乎從這個產品中得不到任何快樂,這只是它有多高效的標誌。"AI 能做的事情沒有任何輕鬆或快樂的成分。大語言模型沒有任何古怪或異想天開之處,每次互動都感覺空洞。

那些拼命尋找它正變得有意識或"更強大"的線索的人,只是在尋求自我驗證——他們想成為第一個發現某事的人,因為得出別人的結論就是他們謀生的方式。

成為"第一個"——可以說在"前沿"——是人們在內心找不到東西時渴望的,這正是騙子渴望的燃料,因為大語言模型不斷嗡嗡作響,給人一種即將做出新事物的感覺,儘管它們在數學上被限制為重複其他行動。

這是一個深深悲哀的時代。那些如此積極地共同努力支撐這個行業的人,只是推遲了它不可避免的衰落。讓我感到恐懼的是,我們的市場和部分經濟被普遍持有但完全未經證實的假設所支撐,即大語言模型會以某種方式變得更便宜,AI 初創公司會神奇地變得盈利,提供 AI 算力將永久盈利,以至於需要在 2030 年前將當前供應增加十倍。

人們為了捍衛 AI 行業而貶低自己,因為這就是該行業對其信徒的要求。要成為"AI 專家"需要你主動忽視歷史上任何行業最糟糕的經濟狀況,不斷為產品明顯而刺眼的問題辯解,並積極說服其他人也這樣做。OpenAI 和 Anthropic 不提供如何盈利的清晰解釋,因為他們知道支持者永遠不會要求——因為完全"相信 AI"的唯一方法就是主動戴上眼罩。

我理解。如果你承認 OpenAI 和/或 Anthropic 最終會崩潰,這一切似乎有點瘋狂。我真誠地請求你認真考慮這兩家公司中的一家或兩家會耗盡資金。

我真的很擔心,而且媒體和更廣泛社會普遍缺乏關注讓我更加擔心。

如果我必須想象,假設是我只是危言聳聽,"需求絕對會在那裡。"

你最好希望自己是對的。

至少為了 Larry Ellison 著想。Ellison 已經質押了 3.46 億股 Oracle 股票——約 615 億美元——"以擔保某些個人債務,包括各種信用額度",意味著"許多大額、漂亮的以 Oracle 股票為抵押的貸款。"IFR 在 9 月份(當時 Oracle 股價高得多)估計,這可能讓他以(他們說的"保守的")20%貸款價值比獲得多達 214 億美元的債務,這還是假設銀行不是特別慷慨。

如果 OpenAI 在 2030 年底前無法籌集到 8520 億美元的收入和資金,它將無法支付 Stargate 的費用。這將扼殺 Oracle 股票的價值,導致一系列追加保證金通知,導致 Ellison 不得不出售股票,導致進一步的追加保證金通知。無論存在什麼救助,都救不了 Larry 的資產。

我要說的是,Ellison 的未來取決於 Sam Altman 在 4 年內籌集資金並創造 8520 億美元收入的能力。

祝你好運,Larry!你會需要的。

歡迎加入深潮 TechFlow 官方社群

Telegram 訂閱群:https://t.me/TechFlowDaily

Twitter 官方帳號:https://x.com/TechFlowPost

Twitter 英文帳號:https://x.com/BlockFlow_News