GitHub 코파일럿의 요금제 변경은 AI 산업에서 가장 큰 거짓말을 드러냈다

저자: 에드 지트론

번역: TechFlow

TechFlow 독자 안내: 마이크로소프트가 결국 버티지 못했다. GitHub Copilot이 월정액제에서 토큰 기반 과금제로 전환된다. 이는 제품 업그레이드가 아니다. 오히려 전체 AI 산업의 보조금 사기극이 집단적으로 파산한 증거다—OpenAI와 Anthropic 등은 월정액제를 이용해 실제 비용을 은폐하고, 사용자가 1달러를 쓸 때마다 8~13달러 상당의 컴퓨팅 파워를 태우게 만들었다. 그 결과, 한 세대에 걸쳐 지속 불가능한 사용 습관이 형성된 것이다. 가격이 현실로 돌아오면, 당신이 ‘혁명적’이라고 여겼던 AI 도구들이 사실은 고가의 장난감에 불과했음을 깨닫게 될 것이다.

나는 최근 OpenAI가 오라클(Oracle)을 어떻게 무너뜨렸는지를 다룬 글을 썼고, 오늘 게재하는 이 글에는 그 일부 자료를 활용했다. 이 글은 내가 지금까지 쓴 글 중 최고의 작품 중 하나이며, 나는 이 글을 매우 자랑스럽게 생각한다.

유료 구독은 나에게도 훌륭한 혜택이며, 덕분에 나는 매주 이런 규모 크고 심층적인 무료 기사를 작성할 수 있다.

어제 아침, GitHub Copilot 사용자들은 내가 일주일 전 보도했던 소식을 공식적으로 확인받았다—2026년 6월 1일부터 모든 GitHub Copilot 요금제가 사용량 기반 과금으로 전환된다.

마이크로소프트는 더 이상 사용자에게 일정 횟수의 ‘요청(request)’을 제공하지 않고, 사용자가 실제로 소비한 모델 비용을 기준으로 과금하기로 했다. 마이크로소프트는 이를 “지속 가능하고 신뢰할 수 있는 Copilot 사업 및 모든 사용자 경험을 위한 중요한 한 걸음”이라고 설명했다. 이제 사용자가 얼마만큼 활용할 수 있는지는 구독료로 살 수 있는 토큰 양에 달려 있다(예: 월 19달러 요금제는 19달러 상당의 토큰을 사용할 수 있음).

즉, 번역하면: “우리는 더 이상 GitHub Copilot 사용자를 보조할 수 없습니다. 그렇지 않으면 애미 후드(Amy Hood, 마이크로소프트 CFO)가 야구방망이를 들고 찾아올 겁니다.”

이 발표문 자체는 이러한 가격 조정이 어떻게 포장될지를 보여주는 흥미로운 예시이기도 하다:

Copilot은 이미 1년 전의 제품이 아니다. 편집기 내 보조 도구에서 벗어나, 최신 모델을 활용해 전체 코드베이스를 반복 탐색하며 장시간·다단계 코딩 세션을 자율적으로 수행하는 에이전트 플랫폼으로 진화했다. 에이전트 기반 사용이 기본 모드가 되었고, 이는 상당히 높은 계산 및 추론 비용을 초래한다. 이제 단순한 채팅 질문 하나와 수시간 동안 진행되는 자율 코딩 세션 하나가 동일한 요금을 부과받는다. GitHub는 이처럼 급증하는 추론 비용을 지금까지 감당해 왔지만, 현재 요청 횟수 기반의 프리미엄 요금제는 더 이상 지속 가능하지 않다. 사용량 기반 과금제는 이 문제를 해결한다. 이 방식은 가격 책정을 실제 사용량과 정확히 맞추어 장기적인 서비스 신뢰성을 유지하고, 과도한 사용자에 대한 제약을 줄이는 데 도움이 된다.

보라, 마이크로소프트가 약 200만 명의 사용자에게 컴퓨팅 파워를 보조해 주고 있는 것이 아니라, AI가 너무 강력하고 복잡해져서 사실상 완전히 다른 제품이 되어버린 것이다!

물론 Copilot은 ‘1년 전과 다르다’고 하지만, 그 이면의 경제적 불일치는 거의 변함없다: 마이크로소프트는 지난 3년간 사용자들이 매달 구독료보다 훨씬 많은 토큰을 소비하도록 허용해 왔다. 《월스트리트 저널》 2023년 10월 보도에 따르면:

개인 사용자는 이 AI 보조 도구를 월 10달러에 이용한다. 관계자에 따르면 올해 초 몇 달간 회사는 평균적으로 사용자 한 명당 매달 20달러 이상을 손해 봤으며, 일부 사용자의 경우 한 달에 80달러를 지출하기도 했다.

당연히 GitHub Copilot 사용자들은 지금 분노하고 있으며, 제품이 “죽었다”, “완전히 망가졌다”고 말하고 있다.

나는 2년 전 서브프라임 AI 위기(Subprime AI Crisis)라는 글에서 이미 이 날을 예언했다:

드디어 그날이 왔다. 당신이 사용하는 모든 AI 서비스는 컴퓨팅 파워를 보조하고 있고, 따라서 모든 서비스가 적자를 보고 있다:

당신이 AI 스타트업의 서비스를 유료로 이용할 때—물론 OpenAI와 Anthropic도 포함된다—당신은 Anthropic의 클로드(Claude)를 월 20달러, 100달러 또는 200달러에 구독하거나, Perplexity를 월 20달러 또는 200달러에, 혹은 OpenAI를 월 8달러, 20달러 또는 200달러에 구독하는 식의 월정액제를 지불한다. 일부 기업 환경에서는 ‘할당량(quota)’ 형태로 제공되는데, 예를 들어 Lovable은 월 25달러 구독료에 ‘월 100개의 할당량’과 25달러 상당의 클라우드 호스팅(2026년 1분기 말까지 유효)을 제공하며, 이 할당량은 다음 달로 이월 가능하다. 당신이 이러한 서비스를 사용할 때 관련 기업은 AI 연구소에 백만 토큰당 요금을 지불하거나(Anthropic 및 OpenAI의 경우), 클라우드 서비스 제공업체에 GPU를 임대해 모델을 실행하는 비용을 지불한다. 토큰 하나는 대략 단어 3/4개에 해당한다. 사용자로서 당신은 토큰 소비를 직접 느끼지 못하고, 단지 입력과 출력 과정만 경험할 뿐이다. AI 연구소는 ‘토큰’, ‘메시지’, 혹은 5시간 기준 100% 제한률 같은 용어로 서비스 비용을 은폐하므로, 당신은 실제로 이것이 얼마나 비싼지 전혀 알지 못한다. 백엔드에서는 AI 스타트업들이 막대한 자금을 태우고 있으며, 최근까지 Anthropic은 사용자가 구독료 1달러를 쓸 때마다 최대 8달러 상당의 컴퓨팅 파워를 소비하도록 허용했다. OpenAI도 마찬가지였으나, 구체적인 수치는 측정하기 어려웠다.

AI 스타트업과 클라우드 거대 기업은 보조금과 적자를 기반으로 한 제품을 통해 충분한 사용자를 확보해, 기업이 가격을 인상해도 바꾸기를 거부할 정도로 중독시킬 수 있다고 믿었다. 또 토큰 비용이 시간이 지남에 따라 하락할 것이라 믿었지만, 실제로는—일부 모델의 가격은 하락했을지 몰라도, 새로운 ‘추론(inference)’ 모델은 훨씬 더 많은 토큰을 소비하게 되어, 결과적으로 추론 비용이 시간이 갈수록 오히려 상승했다.

두 가지 전제 모두 틀렸다. 월정액제는 대규모 언어 모델(LLM)을 연결하는 어떤 서비스에도 합리적이지 않다.

생성형 AI의 핵심 경제 모델은 이미 붕괴되었다

이렇게 생각해 보라. 우버(Uber)(아니, 이건 우버와 전혀 다르다)가 차량 호출 가격을 인상할 때, 근본적인 경제 논리는 변하지 않는다. 승객과 운전자에게 보이는 것도 동일하다—사용자는 한 번의 이동에 대해 요금을 지불하고, 운전사는 한 번의 이동에 대해 수입을 받는다. 운전사는 여전히 연료비, 자동차 보험, 지방정부가 요구하는 허가증, 그리고 차량 구매 시 발생할 수 있는 자금 조달 비용을 부담해야 하며, 이 비용은 우버가 보조하지 않는다. 우버의 막대한 적자는 보조금, 끝없는 마케팅 비용, 그리고 실패가 예정된 자율주행 자동차 개발 등에서 비롯된 것이다.

생성형 AI 구독제는 우버와 완전히 다르다

AI 가격 책정의 불일치 규모를 설명하기 위해, 당신에게 아주 다른 비즈니스 모델을 채택한 우버의 병렬 역사(Parallel History)를 상상해 보라고 부탁하겠다.

생성형 AI 구독제는, 만약 우버가 20달러를 월정액으로 받아 100마일 이내의 차량 호출을 월 100회 제공하면서, 가솔린 가격이 갤런당 150달러인데도 우버가 연료비를 전부 부담하는 것과 같다. 누군가 석유가 언젠가는 측정할 가치조차 없을 만큼 싸질 것이라고 주장하기 때문이다.

결국 우버는 사용자에게 차량 호출 자격을 부여하기 위해 월정액을 받은 후, 소비한 연료량에 따라 추가 요금을 부과하기로 결정한다. 갑자기 사용자는 월 20달러로 100회 호출을 하던 것이, 월 20달러의 자격료 + 10마일 이동에 26달러의 연료비를 내는 것으로 바뀐다. 당연히 사용자들은 불만을 품을 것이다.

이야기가 과장처럼 들릴 수도 있지만, 실제로 생성형 AI 산업, 특히 GitHub Copilot에서 벌어지고 있는 일을 꽤 정확하게 묘사한 은유다.

GitHub Copilot 이전의 요금제는 월 300회의 프리미엄 요청과 GPT-5 미니(GPT-5 mini) 등 모델을 사용한 ‘무제한 채팅 요청’을 허용했다. 각 요청(마이크로소프트의 표현에 따르면)은 “Copilot에게 특정 작업을 수행해 달라고 요청하는 모든 상호작용”을 의미하며, 요청 기반 시스템의 후반부에서는 클로드 오푸스(Claude Opus) 4.6처럼 더 비싼 모델을 사용하면 프리미엄 요청 3회를 차지했다. 프리미엄 요청을 모두 소진하면, Copilot은 그달 남은 기간 동안 더 저렴한 모델을 마음껏 사용할 수 있도록 했다.

그러나 상황이 항상 그런 것은 아니었다. 2025년 5월까지 마이크로소프트는 사용자에게 모델 무제한 이용을 허용했고, 그럼에도 불구하고 사용자들은 제품에 어떤 제약이라도 느끼면 분노했다.

마이크로소프트—모든 AI 기업과 마찬가지로—지속 불가능한 서비스를 판매함으로써 고객을 속였다. 왜냐하면 LLM 기반 서비스를 월정액으로 판매하는 것은 결코, 결코 합리적이지 않기 때문이다.

토큰 기반 과금제가 얼마나 비쌀지 궁금하다면, GitHub Copilot 서브포럼의 한 사용자가 과거 한 번의 프리미엄 요청에 약 11달러 상당의 토큰이 소비됐다는 사실을 발견했다. 한 번의 ‘요청’이란 컨텍스트 윈도우에 6만 토큰을 사용하고, 여러 도구와 내부 ‘턴(turn)’(모델이 수행하는 작업)을 거쳐 출력을 생성하는 과정을 의미하기 때문이다.

또한 환각(hallucination)을 유발하기 쉬운 대규모 언어 모델의 근본적인 신뢰성 부족도 있다. 한 번의 프리미엄 요청이 무한 루프에 빠져 반쯤 완성된 코드를 내뱉는 것은 실망스럽겠지만, 그것이 당신 자신의 돈으로 인해 발생한다면, 같은 오류는 더 이상 쉽게 용서되지 않는다.

사용자들은 또한 토큰 기반 과금 방식과는 완전히 다른 방식으로 제품을 사용하도록 훈련되어 왔으며, 많은 사람들은 자신이 얼마나 많은 ‘토큰’을 태우고 있는지, 혹은 특정 작업에 얼마나 많은 토큰이 필요한지조차 제대로 인지하지 못한다. 이는 사용하는 모델에 따라 달라지기 때문이다.

이것은 우버와 전혀 다르다. 이와 반대라고 말하는 사람은 누구나 악의적 행위를 정당화하려는 것이다. 우버는 가격을 인상했을지 몰라도, 플랫폼의 근본적인 경제 논리를 극적으로 바꾸거나, 사용자가 제품을 사용하는 방식을 완전히 바꾸도록 강요하지는 않았다. 우버가 갑자기 갤런당 요금을 부과하기 시작했다고 해서 그렇지는 않다.

월정액 AI 구독제는 모두 AI 보조금 사기의 일부이며, 생성형 AI를 그 실제 비용과 의도적으로 분리시키려는 시도다

LLM 기반 서비스를 경제적으로 지속 가능하게 제공할 수 있는 방법은, 사용자별 실제 토큰 소비량을 기준으로 과금하는 것 외에는 존재하지 않았고, 앞으로도 존재하지 않을 것이다. 이처럼 고객을 속이는 과정에서 기업들은 허위 혜택과 의심스러운 투자 수익률을 갖춘 제품을 만들어냈다.

이 사실은 오래전부터 명백했다.

경제학적 관점에서, 월정액은 비용이 상대적으로 고정되어 있을 때만 합리적이다. 피트니스 센터는 회원권을 판매할 수 있다. 왜냐하면 장비 마모 정도, 수업 운영 비용, 그리고 특정 기간 동안 전기·직원·수도 비용 등이 어느 정도 예측 가능하기 때문이다.

Google Workspace 고객—AI 도입 이전까지—의 비용은 문서 접근 또는 저장 비용, 그리고 Google Docs 등의 지속 운영 비용이었다. 디지털 저장 비용은 상대적으로 낮았고(LMM과 달리 Google Workspace는 계산 요구 수준이 낮음), 따라서 특히 과도하게 Google Drive를 사용하는 고객이 월정액 이윤을 침식시키지 않는다.

그러나 이러한 서비스는 고의적으로 토큰 수량이나 특정 활동에 드는 정확한 비용을 숨긴다. 이는 사용자가 속도 제한(Rate Limit)의 의미를 제대로 이해하지 못한다는 것을 의미하며, 따라서 속도 제한이 갑작스럽게 변경될 때마다 고객은 자신이 서비스로 얼마나 많은 실질적인 작업을 수행할 수 있는지 파악하느라 애쓰게 된다.

이는 학대적이고 조작적이며 사기적인 경영 방식이며, 그 유일한 목적은 Anthropic, OpenAI 및 기타 AI 기업이 사용자 기반을 확대하는 것이다. 대부분의 AI 사용자는 구독을 통해 매달 1달러를 쓸 때마다 8~13.5달러 상당의 토큰을 소비할 수 있다는 사실을 기준으로, 그들의 실제 혹은 상상 속 혜택을 인식하기 때문이다.

이러한 고의적 사기 행위의 유일한 목적은, 대부분의 사람들이 생성형 AI의 실제 비용에 절대 노출되지 않도록 하는 것이다. 《애틀랜틱》이 클로드 코드(Claude Code)를 Anthropic의 ‘챗GPT 순간(ChatGPT Moment)’이라 부르며 열정적인 논설을 쓸 때, 그것은 월 20달러 구독제를 기준으로 한 것이지, Anthropic가 실제로 이 서비스를 제공하는 데 드는 토큰 소비 비용을 기준으로 한 것이 아니다. 이는 다시금 기자가 모델이 범할 수 있는 ‘사소한 오류’를 용서하거나, “더 복잡한 프로그래밍 작업에서 막히는 것”을 눈감아 주도록 만든다.

만약 기자가 실제 토큰 소비량에 따라 요금을 지불해야 했고, 막힐 때마다 15달러의 토큰 비용이 청구됐다면, 나는 그녀가 그런 오류를 그렇게 쉽게 용서하지는 않았을 것이라 확신한다.

그러나 이것은 모두 사기의 일부일 뿐이다.

매우 중요하게, 주류 미디어에서 AI를 다루는 기자들은 실제로 이러한 서비스가 얼마나 비싼지 전혀 이해하지 못한다. 그리고 챗GPT나 클로드 코드 등 서비스에 관한 주류 기사는 거의 대부분, 특정 작업 하나가 사용자에게 얼마를 들일지 전혀 모르는 사람들이 작성한 것이다.

기억하라: 생성형 AI 서비스는 대부분 실험적 제품이며, 기능 면에서 현대의 다른 소프트웨어나 하드웨어와는 아무런 유사성이 없다. 사람들은 그냥 챗GPT나 클로드 앞에 서서 일을 시킬 수는 없다.

물론, 그렇게 할 수는 있다. 그러나 프롬프트를 잘못 작성하거나, 작동 원리를 이해하지 못하거나, 입력한 내용에 실수를 저지르거나, 모델이 단순히 틀릴 경우, 원치 않는 결과를 얻게 되고, 다시 프롬프트를 작성해야 한다. LLM은 본질적으로 예측 불가능하다.

당신은 LLM이 특정 동작을 반드시 수행할 것이라고 보장할 수 없으며, 현실에 기반한 결과를 반드시 제공한다고도 보장할 수 없다. 특정 작업—비록 과거에 LLM으로 수차례 수행했던 작업이라 하더라도—에 얼마가 들지 확실하게 알 수 없으며, 모델이 언제 어디서 어떤 식으로든 무너져서 무엇인가를 삭제하거나, 아무것도 하지 않으면서 마치 했던 것처럼 행동할지도 모른다.

만약 사용자가 실제 요금을 지불하도록 강제된다면, 나는 많은 사람들이 즉시 이 제품을 포기할 것이라 생각한다. 왜냐하면 LLM이 무엇을 할 수 있는지 탐색하려고 아무렇게나 시도하다 보면, 쉽게 5달러 상당의 토큰을 태울 수 있기 때문이다.

부연 설명: 사실, 원하는 결과를 얻지 못한 채도 막대한 돈을 태울 수 있다. 왜냐하면 LLM은 진짜 인공지능이 아니기 때문이다! 진정으로 그 한계를 이해하는 사람이라면, LLM이 자신이 할 수 있다고 주장하는 기술적·경제적으로 완전히 불가능한 일을 하도록 설득하려고 30달러, 50달러, 심지어 100달러를 태우는 일이 어렵지 않다. 이에 대한 용어가 있다. 바로 ‘아첨하기(flattery)’. LLM은 일반적으로 사용자를 긍정하도록 설계되어 있으며, 위험하거나 터무니없는 말을 하더라도 그렇게 한다. 이는 “당신이 기술적·경제적으로 완전히 불가능한 거대한 일을 원하십니까?”라고 말하는 것으로까지 확장될 수 있다. 물론입니다! 이것이 바로 업계가 이러한 비용을 은폐하려는 이유다—이건 정말로 ‘먹튀’다!

나는 대부분의 AI 구독제가 토큰 기반 과금제로 전환되는 것이 불가피하다고 생각한다. 특히 Anthropic와 OpenAI는 이미 기업 고객에게 그렇게 하고 있다.

일반 기업이 토큰 기반 과금제로 전환할 수 있을까? Anthropic는 클로드 코드 사용자들이 하루 평균 13~30달러(연간 7,000달러 이상)를 쓴다고 추정하며, 대규모 조직은 연간 수십만~수백만 달러를 지출한다

지난주 내가 논의한 바에 따르면, 우버의 CTO는 한 회의에서 2026년 전체 AI 예산을 몇 달 만에 소진했다고 밝혔고, 골드만삭스는 일부 기업이 AI 토큰에 직원 급여의 최대 10%를 지출하고, 향후 분기에는 이 비율이 100%까지 치솟을 수 있다고 조언했다.

이는 모든 AI 사용자에게 가능한 한 많이 서비스를 사용하게 하면서도 그 실제 비용을 은폐하려는 직접적인 결과다. ‘가능한 한 많이 AI를 사용하라’고 지시하는 모든 대기업은, 사실상 실제 토큰 소비를 완전히 무시하거나 이탈한 상태에서 그렇게 하고 있다. 기업이 실제 비용을 지불해야 하는 상황이 되면, 나는 이 기술에 대한 어떤 투자도 경제적으로 정당화할 수 있는지 확신하지 못한다.

물론 당신은 “엔지니어들이 코드를 더 빨리 배포한다”는 식의 헛소리를 할 것이다. 나는 알고 있다. 그러나 얼마나 더 빠른가? 그래서 얼마나 벌었거나 아꼈는가? 만약 인건비의 10%를 AI 토큰에 쓴다면, 이 추가 비용은 다른 곳에서 보충되었는가? 나는 그렇게 되지 않았다고 확신한다. 나는 토큰에 막대한 자금을 투입한 기업 중 어느 곳도 투자 수익률을 실현했다는 증거를 찾지 못했다. 이것이 바로 AI 투자 수익률에 관한 모든 연구가 실증적 근거를 찾지 못하는 이유다.

대부분의 경우, 생성형 AI의 다양한 가능성에 대해 열정적으로 이야기하는 사람들은 그 실제 비용을 전혀 부담하지 않은 채 경험하고 있다. 트위터에서 자신의 전체 엔지니어링 팀이 클로드 코드를 미친 듯이 사용한다고 끊임없이 쓰는 광신자들조차, 월 125달러의 Teams 구독을 사용하고 있으며, 그 사용 제한은 Anthropic의 일반 소비자용 월 100달러 구독과 거의 동일하다. 링크드인에서 자신이 어떤 Perplexity 제품으로 ‘몇 분 만에 수시간 분량의 작업을 완료했다’고 단정하는 괴물들도, 최대 월 200달러의 Perplexity Max 구독을 구매한 것뿐이다.

실제로, 10명 규모의 팀이 월 1,250달러를 지불하는 Teams 구독은 API 호출 비용으로 매달 5,000~10,000달러 이상을 태울 가능성이 매우 높다. Anthropic의 성장 담당 책임자 아마울 아바사레(Amol Avasare)는 지난주, Max 구독이 ‘중도 이상의 채팅 사용’을 위해 설계된 것이지, 사람들이 클로드 코드와 Cowork에서 하는 작업을 위한 것이 아니라고 분명히 밝혔으며, “최고 수준의 사용자 경험을 계속 제공하기 위한 다양한 옵션을 검토 중”이라고 말했다. 즉, “우리는 언젠가 가격을 조정할 것이다”는 뜻이다.

사람들이 특히 대규모 코드베이스를 다루고, 코딩 및 인프라 도구를 빈번하게 호출하는 프로그래밍 프로젝트에서 토큰이 얼마나 비싼지 인지하고 있는지 확신하지 못한다. 월 200달러를 쓰는 사람이 350달러, 400달러 또는 500달러를 감당할 수 있을까? 어느 달에 이보다 더 많이 쓸 수 있을까? 예산이 초과되면 어떻게 될까? 아니면 실제로 작업을 완료하는 데 필요한 비용을 감당조차 못한다면?

좀 더 현실적인 예를 들어 보겠다. 지난 4월 초까지 Anthropic 자체의 클로드 코드 개발자 문서(아카이브)에는 “[클로드 코드 사용자]의 평균 비용은 개발자당 하루 6달러이며, 90%의 사용자는 하루 비용을 12달러 이하로 유지한다”고 적혀 있었다. 이번 주 기준, 문서는 다음과 같이 수정되었다:

클로드 코드는 API 토큰 소비량에 따라 과금됩니다. 구독 요금제 가격(Pro, Max, Team, Enterprise)은 claude.com/pricing에서 확인하세요. 개발자당 비용은 선택한 모델, 코드베이스 크기, 사용 패턴(여러 인스턴스 실행 또는 자동화 등)에 따라 크게 달라집니다. 기업 배포 환경에서는 개발자당 활성 근무일 기준 평균 비용이 약 13달러이며, 월 150~250달러 사이입니다. 90%의 사용자는 개발자당 활성 근무일 기준 30달러 이하의 비용을 유지합니다. 팀의 예산을 예측하려면, 작은 시범 팀을 구성하여 아래 추적 도구를 사용해 기준선을 설정한 후 확장하세요.

만약 한 달 평균 근무일을 21일로 가정한다면, 클로드 코드 사용자의 평균 비용은 월 약 273달러, 즉 연간 3,276달러이다. 근무일 기준 30달러라면, 월 630달러, 연간 7,560달러가 된다.

이 숫자는 놀랍다. 더욱 놀라운 것은, 당신이 Anthropic의 최신 모델을 사용한다면 하루 30달러로는 결코 충분하지 않다는 점이다. 클로드 오푸스 4.7의 요금은 백만 입력 토큰당 5달러, 백만 출력 토큰당 25달러이다. 백만 토큰은 약 5만 줄의 코드에 해당하며, 당신이所谓 ‘최첨단 모델’을 사용한다면, 최소한 백만 토큰은 소비할 것이 분명하다. 특정 작업에 어떤 모델을 사용해야 할지 잘 모를 경우, 이 수치는 급격히 증가한다.

이제 이 30달러라는 숫자를 좀 더 자세히 살펴보자.

10명의 개발자 팀이라면, 연간 75,600달러이며, 우리는 근무일만 계산했다.

만약 3개월 동안 평균 근무일 기준 50달러로 올라간다면, 88,200달러가 된다.

한 달 동안 100달러를 넘어서면, 연간 102,900달러가 된다.

하루에 300달러를 쓴다면, 10명의 팀은 연간 756,000달러를 쓴다.

이것은 자금이 풍부한 스타트업이나 메타(Meta) 같은 ‘바나나 공화국’의 여유 자금 사고방식에서는 가능할지 몰라도, 비용을 진정으로 고려하는 기업이라면, 측정조차 불가능한 ‘생산성 향상’이라는 모호한 혜택을 위해 5자리 또는 6자리 수의 추가 비용을 지출하는 것을 정당화하기는 어렵다.

지금 나는 대부분의 기업을 세 가지 유형으로 분류한다:

스포티파이(Spotify)나 우버처럼 AI에 집착하는 CEO가 있는 대규모 조직의 기업 배포. 나는 자금이 풍부한 대규모 스타트업도 이 범주에 포함시킨다.

보조금이 적용된 ‘Teams’ 구독을 사용하는 소규모 스타트업.

클로드나 기타 AI 구독 서비스를 월정액으로 이용하는 개인 사용자.

대규모 조직은 여전히 ‘최고의 엔지니어’는 코드를 전혀 쓰지 않는다는 의심스러운 혜택을 이유로, 소프트웨어 엔지니어에게 수백만 달러의 AI 토큰을 태우고 있다고 말할 수 있다.

한 차례의 실망스러운 실적 발표 전화 회의만으로도 이 서사가 바뀔 수 있다. 어느 순간, 투자자들—심지어 지금까지 AI 거품을 부풀리던 머리 나쁜 바보들조차—지속적으로 증가하는 R&D 비용(AI 토큰 소비는 일반적으로 여기에 숨겨짐)을 질문하기 시작할 것이며, 기업의 수익 성장이 이를 따라가지 못할 경우, 메타처럼 비용 통제를 위해 더 많은 해고가 발생할 것이다. 그리고 누군가 “이런 것들이 우리에게 정말로 더 빠르고 더 나은 일을 시키고 있나요?”라고 물을 때, 결국 축소될 것이다.

나는 또한 6개월 이내에, 인건비의 10% 이상을 AI 토큰에 태우는 스타트업들이 투자자들에게 이것이 필수적이라고 설득하기 어려울 것이라 생각한다.

모두가 토큰 기반 과금제로 전환되면, 나는 생성형 AI에 대한 과장된 홍보가 지금처럼 많지 않을 것이라 확신한다.

AI 데이터센터 및 컴퓨팅 파워의 경제학은 비합리적이다

사람들이 AI 데이터센터에 대해 이야기하는 방식은 현실과 완전히 괴리되어 있으며, 나는 사람들이 이 시대 전체가 얼마나 터무니없어졌는지 인지하지 못하고 있다고 생각한다.

AI 데이터센터 건설 및 운영 비용은 매우 높고, 실제 수입은 매우 적다

TD Cowen의 제롬 다링(Jerome Darling)에 따르면, 핵심 IT(GPU 및 관련 하드웨어) 비용은 약 3,000만 달러이며, 1MW 데이터센터 용량당 비용은 1,400만 달러이다. 데이터센터 건설은 전력 공급이 확보된 경우에도 1~3년이 소요되는 것으로 보인다.

2028년 말까지 완공될 것으로 알려진 114GW 데이터센터 중, 실제로 공사가 진행 중인 곳은 15.2GW에 불과하다. 그리고 ‘공사 중’이란 말은 단지 ‘땅에 구덩이가 파여 있다’는 의미일 수도 있다. 이는 해당 시설의 용량이 곧바로 사용 가능해질 것이라는 의미가 아니며, 그렇게 여겨서도 안 된다.

단순히 시작해 보자: ‘100MW’를 생각할 때마다 ‘44억 달러’를 떠올리라. 이 금액의 상당 부분은 NVIDIA GPU에 쓰인다.

따라서 각 AI 데이터센터는 처음부터 수백만 달러의 적자를 보게 되며, 6년 감가상각 계획을 적용하더라도 수년이 걸려야 회수할 수 있다… 게다가 NVIDIA의 연간 업그레이드 주기 때문에, 첫 번째 고객 계약이 끝나면 그 GPU들이 더 이상 많은 수익을 창출하지 못할 가능성이 높다.

OpenAI와 Anthropic을 제외한 AI 컴퓨팅 파워 고객층이 존재하는지도 불분명하다. 이 두 기업의 수요가 현재 건설 중인 AI 데이터센터의 50%를 차지하며, 이 중 어느 한쪽이라도 지불 능력이 없으면 거대한 시스템적 취약점이 발생할 것이다.

어쨌든, 이러한 데이터센터가 지속적으로 어떤 요금을 부과할지도 불분명하다. 현물 시장 가격은 B200 GPU 기준 시간당 약 4.50달러일 수 있으나, 장기 계약 가격은 훨씬 낮은데, 한 창업가(《더 인포메이션》 보도에 따름)는 1년 약정으로 GPU당 시간당 약 3.70달러를 지불한다고 밝혔다.

명확히 해야 할 점은, ‘현물 비용’—다른 사람의 서버에서 임의로 GPU를 구동하는 비용—과 ‘계약 컴퓨팅 파워’—데이터센터 자본지출의 대부분을 차지함—를 구분해야 한다는 것이다. 대부분의 데이터센터는 한두 개의 대규모 고객을 목표로 건설되므로, 이 고객들은 더 저렴한 혼합 요금을 협상할 가능성이 높다.

따라서 많은 데이터센터는 시간당 3.70달러보다 훨씬 낮은 요금을 부과한다. 왜냐하면 이들은 일반적으로 MW(또는 kW) 단위로 요금을 책정하기 때문이다.

이곳에서 경제학이 붕괴되기 시작한다.

100MW 데이터센터의 붕괴된 경제학—시간당 2.55달러, 100% 입주율 기준 매출총이익률 16%, 부채로 인해 이익 없음

이것은 100MW 데이터센터의 초기 비용이다. 100MW 데이터센터는 실제 청구 가능한 용량이 85MW에 불과할 수 있으며, 초대규모 요금 책정에 정통한 소스들과의 논의를 통해, MW당 수입은 약 1,250만 달러, 즉 연간 수입은 약 10.63억 달러로 예상된다.

지금, 나는 당신이 아는 대부분의 데이터센터 기업들이 실제로 데이터센터를 건설하지 않는다는 점을 분명히 해야 한다. 대신 이 작업은 Applied Digital 같은 기업에 맡기며, 이들은 ‘호스팅 파트너(hosting partner)’라고도 불린다. 예를 들어, CoreWeave는 노스다코타주의 데이터센터를 사용하기 위해 Applied Digital에 호스팅 비용을 지불한다. CoreWeave는 데이터센터 내 모든 GPU 및 기타 기술을 관리한다.

경제적 불일치를 설명하기 위해, 이론적인 AI 컴퓨팅 파워 기업에 임대된 데이터센터를 예로 들어 설명하겠다.

이 데이터센터의 GPU는 아마도 NVIDIA의 블랙웰(Blackwell) 칩일 것이다. 더 정확히는, 8개의 B200 GPU로 구성된 포드(pod)를 사용할 가능성이 높으며, 소매가는 약 45만 달러, 즉 GPU당 56,250달러이다. 85MW의 핵심 IT 부하를 기준으로, MW당 총 자본지출은 약 36.78만 달러, 즉 총 IT 자본지출은 약 31.26억 달러, 또는 GPU에만 26.7억 달러가 소요된다.

이 데이터센터가 노스다코타주 엘렌데일(Ellendale)에 있다고 가정하면, 산업용 전기 요금은 kWh당 약 6.31센트이며, 연간 전기 요금은 약 5,540만 달러이다. 소스들과의 논의를 바탕으로, 나는 유지보수·인력·전원 교체 등 지속적인 운영 비용이 수입의 약 12%, 즉 연간 약 1.28억 달러로 추정하며, 이로 인해 총 비용은 1.834억 달러가 된다.

잠깐, 미안하다. 당신은 핵심 IT에 대한 호스팅 비용도 지불해야 한다. Brightlio에 따르면, 이 비용은 일반적으로 규모와 위치에 따라 kW당 월 180~200달러 수준이며, 나는 130달러를 채택했는데, 이는 연간 약 1.33억 달러에 해당한다. 이로 인해 총 비용은 3.164억 달러가 된다.

음, 이는 여전히 10.6억 달러보다 적으므로, 아직 괜찮은가?

틀렸다! 당신은 31.26억 달러 상당의 IT 장비를 6년간 감가상각해야 하며, 이는 연간 약 5.21억 달러를 의미한다. 즉, 연간 총 비용은 약 8.374억 달러가 되어, 약 1.686억 달러의 연간 이익, 즉 약 16.7%의 매출총이익률을 남긴다…

…단, 100% 입주율을 유지할 경우에만 그렇다! 데이터센터는 GPU 설치와 고객 입주에 1~2개월이 소요될 수 있으며, 이 기간 동안 수입은 제로이고, 호스팅·전기·운영 비용을 지불하면서 손실은 훨씬 커진다. 비용은 훨씬 낮지만(나는 전기 비용 10%, 호스팅/운영 비용 15%로 모델링), 하루 손실은 약 327만 달러이다.

이 예시를 위해, 이 시설이 가동되기까지 추가로 한 달이 더 걸린다고 가정하자. 그러면 이미 약 1.02억 달러를 지불했고, 이는 회수 불가능하므로, 감가상각을 포함한 연간 총 비용은 9.394억 달러, 즉 매출총이익률은 6.6%가 된다.

잠깐, 이 GPU를 빌려서 구입하지는 않았지? 빌렸다면? 얼마나 심각한가? 오 맙소사—당신은 6년 만기의 자산담보대출(asset-backed loan)을 받았고, 대출가치비율(LTV)은 80%이며, 이는 6%의 이율로 28억 달러를 빌렸다는 뜻이다.

당신의 은행은 영원한 관대함으로 당신에게 특별한 거래를 해줬다—12개월의 유예기간 동안 이자만 지불… 약 1.68억 달러. 이로 인해 첫 해 총 비용(공정성을 위해 지연된 한 달은 제외)은 약 10.05억 달러에 달하며… 수입은 10.6억 달러이다.

이는 5.19%의 매출총이익률이며, 당신은 아직 원금 상환조차 시작하지 않았다. 원금 상환이 시작되면, 매달 5,410만 달러를 상환해야 하며, 향후 5년간 연간 약 6.49억 달러, 총 약 14.8억 달러, 즉 약 -40%의 매출총이익률이 된다.

명확히 해야 할 점은, 이 모든 계산은 100% 가동률을 전제로 하며, 임차인이 매번 정시에 지불한다는 가정 하에 이루어진 것이다.

스타게이트 아빌린(Stargate Abilene)은 재앙이다—GPU당 시간당 2.94달러, 연간 수입 100억 달러, 수년간 지연, 매년 수십억 달러 적자인 단일 임차인

데이터센터 역사상 가장 경제적으로 타당한 단일 프로젝트—세계 최대 AI 기업을 위해 오라클이 건설한 대규모 캠퍼스—에 대해 이야기해 보자. 오라클은 수십 년의 역사를 가진 거의 초대규모 기업이며, 기업 및 정부에 고가의 데이터베이스 및 비즈니스 관리 소프트웨어를 판매해 왔다.

하, 나는 물론 농담을 하고 있다. 이곳은 정말로 악몽이다.

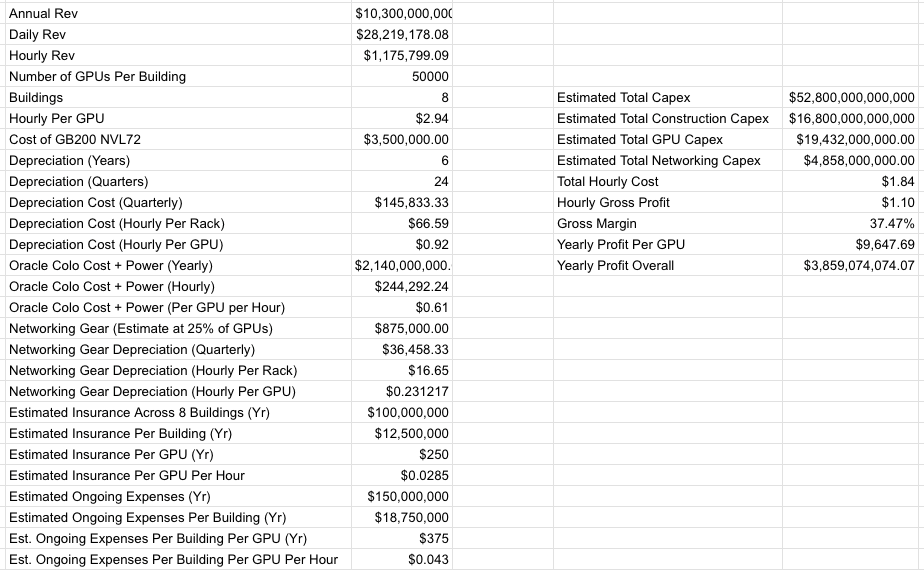

스타게이트 아빌린은 8개 건물, 1.2GW 규모의 데이터센터 캠퍼스로, 핵심 IT 용량은 약 824MW이며, 2024년 7월에 처음 발표되었다. 2026년 4월 27일 기준, 운영 중이며 수입을 창출하는 건물은 2개뿐이며, 3번째 건물에는 거의 아무 IT 장비도 없다. 나는 스타게이트 아빌린의 총 비용이 약 528억 달러에 달한다고 추정한다.

내 자체 보도에 따르면, 오라클은 스타게이트 아빌린에서 연간 약 100억 달러의 수입을 기대하고 있으며, 나는 오라클이 고객을 위해 건설한 7.1GW 데이터센터 용량에서 총 약 750억 달러의 수입을 기대한다고 추정한다—그 고객은 OpenAI이다. 내가 추가로 보도한 바에 따르면, 오라클은 2024년 아빌린에서 토지개발업체 크루소(Crusoe)에 연간 최소 21.4억 달러의 호스팅 및 전기 요금을 지불할 것으로 예상했다.

나는 또한 오라클이 아빌린의 모든 건설 비용을 부담하고 있는 것으로 보인다고 보충해야 한다.

내 계산 및 보도에 따르면, 나는 아빌린이 완전 가동되면 대략적인 매출총이익률이 37.47%에 이를 것이라고 추정한다:

명확히 해야 할 점은, 37.47%의 매출총이익률은 오라클의 실제 보험 또는 인력 비용 정확한 수치를 모르기 때문에 과도하게 높을 수 있다는 것이다. 나는 이 잡지가 확인한 문서를 바탕으로 한 추정치만 가지고 있다. 또한 오라클이 스타게이트 아빌린과 같은 프로젝트에 자신의 미래 전체를 걸고 있으며, 수십억 달러의 사전 비용을 발생시키고 있다는 점을 분명히 해야 한다. 이 사업은 OpenAI가 매번 정시에 지불하더라도 수년이 걸려야 이익을 낼 수 있다.

유감스럽게도, 나는 아빌린의 건설 비용이 얼마나 부채로 조달되었는지 확실히 알 수 없다. 나는 다만 오라클이 2025년 9월에 7년에서 40년까지 다양한 만기의 채권을 발행해 약 180억 달러를 조달했고, 최근 분기 실적 보고서에서 247억 달러의 부정 현금흐름을 기록했다는 사실만 안다.

확실한 것은, 오라클이 개발업체 크루소와 15년 임대 계약을 체결했으며, 오라클의 미래는 OpenAI가 계속해서 지불할 수 있는 능력에 심각하게 의존하고 있다는 점이다. 이는 다시 오라클이 스타게이트 아빌린 프로젝트를 완료할 수 있는지에 달려 있다.

또한 분명히 해야 할 점은, 연간 38.5억 달러의 이익은 OpenAI가 정시에 지불하고, 최대한 빠르게 아빌린에 입주하며, 모든 것이 계획대로 진행될 경우에만 실현 가능하다는 것이다.

OpenAI가 향후 4년 내에 8520억 달러의 수입, 자금 조달 및 부채를 조달하지 못하면, 스타게이트 데이터센터 프로젝트가 오라클을 망가뜨릴 것이다

유감스럽게도, 완전히 반대의 상황이 발생했다:

DatacenterDynamics 보도에 따르면, 최초 200MW의 전력은 “2025년”에 가동될 예정이었다. 시간이 지남에 따라 입주는 2025년 상반기에 시작되어 “2025년 내 1GW에 도달할 가능성”이 있었고, 2026년 중반에 전체 1.2GW 용량이 완료되고, 같은 시기에 전력이 공급되며, 2026년 말까지 64,000개의 GPU가 배치될 예정이었다. 2025년 9월 30일 기준, “두 개의 건물이 가동되었다”. 2025년 12월 12일 기준, 오라클 공동 CEO 클레이 마구유르크(Clay Magouyurk)는 아빌린이 “계획대로 진행 중”이며, “96,000개 이상의 NVIDIA 그레이스 블랙웰 GB200 GPU가 이미 인도되었다”고 밝혔다—이는 두 개 건물의 GPU 수량이다. 4개월 후인 2026년 4월 22일, 오라클은 트위터에서 “아빌린에서 200MW가 이미 가동 중이며, 8개 건물 캠퍼스의 전달은 여전히 계획대로 진행 중이다”고 발표했다. 현재 이것이 200MW의 핵심 IT 용량인지, 아니면 아빌린 캠퍼스의 총 사용 가능한 전력인지 불분명하다. 어쨌든, 이는 두 개 건물만 지원할 수 있다는 뜻이며, 오라클은 분명히 “계획대로 진행 중”이 아니다.

이것은 거대한 문제다. OpenAI는 실제로 존재하는 컴퓨팅 파워에 대해서만 지불할 수 있으며, 현재 수입을 창출하는 핵심 IT 용량은 단지 206MW에 불과하다. 세 번째 건물은 최소 한 달(분기 단위일 수도 있음) 이상 더 걸려야 가동될 수 있다.

그러나 전체 스타게이트 데이터센터 프로젝트에는 더 크고 근본적인 문제가 있다—오직 OpenAI가 그 터무니없고 만화 같은 예측을 실현할 경우에만 이 모든 것이 의미가 있다.

내가 금요일에 논의한 바에 따르면:

다시 한번 이 수치들을 반복하겠다: 건설 중인 7.1GW 스타게이트 데이터센터가 완공되면 약 750억 달러의 연간 수입을 창출할 것이며, 총 비용은 3400억 달러를 넘을 것이다. 오라클의 자유현금흐름은 마이너스 247억 달러이며, 다른 사업 부문은 정체 상태에 있으며, 이로 인해 부정에서 저수익 수준의 클라우드 사업이 유일한 성장 엔진이 되었다. 오라클과의 컴퓨팅 파워 계약—아마존, 마이크로소프트, 코어위브(CoreWeave), 구글, 세르베라스(Cerberas) 및 오라클과의 계약을 포함—을 실제로 이행하려면, OpenAI는 4년 내에 8520억 달러의 수입과/또는 자금 조달을 확보해야 한다. 이는 연간 250% 이상의 성장을 필요로 하며, 2030년 말까지 실질적으로 10배 성장해야 한다는 것을 의미한다. 이때 OpenAI는 현금흐름이 양수가 되는 방안을 찾아야만 이 수치들이 의미를 갖는다. 분명히 말하자면, OpenAI의 예측은 향후 4년간 6730억 달러의 수입을 창출하고, 이를 위해 2180억 달러를 태운다는 것이다. 이는 극도로 이익이 나지 않는 사업이며, 비록 이익을 낸다 해도, 오라클에 계속해서 지불하려면 지금보다 훨씬 더 많은 수입을 창출해야 한다.

나는 750억 달러라는 수치를, 나

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News